Centos7.0配置Hadoop2.7.0伪分布式

一、ssh免密登录

1.命令ssh-keygen、

overwrite输入y一路回车

2.将生成的密钥发送到本机

ssh-copy-id localhost中间会询问是否继续输入“yes”

3.测试免密登录是否成功

ssh localhost

二、Java配置

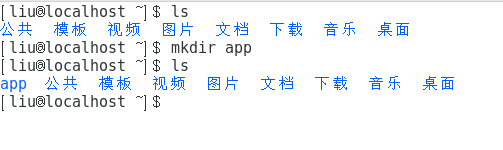

新建一个文件夹存放java和hadoop这里我在~目录下新建了一个app文件夹下面。

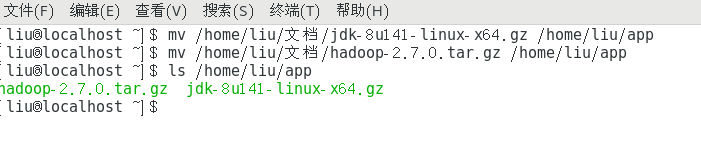

命令行移动文件到新建的app文件夹下。

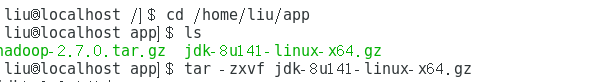

解压jdk压缩包。

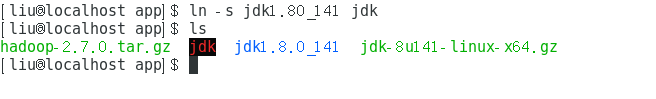

创建软连接或重命名已解压文件夹。

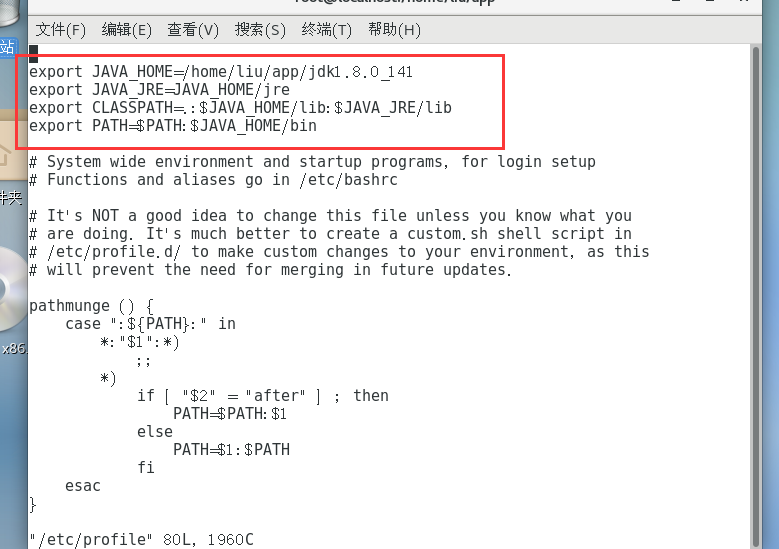

配置jdk环境变量。切换到root用户(输入su命令 切换root用户接着输入root用户密码),然后通过

vi /etc/profile

编辑、etc/profile文件配置环境变量。

编辑好后Esc键接着“:”在输入wq保存并且退出编辑。

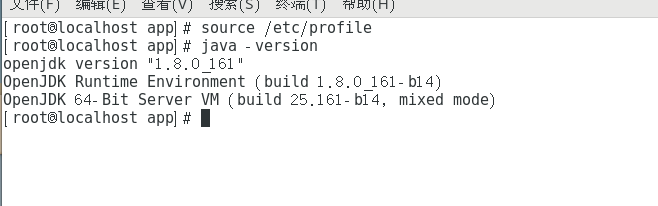

使/etc/profile生效,并检测是否配置成功。

配置成功。

三、Hadoop配置

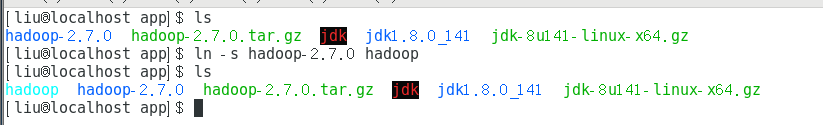

由root用户切换为普通用户,我这里用户名是liu所以使用命令 su liu。

解压Hadoop然后创建软连接或者重命名。

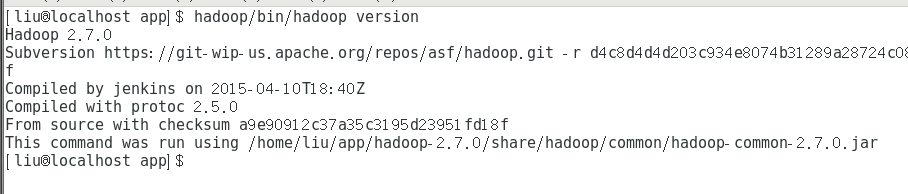

验证单击模式Hadoop是否安装成功,hadoop/bin/hadoop version

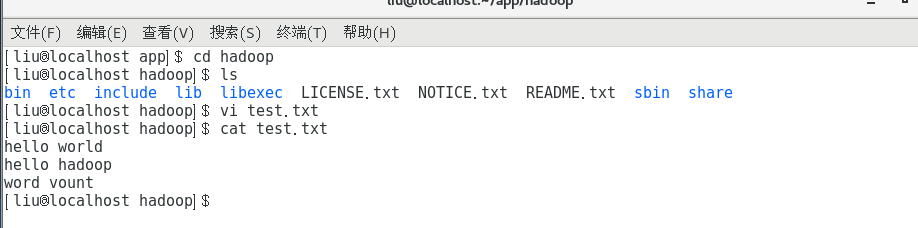

此时可以看到Hadoop版本2.7.0,安装成功。可以在hadoop目录下新建一个test.txt输入一下内容。

测试运行Hadoop自带的WordCount程序,统计单词个数。

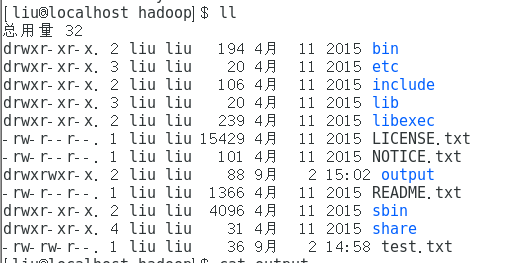

查看结果文件夹output

查看内容

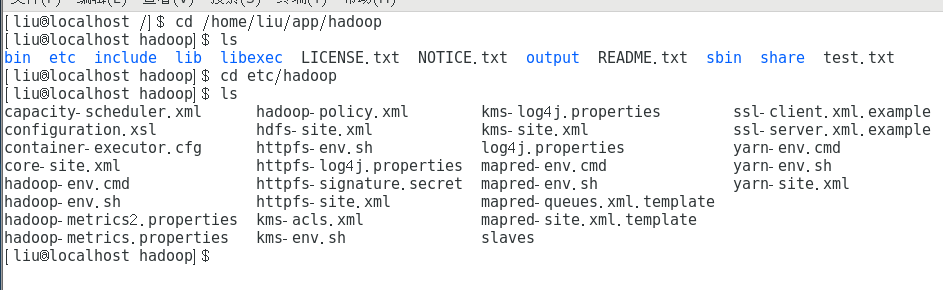

四、Hadoop伪分布式配置

进入hadoop目录下的/etc/hadoop文件

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/data/tmp</value>

</property>

<property>

<name>hadoop.proxyuser.hadoop.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.hadoop.groups</name>

<value>*</value>

</property>

</configuration>

修改core-site.xml文件

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>/data/dfs/name</value>

<final>true</final>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/data/dfs/data</value>

<final>true</final>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

修改hdfs-site.xml文件

export JAVA_HOME=/home/liu/app/jdk1.8.0_141

修改hadoop-env.sh

<configuration>

<property>

<name>mapreduce.frameword.name</name>

<value>yarn</value>

</property>

</configuration>

修改mapred-site.xml.template

<configuration> <!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-servies</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

修改yarn-site.xml

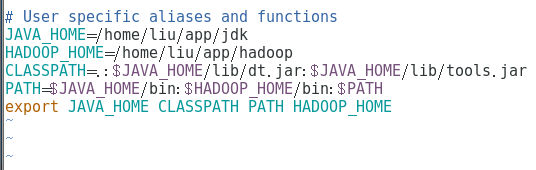

配置hadoop环境在 ~/.bashrc文件下

保存退出后记得source ~/.bashrc是修改生效。

然后在~下创建配置文件中的目录,

mkdir -p data/p

mkdir -p /data/dfs/name

mkdir -p /data/dfs/data

第一次需要格式化namenode,进入hadoop目录下。

cd /home/liu/app/hadoop

格式化。

bin/hdfs namenode -format

启动hadoop

sbin/start-all.sh

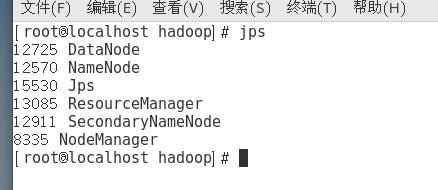

启动完毕后输入jps查看。

最重要的是NameNode和DataNode。这样就配置并且启动成功了。

需要注意的是如果jps后并没有则说明配置错误,请检查配置文件,若配置完环境变量后检测是否成功,提示失败并给出路径,很有可能是环境变量配置路径错误。

若第一次启动hadoop失败,后边重新启动的时候,请删除~下新建的data文件重新格式化NameNode。

Centos7.0配置Hadoop2.7.0伪分布式的更多相关文章

- Ubuntu14.04 安装配置Hadoop2.6.0

目前关于Hadoop的安装配置教程书上.官方教程.博客都有很多,但由于对Linux环境的不熟悉以及各种教程或多或少有这样那样的坑,很容易导致折腾许久都安装不成功(本人就是受害人之一).经过几天不断尝试 ...

- 在Linux(Centos7)系统上对进行Hadoop分布式配置以及运行Hadoop伪分布式实例

在Linux(Centos7)系统上对进行Hadoop分布式配置以及运行Hadoop伪分布式实例 ...

- Dockerfile完成Hadoop2.6的伪分布式搭建

在 <Docker中搭建Hadoop-2.6单机伪分布式集群>中在容器中操作来搭建伪分布式的Hadoop集群,这一节中将主要通过Dokcerfile 来完成这项工作. 1 获取一个简单的D ...

- hadoop2.6.0实践:002 检查伪分布式环境搭建

1.检查网络配置[root@hadoop-master ~]# cat /etc/sysconfig/networkNETWORKING=yesHOSTNAME=hadoop-masterGATEWA ...

- hadoop2.6.0实践:004 启动伪分布式hadoop的进程

[hadoop@LexiaofeiMaster hadoop-2.6.0]$ start-dfs.shStarting namenodes on [localhost]localhost: start ...

- 分布式配置hadoop2.5.0 2.6.x

1. sudo vim /etc/hostname 在master的机器上,改成 master 在slave上写 slave01,02,03...... 配置好后重启. 2. sudo vi ...

- 2-10 就业课(2.0)-oozie:10、伪分布式环境转换为HA集群环境

hadoop 的基础环境增强 HA模式 HA是为了保证我们的业务 系统 7 *24 的连续的高可用提出来的一种解决办法,现在hadoop当中的主节点,namenode以及resourceManager ...

- Hadoop - 操作练习之单机配置 - Hadoop2.8.0/Ubuntu16.04

系统版本 anliven@Ubuntu1604:~$ uname -a Linux Ubuntu1604 4.8.0-36-generic #36~16.04.1-Ubuntu SMP Sun Feb ...

- 在CentOS7下搭建Hadoop2.9.0集群

系统环境:CentOS 7 JDK版本:jdk-8u191-linux-x64 MYSQL版本:5.7.26 Hadoop版本:2.9.0 Hive版本:2.3.4 Host Name Ip User ...

随机推荐

- syniverse是一家怎样的公司

syniverse是一家怎样的公司?(详见问题描述)? 李超 核心业务当然是国际漫游了.简单来说就是做全球各个运营商之间的hub. 打个比方说,一家运营商A做通信,它的覆盖范围肯定是有限的(比如中 ...

- 如何实现一个 windows 桌面动态壁纸

更新: 2018/08/31 WS_MOUSE_LL 钩子,实现底层壁纸交互效果. 一.介绍 国内玩家第一次看到动态壁纸,都是出于一款来自 Wallpaper Engine 的 Steam 程序. ...

- 上传本地文件到github仓库

第一步:新建仓库 给仓库一个名字,备注 得到仓库地址: https://github.com/Lucasli2018/java-1-mybatis.git 第二步:进入要上传的文件夹,初始化上传文件夹 ...

- coercing to Unicode: need string or buffer, geoprocessing value object found

workbook.save(outxls),保存xls,出现上面的错误原因是:outxls不是错误 arcpy.AddMessage("--------"+outxls) cann ...

- https://www.atlassian.com/git/tutorials/git-gc

https://www.atlassian.com/git/tutorials/git-gc The git gc command is a repository maintenance comman ...

- socket_timeout

https://github.com/pika/pika/blob/03542ef616a2a849e8bfb0845427f50e741ea0c6/docs/examples/using_urlpa ...

- netty 聊天室

https://blog.csdn.net/qq_37372007/article/details/82937584 使用netty实现一个多人聊天室--failed: Error during We ...

- Oracle查看表结构的方法【我】

Oracle查看表结构的方法 方法一: 在命令窗口下输入 DESC table_name; 回车 方法二: 在sql窗口下 SELECT DBMS_METADATA.GET_ ...

- Zabbix4.x 历史数据存储到Elasticsearch7.x

一.简介 Zabbix 3.4.6 版本开始支持历史数据存储到 Elasticsearch, 早就想测试这个功能,最近有个需求需保存 zabbix 的历史数据上达十亿条,因此决定测试这功能的实用性,事 ...

- LeetCode_125. Valid Palindrome

125. Valid Palindrome Easy Given a string, determine if it is a palindrome, considering only alphanu ...