hadoop_学习_02_Hadoop环境搭建(单机)

一、环境准备

1.说明

hadoop的下载来源有:

官方版本:http://archive.apache.org/dist/hadoop/

CDH版本:http://archive.cloudera.com/cdh5

企业应用一般选择CDH版本,因为比较稳定。

若决定使用CDH版本,则要保证相关软件的CDH版本相同,如 选择 hadoop-2.6.0-cdh5.9.3 与 hbase-1.2.0-cdh5.9.3

2.环境准备

操作系统 : linux CentOS 6.8

jdk:1.7

cdh版本为: 5.9.3

hadoop-2.6.0-cdh5.9.3

二、服务器基本配置

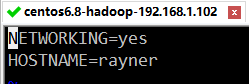

1.配置主机名

(1)修改 hostname

sudo vim /etc/sysconfig/network

将HOSTNAME修改为 rayner (改成你自己的,所有的地方一致即可)

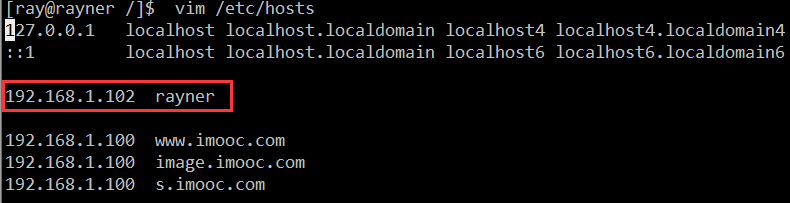

(2)映射主机 ip 与主机名

sudo vim /etc/hosts

加入以下配置:

192.168.1.102 rayner

2.关闭防火墙

关闭防火墙,这样就可以在本机 window 中访问虚拟机的所有端口了

CentOS 7版本以下输入:

service iptables stop

CentOS 7 以上的版本输入:

systemctl stop firewalld.service

3.时间设置

输入:

date

查看服务器时间是否一致,若不一致则更改

更改时间命令

date -s ‘MMDDhhmmYYYY.ss’

三、Hadoop下载

1.hadoop下载地址

http://archive.apache.org/dist/hadoop/common/hadoop-2.6.0/hadoop-2.6.0.tar.gz

2.下载hadoop

wget http://archive.apache.org/dist/hadoop/common/hadoop-2.6.0/hadoop-2.6.0.tar.gz

3.解压hadoop

tar -zxvf hadoop-2.6.0.tar.gz

4.创建文件夹

sudo mkdir /ray/hadoop

sudo mkdir /ray/hadoop/tmp

sudo mkdir /ray/hadoop/var

sudo mkdir /ray/hadoop/dfs

sudo mkdir /ray/hadoop/dfs/name

sudo mkdir /ray/hadoop/dfs/data

四、Hadoop环境配置

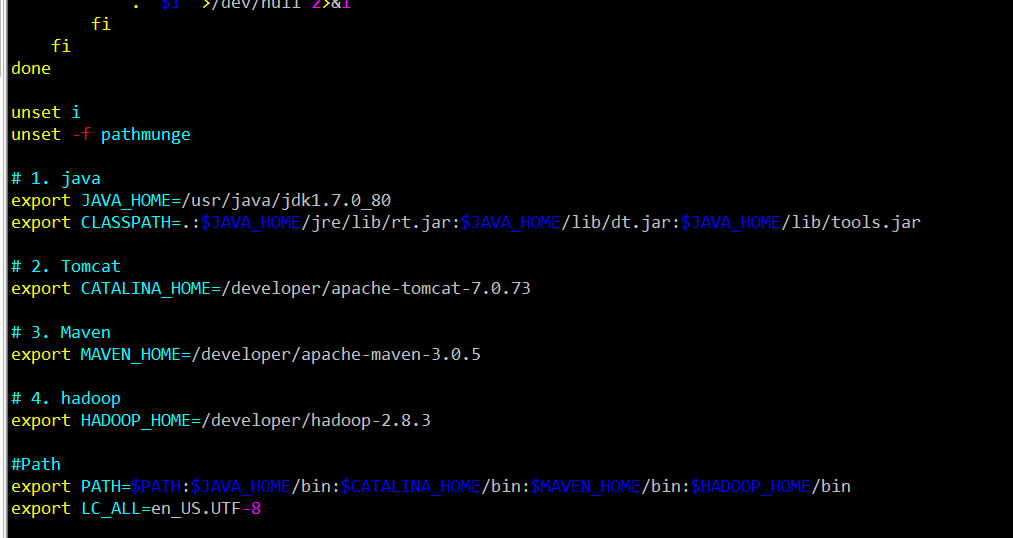

1.配置profile文件-环境变量

(1)编辑 profile 文件

sudo vim /etc/profile

(2)设置 HADOOP_HOME ,并将其添加到path中

# 1. java

export JAVA_HOME=/usr/java/jdk1.7.0_80

export CLASSPATH=.:$JAVA_HOME/jre/lib/rt.jar:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar # 2. Tomcat

export CATALINA_HOME=/developer/apache-tomcat-7.0.73 # 3. Maven

export MAVEN_HOME=/developer/apache-maven-3.0.5 # 4. hadoop

export HADOOP_HOME=/developer/hadoop-2.6.0 #Path

export PATH=$HADOOP_HOME/bin:$MAVEN_HOME/bin:$CATALINA_HOME/bin:$JAVA_HOME/bin:$PATH

export LC_ALL=en_US.UTF-8

(3)使配置生效

source /etc/profile

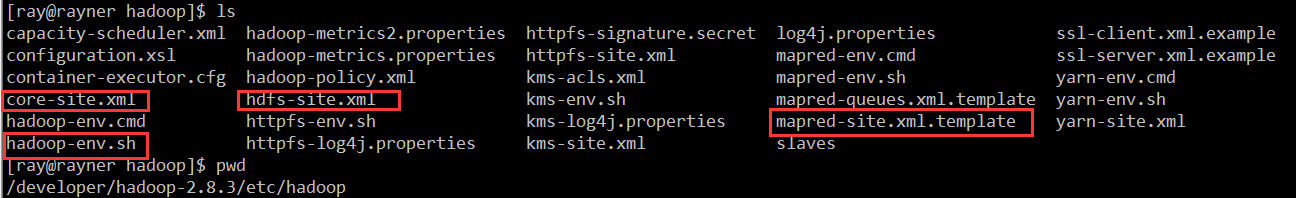

2.配置 hadoop-env.sh

(1) 进入路径:

cd /developer/hadoop-2.6.0/etc/hadoop

(2) 编辑 hadoop-env.sh

sudo vim hadoop-env.sh

(3) 配置JAVA_HOME

将${JAVA_HOME} 修改为自己的JDK路径 ,即

将

export JAVA_HOME=${JAVA_HOME}

修改为:

export JAVA_HOME=/usr/java/jdk1.7.0_80

3.配置 core-site.xml

(1)编辑 core-site.xml

sudo vim core-site.xml

(2)在 configuration 节点中 加入以下配置

注意要将value替换成自己的

<!--1. tmp -->

<property>

<name>hadoop.tmp.dir</name>

<value>/ray/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property> <!--2. default.name -->

<property>

<name>fs.default.name</name>

<value>hdfs://rayner:9000</value>

</property>

4.配置 hdfs-site.xml

(1)编辑 hdfs-site.xml

sudo vim hdfs-site.xml

(2)在 configuration 节点中 加入以下配置

<!--1. name -->

<property>

<name>dfs.name.dir</name>

<value>/ray/hadoop/dfs/name</value>

<description>Path on the local filesystem where theNameNode stores the namespace and transactions logs persistently.</description>

</property> <!--2. data -->

<property>

<name>dfs.data.dir</name>

<value>/ray/hadoop/dfs/data</value>

<description>Comma separated list of paths on the localfilesystem of a DataNode where it should store its blocks.</description>

</property> <!--3. replication -->

<property>

<name>dfs.replication</name>

<value>2</value>

</property> <!--4. permissions -->

<property>

<name>dfs.permissions</name>

<value>false</value>

<description>need not permissions</description>

</property>

说明:dfs.permissions配置为false后,可以允许不要检查权限就生成dfs上的文件,

方便倒是方便了,但是你需要防止误删除,请将它设置为true,或者直接将该property节点删除,因为默认就是true。

5.配置 mapred-site.xml

如果没有 mapred-site.xml 该文件,就复制mapred-site.xml.template文件并重命名为 mapred-site.xml。

(1) 编辑 mapred-site.xml

sudo vim mapred-site.xml

(2) 在 configuration 节点中 加入以下配置

<!--1. job -->

<property>

<name>mapred.job.tracker</name>

<value>rayner:9001</value>

</property> <!--2. local -->

<property>

<name>mapred.local.dir</name>

<value>/ray/hadoop/var</value>

</property> <!--3. framework -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

五、hadoop 常用命令

1.格式化namenode

第一次启动Hadoop需要初始化

切换到 /home/hadoop/hadoop2.8/bin目录下输入

hadoop namenode -format

这一步可能会出现异常:

Unable to determine local hostname -falling back to "localhost"

java.net.UnknownHostException: rayner: rayner

2、启动hadoop

启 /developer/hadoop-2.6.0/sbin/start-all.sh

停 /developer/hadoop-2.6.0/sbin/stop-all.sh

(1)进入sbin目录,执行以下命令

/developer/hadoop-2.6.0/sbin/start-all.sh

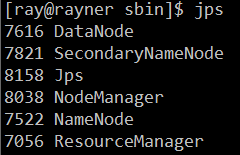

(2)使用jps命令查看启动成功效果

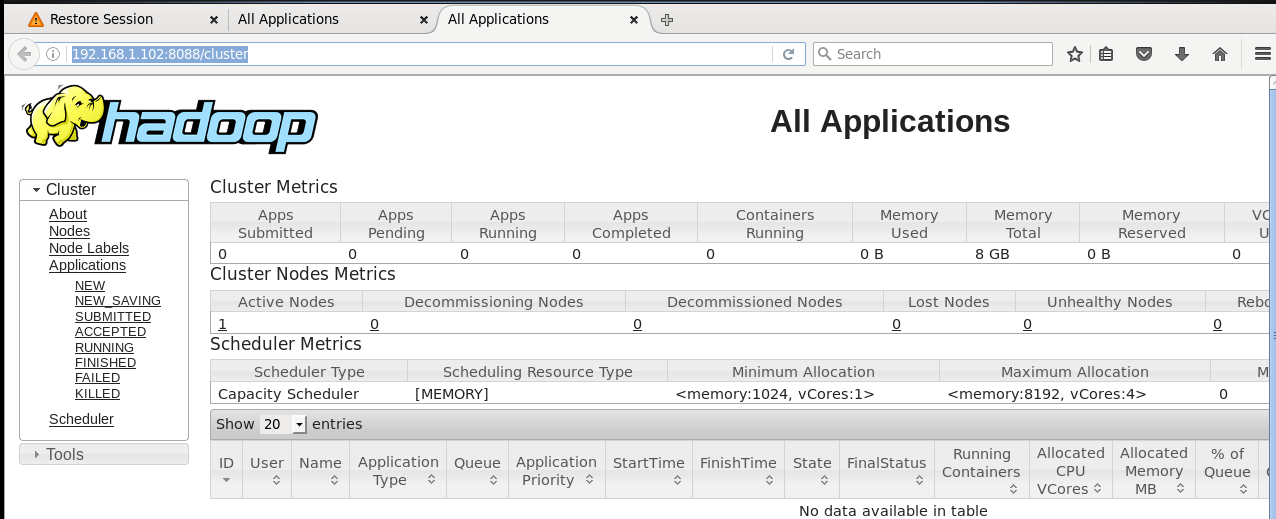

(2)浏览器输入: 127.0.0.1:8088/cluster 或者 192.168.1.102:8088/cluster ,会出现下图

(3)浏览器输入:127.0.0.1:50070 或者 192.168.1.102:50070

2.查看hadoop下有哪些文件

hadoop fs -ls /

六、参考资料

1.大数据学习系列之一 ----- Hadoop环境搭建(单机)

hadoop_学习_02_Hadoop环境搭建(单机)的更多相关文章

- hive_学习_01_hive环境搭建(单机)

一.前言 本文承接上一篇:hbase_学习_01_HBase环境搭建(单机),主要是搭建 hive 的单机环境 二.环境准备 1.说明 hive 的下载来源有: 官方版本:http://archive ...

- hbase_学习_01_HBase环境搭建(单机)

一.前言 本文承接上一篇:hadoop_学习_02_Hadoop环境搭建(单机) ,主要是搭建HBase的单机环境 二.环境准备 1.说明 hbase 的下载来源有: 官方版本:http://arc ...

- 从0开始学爬虫9之requests库的学习之环境搭建

从0开始学爬虫9之requests库的学习之环境搭建 Requests库的环境搭建 环境:python2.7.9版本 参考文档:http://2.python-requests.org/zh_CN/l ...

- Ubuntu16.04深度学习基本环境搭建,tensorflow , keras , pytorch , cuda

Ubuntu16.04深度学习基本环境搭建,tensorflow , keras , pytorch , cuda Ubuntu16.04安装 参考https://blog.csdn.net/flyy ...

- ubuntu 深度学习cuda环境搭建,docker-nvidia 2019-02

ubuntu 深度学习cuda环境搭建 ubuntu系统版本 18.04 查看GPU型号(NVS 315 性能很差,比没有强) 首先最好有ssh服务,以下操作都是远程ssh执行 lspci | gre ...

- Python基础学习之环境搭建

Python如今成为零基础编程爱好者的首选学习语言,这和Python语言自身的强大功能和简单易学是分不开的.今天我们将带领Python零基础的初学者完成入门的第一步——环境搭建.本文会先来区分几个在P ...

- 001-深度学习Pytorch环境搭建(Anaconda , PyCharm导入)

001-深度学习Pytorch环境搭建(Anaconda , PyCharm导入) 在开始搭建之前我们先说一下本次主要安装的东西有哪些. anaconda 3:第三方包管理软件. 这个玩意可以看作是一 ...

- 人工智能之深度学习-初始环境搭建(安装Anaconda3和TensorFlow2步骤详解)

前言: 本篇文章主要讲解的是在学习人工智能之深度学习时所学到的知识和需要的环境配置(安装Anaconda3和TensorFlow2步骤详解),以及个人的心得体会,汇集成本篇文章,作为自己深度学习的总结 ...

- 深度学习开发环境搭建教程(Mac篇)

本文将指导你如何在自己的Mac上部署Theano + Keras的深度学习开发环境. 如果你的Mac不自带NVIDIA的独立显卡(例如15寸以下或者17年新款的Macbook.具体可以在"关 ...

随机推荐

- MySql 数据库系列问题

0. 我的MYSQL学习心得(四) 数据类型(系列文章) 1.MySql数据库学习--存储过程(1) 0.[转]MySQL存储过程调试工具-dbForge Studio for MySQL ①.存储过 ...

- flex hack 记录

IE从IE10开始. //共通 display: flex; flex-direction: column; align-items: flex-start;justify-content: cent ...

- Linux64位程序移植

1 概述 Linux下的程序大多充当服务器的角色,在这种情况下,随着负载量和功能的增加,服务器所使用内存必然也随之增加,然而32位系统固有的4GB虚拟地址空间限制,在如今已是非常突出的问题了:另一个需 ...

- linux系统之间基于密钥对免输入密码登陆

通常,我们登陆到一台linux主机是需要输入密码,这样可以验证登陆者的身份. 这篇随笔里面我打算记录一下配置基于ssh密钥对登陆系统.在配置之前先和大家说明一下我遇到过的问题:刚接触到linux时候首 ...

- 【CodeM初赛B轮】F 期望DP

[CodeM初赛B轮]F 题目大意:有n个景点,m条无向边,经过每条边的时间需要的时间是li,在第i个景点游览花费的时间是ti,游览完第i个景点可以获得的满意度是hi.你的总时间为k,起初你等概率的选 ...

- SSAS(SQL Server 分析服务)、***S(SQL Server报表服务)、SSIS(SQL Server集成服务)

一.数据仓库入门 实验手册 1. 创建数据源 http://jimshu.blog.51cto.com/3171847/13366622. 创建数据源视图 http://jimshu.blog.51 ...

- react create app ,nginx服务器配置

server{ listen 80; server_name www.domain.com domain.com; location ~* \.js$ { root /home/hard/Projec ...

- java使用poi读写Excel

package com.demo.excel; import com.demo.pojo.Student; import org.apache.poi.hssf.usermodel.HSSFCell; ...

- python3 str和bytes转换

bytes object b = b"example" str object s = "example" #str to bytes bytes(s, enco ...

- C#练习DataReader

SQL代码: create database ThreeDb go USE ThreeDb; GO CREATE TABLE classify --分类表 ( id ,), name ) not nu ...