[Python]jieba切词 添加字典 去除停用词、单字 python 2020.2.10

源码如下:

import jieba

import io

import re #jieba.load_userdict("E:/xinxi2.txt")

patton=re.compile(r'..') #添加字典

def add_dict():

f=open("E:/xinxi2.txt","r+",encoding="utf-8") #百度爬取的字典

for line in f:

jieba.suggest_freq(line.rstrip("\n"), True)

f.close() #对句子进行分词

def cut():

number=0

f=open("E:/luntan.txt","r+",encoding="utf-8") #要处理的内容,所爬信息,CSDN论坛标题

for line in f:

line=seg_sentence(line.rstrip("\n"))

seg_list=jieba.cut(line)

for i in seg_list:

print(i) #打印词汇内容

m=patton.findall(i)

#print(len(m)) #打印字符长度

if len(m)!=0:

write(i.strip()+" ")

line=line.rstrip().lstrip()

print(len(line))#打印句子长度

if len(line)>1:

write("\n")

number+=1

print("已处理",number,"行") #分词后写入

def write(contents):

f=open("E://luntan_cut2.txt","a+",encoding="utf-8") #要写入的文件

f.write(contents)

#print("写入成功!")

f.close() #创建停用词

def stopwordslist(filepath):

stopwords = [line.strip() for line in open(filepath, 'r', encoding='utf-8').readlines()]

return stopwords # 对句子进行去除停用词

def seg_sentence(sentence):

sentence_seged = jieba.cut(sentence.strip())

stopwords = stopwordslist('E://stop.txt') # 这里加载停用词的路径

outstr = ''

for word in sentence_seged:

if word not in stopwords:

if word != '\t':

outstr += word

#outstr += " "

return outstr #循环去除、无用函数

def cut_all():

inputs = open('E://luntan_cut.txt', 'r', encoding='utf-8')

outputs = open('E//luntan_stop.txt', 'a')

for line in inputs:

line_seg = seg_sentence(line) # 这里的返回值是字符串

outputs.write(line_seg + '\n')

outputs.close()

inputs.close() if __name__=="__main__":

add_dict()

cut()

luntan.txt的来源,地址:https://www.cnblogs.com/zlc364624/p/12285055.html

其中停用词可自行百度下载,或者自己创建一个txt文件夹,自行添加词汇用换行符隔开。

百度爬取的字典在前几期博客中可以找到,地址:https://www.cnblogs.com/zlc364624/p/12289008.html

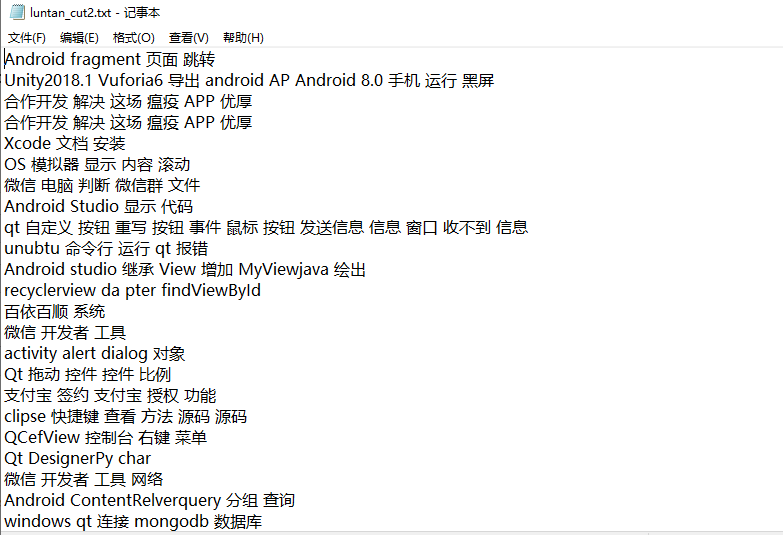

效果如下:

import jieba

import io

import re #jieba.load_userdict("E:/xinxi2.txt")

patton=re.compile(r'..') #添加字典

def add_dict():

f=open("E:/xinxi2.txt","r+",encoding="utf-8") #百度爬取的字典

for line in f:

jieba.suggest_freq(line.rstrip("\n"), True)

f.close() #对句子进行分词

def cut():

number=0

f=open("E:/luntan.txt","r+",encoding="utf-8") #要处理的内容,所爬信息,CSDN论坛标题

for line in f:

line=seg_sentence(line.rstrip("\n"))

seg_list=jieba.cut(line)

for i in seg_list:

print(i) #打印词汇内容

m=patton.findall(i)

#print(len(m)) #打印字符长度

if len(m)!=:

write(i.strip()+" ")

line=line.rstrip().lstrip()

print(len(line))#打印句子长度

if len(line)>:

write("\n")

number+=1

print("已处理",number,"行") #分词后写入

def write(contents):

f=open("E://luntan_cut2.txt","a+",encoding="utf-8") #要写入的文件

f.write(contents)

#print("写入成功!")

f.close() #创建停用词

def stopwordslist(filepath):

stopwords = [line.strip() for line in open(filepath, 'r', encoding='utf-8').readlines()]

return stopwords # 对句子进行去除停用词

def seg_sentence(sentence):

sentence_seged = jieba.cut(sentence.strip())

stopwords = stopwordslist('E://stop.txt') # 这里加载停用词的路径

outstr = ''

for word in sentence_seged:

if word not in stopwords:

if word != '\t':

outstr += word

#outstr += " "

return outstr #循环去除、无用函数

def cut_all():

inputs = open('E://luntan_cut.txt', 'r', encoding='utf-8')

outputs = open('E//luntan_stop.txt', 'a')

for line in inputs:

line_seg = seg_sentence(line) # 这里的返回值是字符串

outputs.write(line_seg + '\n')

outputs.close()

inputs.close() if __name__=="__main__":

add_dict()

cut()

[Python]jieba切词 添加字典 去除停用词、单字 python 2020.2.10的更多相关文章

- jieba文本分词,去除停用词,添加用户词

import jieba from collections import Counter from wordcloud import WordCloud import matplotlib.pyplo ...

- python去除停用词(结巴分词下)

python 去除停用词 结巴分词 import jieba #stopwords = {}.fromkeys([ line.rstrip() for line in open('stopword. ...

- (3.1)用ictclas4j进行中文分词,并去除停用词

酒店评论情感分析系统——用ictclas4j进行中文分词,并去除停用词 ictclas4j是中科院计算所开发的中文分词工具ICTCLAS的Java版本,因其分词准确率较高,而备受青睐. 注:ictcl ...

- python利用jieba进行中文分词去停用词

中文分词(Chinese Word Segmentation) 指的是将一个汉字序列切分成一个一个单独的词. 分词模块jieba,它是python比较好用的分词模块.待分词的字符串可以是 unicod ...

- 使用Python中的NLTK和spaCy删除停用词与文本标准化

概述 了解如何在Python中删除停用词与文本标准化,这些是自然语言处理的基本技术 探索不同的方法来删除停用词,以及讨论文本标准化技术,如词干化(stemming)和词形还原(lemmatizatio ...

- python编程基础知识—字典

字典 在python中,字典是一系列键-值对,每个键都与一个值相关联,可使用键来访问相关联的值.与键相关联的值可以是数字.字符串.列表乃至字典,即可将任何python对象用在字典中的值. 在pytho ...

- 如何在java中去除中文文本的停用词

1. 整体思路 第一步:先将中文文本进行分词,这里使用的HanLP-汉语言处理包进行中文文本分词. 第二步:使用停用词表,去除分好的词中的停用词. 2. 中文文本分词环境配置 使用的HanLP-汉 ...

- 词项邻近 & 停用词 & 词干还原

[词项邻近] 邻近操作符(proximity)用于指定查询中的两个词项应该在文档中互相靠近,靠近程度通常采用两者之间的词的个数或者是否同在某个结构单元(如句 子或段落)中出现来衡量. [停用词] 一些 ...

- python jieba分词(添加停用词,用户字典 取词频

中文分词一般使用jieba分词 1.安装 pip install jieba 2.大致了解jieba分词 包括jieba分词的3种模式 全模式 import jieba seg_list = jieb ...

随机推荐

- 谈下slot-scope

Vue里有个slot插槽的概念,常用的一般是命名的slot和默认的slot, 这里谈下slot-scope,Vue2.6后改成v-slot slot-scope场景是父组件用子组件的数据,但是样式自己 ...

- (数据科学学习手札78)基于geopandas的空间数据分析——基础可视化

本文对应代码和数据已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 通过前面的文章,我们已经对geopanda ...

- Http API触发小程序云函数案例

1.创建云函数 在云开发中创建云函数(sum,调用需要两个参数:a.b): 2.invokeCloudFunction触发云函数 const request = require('request'); ...

- 【Android开发艺术探索】理解Window和WindowManager

个人博客: http://www.milovetingting.cn 理解Window和WindowManager Window表示一个窗口的概念,是一个抽象类,具体实现是PhoneWindow,可以 ...

- linux中shell内置命令和外置命令

shell内置命令 无法通过which或者whereis去查找命令的位置 例如cd,cp这些命令是shell解释器内置的命令 当shell内置命令传入shell解释器,shell解释器通过内核获取相关 ...

- mutations.js文件书写规范及模板调用此文件书写方法

1)mutations.js代码如下 const mutations={ add(state){ state.count++ }, reduce(state){ state.count-- } } 2 ...

- Node.js文档-模块

核心模块 Node为Javascript提供了很多服务器级别的API,绝大多数都被包装到了一个具名的核心模块中,例如文件操作的fs核心模块,http服务构建的http模块等,核心模块的使用必须通过re ...

- 堆优化 dijkstra 简介

dijkstra 前言 原本我真的不会什么 dijkstra 只用那已死的 spfa ,还有各种玄学优化,可是,我不能相信一个已死的算法,就像我不能相信自己. ps : 虽然他已经活了 序 我站在镜子 ...

- idea git pull fatal: bad config line 1 in file /.gitconfig 问题处理

在网上搜好多都是直接改username和useremail的,但是没有说明原理. 因为我的电脑是新入职接手上一家的电脑 后来在git bash 里面用$ git config user.name 原来 ...

- Enityt模型特性

数据验证相关的数据注解: 特性 解释 Remote 使用 jQuery 验证插件远程验证程序的特性 FileExtension 验证文件扩展名 Compare 比较两个属性的值 RegularExpr ...