吴裕雄 PYTHON 神经网络——TENSORFLOW 双隐藏层自编码器设计处理MNIST手写数字数据集并使用TENSORBORD描绘神经网络数据2

import os

import tensorflow as tf from tensorflow.examples.tutorials.mnist import input_data os.environ['TF_CPP_MIN_LOG_LEVEL'] = '' batch_size = 128 # batch容量

display_step = 1 # 展示间隔

learning_rate = 0.01 # 学习率

training_epochs = 20 # 训练轮数,1轮等于n_samples/batch_size

example_to_show = 10 # 展示图像数目 n_hidden1_units = 256 # 第一隐藏层

n_hidden2_units = 128 # 第二隐藏层

n_input_units = 784

n_output_units = n_input_units def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.histogram('mean', mean)

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var - mean)))

tf.summary.scalar('stddev', stddev) # 注意,这是标量

tf.summary.scalar('max', tf.reduce_max(var))

tf.summary.scalar('min', tf.reduce_min(var))

tf.summary.histogram('histogram', var)

def WeightsVariable(n_in,n_out,name_str):

return tf.Variable(tf.random_normal([n_in,n_out]),dtype=tf.float32,name=name_str) def biasesVariable(n_out,name_str):

return tf.Variable(tf.random_normal([n_out]),dtype=tf.float32,name=name_str) def encoder(x_origin,activate_func=tf.nn.sigmoid):

with tf.name_scope('Layer1'):

Weights = WeightsVariable(n_input_units,n_hidden1_units,'Weights')

biases = biasesVariable(n_hidden1_units,'biases')

x_code1 = activate_func(tf.add(tf.matmul(x_origin,Weights),biases))

variable_summaries(Weights)

variable_summaries(biases)

with tf.name_scope('Layer2'):

Weights = WeightsVariable(n_hidden1_units,n_hidden2_units,'Weights')

biases = biasesVariable(n_hidden2_units,'biases')

x_code2 = activate_func(tf.add(tf.matmul(x_code1,Weights),biases))

variable_summaries(Weights)

variable_summaries(biases)

return x_code2 def decode(x_code,activate_func=tf.nn.sigmoid):

with tf.name_scope('Layer1'):

Weights = WeightsVariable(n_hidden2_units,n_hidden1_units,'Weights')

biases = biasesVariable(n_hidden1_units,'biases')

x_decode1 = activate_func(tf.add(tf.matmul(x_code,Weights),biases))

variable_summaries(Weights)

variable_summaries(biases)

with tf.name_scope('Layer2'):

Weights = WeightsVariable(n_hidden1_units,n_output_units,'Weights')

biases = biasesVariable(n_output_units,'biases')

x_decode2 = activate_func(tf.add(tf.matmul(x_decode1,Weights),biases))

variable_summaries(Weights)

variable_summaries(biases)

return x_decode2 with tf.Graph().as_default():

with tf.name_scope('Input'):

X_input = tf.placeholder(tf.float32,[None,n_input_units])

with tf.name_scope('Encode'):

X_code = encoder(X_input)

with tf.name_scope('decode'):

X_decode = decode(X_code)

with tf.name_scope('loss'):

loss = tf.reduce_mean(tf.pow(X_input - X_decode,2))

with tf.name_scope('train'):

Optimizer = tf.train.RMSPropOptimizer(learning_rate)

train = Optimizer.minimize(loss)

# 标量汇总

with tf.name_scope('LossSummary'):

tf.summary.scalar('loss',loss)

tf.summary.scalar('learning_rate',learning_rate)

# 图像展示

with tf.name_scope('ImageSummary'):

image_original = tf.reshape(X_input,[-1, 28, 28, 1])

image_reconstruction = tf.reshape(X_decode, [-1, 28, 28, 1])

tf.summary.image('image_original', image_original, 9)

tf.summary.image('image_recinstruction', image_reconstruction, 9)

# 汇总

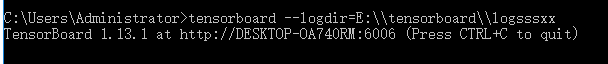

merged_summary = tf.summary.merge_all() init = tf.global_variables_initializer() writer = tf.summary.FileWriter(logdir='E:\\tensorboard\\logsssxx', graph=tf.get_default_graph())

writer.flush() mnist = input_data.read_data_sets('E:\\MNIST_data\\', one_hot=True) with tf.Session() as sess:

sess.run(init)

total_batch = int(mnist.train.num_examples / batch_size)

for epoch in range(training_epochs):

for i in range(total_batch):

batch_xs,batch_ys = mnist.train.next_batch(batch_size)

_,Loss = sess.run([train,loss],feed_dict={X_input: batch_xs})

Loss = sess.run(loss,feed_dict={X_input: batch_xs})

if epoch % display_step == 0:

print('Epoch: %04d' % (epoch + 1),'loss= ','{:.9f}'.format(Loss))

summary_str = sess.run(merged_summary,feed_dict={X_input: batch_xs})

writer.add_summary(summary_str,epoch)

writer.flush()

writer.close()

print('训练完毕!')

吴裕雄 PYTHON 神经网络——TENSORFLOW 双隐藏层自编码器设计处理MNIST手写数字数据集并使用TENSORBORD描绘神经网络数据2的更多相关文章

- 吴裕雄 PYTHON 神经网络——TENSORFLOW 单隐藏层自编码器设计处理MNIST手写数字数据集并使用TensorBord描绘神经网络数据

import os import numpy as np import tensorflow as tf import matplotlib.pyplot as plt from tensorflow ...

- 『TensorFlow』单&双隐藏层自编码器设计

计算图设计 很简单的实践, 多了个隐藏层 没有上节的高斯噪声 网络写法由上节的面向对象改为了函数式编程, 其他没有特别需要注意的,实现如下: import numpy as np import mat ...

- Android+TensorFlow+CNN+MNIST 手写数字识别实现

Android+TensorFlow+CNN+MNIST 手写数字识别实现 SkySeraph 2018 Email:skyseraph00#163.com 更多精彩请直接访问SkySeraph个人站 ...

- TensorFlow——MNIST手写数字识别

MNIST手写数字识别 MNIST数据集介绍和下载:http://yann.lecun.com/exdb/mnist/ 一.数据集介绍: MNIST是一个入门级的计算机视觉数据集 下载下来的数据集 ...

- Tensorflow实现MNIST手写数字识别

之前我们讲了神经网络的起源.单层神经网络.多层神经网络的搭建过程.搭建时要注意到的具体问题.以及解决这些问题的具体方法.本文将通过一个经典的案例:MNIST手写数字识别,以代码的形式来为大家梳理一遍神 ...

- mnist手写数字识别——深度学习入门项目(tensorflow+keras+Sequential模型)

前言 今天记录一下深度学习的另外一个入门项目——<mnist数据集手写数字识别>,这是一个入门必备的学习案例,主要使用了tensorflow下的keras网络结构的Sequential模型 ...

- 基于tensorflow的MNIST手写数字识别(二)--入门篇

http://www.jianshu.com/p/4195577585e6 基于tensorflow的MNIST手写字识别(一)--白话卷积神经网络模型 基于tensorflow的MNIST手写数字识 ...

- 用tensorflow搭建RNN(LSTM)进行MNIST 手写数字辨识

用tensorflow搭建RNN(LSTM)进行MNIST 手写数字辨识 循环神经网络RNN相比传统的神经网络在处理序列化数据时更有优势,因为RNN能够将加入上(下)文信息进行考虑.一个简单的RNN如 ...

- Tensorflow可视化MNIST手写数字训练

简述] 我们在学习编程语言时,往往第一个程序就是打印“Hello World”,那么对于人工智能学习系统平台来说,他的“Hello World”小程序就是MNIST手写数字训练了.MNIST是一个手写 ...

随机推荐

- mysql中循环插入数据

循环插入1w条数据 表结构: mysql> desc time_table; +-------+-----------+------+-----+-------------------+---- ...

- K3/Cloud点击按钮打开第三方URL

public override void AfterBarItemClick(BOS.Core.DynamicForm.PlugIn.Args.AfterBarItemClickEventArgs e ...

- 一键安装各个版本boost库(无需编译)

1.NuGet 最简单的,用VS自带的NuGet包管理器安装,一般比较常用的上面都有 2.下载exe安装包 在这里https://sourceforge.net/projects/boost/file ...

- C++分割string字符串(转)

原文链接:https://blog.csdn.net/jirryzhang/article/details/80473032 或:https://www.cnblogs.com/dingxiaoqia ...

- 如何在Word中批量选中特定文本

如何在Word中批量选中特定文本 举个例子,我们对如下文本进行操作,将文本中所有的“1111111”标红,所有的“2222222”标绿,所有的“3333333”标蓝 在Word中找到“查找”下的“高级 ...

- 2-第一个Django程序

第一个Django程序 从本章节开始将通过实现一个投票应用程序,来让用户逐步的了解Django.这个程序由两步分组成: 公共站点,允许用户访问进行投票,和查看投票. 站点管理,允许添加,删除,修改投票 ...

- Mysql5.6基础命令

Centos7下mysql5.6数据库的操作 Mysql如何修改密码? 1.使用mysqladmin修改,这种修改方式需要知道mysql的原始密码 修改密码后我们测试下看看能不能登录成功 怎么才能不需 ...

- DataFrames,Datasets,与 SparkSQL

v\:* {behavior:url(#default#VML);} o\:* {behavior:url(#default#VML);} w\:* {behavior:url(#default#VM ...

- 转载:Bass management

https://kenrockwell.com/audio/bass-management.htm https://www.axiomaudio.com/blog/bassmanagement htt ...

- command failed: npm install --loglevel error --registry=https://registry.npm 用vue-cli 4.0 新建项目总是报错

昨天新买的本本,今天布环境,一安装vue-cli发现都4.0+的版本了,没管太多,就开始新建个项目感受哈,一切运行顺利,输入 "vue create app" 的时候,一切貌似进展 ...