BeautifulSoup图片爬取

------------恢复内容开始------------

BeautifulSoup介绍:

简单来说,Beautiful Soup 是 python 的一个库,最主要的功能是从网页抓取数据。官方解释如下:

Beautiful Soup 提供一些简单的、python 式的函数用来处理导航、搜索、修改分析树等功能。它是一个工具箱,通过解析文档为用户提供需要抓取的数据,因为简单,所以不需要多少代码就可以写出一个完整的应用程序。 Beautiful Soup 自动将输入文档转换为 Unicode 编码,输出文档转换为 utf-8 编码。你不需要考虑编码方式,除非文档没有指定一个编码方式,这时,Beautiful Soup 就不能自动识别编码方式了。然后,你仅仅需要说明一下原始编码方式就可以了。 Beautiful Soup 已成为和 lxml、html6lib 一样出色的 python 解释器,为用户灵活地提供不同的解析策略或强劲的速度。

以下为爬取网页图片的例子:

爬取图片的网页地址:https://pic.netbian.com/4kdongman/

先创建一个requests的请求,然后使用BeautifulSoup的lxml HTML解析器去解析网页

url = 'https://pic.netbian.com/4kdongman/'

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/97.0.4692.71 Safari/537.36'

}

r = requests.get(url,headers=headers)

#设置编码为gbk,要不然会乱码

r.encoding='gbk'

#使用lxml解析器解析

soup = BeautifulSoup(r.text,'lxml')

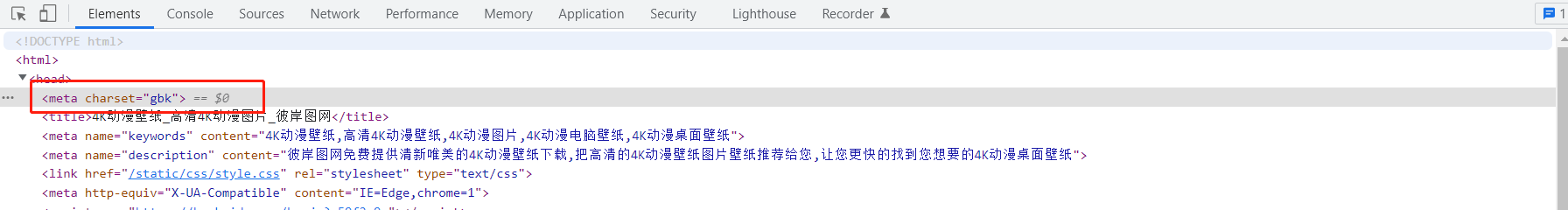

编码格式可以从网页html中看到

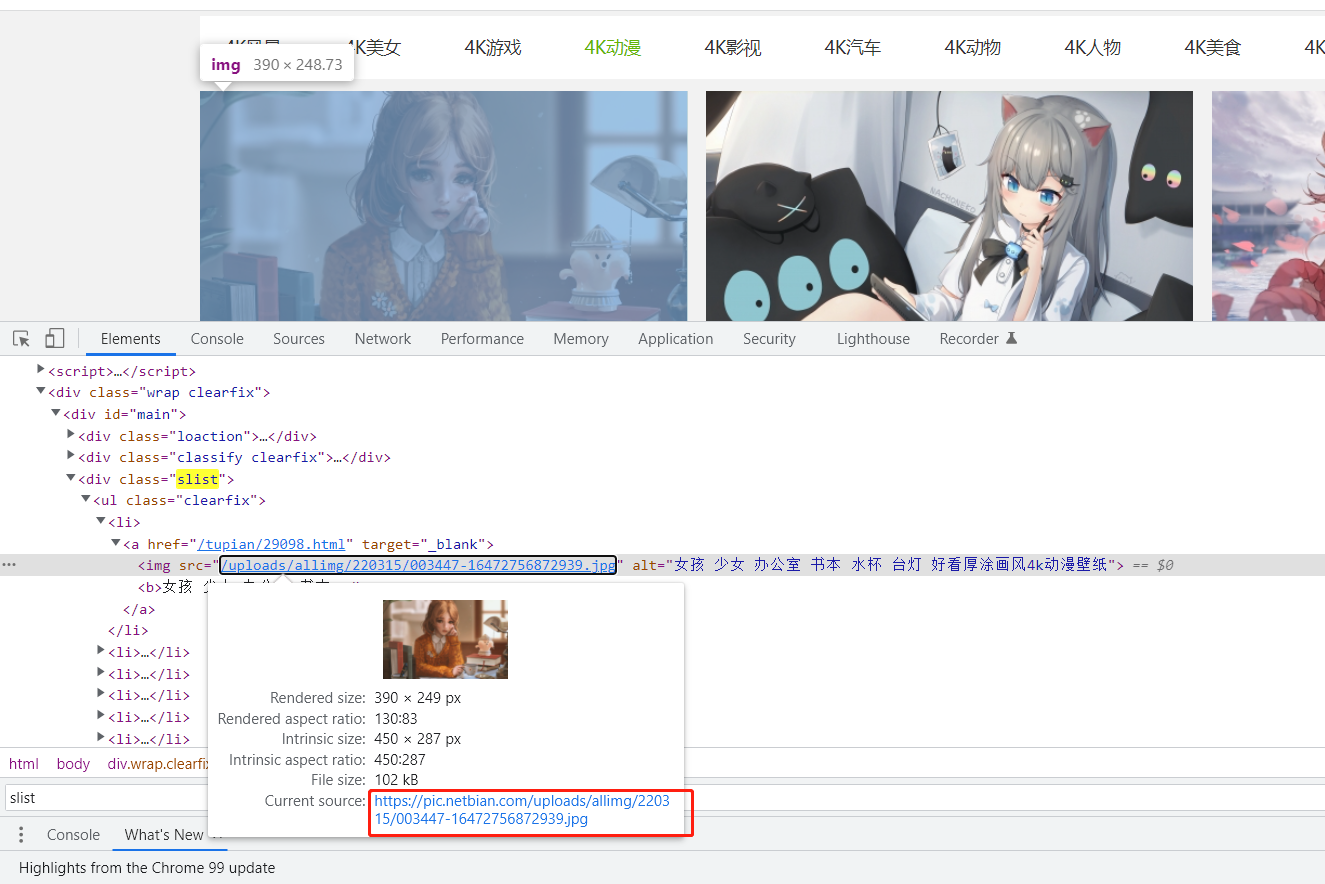

接下来可以先定位到所有图片的整体div,例如class=’slist‘这个div,然后再定位每张图片的img标签,提取相关数据,得到每张图片的url地址

#定位所有图片的整体div

all_list = soup.find_all(attrs={'class': 'slist'})

#定位所有的img标签

img_list = all_list[0].find_all('img')

#遍历每个img标签

for img in img_list:

img_url = img['src']

name = img['alt']

#拼接图片url地址

img_url = 'https://pic.netbian.com' + img_url

#图片名称

print(name)

#图片url

print(img_url)

获取到每张图片的url地址后,就可以直接将其下载下来

方法一:with open直接将图片用字节流写入保存

r_img = requests.get(img_url)

with open('./img/'+name+'.jpg','wb+') as f:

#content返回的是二进制数据,如果你是取文本,你可以使用r.txt,如果取图片和文件,则是r.content

f.write(r_img.content)

方法二:直接使用urllib.request.urlretrieve下载

#第一个参数为要下载文件的url,第二个参数为本地保存路径以及文件名的路径

urllib.request.urlretrieve(img_url,'./img/'+name+'.jpg')

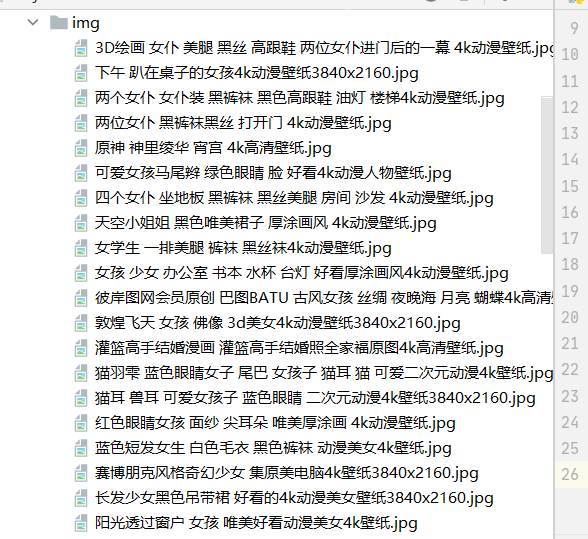

两种都可以实现,图片的下载,我保存的图片的地址为当前目录的img,从下面图片可以看到已经全部下载了

完整代码如下:

import urllib.request import requests

from bs4 import BeautifulSoup url = 'https://pic.netbian.com/4kdongman/'

headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/97.0.4692.71 Safari/537.36'

}

r = requests.get(url,headers=headers)

#设置编码为gbk,要不然会乱码

r.encoding='gbk'

#使用lxml解析器解析

soup = BeautifulSoup(r.text,'lxml')

all_list = soup.find_all(attrs={'class': 'slist'})

img_list = all_list[0].find_all('img')

for img in img_list:

img_url = img['src']

name = img['alt']

img_url = 'https://pic.netbian.com' + img_url

print(name)

# r_img = requests.get(img_url)

# with open('./img/'+name+'.jpg','wb+') as f:

# f.write(r_img.content)

urllib.request.urlretrieve(img_url,'./img/'+name+'.jpg')

print('已经保存完成:'+img_url)

------------恢复内容结束------------

BeautifulSoup图片爬取的更多相关文章

- Python爬虫入门教程 26-100 知乎文章图片爬取器之二

1. 知乎文章图片爬取器之二博客背景 昨天写了知乎文章图片爬取器的一部分代码,针对知乎问题的答案json进行了数据抓取,博客中出现了部分写死的内容,今天把那部分信息调整完毕,并且将图片下载完善到代码中 ...

- 用BeautifulSoup简单爬取BOSS直聘网岗位

用BeautifulSoup简单爬取BOSS直聘网岗位 爬取python招聘 import requests from bs4 import BeautifulSoup def fun(path): ...

- 4k图片爬取+中文乱码

4k图片爬取+中文乱码 此案例有三种乱码解决方法,推荐第一种 4k图片爬取其实和普通图片爬取的过程是没有本质区别的 import requests import os from lxml import ...

- scrapy之360图片爬取

#今日目标 **scrapy之360图片爬取** 今天要爬取的是360美女图片,首先分析页面得知网页是动态加载,故需要先找到网页链接规律, 然后调用ImagesPipeline类实现图片爬取 *代码实 ...

- [Python_scrapy图片爬取下载]

welcome to myblog Dome地址 爬取某个车站的图片 item.py 中 1.申明item 的fields class PhotoItem(scrapy.Item): # define ...

- 爬虫07 /scrapy图片爬取、中间件、selenium在scrapy中的应用、CrawlSpider、分布式、增量式

爬虫07 /scrapy图片爬取.中间件.selenium在scrapy中的应用.CrawlSpider.分布式.增量式 目录 爬虫07 /scrapy图片爬取.中间件.selenium在scrapy ...

- python+BeautifulSoup+多进程爬取糗事百科图片

用到的库: import requests import os from bs4 import BeautifulSoup import time from multiprocessing impor ...

- 使用BeautifulSoup自动爬取微信公众号图片

爬取微信分享的图片,根据不同的页面自行修改,使用BeautifulSoup爬取,自行格局HTML修改要爬取图片的位置 import re import time import requests imp ...

- 网络爬虫之网站图片爬取-python实现

版本1.5 本次简单添加了四路多线程(由于我电脑CPU是四核的),速度飙升.本想试试xPath,但发现反倒是多此一举,故暂不使用 #-*- coding:utf-8 -*- import re,url ...

随机推荐

- SpringBoot + Log4j2使用配置 (转)

前言 后台程序开发及上线时,一般都会用到Log信息打印及Log日志记录,开发时通过Log信息打印可以快速的定位问题所在,帮助我们快捷开发.程序上线后如遇到Bug或错误,此时则需要日志记录来查找发现问题 ...

- js正则表达式 (.+)与(.+?)

(.+)默认是贪婪匹配 (.+?)为惰性匹配 疑问号让.+的搜索模式从贪婪模式变成惰性模式. var str = 'aaa<div style="font-color:red;&quo ...

- having筛选结果集

题目要求:让你输出有两科及其以上挂科(60分及格)的学生的名单? name subject score 错误的做法: mysql> select name, count(scoure<60 ...

- LVS-DR群集

LVS-DR群集 目录 LVS-DR群集 一.LVS-DR的工作原理 1. LVS-DR数据包流向分析 2. IP包头及数据帧头信息的变化 3. DR模式的特点 4.LVS-DR中的ARP问题 (1) ...

- MySQL5.7修改登录密码的几种方式

1.更新mysql.user表 use mysql UPDATE user SET authentication_string = password('新密码') where user = 'root ...

- Java 线程的 5 种状态

线程状态图: 线程共包括以下 5 种状态: 1. 新建状态(New): 线程对象被创建后,就进入了新建状态.例如,Thread thread = new Thread(). 2. 就绪状态(Runna ...

- mysql悬案 之 为什么用docker启动的mysql配置文件不生效

文章目录 故事前景 查看docker启动时挂载了哪些目录 使用相同镜像启动一个mysql 新建一个目录用来存放容器内的mysql配置文件 复制容器内的mysql配置文件到本地 查看mysql配置文件目 ...

- CentOS7防火墙firewall

一.Firewall 1. 从CentOS7开始,默认使用firewall来配置防火墙,没有安装iptables(旧版默认安装). 2. firewall的配置文件是以xml的格式,存储在 /usr/ ...

- IDEA配置scala

IDEA中配置scala 准备:先下好IDEA和scala安装包,配置好jdk环境 scala不想去官网下载的可以直接去百度网盘下载 链接: 链接:https://pan.baidu.com/s/17 ...

- RFC2899广播吞吐量测试——网络测试仪实操

一.简介 RFC 2889为LAN交换设备的基准测试提供了方法学,它将RFC 2544中为网络互联设备基准测试所定义的方法学扩展到了交换设备,提供了交换机转发性能(Forwarding Perform ...