Fluentd直接传输日志给kafka

官方文档地址:https://docs.fluentd.org/output/kafka

td-agent版本自带包含out_kafka2插件,不用再安装了,可以直接使用。

若是使用的是Fluentd,则需要安装这个插件:

$ fluent-gem install fluent-plugin-kafka

配置示例

<match pattern>

@type kafka2

# list of seed brokers

brokers <broker1_host>:<broker1_port>,<broker2_host>:<broker2_port>

use_event_time true

# buffer settings

<buffer topic>

@type file

path /var/log/td-agent/buffer/td

flush_interval 3s

</buffer>

# data type settings

<format>

@type json

</format>

# topic settings

topic_key topic

default_topic messages

# producer settings

required_acks -1

compression_codec gzip

</match>

参数说明

- @type:必填,kafka2

- brokers:kafka连接地址,默认是localhost:9092

- topic_key:目标主题的字段名,默认是topic,必须设置buffer chunk key,示例如下:

topic_key category

<buffer category> # topic_key should be included in buffer chunk key

# ...

</buffer>

- default_topic:要写入目标的topic,默认nil,topic_key未设置的话则使用这个参数

- 指令,可用参数有json, ltsv和其他格式化程序插件,用法如下:

<format>

@type json

</format>

- use_event_time:fluentd事件发送到kafka的时间,默认false,也就是当前时间

- required_acks:每个请求所需的ACK数,默认-1

- compression_codec: 生产者用来压缩消息的编解码器,默认nil,可选参数有gzip, snappy(如果使用snappy,需要使用命令td-agent-gem安装snappy)

- @log_level:可选,日志等级,参数有fatal, error, warn, info, debug, trace

用法示例

kafka安装参考:https://www.cnblogs.com/sanduzxcvbnm/p/13932933.html

<source>

@type tail

@id input_tail

<parse>

@type nginx

</parse>

path /usr/local/openresty/nginx/logs/host.access.log

tag td.nginx.access

</source>

<match td.nginx.access>

@type kafka2

brokers 192.168.0.253:9092

use_event_time true

<buffer app>

@type memory

</buffer>

<format>

@type json

</format>

topic_key app

default_topic messagesb # 注意,kafka中消费使用的是这个topic

required_acks -1

compression_codec gzip

</match>

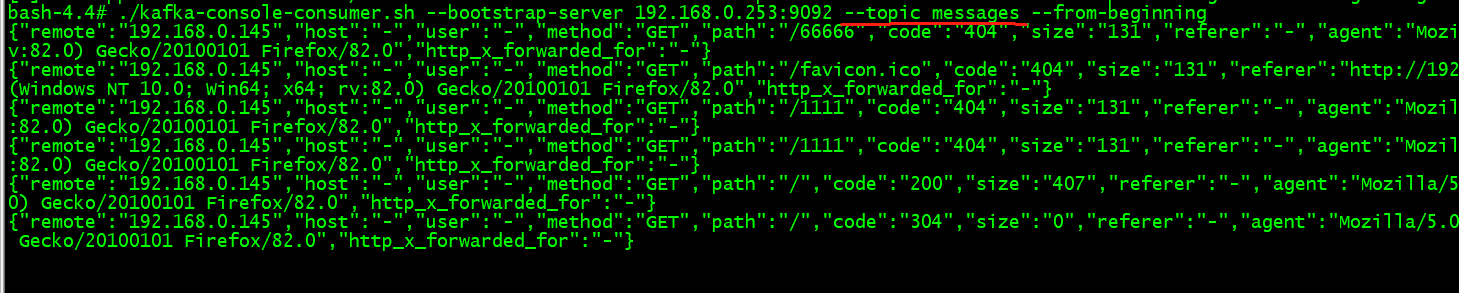

kafka消费的数据显示:

{"remote":"192.168.0.145","host":"-","user":"-","method":"GET","path":"/00000","code":"404","size":"131","referer":"-","agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:82.0) Gecko/20100101 Firefox/82.0","http_x_forwarded_for":"-"}

{"remote":"192.168.0.145","host":"-","user":"-","method":"GET","path":"/99999","code":"404","size":"131","referer":"-","agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:82.0) Gecko/20100101 Firefox/82.0","http_x_forwarded_for":"-"}

Fluentd直接传输日志给kafka的更多相关文章

- Fluentd直接传输日志给Elasticsearch

官方文档地址:https://docs.fluentd.org/output/elasticsearch td-agent的v3.0.1版本以后自带包含out_elasticsearch插件,不用再安 ...

- Fluentd直接传输日志给MongoDB副本集 (replset)

官方文档地址:https://docs.fluentd.org/output/mongo_replset td-agent版本默认没有包含out_mongo插件,需要安装这个插件才能使用 使用的是td ...

- Fluentd直接传输日志给MongoDB (standalone)

官方文档地址:https://docs.fluentd.org/output/mongo td-agent版本默认没有包含out_mongo插件,需要安装这个插件才能使用 使用的是td-agent,安 ...

- 一次flume exec source采集日志到kafka因为单条日志数据非常大同步失败的踩坑带来的思考

本次遇到的问题描述,日志采集同步时,当单条日志(日志文件中一行日志)超过2M大小,数据无法采集同步到kafka,分析后,共踩到如下几个坑.1.flume采集时,通过shell+EXEC(tail -F ...

- 记一次logback传输日志到logstash根据自定义设置动态创建ElasticSearch索引

先说背景,由于本人工作需要创建很多小应用程序,而且在微服务的大环境下,服务越来越多,然后就导致日志四分五裂,到处都有,然后就有的elk,那么问题来了 不能每个小应用都配置一个 logstash 服务来 ...

- 日志打入kafka改造历程-我们到底能走多远系列49

方案 日志收集的方案有很多,包括各种日志过滤清洗,分析,统计,而且看起来都很高大上.本文只描述一个打入kafka的功能. 流程:app->kafka->logstash->es-&g ...

- ELK系列~Fluentd对大日志的处理过程~16K

Fluentd是一个日志收集工具,有输入端和输出端的概念,前者主要是日志的来源,你可以走多种来源方式,http,forward,tcp都可以,后者输出端主要指把日志进行持久化的过程,你可以直接把它持久 ...

- 日志=>flume=>kafka=>spark streaming=>hbase

日志=>flume=>kafka=>spark streaming=>hbase 日志部分 #coding=UTF-8 import random import time ur ...

- 9. Fluentd部署:日志

Fluentd是用来处理其他系统产生的日志的,它本身也会产生一些运行时日志.Fluentd包含两个日志层:全局日志和插件级日志.每个层次的日志都可以进行单独配置. 日志级别 Fluentd的日志包含6 ...

随机推荐

- java线程池开启多线程

// //maximumPoolSize设置为2 ,拒绝策略为AbortPolic策略,直接抛出异常 ThreadPoolExecutor pool = new ThreadPoolExecutor( ...

- day04 缓冲字符流__异常处理

缓冲字符流 缓冲字符输入流:java.io.BufferedReader 是一个高级的字符流,特点是块读文本数据,并且可以按行读取字符串. package io; import java.io.*; ...

- Codeforces Round #801 (Div. 2) and EPIC Institute of Technology Round(C,D题解)

Codeforces Round #801 (Div. 2) and EPIC Institute of Technology Round C - Zero Path 在这道题目中,不可以真正地进行寻 ...

- python zip、*、**理解

zip函数 zip()一般传入可迭代对象(不止一个),将对象中对应的元素打包成一个个元组,然后返回由这些元组组成的zip对象(python2返回元组),需要手动使用tuple.list等序列转换成可使 ...

- 整除分块套杜教筛为什么是 O(n^2/3) 的

假设我们要筛一个东西叫做 \(f\) . 记 \[D(n)=\left\{n,\left\lfloor\dfrac n2\right\rfloor,\left\lfloor\dfrac n3\righ ...

- Veux mapState、mapGetters、mapActions、mapMutations && Vuex命名空间

1 # 一.四个map方法的使用 2 # 1.mapState方法:用于帮助我们映射state中的数据为计算属性 3 computed:{ 4 // sum(){ 5 // return this.$ ...

- Educational Codeforces Round 132 (Rated for Div. 2)

Educational Codeforces Round 132 (Rated for Div. 2) A. Three Doors 简述 题意: 有三扇门(1~3), 其中两扇门后面有对应标号门的钥 ...

- 详解ConCurrentHashMap源码(jdk1.8)

ConCurrentHashMap是一个支持高并发集合,常用的集合之一,在jdk1.8中ConCurrentHashMap的结构和操作和HashMap都很类似: 数据结构基于数组+链表/红黑树. ge ...

- 个人学习-STL深入学习01-vectory源码研习 // 需要补充

参考资料: [1]博主:一枚程序员 STL源码剖析--vector https://www.cnblogs.com/sooner/p/3273395.html [2]博主:劲蜡鸡腿堡 vector源码 ...

- Luogu3855 [TJOI2008]Binary Land (BFS)

#include <iostream> #include <cstdio> #include <cstring> #include <algorithm> ...