ML: 降维算法-LLE

局部线性嵌入 (Locally linear embedding)是一种非线性降维算法,它能够使降维后的数据较好地保持原有 流形结构 。LLE可以说是流形学习方法最经典的工作之一。很多后续的流形学习、降维方法都与LLE有密切联系。

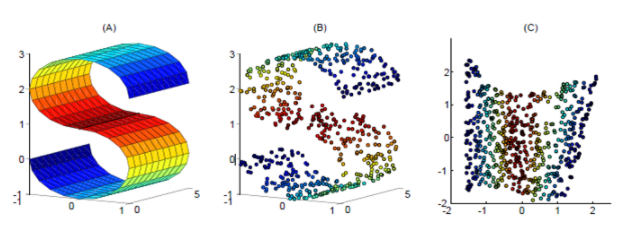

如下图,使用LLE将三维数据(b)映射到二维(c)之后,映射后的数据仍能保持原有的数据流形(红色的点互相接近,蓝色的也互相接近),说明LLE有效地保持了数据原有的流行结构。

但是LLE在有些情况下也并不适用,如果数据分布在整个封闭的球面上,LLE则不能将它映射到二维空间,且不能保持原有的数据流形。那么我们在处理数据中,首先假设数据不是分布在闭合的球面或者椭球面上。

LLE算法认为每一个数据点都可以由其近邻点的线性加权组合构造得到。算法的主要步骤分为三步:

- 1、寻找每个样本点的k个近邻点;

- 2、由每个 样本点的近邻点计算出该样本点的局部重建权值矩阵;

- 3、由该样本点的局部重建权值矩阵和其近邻点计算出该样本点的输出值。

理解:对于图像X中每一个块X1

- 第一步是计算出每个样本点Xi的k个近邻点,即找出样本点的近邻域集合,此处计算可以通过欧几里德距离法求;

- 第二步是计算出样本点的局部重建权值矩阵W来使得重构块X1的误差最小化;

- 第三步将所有样本点映射到低维空间中达到降维的目的

其原理解释可参考:

R实现LLE算法包

R算法包 lle , 参考资料:https://cran.r-project.org/web/packages/lle/index.html

Usage: lle(X, m, k, reg = 2, ss = FALSE, p = 0.5, id = FALSE, nnk = TRUE, eps = 1, iLLE = FALSE, v = 0.99)

- X: 输入的数据对象

- m: 输入数据的内在维度,这个参数主要影响结果的可视化,实现的内在维度结果在算法中会自动进行计算

- k: 近邻个数,K的取值在算法中起到关键作用,如果K值太大,LLE不能体现局部特性。使得LLE算法趋向于PCA算法。反之取得太小,LLE便不能保持样本点在在低维空间中的拓扑结构。可使用

calc_k. 函数进行计算 - id: 逻辑变量,定义是否进行内存维度计算

Usage: calc_k(X, m, kmin=1, kmax=20, plotres=TRUE,parallel=FALSE, cpus=2, iLLE=FALSE)

- m: 输入数据的内在维度

- kmin: K最小值

- kmax: K最大值

- plotres:是否plot结果

- parallel: 是否使用并行计算

示例代码

> remove(list = ls())

> if (require(lle) == FALSE)

+ {

+ install.packages("lle")

+ }

>

> test <- iris[,1:4]

> le <- lle(test,5,20,id=TRUE)

finding neighbours

calculating weights

intrinsic dim: mean=3.96, mode=4

computing coordinates

> table(le$id) 3 4

6 144

从上面的结果发现,输入数据的内在维度为2,再通过calc_k计算最合适的K值

> k <- calc_k(test,2,kmin = 1,kmax = dim(test)[1])

snowfall 1.84-6.1 initialized: sequential execution, one CPU.

如下图,选择K值:50

根据计算优化的参数,重新进行数据计算

> le <- lle(test,2,50)

finding neighbours

calculating weights

computing coordinates

> newSet <- cbind(iris,as.data.frame(le$Y))

> head(newSet)

Sepal.Length Sepal.Width Petal.Length Petal.Width Species V1 V2

1 5.1 3.5 1.4 0.2 setosa 0.5703337 -1.345773

2 4.9 3.0 1.4 0.2 setosa -0.7795944 -1.236492

3 4.7 3.2 1.3 0.2 setosa -0.8186908 -1.311557

4 4.6 3.1 1.5 0.2 setosa -1.2211154 -1.217567

5 5.0 3.6 1.4 0.2 setosa 0.5488266 -1.365494

6 5.4 3.9 1.7 0.4 setosa 1.9528668 -1.289062

结果图例显示

library(rgl)

plot_lle(le$Y,test)

ML: 降维算法-LLE的更多相关文章

- ML: 降维算法-概述

机器学习领域中所谓的降维就是指采用某种映射方法,将原高维空间中的数据点映射到低维度的空间中.降维的本质是学习一个映射函数 f : x->y,其中x是原始数据点的表达, y是数据点映射后的低维向量 ...

- ML: 降维算法-LE

PCA的降维原则是最小化投影损失,或者是最大化保留投影后数据的方差.LDA降维需要知道降维前数据分别属于哪一类,而且还要知道数据完整的高维信息.拉普拉斯特征映射 (Laplacian Eigenmap ...

- ML: 降维算法-LDA

判别分析(discriminant analysis)是一种分类技术.它通过一个已知类别的“训练样本”来建立判别准则,并通过预测变量来为未知类别的数据进行分类.判别分析的方法大体上有三类,即Fishe ...

- ML: 降维算法-PCA

PCA (Principal Component Analysis) 主成份分析 也称为卡尔胡宁-勒夫变换(Karhunen-Loeve Transform),是一种用于探索高维数据结 ...

- 四大机器学习降维算法:PCA、LDA、LLE、Laplacian Eigenmaps

四大机器学习降维算法:PCA.LDA.LLE.Laplacian Eigenmaps 机器学习领域中所谓的降维就是指采用某种映射方法,将原高维空间中的数据点映射到低维度的空间中.降维的本质是学习一个映 ...

- 【转】四大机器学习降维算法:PCA、LDA、LLE、Laplacian Eigenmaps

最近在找降维的解决方案中,发现了下面的思路,后面可以按照这思路进行尝试下: 链接:http://www.36dsj.com/archives/26723 引言 机器学习领域中所谓的降维就是指采用某种映 ...

- 降维算法整理--- PCA、KPCA、LDA、MDS、LLE 等

转自github: https://github.com/heucoder/dimensionality_reduction_alo_codes 网上关于各种降维算法的资料参差不齐,同时大部分不提供源 ...

- 【机器学习基础】无监督学习(2)——降维之LLE和TSNE

在上一节介绍了一种最常见的降维方法PCA,本节介绍另一种降维方法LLE,本来打算对于其他降维算法一并进行一个简介,不过既然看到这里了,就对这些算法做一个相对详细的学习吧. 0.流形学习简介 在前面PC ...

- sklearn LDA降维算法

sklearn LDA降维算法 LDA(Linear Discriminant Analysis)线性判断别分析,可以用于降维和分类.其基本思想是类内散度尽可能小,类间散度尽可能大,是一种经典的监督式 ...

随机推荐

- JAVA数组与List相互转换

1.数组转成List 数组转成List可以用方法 :Arrays.asList,一起来了解一下 System.out.println(Arrays.asList(new String[] { &quo ...

- CentOS安装JDK9

1.使用XShell将下载好的jdk-9.0.1_linux-x64_bin.tar.gz包上传到/opt/下 2.解压文件 $ tar -zxvf jdk-9.0.1_linux-x64_bin.t ...

- logging 模块 五星知识

logging 是用来记录日志的,有下面5种模式,它和print功能一样,只不过,print不能控制自己打印的内容,而logging可以控制,你想打印什么东西. logging 有两种形式: 第一种: ...

- 一种简单的ELF加固方法

介绍一种ELF文件函数粒度的加固方法,可以有效防止对程序的静态分析.这是一种有源码加固方式,需要被加固程序中代码配合.加固流程如下: 1)读取ELF文件头,获取e_phoff和e_phnum2)通过E ...

- Java匿名内部类的继承者、终结者————lambda表达式

一.什么是lambda表达式? lambda表达式就是一个代码块,可以传入变量和放入相应的代码. 二.基本格式 (参数 ) - >{ 代码 ...

- 深入理解Java中的多态

一.什么是多态? 多态指同一个实体同时具有多种形式.它是面向对象程序设计(OOP)的一个重要特征.如果一个语言只支持类而不支持多态,只能说明它是基于对象的,而不是面向对象的. 二.多态是如何实现的? ...

- xdoj-1117(记忆化搜索+组合数学)

因为我是从上到下,所以就不叫动态规划而叫记忆化搜索吧 (不过运行时间只有3ms....应该是很不错的吧) 排版怎么那么难看...编辑的时候不是这样子的啊?! 思想 : 大眼一看应该是一道很裸的状压dp ...

- xdoj-1106(判断组合数是否溢出)

1 首先 ans=c(n,a[0] )*c(n-a[0],a[1])*(n-a[0]-a[1],a[2])...... a[i]: 含义 在数列中i的个数有a[i]个 2 如何判断 x*y>p( ...

- ACM-ICPC 2018 焦作赛区网络预赛- G:Give Candies(费马小定理,快速幂)

There are N children in kindergarten. Miss Li bought them NNN candies. To make the process more inte ...

- linux php.ini文件没有指向 不生效

phpinfo下查看: 命令行下查看 :php -i | grep "Loaded Configuration File" 解决: 使用命令去追踪错误: strace /usr/ ...