hive学习笔记之九:基础UDF

欢迎访问我的GitHub

https://github.com/zq2599/blog_demos

内容:所有原创文章分类汇总及配套源码,涉及Java、Docker、Kubernetes、DevOPS等;

《hive学习笔记》系列导航

本篇概览

- 本文是《hive学习笔记》的第九篇,前面学习的内置函数尽管已经很丰富,但未必能满足各种场景下的个性化需求,此时可以开发用户自定义函数(User Defined Function,UDF),按照个性化需求自行扩展;

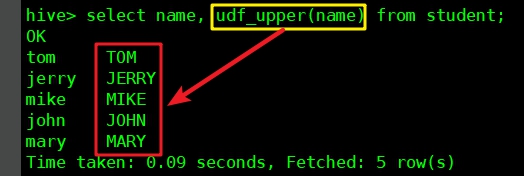

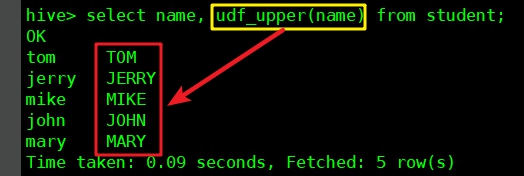

- 本篇内容就是开发一个UDF,名为udf_upper,功能是将字符串字段转为全大写,然后在hive中使用这个UDF,效果如下图红框所示:

- 本篇有以下章节:

- 开发

- 部署和验证(临时函数)

- 部署和验证(永久函数)

源码下载

- 如果您不想编码,可以在GitHub下载所有源码,地址和链接信息如下表所示:

| 名称 | 链接 | 备注 |

|---|---|---|

| 项目主页 | https://github.com/zq2599/blog_demos | 该项目在GitHub上的主页 |

| git仓库地址(https) | https://github.com/zq2599/blog_demos.git | 该项目源码的仓库地址,https协议 |

| git仓库地址(ssh) | git@github.com:zq2599/blog_demos.git | 该项目源码的仓库地址,ssh协议 |

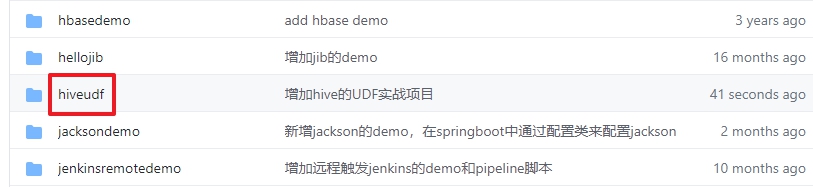

- 这个git项目中有多个文件夹,本章的应用在hiveudf文件夹下,如下图红框所示:

开发

- 新建名为hiveudf的maven工程,pom.xml内容如下,有两处需要关注的地方,接下来马上讲到:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.bolingcavalry</groupId>

<artifactId>hiveudf</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<dependency>

<groupId>org.apache.hive</groupId>

<artifactId>hive-exec</artifactId>

<version>1.2.2</version>

<scope>provided</scope>

<exclusions>

<exclusion>

<groupId>org.pentaho</groupId>

<artifactId>pentaho-aggdesigner-algorithm</artifactId>

</exclusion>

</exclusions>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.7.7</version>

<scope>provided</scope>

</dependency>

</dependencies>

</project>

- 上述pom.xml中,两个依赖的scope为provided,因为这个maven工程最终只需要将咱们写的java文件构建成jar,所以依赖的库都不需要;

- 上述pom.xml中排除了pentaho-aggdesigner-algorithm,是因为从maven仓库下载不到这个库,为了能快速编译我的java代码,这种排除的方式是最简单的,毕竟我用不上(另一种方法是手动下载此jar,再用maven install命令部署在本地);

- 创建Upper.java,代码如下非常简单,只需存在名为evaluate的public方法即可:

package com.bolingcavalry.hiveudf.udf;

import org.apache.commons.lang.StringUtils;

import org.apache.hadoop.hive.ql.exec.UDF;

public class Upper extends UDF {

/**

* 如果入参是合法字符串,就转为小写返回

* @param str

* @return

*/

public String evaluate(String str) {

return StringUtils.isBlank(str) ? str : str.toUpperCase();

}

}

- 编码已完成,执行mvn clean package -U编译构建,在target目录下得到hiveudf-1.0-SNAPSHOT.jar文件;

- 接下来将咱们做好的UDF部署在hive,验证功能是否正常;

部署和验证(临时函数)

- 如果希望UDF只在本次hive会话中生效,可以部署为临时函数,下面是具体的步骤;

- 将刚才创建的hiveudf-1.0-SNAPSHOT.jar文件下载到hive服务器,我这边路径是/home/hadoop/udf/hiveudf-1.0-SNAPSHOT.jar;

- 开启hive会话,执行以下命令添加jar:

add jar /home/hadoop/udf/hiveudf-1.0-SNAPSHOT.jar;

- 执行以下命令创建名为udf_upper的临时函数:

create temporary function udf_upper as 'com.bolingcavalry.hiveudf.udf.Upper';

- 找一个有数据并且有string字段的表(我这是student表,其name字段是string类型),执行以下命令:

select name, udf_upper(name) from student;

- 执行结果如下,红框中可见udf_upper函数将name字段转为大写:

- 这个UDF只在当前会话窗口生效,当您关闭了窗口此函数就不存在了;

- 如果您想在当前窗口将这个UDF清理掉,请依次执行以下两个命令:

drop temporary function if exists udf_upper;

delete jar /home/hadoop/udf/hiveudf-1.0-SNAPSHOT.jar;

- 删除后再使用udf_upper会报错:

hive> select name, udf_upper(name) from student;

FAILED: SemanticException [Error 10011]: Line 1:13 Invalid function 'udf_upper'

部署和验证(永久函数)

- 前面体验了临时函数,接下来试试如何让这个UDF永久生效(并且对所有hive会话都生效);

- 在hdfs创建文件夹:

/home/hadoop/hadoop-2.7.7/bin/hadoop fs -mkdir /udflib

- 将jar文件上传到hdfs:

/home/hadoop/hadoop-2.7.7/bin/hadoop fs -put /home/hadoop/udf/hiveudf-1.0-SNAPSHOT.jar /udflib/

- 在hive会话窗口执行以下命令,使用hdfs中的jar文件创建函数,要注意的是jar文件地址是hdfs地址,一定不要漏掉hdfs:前缀:

create function udf_upper as 'com.bolingcavalry.hiveudf.udf.Upper'

using jar 'hdfs:///udflib/hiveudf-1.0-SNAPSHOT.jar';

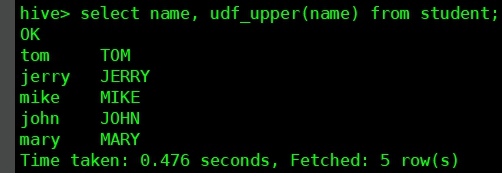

- 试一下这个UDF,如下图,没有问题:

6. 新开hive会话窗口尝试上述sql,依旧没有问题,证明UDF是永久生效的;

- 至此,咱们已经对hive的UDF的创建、部署、使用都有了基本了解,但是本篇的UDF太过简单,只能用在一进一出的场景,接下来的文章咱们继续学习多进一出和一进多出。

你不孤单,欣宸原创一路相伴

欢迎关注公众号:程序员欣宸

微信搜索「程序员欣宸」,我是欣宸,期待与您一同畅游Java世界...

https://github.com/zq2599/blog_demos

hive学习笔记之九:基础UDF的更多相关文章

- Hive学习笔记——HQL用法及UDF,Transform

Hive中没有定义专门的数据格式,数据格式可以由用户指定,用户定义数据格式需要指定三个属性:列分隔符(通常为空格.”\t”.”\x001″).行分隔符 (”\n”)以及读取文件数据的方法(Hive 中 ...

- hive学习笔记之六:HiveQL基础

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之一:基本数据类型

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之三:内部表和外部表

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之四:分区表

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之五:分桶

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之七:内置函数

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之十:用户自定义聚合函数(UDAF)

欢迎访问我的GitHub 这里分类和汇总了欣宸的全部原创(含配套源码):https://github.com/zq2599/blog_demos 本篇概览 本文是<hive学习笔记>的第十 ...

- hive学习笔记之十一:UDTF

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

随机推荐

- Python 送你一棵圣诞树

Python 送你一棵圣诞树 2019-01-02阅读 8800 今天是圣诞节,先祝大家圣诞快乐!??? 有人要说了,圣诞节是耶稣诞生的日子,我又不信基督教,有啥好庆祝的.这你就有所不知了,Pyt ...

- cent 7 识别exfat

cent 7 识别exfat install fuse-exfat exfat-utils

- Xshell 远程使用vim打开文件不能使用右键复制粘贴(右键显示可视)的问题

Xshell 远程使用vim打开文件不能使用右键复制粘贴(右键显示可视)的问题 Debian9.4系统不能再VIM打开文件界面不能使用右键复制粘贴 root@debian:~# vim /usr/sh ...

- SSH自动断开连接的原因-20200323

SSH自动断开连接的原因 方法一: 用putty/SecureCRT连续3分钟左右没有输入, 就自动断开, 然后必须重新登陆, 很麻烦. 在网上查了很多资料, 发现原因有多种, 环境变量TMOUT ...

- Spring Mvc Long类型精度丢失

背景 在使用Spring Boot Mvc的项目中,使用Long类型作为id的类型,但是当前端使用Number类型接收Long类型数据时,由于前端精度问题,会导致Long类型数据转换为Number类型 ...

- python 获取时间范围内日期列表

python 获取时间范围内日期列表 import datetime def dateRange(beginDate, endDate): dates = [] dt = datetime.datet ...

- GO语言面向对象07---面向对象练习02

package main import "fmt" /* ·定义接口IPerson,定义吃喝睡三个抽象方法: ·定义一个IPerson的实现类Person,实现吃喝睡方法; ·定义 ...

- CUDA 11功能清单

CUDA 11功能清单 基于NVIDIA Ampere GPU架构的新型NVIDIA A100 GPU在加速计算方面实现了最大的飞跃.A100 GPU具有革命性的硬件功能,CUDA 11与A100一起 ...

- 中继TensorRT集成

中继TensorRT集成 介绍 NVIDIA TensorRT是用于优化深度学习推理的库.这种集成将使尽可能多的算子从Relay转移到TensorRT,从而无需调整调度,即可在NVIDIA GPU上提 ...

- CodeGen API分析

CodeGen API分析 作为使用命令行界面的替代方法,开发人员可以使用核心CodeGen环境编写自定义工具或实用程序来生成代码,从而将CodeGen更紧密地集成到开发环境中. 为了实现这一点,Co ...