Python爬取房产数据,在地图上展现!

小伙伴,我又来了,这次我们写的是用python爬虫爬取乌鲁木齐的房产数据并展示在地图上,地图工具我用的是 BDP个人版-免费在线数据分析软件,数据可视化软件 ,这个可以导入csv或者excel数据。

- 首先还是分析思路,爬取网站数据,获取小区名称,地址,价格,经纬度,保存在excel里。再把excel数据上传到BDP网站,生成地图报表

本次我使用的是scrapy框架,可能有点大材小用了,主要是刚学完用这个练练手,再写代码前我还是建议大家先分析网站,分析好数据,再去动手写代码,因为好的分析可以事半功倍,乌鲁木齐楼盘,2017乌鲁木齐新楼盘,乌鲁木齐楼盘信息 - 乌鲁木齐吉屋网 这个网站的数据比较全,每一页获取房产的LIST信息,并且翻页,点进去是详情页,获取房产的详细信息(包含名称,地址,房价,经纬度),再用pipelines保存item到excel里,最后在bdp生成地图报表,废话不多说上代码:

JiwuspiderSpider.py

- # -*- coding: utf-8 -*-

- from scrapy import Spider,Request

- import re

- from jiwu.items import JiwuItem

- class JiwuspiderSpider(Spider):

- name = "jiwuspider"

- allowed_domains = ["wlmq.jiwu.com"]

- start_urls = ['http://wlmq.jiwu.com/loupan']

- def parse(self, response):

- """

- 解析每一页房屋的list

- :param response:

- :return:

- """

- for url in response.xpath('//a[@class="index_scale"]/@href').extract():

- yield Request(url,self.parse_html) # 取list集合中的url 调用详情解析方法

- # 如果下一页属性还存在,则把下一页的url获取出来

- nextpage = response.xpath('//a[@class="tg-rownum-next index-icon"]/@href').extract_first()

- #判断是否为空

- if nextpage:

- yield Request(nextpage,self.parse) #回调自己继续解析

- def parse_html(self,response):

- """

- 解析每一个房产信息的详情页面,生成item

- :param response:

- :return:

- """

- pattern = re.compile('<script type="text/javascript">.*?lng = \'(.*?)\';.*?lat = \'(.*?)\';.*?bname = \'(.*?)\';.*?'

- 'address = \'(.*?)\';.*?price = \'(.*?)\';',re.S)

- item = JiwuItem()

- results = re.findall(pattern,response.text)

- for result in results:

- item['name'] = result[2]

- item['address'] = result[3]

- # 对价格判断只取数字,如果为空就设置为0

- pricestr =result[4]

- pattern2 = re.compile('(\d+)')

- s = re.findall(pattern2,pricestr)

- if len(s) == 0:

- item['price'] = 0

- else:item['price'] = s[0]

- item['lng'] = result[0]

- item['lat'] = result[1]

- yield item

item.py

- # -*- coding: utf-8 -*-

- # Define here the models for your scraped items

- #

- # See documentation in:

- # http://doc.scrapy.org/en/latest/topics/items.html

- import scrapy

- class JiwuItem(scrapy.Item):

- # define the fields for your item here like:

- name = scrapy.Field()

- price =scrapy.Field()

- address =scrapy.Field()

- lng = scrapy.Field()

- lat = scrapy.Field()

- pass

pipelines.py 注意此处是吧mongodb的保存方法注释了,可以自选选择保存方式

- # -*- coding: utf-8 -*-

- # Define your item pipelines here

- #

- # Don't forget to add your pipeline to the ITEM_PIPELINES setting

- # See: http://doc.scrapy.org/en/latest/topics/item-pipeline.html

- import pymongo

- from scrapy.conf import settings

- from openpyxl import workbook

- class JiwuPipeline(object):

- wb = workbook.Workbook()

- ws = wb.active

- ws.append(['小区名称', '地址', '价格', '经度', '纬度'])

- def __init__(self):

- # 获取数据库连接信息

- host = settings['MONGODB_URL']

- port = settings['MONGODB_PORT']

- dbname = settings['MONGODB_DBNAME']

- client = pymongo.MongoClient(host=host, port=port)

- # 定义数据库

- db = client[dbname]

- self.table = db[settings['MONGODB_TABLE']]

- def process_item(self, item, spider):

- jiwu = dict(item)

- #self.table.insert(jiwu)

- line = [item['name'], item['address'], str(item['price']), item['lng'], item['lat']]

- self.ws.append(line)

- self.wb.save('jiwu.xlsx')

- return item

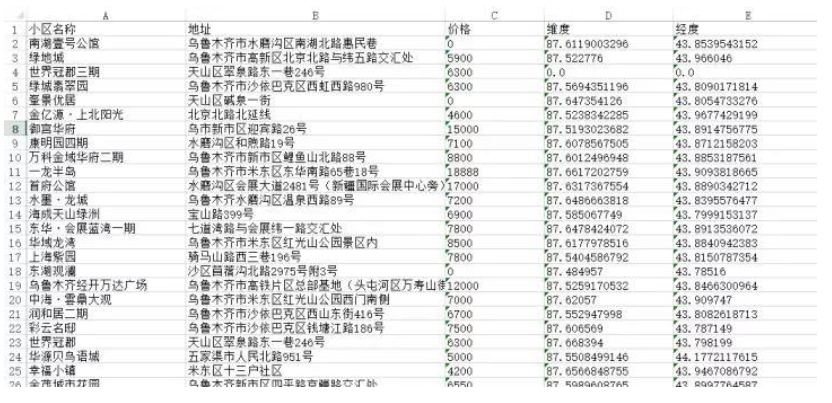

最后报表的数据

mongodb数据库

Python爬取房产数据,在地图上展现!的更多相关文章

- 如何使用Python爬取基金数据,并可视化显示

本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理 以下文章来源于Will的大食堂,作者打饭大叔 前言 美国疫情越来越严峻,大选也进入 ...

- 毕设之Python爬取天气数据及可视化分析

写在前面的一些P话:(https://jq.qq.com/?_wv=1027&k=RFkfeU8j) 天气预报我们每天都会关注,我们可以根据未来的天气增减衣物.安排出行,每天的气温.风速风向. ...

- python爬取网站数据

开学前接了一个任务,内容是从网上爬取特定属性的数据.正好之前学了python,练练手. 编码问题 因为涉及到中文,所以必然地涉及到了编码的问题,这一次借这个机会算是彻底搞清楚了. 问题要从文字的编码讲 ...

- python爬取网站数据保存使用的方法

这篇文章主要介绍了使用Python从网上爬取特定属性数据保存的方法,其中解决了编码问题和如何使用正则匹配数据的方法,详情看下文 编码问题因为涉及到中文,所以必然地涉及到了编码的问题,这一次借这 ...

- python爬取拉勾网数据并进行数据可视化

爬取拉勾网关于python职位相关的数据信息,并将爬取的数据已csv各式存入文件,然后对csv文件相关字段的数据进行清洗,并对数据可视化展示,包括柱状图展示.直方图展示.词云展示等并根据可视化的数据做 ...

- 用Python爬取股票数据,绘制K线和均线并用机器学习预测股价(来自我出的书)

最近我出了一本书,<基于股票大数据分析的Python入门实战 视频教学版>,京东链接:https://item.jd.com/69241653952.html,在其中用股票范例讲述Pyth ...

- python爬取github数据

爬虫流程 在上周写完用scrapy爬去知乎用户信息的爬虫之后,github上star个数一下就在公司小组内部排的上名次了,我还信誓旦旦的跟上级吹牛皮说如果再写一个,都不好意思和你再提star了,怕你们 ...

- 用python爬取微博数据并生成词云

很早之前写过一篇怎么利用微博数据制作词云图片出来,之前的写得不完整,而且只能使用自己的数据,现在重新整理了一下,任何的微博数据都可以制作出来,放在今天应该比较应景. 一年一度的虐汪节,是继续蹲在角落默 ...

- python爬取旅游数据+matplotlib简单可视化

题目如下: 共由6个函数组成: 第一个函数爬取数据并转为DataFrame: 第二个函数爬取数据后存入Excel中,对于解题来说是多余的,仅当练手以及方便核对数据: 后面四个函数分别对应题目中的四个m ...

随机推荐

- C# 高级编程01----.Net基础介绍

一.C#与.Net 的关系 1)C#语言 1. C#是一种简洁.类型安全的面向对象语言,可以使用C#语言创建可以在.Net Framework上运行的应用程序 2. C# 语言功能取决于.Net 的功 ...

- python3.0j基语法-01

python基础语法,字符编码,python解释器在加载 .py 文件中的代码时,会对内容进行编码(默认ascill) print("Hello word") 一个简单hello ...

- .net基础学java系列(六)Java基础

一.废话 .net学java为何一直没入坑?其实大家都知道,语法很相似,就是使用的习惯不同 稍微的语法差异 结构体系不同 IDE不同 类库集不同 各种框架不同 对于我来说,我一直被第三道坎拦住了,所以 ...

- MAC Undefined symbols for architecture x86_64 cv::imwrite

因为homebrew安装opencv时用的是clang,而CLion中使用的是gcc编译器. 将clion中的编译器改回默认的clang就行了.

- Useful Git Commands for me

查看Git追踪的文件 git ls-files 移除远程仓库的文件夹 git rm -r --cached some-directory git commit -m "Remove th ...

- sql server使用sql语句上传Excel到数据库

USE pro GO SELECT * INTO temp_budget_price@201704170950 FROM OPENDATASOURCE('Microsoft.Jet.OLE ...

- Codeforces 677E Vanya and Balloons

Vanya and Balloons 枚举中心去更新答案, 数字过大用log去比较, 斜着的旋转一下坐标, 然后我旋出来好多bug.... #include<bits/stdc++.h> ...

- 002 html总结

1.题目 每个HTML文件里开头都有个很重要的东西,Doctype,知道这是干什么的吗? div+css的布局较table布局有什么优点? strong与em的异同? 你能描述一下渐进增强和优雅降级之 ...

- react生命周期,中间件、性能优化、数据传递、mixin的使用

https://github.com/lulujianglab/blog/issues/34 一.生命周期 1,初始化的执行顺序,初始生命周期执行过程详解 class initSate extends ...

- functools.wraps函数

原文地址:https://www.cnblogs.com/fcyworld/p/6239951.html 第一次见到functools.wraps是在 Flask Web开发 中,一直不明白怎么回事. ...