wiki中文语料的word2vec模型构建

一、利用wiki中文语料进行word2vec模型构建

1)数据获取

到wiki官网下载中文语料,下载完成后会得到命名为zhwiki-latest-pages-articles.xml.bz2的文件,里面是一个XML文件

下载地址如下:https://dumps.wikimedia.org/zhwiki/latest/zhwiki-latest-pages-articles.xml.bz2

其中:https://dumps.wikimedia.org/zhwiki/latest/提供wiki各种文件下载,而且在不停的更新

本人已经下载并上传百度云盘,链接:https://pan.baidu.com/s/1kzMwGwVR4h0wuOYU70aUhA 提取码:2axt

然后在桌面新建wiki中文语料的word2vec模型构建文件夹,将下载的压缩文件放在内,进入wiki中文语料的word2vec模型构建文件夹,按住shift+右键,选择在此处打开命令窗口

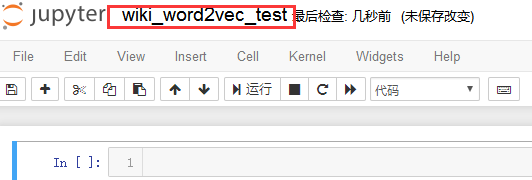

输入jupyter notebook,新建一个名为:wiki_word2vec_test的脚本文件:

2)将XML的Wiki数据转换为text格式

使用gensim.corpora中的WikiCorpus函数来处理维基百科的数据,转换后生成的文件wiki.zh.txt

import logging

import sys

import os from gensim.corpora import WikiCorpus program = os.path.basename( sys.argv[0] )

logger = logging.getLogger(program) logging.basicConfig(format='%(asctime)s: %(levelname)s: %(message)s')

logging.root.setLevel(level=logging.INFO)

logger.info( "running %s" % ' '.join(sys.argv) ) inp = 'zhwiki-latest-pages-articles.xml.bz2'

outp = 'wiki.zh.txt'

space = ' '

i = 0

output = open(outp, 'w', encoding='utf-8')

#gensim里的维基百科处理类WikiCorpu

wiki = WikiCorpus(inp, lemmatize=False, dictionary=[] ) #通过get_texts将维基里的每篇文章转换为1行text文本,并且去掉了标点符号等内容

for text in wiki.get_texts():

output.write( space.join(text) + '\n' )

i += 1

if ( i % 10000 == 0):

logger.info('Saved ' + str(i) + ' articles.') output.close()

logger.info('Finished Saved ' + str(i) + ' articles.')

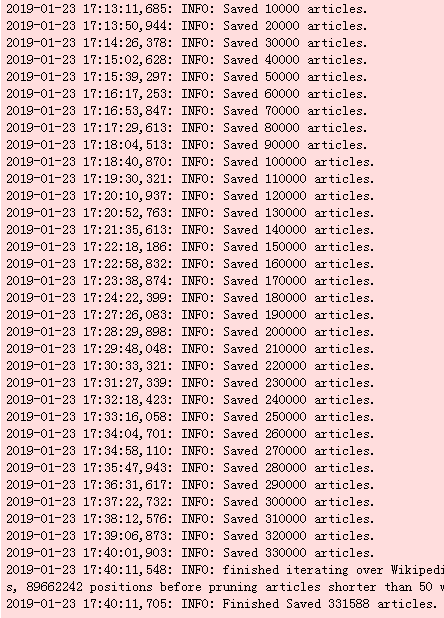

从下面的结果看27min处理了331588条数据,还是比较慢的,已经将wiki.zh.txt上传云盘,并且被压缩:

链接:https://pan.baidu.com/s/1g7d87ztvAdr8CZd2rCnvOg 提取码:42x5

3)中文繁体转简体

Wiki中文语料中包含了很多繁体字,需要转成简体字再进行处理,这里使用到了OpenCC工具进行转换

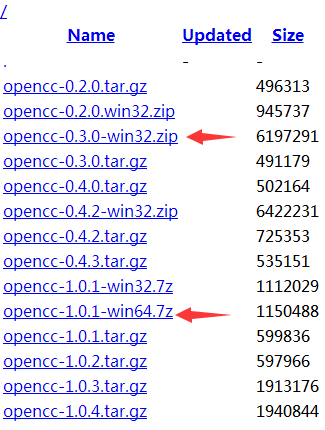

安装OpenCC:下载对应版本的OpenCC,https://bintray.com/package/files/byvoid/opencc/OpenCC,本人选择的是win 64位

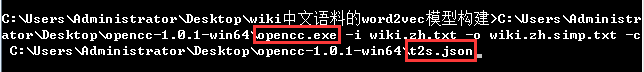

下载解压后,在wiki中文语料的word2vec模型构建文件夹下打开dos窗口:

opencc -i wiki.zh.txt -o wiki.zh.simp.txt -c t2s.json

#注意可以添加上opencc的绝对路径,t2s.json也要加绝对路径

则会得到文件wiki.zh.simp.txt,即转成了简体的中文,由于文件过大,无法直接打开查看,我们使用代码查看前2行:

import codecs,sys

i = 0

f = codecs.open('wiki.zh.txt','r',encoding="utf-8")

for eachline in f:

i += 1

if (i < 3):

print(eachline)

else:

break

可以看出有很多繁体字:

我们再来看看繁体转简体后:

import codecs,sys

i = 0

f = codecs.open('wiki.zh.simp.txt','r',encoding="utf-8")

for eachline in f:

i += 1

if (i < 3):

print(eachline)

else:

break

是不是都看懂了呢?

其中的wiki.zh.simp.txt简体文件以及被我压缩,并上传至云盘:

链接:https://pan.baidu.com/s/1Gx1iWORvKvmd5AzaZY3raw 提取码:45k5

4)jieba分词

本例中采用结巴分词对字体简化后的wiki中文语料数据集进行分词。由于此语料已经去除了标点符号,因此在分词程序中无需进行清洗操作,可直接分词

若是自己采集的数据还需进行标点符号去除和去除停用词的操作

import jieba

import jieba.analyse

import codecs def prepareData(sourceFile, targetFile):

f =codecs.open(sourceFile, 'r', encoding='utf-8')

target = codecs.open(targetFile, 'w', encoding='utf-8')

print( 'open source file: '+ sourceFile )

print( 'open target file: '+ targetFile ) lineNum = 0

for eachline in f:

lineNum += 1

if lineNum % 1000 == 0:

print('---processing ', sourceFile, lineNum,' article---')

seg_list = jieba.cut(eachline, cut_all=False)

line_seg = ' '.join(seg_list)

target.write(line_seg+ '\n')

print('---Well Done!!!---' * 4)

f.close()

target.close() sourceFile = 'wiki.zh.simp.txt'

targetFile = 'wiki.zh.simp.seg.txt'

prepareData(sourceFile, targetFile)

查看分词结果文件-wiki.zh.simp.seg.txt

import codecs,sys

i = 0

f = codecs.open('wiki.zh.simp.seg.txt','r',encoding="utf-8")

for eachline in f:

i += 1

if (i < 3):

print(eachline)

else:

break

其中分词结果文件wiki.zh.simp.seg.txt已经被压缩并上传云盘:

链接:https://pan.baidu.com/s/15R75m5T2WlyjMagqkXbI6g 提取码:zr46

5)Word2Vec模型训练

分好词的文档即可进行word2vec词向量模型的训练了。文档较大,需要内存较大,具体Python代码实现如下所示:

import os

import sys

import logging

from gensim.models import Word2Vec

from gensim.models.word2vec import LineSentence

import multiprocessing program = os.path.basename(sys.argv[0])

logger = logging.getLogger(program)

logging.basicConfig(format='%(asctime)s: %(levelname)s: %(message)s',level=logging.INFO)

logger.info("running %s" % ' '.join(sys.argv)) # inp为输入语料, outp1 为输出模型, outp2为原始c版本word2vec的vector格式的模型

inp = 'wiki.zh.simp.seg.txt'

outp1 = 'wiki.zh.text.model'

outp2 = 'wiki.zh.text.vector' #训练skip-gram 模型

model = Word2Vec( LineSentence(inp), size=400, window=5, min_count=5, workers=multiprocessing.cpu_count() )

model.save(outp1)

model.wv.save_word2vec_format(outp2, binary=False)

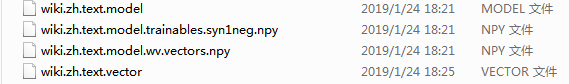

摘取了最后几行代码运行信息,代码运行完成后得到如下四个文件,其中wiki.zh.text.model是建好的模型,wiki.zh.text.vector是词向量,是每个词对应的词向量,可以在此基础上作文本特征的提取以及分类

其中wiki.zh.text.mode和wiki.zh.text.vector文件已经上传云盘:

wiki.zh.text.mode:https://pan.baidu.com/s/1mlZ_5-mY3GerWnvYADt3sA 提取码:7p83

wiki.zh.text.vector:https://pan.baidu.com/s/16vEVQ79FkmVFwMPrA3G5mg 提取码:aaa5

6)模型测试

模型训练好后,来测试模型的结果

import warnings

warnings.filterwarnings(action='ignore', category=UserWarning, module='gensim')# 忽略警告

import sys import gensim

model = gensim.models.Word2Vec.load('wiki.zh.text.model')

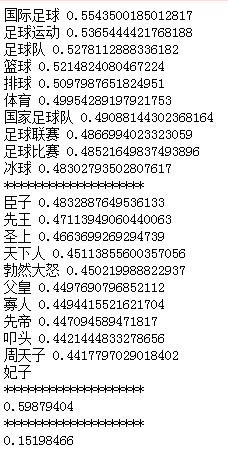

#与足球最相似的

word = model.most_similar("足球")

for each in word:

print(each[0], each[1]) print('*' * 20) word = model.most_similar(positive=['皇上','国王'],negative=['皇后'])

for t in word:

print (t[0],t[1]) print(model.doesnt_match('太后 妃子 贵人 贵妃 才人'.split(' ')))

print('*' * 20) print(model.similarity('书籍','书本'))

print('*' * 20)

print(model.similarity('逛街','书本'))

7)致谢

至此,使用python对中文wiki语料的词向量建模就全部结束了,wiki.zh.text.vector中是每个词对应的词向量,可以在此基础上作文本特征的提取以及分类

本文参考:https://github.com/AimeeLee77/wiki_zh_word2vec

感谢作者的分享,为后续情感分析打下了基础

wiki中文语料的word2vec模型构建的更多相关文章

- wiki中文语料+word2vec (python3.5 windows win7)

环境: win7+python3.5 1. 下载wiki中文分词语料 使用迅雷下载会快不少,大小为1个多G https://dumps.wikimedia.org/zhwiki/late ...

- 基于CBOW网络手动实现面向中文语料的word2vec

最近在工作之余学习NLP相关的知识,对word2vec的原理进行了研究.在本篇文章中,尝试使用TensorFlow自行构建.训练出一个word2vec模型,以强化学习效果,加深理解. 一.背景知识: ...

- word2vec词向量处理中文语料

word2vec介绍 word2vec官网:https://code.google.com/p/word2vec/ word2vec是google的一个开源工具,能够根据输入的词的集合计算出词与词之间 ...

- NLP学习(4)----word2vec模型

一. 原理 哈弗曼树推导: https://www.cnblogs.com/peghoty/p/3857839.html 负采样推导: http://www.hankcs.com/nlp/word2v ...

- 利用RNN进行中文文本分类(数据集是复旦中文语料)

利用TfidfVectorizer进行中文文本分类(数据集是复旦中文语料) 1.训练词向量 数据预处理参考利用TfidfVectorizer进行中文文本分类(数据集是复旦中文语料) ,现在我们有了分词 ...

- word2vec模型评估方案

1.word2vec参数详解 · sentences:可以是一个·ist,对于大语料集,建议使用BrownCorpus,Text8Corpus或·ineSentence构建.· sg: 用于设置训练算 ...

- Word2Vec模型参数 详解

用gensim函数库训练Word2Vec模型有很多配置参数.这里对gensim文档的Word2Vec函数的参数说明进行翻译,以便不时之需. class gensim.models.word2vec.W ...

- 基于tensorflow的文本分类总结(数据集是复旦中文语料)

代码已上传到github:https://github.com/taishan1994/tensorflow-text-classification 往期精彩: 利用TfidfVectorizer进行 ...

- word2vec模型原理与实现

word2vec是Google在2013年开源的一款将词表征为实数值向量的高效工具. gensim包提供了word2vec的python接口. word2vec采用了CBOW(Continuous B ...

随机推荐

- NSTimer 不工作 不调用方法

比如,定义一个NSTimer来隔一会调用某个方法,但这时你在拖动textVIew不放手,主线程就被占用了.timer的监听方法就不调用,直到你松手,这时把timer加到 runloop里,就相当于告诉 ...

- Servlet是否单例?

1,测试环境: Java SE版本:1.8.0_161(AMD64) Tomcat版本:9.0.7(AMD64) 2,试验 (1)编写HelloServlet. 由于测试代码很简单,此处只列出doGe ...

- iOS Accessibility指南

开发者经常会为用户开发一些令人充满惊喜的App.但是,开发者真的为每一个潜在的用户都做适配了么?是否每个人都可以真正使用你的APP呢? 设计APP.产品或者任何类型的服务,都要考虑到所有用户,包括视力 ...

- 通过BulkLoad快速将海量数据导入到Hbase

在第一次建立Hbase表的时候,我们可能需要往里面一次性导入大量的初始化数据.我们很自然地想到将数据一条条插入到Hbase中,或者通过MR方式等. 但是这些方式不是慢就是在导入的过程的占用Region ...

- 一探究竟:Namenode、SecondaryNamenode、NamenodeHA关系

NameNode与Secondary NameNode 很多人都认为,Secondary NameNode是NameNode的备份,是为了防止NameNode的单点失败的,其实并不是在这样.文章Sec ...

- SystemTap Beginners Guide

SystemTap 3.0 SystemTap Beginners Guide Introduction to SystemTap Edition 3.0 Red Hat, Inc. Don Do ...

- (十二)Deleting Documents

Deleting a document is fairly straightforward. This example shows how to delete our previous custome ...

- C++ SIMD

SIMD Single Instruction Multiple Data

- Fabric CA环境的集成

我们前面关于Fabric的所有文章中用到的例子都没有CA Server,都是由cryptogen这个工具根据crypto-config.yaml而生成的.但是在实际生产环境中,我们肯定不能这么做,我们 ...

- 随心测试_软测基础_002_<测试工程师_核心技能体系>

测试工程师核心技能体系构成 测试基础体系:[对象——>方法——>流程].[测试活动类型——>质量] 测试分析体系:[测试对象分析]——>[测试设计(计划.数据.用例.文档)] ...