论文阅读:Multi-task Learning for Multi-modal Emotion Recognition and Sentiment Analysis

论文标题:Multi-task Learning for Multi-modal Emotion Recognition and Sentiment Analysis

论文链接:http://arxiv.org/abs/1905.05812

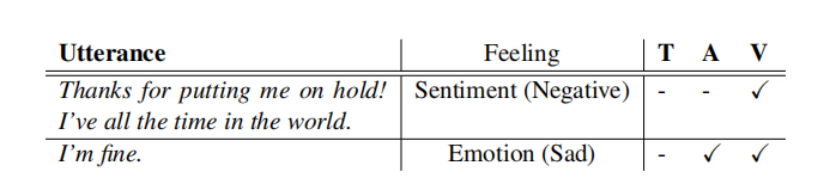

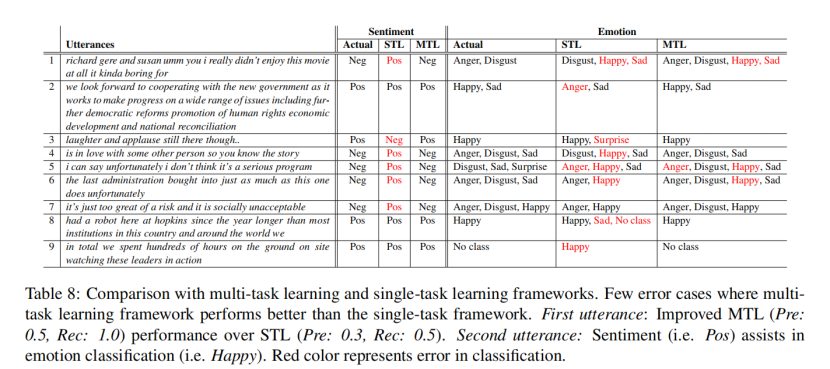

文章同时使用视觉、语音、和文本(语言)信息进行情感分析,通过增加视觉和语音信号,补足了一些无法通过文本来进行判断的情况,例如下图中,第一句话需要图像才能判断为负面情绪,第二句话同时语音和图像才能判断为负面情绪。

一、模型架构

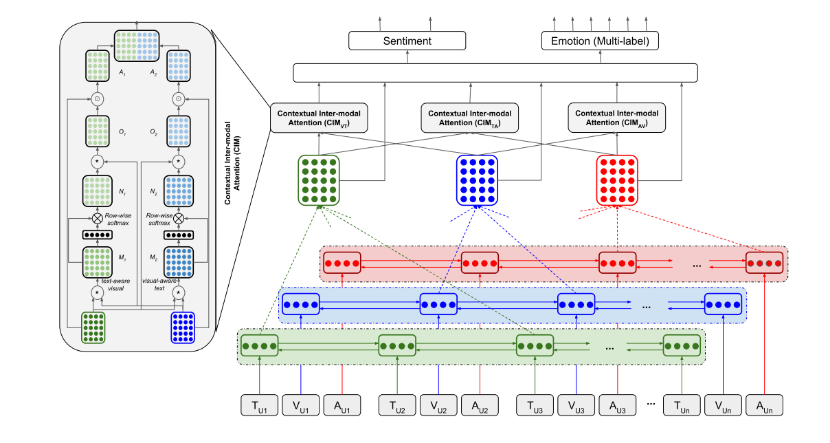

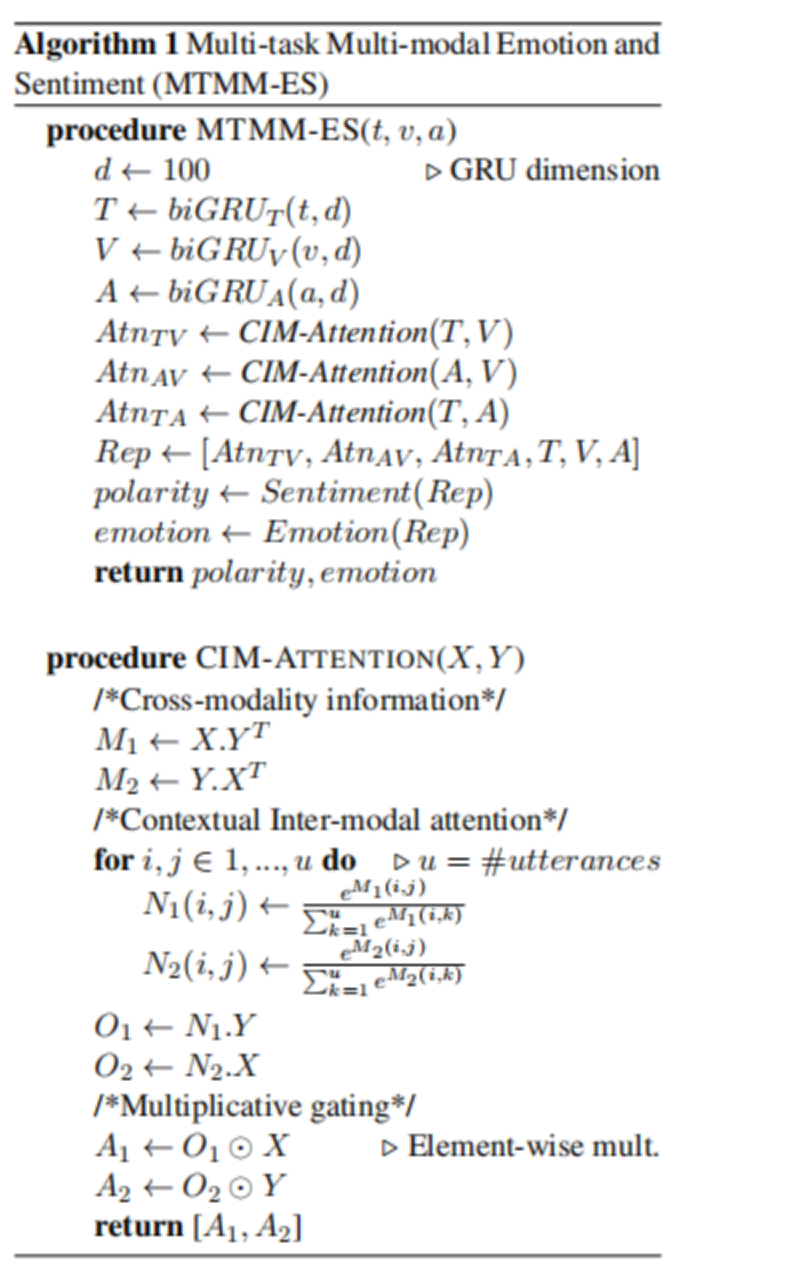

模型整体思路

- 1.首先,每一个模态的信息都会通过一个bi-directional GRU ,双向GRU可以有效的表征单一模态内部的相互关系。

- 2.得到的表征 A V T 需要通过本文提出的CIM 注意力机制去获得俩俩模态之间的互注意力( AV , AT, VT ),通过这个步骤可以获取到对模型分类最重要的信息。

- 3.将获得的注意力和 单模态特征 A V T进行拼接,得到最终表征。

- 4.将表征链接最后的分类层,进行分类任务。

CIM注意力机制( Contextual Inter-modal (CIM) Attention

Framework )

本文主要的特色是提出了CIM注意力方法,来提取模态间的互注意力,筛选出关键的信息,思路如下:

- 1.通过两个表征矩阵互相乘积得到跨模态信息M1,M2(可以理解为,一个模态中,每一个维度的信息和另外一个模态的所有维度信息做点积操作,可以得到两个模态之间的关系表征,类似于通过外积进行模态融合的bilinear pooling 操作)

- 2.通过soft-attention得到注意力分布N1,N2,在通过与特征进行乘积得到最终的注意力表征信息O1和O2。 这里的N1[ i , j ] 表示的是第一个模态第 i 个特征 与 第二个模态 第 j 个特征相关性,值越大,说明这个特征跟另外一个特征的交互性越强,也就越重要,所以O1 和 O2 得到的就是对 互注意力 贡献最大的特征的维度信息

- 3.通过注意力表征O1,O2与特征相乘得到最终的注意力特征A1,A2,这里使用的是乘法过滤机制,用过注意力表征和特征相乘,得到最终的经过过滤的特征。

二、数据集 CMU-MOSEI

全称: CMU Multi-modal Opinion Sentiment and Emotion Intensity (CMU-MOSEI)

总共包含 3,229 个视频片段,总共有23,000个句子,来自于1,000 个 youtueb视频 。

其中Training Set:16216,Validation Set : 1835 Test Set : 4625

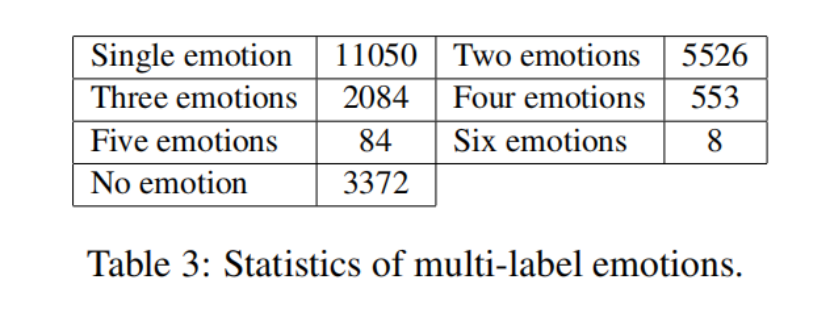

每个样本对应六个标签:anger, disgust, fear, happy, sad and surprise,具体统计如下图Table2 所示

文章中还测试了多标签分类任务,其中关于数据集多标签的统计入下图Table3 所示

三、结果

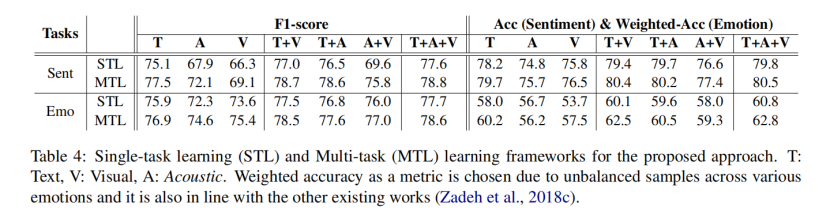

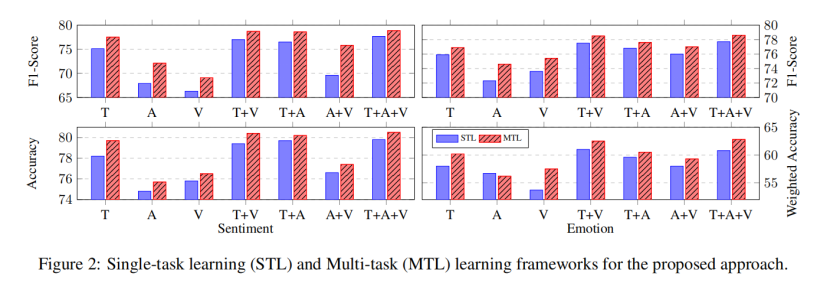

单模态下,语言模态效果最好,双模态下,语言+视觉 效果最好,总体而言三个模态效果最好,但是不明显。

多标签分类的效果整体上都领先于单标签分类

主要原因是多标签可以捕获更多的信息,来帮助模型进行判断

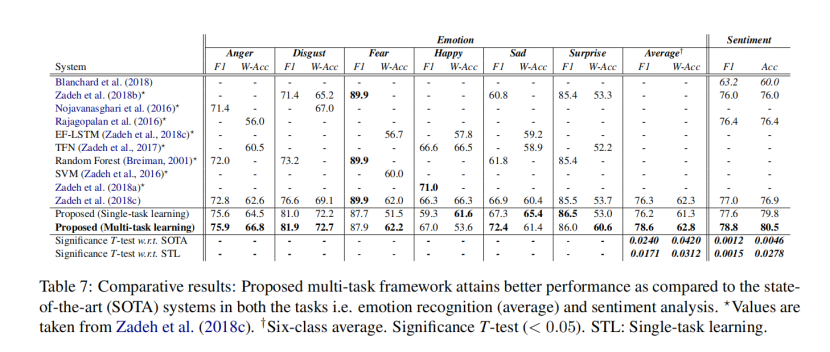

与已有模型对比也取得了很好的效果

论文阅读:Multi-task Learning for Multi-modal Emotion Recognition and Sentiment Analysis的更多相关文章

- [论文阅读笔记] Adversarial Learning on Heterogeneous Information Networks

[论文阅读笔记] Adversarial Learning on Heterogeneous Information Networks 本文结构 解决问题 主要贡献 算法原理 参考文献 (1) 解决问 ...

- 【论文阅读】Between-class Learning for Image Classification

文章:Between-class Learning for Image Classification 链接:https://arxiv.org/pdf/1711.10284.pdf CVPR2018 ...

- 【论文阅读】CVPR2022: Learning from all vehicles

Column: March 23, 2022 1:08 PM Last edited time: March 23, 2022 11:13 PM Sensor/组织: 现leaderboard第一名, ...

- 论文阅读 Inductive Representation Learning on Temporal Graphs

12 Inductive Representation Learning on Temporal Graphs link:https://arxiv.org/abs/2002.07962 本文提出了时 ...

- 论文阅读:MDNet: Learning Multi-Domain Convolutional Neural Networks for Visual Tracking

前言 CVPR2016 来自Korea的POSTECH这个团队 大部分算法(例如HCF, DeepLMCF)只是用在大量数据上训练好的(pretrain)的一些网络如VGG作为特征提取器,这些做法 ...

- [论文阅读] Deep Residual Learning for Image Recognition(ResNet)

ResNet网络,本文获得2016 CVPR best paper,获得了ILSVRC2015的分类任务第一名. 本篇文章解决了深度神经网络中产生的退化问题(degradation problem). ...

- 论文阅读《End-to-End Learning of Geometry and Context for Deep Stereo Regression》

端到端学习几何和背景的深度立体回归 摘要 本文提出一种新型的深度学习网络,用于从一对矫正过的立体图像回归得到其对应的视差图.我们利用问题(对象)的几何知识,形成一个使用深度特征表示的代价量(c ...

- 论文阅读 | CrystalBall: A Visual Analytic System for Future Event Discovery and Analysis from Social Media Data

CrystalBall: A Visual Analytic System for Future Event Discovery and Analysis from Social Media Data ...

- 【CV论文阅读】Two stream convolutional Networks for action recognition in Vedios

论文的三个贡献 (1)提出了two-stream结构的CNN,由空间和时间两个维度的网络组成. (2)使用多帧的密集光流场作为训练输入,可以提取动作的信息. (3)利用了多任务训练的方法把两个数据集联 ...

随机推荐

- 基于注解的DI

目录 一.使用注解的步骤 二.@Component 三.@Value 四.@Autowired 五.@Qualifier 六.@Resource 七.XML和注解对比 通过spring的注解完成对ja ...

- linux下免密登录配置

1.首先大家先开三台虚拟机 2.回到首层. 2.1:编辑文件: vim /etc/ssh/sshd_config 3:在master的linux上生成ssh密钥: ssh-keygen -t r ...

- GaussDB连接与登出

连接 连接命令1: gsql -d ${dbName} -U ${userName} -p {port:默认为25308} -h {ip} -W {password} 连接命令2: gsql -d p ...

- Git常用命令参考手册

配置 # 查看全局配置列表 git config -l # 查看局部配置列表 git config --local --list # 查看已设置的全局用户名/邮箱 git config --globa ...

- LDA线性判别分析原理及python应用(葡萄酒案例分析)

目录 线性判别分析(LDA)数据降维及案例实战 一.LDA是什么 二.计算散布矩阵 三.线性判别式及特征选择 四.样本数据降维投影 五.完整代码 结语 一.LDA是什么 LDA概念及与PCA区别 LD ...

- 浏览器自动化的一些体会9 webBrowser控件之零碎问题3

WebBrowser控件最大的优点是可以轻松嵌入win form程序中,但是微软好像对这个控件没什么兴趣,这么多年了还没有改进,结果造成一堆问题. 1. 不支持https 2. 缺省模拟ie 7,如果 ...

- three.js 利用uv和ThreeBSP制作一个快递柜

最近有three网友,问我要不要学习blender,其实我感觉学习一下也无妨,不过花大量时间精通,尚可不必,术业有专攻给别人留一条路吧,哈哈.那我我们就是用ThreeBSP和uv贴图的知识来制作一个定 ...

- python - 基础局部变量和全局变量

python中全局变量和局部变量的最大区别在于局部变量只能通过函数去访问,而全局变量可以直接访问 首先我们来看下什么是全局变量和局部变量 全局变量:在函数之外定义的变量,所有函数内可以调用这个全局变量 ...

- Python实现电脑控制,这个库让你可以控制和监控输入设备

前言 这个库让你可以控制和监控输入设备.对于每一种输入设备,它包含一个子包来控制和监控该种输入设备:pynput.mouse:包含控制和监控鼠标或者触摸板的类.pynput.keyboard:包含控制 ...

- PythonCrashCourse 第七章习题

编写一个程序,询问用户要租赁什么样的汽车,并打印一条消息,如"Let me see if I can find you a Subaru" car =input("Wha ...