TensorFlow 一步一步实现卷积神经网络

欢迎大家关注我们的网站和系列教程:http://www.tensorflownews.com/,学习更多的机器学习、深度学习的知识!

TensorFlow 从入门到精通系列教程:

http://www.tensorflownews.com/series/tensorflow-tutorial/

卷积层简单封装

# 池化操作

def conv2d(x, W, b, strides=1):

# Conv2D wrapper, with bias and relu activation

x = tf.nn.conv2d(x, W, strides=[1, strides, strides, 1], padding='SAME')

x = tf.nn.bias_add(x, b)

return tf.nn.relu(x)TensorFlow max_pool 函数介绍:

tf.nn.max_pool(x, ksize, strides ,padding)

参数 x:

和 conv2d 的参数 x 相同,是一个 4 维张量,每一个维度分别代表 batch,in_height,in_height,in_channels。

参数 ksize:

池化核的大小,是一个 1 维长度为 4 的张量,对应参数 x 的 4 个维度上的池化大小。

参数 strides:

1 维长度为 4 的张量,对应参数 x 的 4 个维度上的步长。

参数 padding:

边缘填充方式,主要是 “SAME”, “VALID”,一般使用 “SAME”。

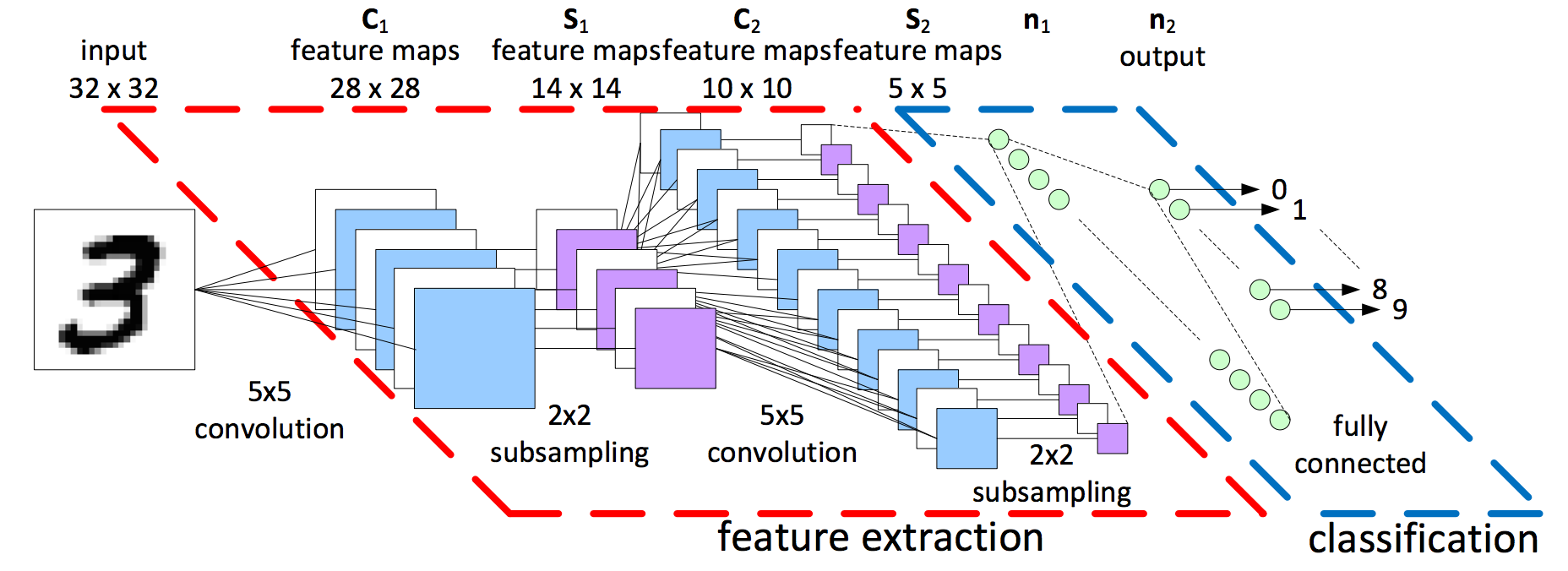

接下来将会使用 TensorFlow 实现以下结构的卷积神经网络:

卷积层简单封装

def maxpool2d(x, k=2):

# MaxPool2D wrapper

return tf.nn.max_pool(x, ksize=[1, k, k, 1], strides=[1, k, k, 1],padding='SAME')

卷积神经网络函数

超参数定义:

# 训练参数

learning_rate = 0.001

num_steps = 200

batch_size = 128

display_step = 10

# 网络参数

#MNIST 数据维度

num_input = 784

#MNIST 列标数量

num_classes = 10

#神经元保留率

dropout = 0.75卷积神经网络定义:

# 卷积神经网络

def conv_net(x, weights, biases, dropout):

x = tf.reshape(x, shape=[-1, 28, 28, 1])

# 第一层卷积

conv1 = conv2d(x, weights['wc1'], biases['bc1'])

# 第二层池化

conv1 = maxpool2d(conv1, k=2)

# 第三层卷积

conv2 = conv2d(conv1, weights['wc2'], biases['bc2'])

# 第四层池化

conv2 = maxpool2d(conv2, k=2)

#全连接层

fc1 = tf.reshape(conv2, [-1, weights['wd1'].get_shape().as_list()[0]])

fc1 = tf.add(tf.matmul(fc1, weights['wd1']), biases['bd1'])

fc1 = tf.nn.relu(fc1)

#丢弃

fc1 = tf.nn.dropout(fc1, dropout)

#输出层,输出最后的结果

out = tf.add(tf.matmul(fc1, weights['out']), biases['out'])

return out

效果评估

#softmax 层

logits = conv_net(X, weights, biases, keep_prob)

prediction = tf.nn.softmax(logits)

#定义损失函数

loss_op = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(

logits=logits, labels=Y))

#定义优化函数

optimizer = tf.train.AdamOptimizer(learning_rate=learning_rate)

#确定优化目标

train_op = optimizer.minimize(loss_op)

#获得预测正确的结果

correct_pred = tf.equal(tf.argmax(prediction, 1), tf.argmax(Y, 1))

#求准确率

accuracy = tf.reduce_mean(tf.cast(correct_pred, tf.float32))

训练过程输出

Step 1, Minibatch Loss= 92463.1406, Training Accuracy= 0.117

Step 10, Minibatch Loss= 28023.7285, Training Accuracy= 0.203

Step 20, Minibatch Loss= 13119.1172, Training Accuracy= 0.508

Step 30, Minibatch Loss= 5153.5215, Training Accuracy= 0.719

Step 40, Minibatch Loss= 4394.2578, Training Accuracy= 0.750

Step 50, Minibatch Loss= 4201.6006, Training Accuracy= 0.734

Step 60, Minibatch Loss= 2271.7676, Training Accuracy= 0.820

Step 70, Minibatch Loss= 2406.0142, Training Accuracy= 0.836

Step 80, Minibatch Loss= 3353.5925, Training Accuracy= 0.836

Step 90, Minibatch Loss= 1519.4861, Training Accuracy= 0.914

Step 100, Minibatch Loss= 1908.3972, Training Accuracy= 0.883

Step 110, Minibatch Loss= 2853.9766, Training Accuracy= 0.852

Step 120, Minibatch Loss= 2722.6582, Training Accuracy= 0.844

Step 130, Minibatch Loss= 1433.3765, Training Accuracy= 0.891

Step 140, Minibatch Loss= 3010.4907, Training Accuracy= 0.859

Step 150, Minibatch Loss= 1436.4202, Training Accuracy= 0.922

Step 160, Minibatch Loss= 791.8259, Training Accuracy= 0.938

Step 170, Minibatch Loss= 596.7582, Training Accuracy= 0.930

Step 180, Minibatch Loss= 2496.4136, Training Accuracy= 0.906

Step 190, Minibatch Loss= 1081.5593, Training Accuracy= 0.914

Step 200, Minibatch Loss= 783.2731, Training Accuracy= 0.930

Optimization Finished!

Testing Accuracy: 0.925781模型优化

经典卷积神经网络

图像分类实战项目

The CIFAR-10 dataset

目标检测实战项目

Tensorflow Object Detection API

https://github.com/tensorflow/models/tree/master/research/object_detection

主要参考对象:

1.TensorFlow 官方介绍

Image Recognition

https://tensorflow.google.cn/tutorials/image_recognition

https://www.tensorflow.org/tutorials/deep_cnn

2.最经典论文

ImageNet Classification with Deep Convolutional Neural Networks

http://papers.nips.cc/paper/4824-imagenet-classification-with-deep-convolutional-neural-networks

3.最经典课程

Convolutional Neural Networks

http://cs231n.github.io/convolutional-networks/Deep learning

http://neuralnetworksanddeeplearning.com/chap6.html

3.Wikipedia

Convolutional neural network

https://en.wikipedia.org/wiki/Convolutional_neural_network

4.Good tutorial

Comparison of Normal Neural network

Convolutional Neural Networks (LeNet)

http://deeplearning.net/tutorial/lenet.html#sparse-connectivity

Convolutional neural networks from scratch

http://gluon.mxnet.io/chapter04_convolutional-neural-networks/cnn-scratch.html

卷积神经网络

http://prors.readthedocs.io/zh_CN/latest/2ndPart/Chapter8.SceneClassification/ConvNet.html

ImageNet Classification with Deep Convolutional

Neural Networks

本篇文章出自http://www.tensorflownews.com,对深度学习感兴趣,热爱Tensorflow的小伙伴,欢迎关注我们的网站!

TensorFlow 一步一步实现卷积神经网络的更多相关文章

- 在 TensorFlow 中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- 在TensorFlow中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- TensorFlow实战第八课(卷积神经网络CNN)

首先我们来简单的了解一下什么是卷积神经网路(Convolutional Neural Network) 卷积神经网络是近些年逐步兴起的一种人工神经网络结构, 因为利用卷积神经网络在图像和语音识别方面能 ...

- TensorFlow实战之实现AlexNet经典卷积神经网络

本文根据最近学习TensorFlow书籍网络文章的情况,特将一些学习心得做了总结,详情如下.如有不当之处,请各位大拿多多指点,在此谢过. 一.AlexNet模型及其基本原理阐述 1.关于AlexNet ...

- 『TensorFlow』读书笔记_进阶卷积神经网络_分类cifar10_上

完整项目见:Github 完整项目中最终使用了ResNet进行分类,而卷积版本较本篇中结构为了提升训练效果也略有改动 本节主要介绍进阶的卷积神经网络设计相关,数据读入以及增强在下一节再与介绍 网络相关 ...

- TensorFlow深度学习实战---图像识别与卷积神经网络

全连接层网络结构:神经网络每两层之间的所有结点都是有边相连的. 卷积神经网络:1.输入层 2.卷积层:将神经网络中的每一个小块进行更加深入地分析从而得到抽象程度更高的特征. 3 池化层:可以认为将一张 ...

- 『TensorFlow』读书笔记_简单卷积神经网络

如果你可视化CNN的各层级结构,你会发现里面的每一层神经元的激活态都对应了一种特定的信息,越是底层的,就越接近画面的纹理信息,如同物品的材质. 越是上层的,就越接近实际内容(能说出来是个什么东西的那些 ...

- 『TensorFlow』读书笔记_进阶卷积神经网络_分类cifar10_下

数据读取部分实现 文中采用了tensorflow的从文件直接读取数据的方式,逻辑流程如下, 实现如下, # Author : Hellcat # Time : 2017/12/9 import os ...

- TensorFlow系列专题(十四): 手把手带你搭建卷积神经网络实现冰山图像分类

目录: 冰山图片识别背景 数据介绍 数据预处理 模型搭建 结果分析 总结 一.冰山图片识别背景 这里我们要解决的任务是来自于Kaggle上的一道赛题(https://www.kaggle.com/c/ ...

随机推荐

- 迈克尔·乔丹:几百年内AI不会觉醒

此乔丹非飞人乔丹.他是研究统计学和计算机科学家,目前研究的领域正是普通人所说的人工智能.权威的学术搜索引擎Semantic Scholar在2105年做了一项排名,关于计算机科学领域谁最具影响力 ...

- 编写一个可复用的SpringBoot应用运维脚本

前提 作为Java开发者,很多场景下会使用SpringBoot开发Web应用,目前微服务主流SpringCloud全家桶也是基于SpringBoot搭建的.SpringBoot应用部署到服务器上,需要 ...

- Python在计算内存时应该注意的问题?

我之前的一篇文章,带大家揭晓了 Python 在给内置对象分配内存时的 5 个奇怪而有趣的小秘密.文中使用了sys.getsizeof()来计算内存,但是用这个方法计算时,可能会出现意料不到的问题. ...

- Spring MVC知识梳理

同上一篇博客,复习梳理SpringMVC知识点,这次的梳理比较快,很多细节没有顾虑到,后期可能会回来补充 1. 整体架构 1.1 在学习了SSM框架后我们来理清三者的应用层面 浏览器发送请求,请求到达 ...

- c++获取屏幕大小

API: 要取得屏幕大小,可以用下面几个函数: # include <windows.h>int cx = GetSystemMetrics( SM_CXFULLSCREEN ); int ...

- tomcat服务器的应用总结

tomcat的安装和部署: >> Web的基本入门: |-- C/S架构:客户端和服务器: |-- B/S架构:浏览器和服务器: >> 服务器当中可以放入的资源: |-- 静态 ...

- MySQL的字符集和乱码问题

1.字符集知识 #概述 .字符集是一套文字符号及其编码.比较规则的集合,第一个计算机字符串ASC2 .mysql数据库字符集包括字符集(character)和 校对规则,其中字符集使用来定义mysql ...

- koa01

1.koa简介 koa是express团队开发的一个更加轻量级的服务端开发框架,也是未来的趋势 2.安装 npm i -g koa-generator //全局安装koa脚手架 3.创建项目 koa2 ...

- Postgresql存放数组形式的数据

Postgres 数据库允许把字段定义为可变长度的数组.数据类型既可以是内置类型,也可以是用户自定义的类型或枚举类型. 例如: 创建表 create table demo(name text,subj ...

- RabbitMQ 消息模式

消息模式实例 视频教程:https://ke.qq.com/course/304104 编写代码前,最好先添加好用户并设置virtual hosts 一.简单模式 1.导入jar包 <depen ...