Computer Vision_33_SIFT:Remote Sensing Image Registration With Modified SIFT and Enhanced Feature Matching——2017

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面。对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献。有一些刚刚出版的文章,个人非常喜欢,也列出来了。

33. SIFT

关于SIFT,实在不需要介绍太多,一万多次的引用已经说明问题了。SURF和PCA-SIFT也是属于这个系列。后面列出了几篇跟SIFT有关的问题。

[1999 ICCV] Object recognition from local scale-invariant features

[2000 IJCV] Evaluation of Interest Point Detectors

[2006 CVIU] Speeded-Up Robust Features (SURF)

[2004 CVPR] PCA-SIFT A More Distinctive Representation for Local Image Descriptors

[2004 IJCV] Distinctive Image Features from Scale-Invariant Keypoints

[2010 IJCV] Improving Bag-of-Features for Large Scale Image Search

[2011 PAMI] SIFTflow Dense Correspondence across Scenes and its Applications

[2015 TGRS] SAR-SIFT: A SIFT-LIKE ALGORITHM FOR SAR IMAGES

[2017 GRSL] Remote Sensing Image Registration With Modified SIFT and Enhanced Feature Matching

翻译

带有改进的SIFT和增强的功能匹配的遥感影像配准——

作者:Wenping Ma, Zelian Wen, Yue Wu, Licheng Jiao

摘要 -尺度不变特征变换算法及其许多变体在基于特征的遥感图像配准中得到了广泛的应用。但是,在强度映射有明显差异的某些情况下,可能很难为远程图像对找到足够的正确对应关系。在这封信中,引入了新的梯度定义以克服远程图像对之间图像强度的差异。然后,引入了一种通过组合每个关键点的位置,比例和方向的增强特征匹配方法,以增加正确对应关系的数量。该算法在多光谱和多传感器遥感图像上进行了测试。实验结果表明,与几种最新方法相比,该方法在正确对应的数量和对齐精度方面均提高了匹配性能。

索引词-特征匹配,图像配准,遥感,尺度不变特征变换(SIFT)。

Ⅰ 引言

IMAGE配准是将同一场景的两个或多个图像以不同的时间,不同的传感器和不同的视点进行匹配的过程[1]。它是许多遥感任务(例如变化检测,图像融合和环境监控)必不可少的部分。

已经提出了许多用于遥感图像配准的方法。这些方法可以粗略地分为两类:基于强度的方法和基于特征的方法[1],[2]。基于强度的方法使用像素强度之间的相似性来确定两个图像之间的对齐方式。主要使用的相似性度量是互相关和互信息[2]。然而,基于强度的方法具有单调的纹理[3],光照差异以及全局优化的高度计算复杂性[4]。基于特征的方法提取突出特征,并使用这些特征之间的相关性来确定最佳对齐方式。通常,这些特征包括点,边,轮廓,特定区域的质心[5],[6]等。在基于特征的方法中,尺度不变特征变换(SIFT)[7]是经典算法。 SIFT对图像缩放和旋转不变,而对照明和摄像机视点的变化也不变,因此它已成功用于可见图像配准。基于特征的方法还进行了其他一些改进,例如SURF [8],GLOH [9]和BRISK [10]。这些改进主要是为了提高计算效率。但是,当SIFT直接应用于遥感图像时,由于强度映射的显着差异,正确对应的数量不足以确认匹配精度[4]。强度映射可以是线性,非线性和不稳定的。为了克服这个问题,李等人[4]提出了鲁棒的SIFT(R-SIFT),其中细化了每个像素的梯度方向,并为每个关键点分配了更多的主要方向。在特征匹配过程中,引入了尺度-方向联合约束准则,以提高匹配性能。 Kupfer等人[11]提出了一种快速模式寻找SIFT(MS-SIFT)算法,该算法利用SIFT特征的比例,方向和位置信息,然后有效去除不精确的SIFT关键点对应关系。 Sedaghat等[3]提出了统一的R-SIFT(UR-SIFT)算法。 UR-SIFT方法有效地生成了足够的健壮,可靠且均匀分布的对齐关键点。Gong等人[2]。提出了一种从粗到精的自动图像配准方案。粗略的结果为优化器在微调过程中提供了接近最佳的初始解决方案。

在本文中,我们提出了一个新的梯度定义,以克服远程图像对之间图像强度的差异。此外,提出了一种鲁棒的点匹配算法,该算法结合了每个关键点的位置,比例和方向以增加正确对应的数量。该算法受SIFT算法启发,将被称为PSO-SIFT。我们假设一个相似度转换模型,该模型被广泛用于遥感图像的配准中。在第二部分中,讨论了经典SIFT算法的概述及其在遥感图像上的局限性。第三部分介绍了这封信中提出的算法。第四节说明了在三种不同的遥感图像对上的实验结果。第五节提供结论性意见。

Ⅱ 背景

基于SIFT的配准算法包括三个主要模块:关键点检测,描述符提取和关键点匹配。构造了高斯尺度空间的差异,作为高斯拉普拉斯算子的近似值。然后选择三个维度的局部极值作为候选关键点。根据局部梯度方向直方图,为每个关键点分配一个或多个主要方向。然后,将128个元素的描述符分配给每个关键点。获得的SIFT特征包括四个分量:局部分量(xi,yi),尺度si,方向θi和描述符di。最后一个模块使用描述符上的最小欧几里得距离作为关键点匹配标准。有关SIFT罐的更多详细信息在[7]中找到。

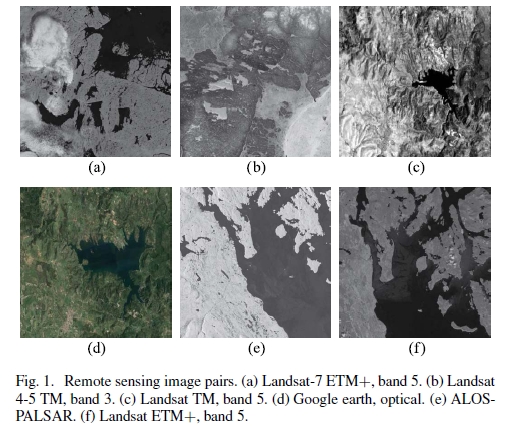

图1.遥感图像对。 (a)Landsat-7 ETM +,频段5。(b)Landsat 4-5 TM,频段3。(c)Landsat TM,频段5。(d)Google Earth,光学的。 (e)ALOSPALSAR。 (f)Landsat ETM +,第5组。

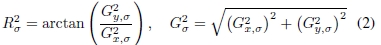

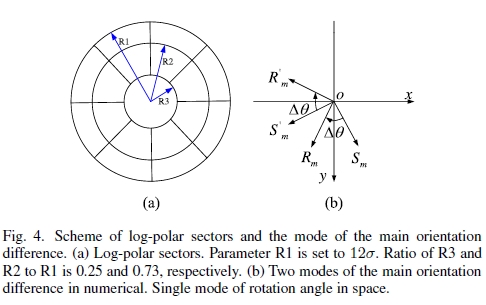

图1(a)和(b)显示了在两个不同的波段和不同的传感器设备中采集的多光谱图像。因此,它们具有非常不同的强度映射,通常更难配准。图2显示了图1(a)和(b)中匹配的原始SIFT关键点的缩放比例,主要方向差异,水平移位和垂直移位的直方图。通过对应的描述符的最近邻居的欧几里得距离与第二最近邻居的欧几里得距离之间的比率来匹配关键点。比率的阈值设置为比率。直方图的详细参数设置可以在[11]中找到。我们可以看到,除了比例比直方图外,这四个直方图显然无法显示单一模式,由于比例谱直方图的存在,由于多光谱图像与多光谱远程图像中相同区域之间的强度映射不同,因此可能具有显着的非线性强度差异[ 4]。这样的强度差异将导致预期正确匹配的对应关系的不同主取向差异。此外,特征描述符对这些差异并不鲁棒,因为每个关键点的主要方向都在描述符提取过程中使用,以确保旋转不变性。

图2.(a)-(d)比例比,主要方向差异,水平位移和垂直位移的直方图。

Ⅲ 建议的方法

A.新的渐变定义

强度映射的显着差异将导致遥感图像对之间同一区域的梯度方向和梯度大小不同。因此,期望正确匹配的SIFT对应关系将不会具有最小的欧几里得距离,因为对应关系计算取决于描述符,该描述符是由关键点位置周围的梯度方向和梯度大小形成的。为了使描述符对这种差异更加鲁棒,我们为高斯比例空间中的每个像素提出了新的梯度定义(包括方向和大小)。为了提高所提方法的效率,不对输入图像对进行扩展,而是使用原始输入图像构建最低级别的高斯金字塔。首先,我们通过Sobel滤波器计算高斯比例空间图像的梯度幅度为

其中σ是高斯尺度空间的尺度,Gx,σ1和Gy,σ1分别表示具有尺度σ的高斯尺度空间图像的水平和垂直导数。然后,我们将建议的梯度方向和梯度幅度定义为

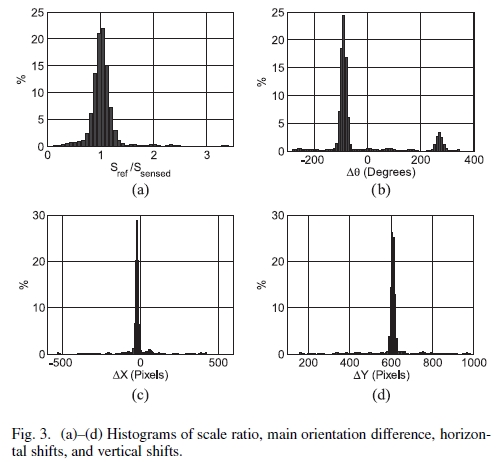

其中Gx,σ2和Gy,σ2分别表示高斯尺度空间的梯度幅值图像Gσ1的水平和垂直导数。所有导数均通过Sobel滤波器近似。使用Sobel运算符,可以轻松计算导数[12],[13]。注意,由(2)计算的梯度被用于方向分配和描述符提取的过程中。在这封信中,我们在计算直方图时不使用梯度幅度的高斯加权[14]。与使用原始SIFT描述符中的正方形邻域和4×4正方形扇区不同,我们使用类似于GLOH的[9],[14]圆形邻域(半径为12σ)和对数极性扇区(17个定位仓)来创建一个特征描述符。一系列实验表明,GLOH获得了最佳结果[9]。注意,梯度方向被量化在八个箱中。这导致了136维的描述符。图4(a)说明了该方法。

图3.(a)-(d)比例比,主要方向差异,水平移位和垂直移位的直方图。

图4.对数极性扇区的方案和主要方向差异的模式。 (a)对数极扇区。 参数R1设置为12σ。 R3和R2与R1之比分别为0.25和0.73。 (b)两种主要方向差异的模式。 空间中旋转角度的单一模式。

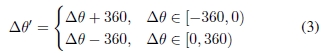

图3显示了在应用建议的梯度定义后,图1(a)和(b)中匹配的关键点的比例,主要方向差异,水平偏移和垂直偏移的直方图。与图2的结果相反,这些直方图显然表现出单一模式,除了具有两个主要模式的主要方向差异直方图。主取向差直方图具有两个主要模式的原因是,圆周角在-180°和180°中不连续[见图4(b)]。需要指出的是,旋转角度只有一种主要模式。如果我们知道两个主要模型的位置之一,则另一种模式的位置可以计算为

其中,Δθ和Δθ′分别表示主取向差直方图的两种模式的位置。图4(b)示出了主取向差的两种模式和旋转角的单一模式。比例比的模式很容易位于r = 1.022。主取向差的两种模式位于Δθ= -89.61和Δθ'= 270.97。在Δx= -10.96和Δy= 608.76处获得水平移位和垂直移位的模式。注意,模式的确切位置是通过适当的插值方法获得的[11]。 Δθ和Δθ′之间的关系非常接近(3)的结果。最后,我们采用快速样本共识(FSC)算法[15]来分别获得变换模型参数r = 0.99,Δθ= -90,Δx= -9.71和Δy= 604.75。从以上结果和分析可以看出,新的梯度计算方法较好地解决了遥感图像对的强度差问题。

B.增强功能匹配

相似度转换包含三个参数:平移,缩放和旋转。在相似度转换模型下,大多数情况下,正确匹配对在空间中的旋转角度相同,缩放比例相同,水平偏移相同,垂直偏移相同。因此,我们使用每个关键点的固有信息(即位置,比例和主要方向)来增加正确对应的数量。

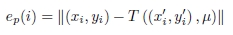

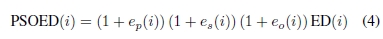

两点要素集P = p1,p2,... ,pM和P′= p1′,p2′,...Pn 分别从参考图像和感测图像中提取出。 (xi,yi),si和θi分别表示关键点pi在参考图像中的位置,比例和主要方向。 (xi',yi'),si' 和θi' 分别表示关键点pi' 在感测图像中的位置,比例和主要方向。对应pi和pi' 的位置变换误差表示为

其中T((xi',yi'),μ)是相似变换模型,μ是变换模型参数。我们还使用点pi和pi' 的比例误差[4]和相对主要方向误差[4]作为

其中,r*和Δθ* 分别表示参考图像和感测图像之间的比例比和主要方向差的模式位置,而Δθi=θi-θi' 表示pi和pi' 之间的主要方向差。然后,我们定义一个更健壮的关节距离,称为位置比例取向欧几里德距离(PSOED)为

其中ED(i)表示与关键点pi和pi'对应的描述符的欧几里得距离。在正确匹配点对的大多数情况下,PSOED会最小化。下面给出了提出的匹配算法。

1)初始匹配:关键点通过对应描述符的最近邻和第二近邻的欧几里得距离之比进行匹配。比率的阈值设置为比率。获得对集PP,然后设置比例比,主要方向差异,水平位移和垂直位移的直方图。从直方图获得模式位置r*,Δθ*,Δx*和Δy*。 FSC算法[15]用于根据对集PP计算初始转换参数μ。

2)重新匹配:由于主要方向差异直方图具有两种模式,因此r*,Δθ*,Δx*和Δy* 只有两种不同的组合。对于每种模式组合,我们使用PSOED作为距离度量,并且关键点由最近邻居和第二最近邻居的距离之比匹配。该比率的阈值表示为dr。由于匹配执行了两次,因此参考图像或感测图像中的关键点将在另一图像中具有一个或多个匹配;因此,我们将具有最小PSOED的点对视为候选匹配对。然后,获得关键点对集合PP1。

3)离群值删除:PP1中会有一些错误的对应。因此,我们首先使用MS-SIFT [11]中提出的方法来滤除大多数异常值。令(x1,y1)和(x1',y1')表示集合PP1中相应关键点的坐标。相应关键点的水平和垂直移动定义为

然后,根据以下逻辑过滤器[11]消除大多数异常值:

其中Δxth和Δyth分别表示水平和垂直差的阈值。阈值设置为相应直方图的单元格宽度[11]。最后,我们从PP1得到一个关键点对集PP2,然后使用FSC算法[15]从关键点对集PP2中找到正确的对应关系。

请注意,尽管我们需要在初始匹配步骤中为每个关键点对计算欧几里得距离,但在重新匹配步骤中可以节省计算量。为了很好地显示直方图的分布,将dratio设置为0.9。为了获得尽可能多的候选关键点对,dr设置为0.9 [4]。相较于随机样本共识[16],离群值去除步骤中采用的FSC算法可在更少的迭代中获得更多正确的匹配。

IV 实验与结果

A.测试映像对

为了评估提出的方法,测试了三个图像对。这些图像对如图1所示。第一对P-A是来自美国地质调查局计划[17]的多光谱图像,纬度/经度:69.6 / -92.7,分辨率为240-m。选择来自波段5(传感器:Landsat-7 ETM +,日期:2000/7/24)的大小为614×611的片段作为参考图像。为了增加测试数据集的难度,在模拟旋转90°之后,从频段3(传感器:Landsat 4-5 TM,日期:1999/6/28)中选择一个大小为614×611的片段作为感测到的图像。第二对PB是两个412×300多传感器图像,参考图像是从传感器Landsat-TM在1995年9月拍摄的场景的波段5中获得的(空间分辨率为30 m),并且感测到的图像是光学图像。从Google Earth获得(空间分辨率为5 m)。第三对PC是两个800×800多传感器图像,参考图像是从2010年6月5日在不列颠哥伦比亚省坎贝尔里弗地区的传感器ALOSPALSAR拍摄的场景的HH模式(L波段)获得的(最初的15 m空间分辨率重新采样到30 m),并且感测到的图像来自Landsat-ETM +传感器于1999年6月26日在同一区域(带有A波段)拍摄的场景的波段5(1.55–1.75μm)。 30 m的空间分辨率)。

B.评估标准

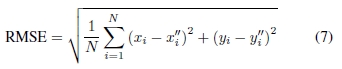

1)匹配精度:精度由均方根误差(rmse)准则[2],[11]评估。从参考图像和感测图像中手动选择总共N个对应点对{(xi,yi),(x'i,y'i)}。点对经过精心选择和精炼,以尽可能减少残差[2]。因此,这些点对用作测试模型参数精度的参考。均方根值根据

其中(xi'',yi'')表示(xi',yi')的变换坐标。对于每个测试图像对,算法执行十次,然后将十个结果的平均值计算为最终结果。

2)关键点编号:正确对应的数量用作评估所提出方法的鲁棒性的标准[18]。调整了关键点检测的阈值,因此比较方法和建议的方法具有大致相同数量的检测点。

C.实验结果

我们将提出的PSO-SIFT算法与基于SIFT的FSC算法,SURF,SAR-SIFT [14]和MS-SIFT算法进行了比较。尽管SAR-SIFT算法是专为SAR图像而设计的,但对于其他类型的遥感图像却显示出良好的性能。除了SURF之外,其他方法还可以在MATLAB R2012a下使用Intel Core 2.53 GHz处理器和6 GB物理内存来实现。源代码位于https://github.com/ZeLianWen/Image-Registration。

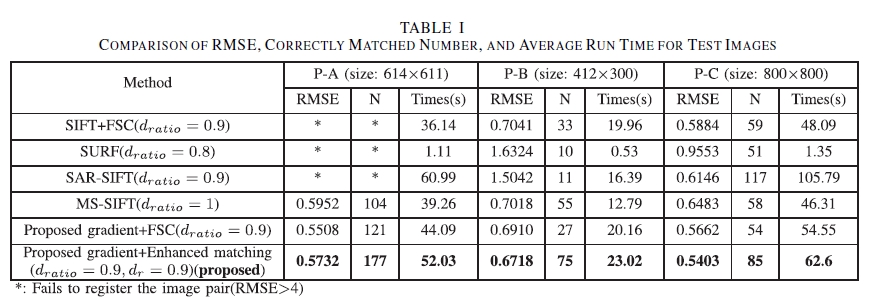

表Ⅰ RMSE,正确匹配的数字和测试图像平均运行时间的比较

无法配准图像对(RMSE>4)

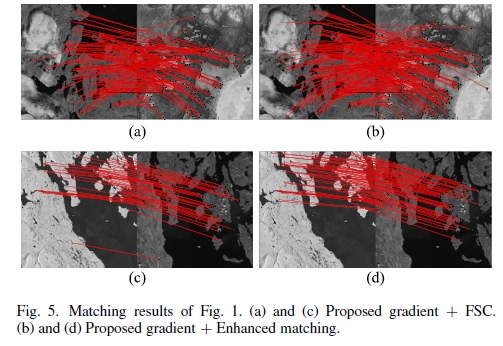

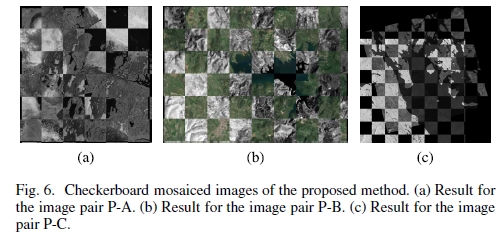

表I中显示了匹配精度,正确匹配的关键点编号以及三个测试对的平均运行时间的结果。请注意,该算法执行十次,并且十次运行时间的平均值作为最终运行时间。在两个不同的频段和不同的传感器设备中获取测试对P-A。由于不同的光谱带,远程图像对之间的强度映射存在一些不规则的关系。考虑到表I中的结果,SIFT,SAR-SIFT和SURF无法配准测试对P-A。然而,在我们修改了梯度计算方法之后,过滤了121个正确匹配的关键点,并获得了子像素匹配结果,这表明了新梯度定义的稳健性。尽管MSSIFT可以准确匹配测试对P-A,但是很难调整其参数以获得令人满意的结果。用不同的传感器设备获取测试对P-B和P-C,并且远程图像对之间的图像强度具有单调关系。 SIFT,SURF,SAR-SIFT和MS-SIFT可以准确匹配此图像对,表明这些方法对于单调强度变换是不变的。所提出的梯度计算方法还实现了亚像素精度。为了验证增强特征匹配方法的鲁棒性,我们比较了两种算法,分别称为“建议梯度+ FSC”和“建议梯度+增强匹配”。可以清楚地看到,增强的匹配方法有效地增加了正确匹配的关键点的数量。对于测试图像对P-A,尽管增强匹配的均方根误差比FSC高一点,但它也达到了亚像素精度。还证明了FSC算法的鲁棒性。由于基于C ++的SURF的实现,效率非常高。两个图像对的匹配结果如图5所示。与FSC相比,增强的匹配方法大大增加了正确的匹配。棋盘格马赛克图像如图6所示。可以看出,两个图像的边缘和区域精确重叠,这证明了我们提出的方法的准确性。

图5.图1的匹配结果。(a)和(c)建议的梯度+ FSC。 (b)和(d)建议的梯度+增强匹配。

图6.所提出方法的棋盘格马赛克图像。 (a)图像对P-A的结果。 (b)图像对P-B的结果。 (c)图像对P-C的结果。

Ⅴ 结论

在这封信中,我们提出了一种新的梯度计算方法,该方法对遥感影像的复杂非线性强度变换更鲁棒。另外,已经提出了一种鲁棒的点匹配算法,该算法结合了每个关键点的位置,比例和方向以增加正确对应的数量。在多光谱和多传感器遥感图像上的实验结果表明,在某些情况下,在对准精度和关键点的正确匹配方面,我们的方法显示出比最新技术更好的性能。

参考资料

[1] A. Wong and D. A. Clausi, “ARRSI: Automatic registration of remote sensing images,” IEEE Trans. Geosci. Remote Sens., vol. 45, no. 5, pp. 1483–1493, May 2007.

[2] M. Gong, S. Zhao, L. Jiao, D. Tian, and S. Wang, “A novel coarse-to-fine scheme for automatic image registration based on sift and mutual information,” IEEE Trans. Geosci. Remote Sens., vol. 52, no. 7, pp. 4328–4338, Jul. 2014.

[3] A. Sedaghat, M. Mokhtarzade, and H. Ebadi, “Uniform robust scale invariant feature matching for optical remote sensing images,” IEEE Trans.Geosci. Remote Sens., vol. 49, no. 11, pp. 4516–4527, Nov. 2011.

[4] Q. Li, G. Wang, J. Liu, and S. Chen, “Robust scale-invariant feature matching for remote sensing image registration,” IEEE Geosci. Remote Sens. Lett., vol. 6, no. 2, pp. 287–291, Apr. 2009.

[5] J. Senthilnath, S. N. Omkar, V. Mani, and T. Karthikeyan, “Multiobjective discrete particle swam optimization for multisensor image alignment,” IEEE Geosci. Remote Sens. Lett., vol. 10, no. 5, pp. 1095–1099, Sep. 2013.

[6] J. Senthilnath, N. P. Kalro, and J. A. Benediktsson, “Accurate point matching based on multi-objective genetic algorithm for multi-sensor satellite imagery,” Appl. Math. Comput., vol. 236, pp. 546–564, 2014.

[7] D. G. Lowe, “Distinctive image features from scale-invariant keypoints,” Int. J. Comput. Vis., vol. 60, no. 2, pp. 91–110, Nov. 2004.

[8] H. Bay, A. Ess, and T. Tuytelaars, “SURF: Speeded-up robust features,” Comput. Vis. Image Understand., vol. 110, no. 3, pp. 346–359, Jun. 2008.

[9] K. Mikolajczyk and C. Schmid, “A performance evaluation of local descriptors,” IEEE Trans. Pattern Anal. Mach. Intell., vol. 27, no. 10, pp. 1615–1630, Oct. 2005.

[10] S. Leutenegger, M. Chli, and R. Siegwart, “BRISK: Binary robust invariant scalable keypoints,” in Proc. IEEE Int. Conf. Comput. Vis., 2011, pp. 2548–2555.

[11] B. Kufer, N. S. Netanyahu, and I. Shimshoni, “An efficient SIFT-based mode-seeking algorithm for sub-pixel registration of remotely sensed images,” IEEE Geosci. Remote Sens. Lett., vol. 12, no. 2, pp. 379–383, Feb. 2015.

[12] Q. Yang and X. Xiao, “A new registration method base on improved Sobel and SIFT algorithms,” in Proc. 3rd Int. Conf. Comput. Elect. Eng., 2010, p. 528.

[13] Y. Li, L. Liu, L. Wang, D. Li, and M. Zhang, “Fast SIFT algorithm based on Sobel edge detector,” in Proc. 2nd Int. Conf. Consum. Electron, Commun. Netw., Apr. 2012, pp. 1820–1823.

[14] F. Dellinger, J. Delon, Y. Gousseau, J. Michel, and F. Tupin, “SAR-SIFT: A SIFT-like algorithm for SAR images,” IEEE Trans. Geosci. Remote Sens., vol. 53, no. 1, pp. 453–466, Jan. 2015.

[15] Y. Wu, W. Ma, M. Gong, L. Su, and L. Jiao, “A novel point-matching algorithm based on fast sample consensus for image registration,” IEEE Geosci. Remote Sens. Lett., vol. 12, no. 1, pp. 43–47, Jan. 2015.

[16] M. A. Fischler and R. C. Bolles, “Random sample consensus: A paradigm for model fitting with applications to image analysis and automated cartography,” Commun. ACM, vol. 24, no. 6, pp. 381–395, Jun. 1981.

[17] [Online]. Available: http://glovis.usgs.gov/ [18] Q. Li, S. Qi, Y. Shen, D. Li, H. Zhang, and T. Wang, “Multispectral image alignment with nonlinear scale-invariant keypoint and enhanced local feature matrix,” IEEE Geosci. Remote Sens. Lett., vol. 12, no. 7, pp. 1551–1556, Jul. 2015.

Computer Vision_33_SIFT:Remote Sensing Image Registration With Modified SIFT and Enhanced Feature Matching——2017的更多相关文章

- Computer Vision_33_SIFT:Robust scale-invariant feature matching for remote sensing image registration——2009

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT: A novel point-matching algorithm based on fast sample consensus for image registration——2015

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:A novel coarse-to-fine scheme for automatic image registration based on SIFT and mutual information——2014

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:An efficient SIFT-based mode-seeking algorithm for sub-pixel registration of remotely sensed images——2015

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:TILDE: A Temporally Invariant Learned DEtector——2014

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:Fast Adaptive Bilateral Filtering——2018

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:An Improved RANSAC based on the Scale Variation Homogeneity——2016

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:LIFT: Learned Invariant Feature Transform——2016

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

- Computer Vision_33_SIFT:ORB_An efficient alternative to SIFT or SURF——2012

此部分是计算机视觉部分,主要侧重在底层特征提取,视频分析,跟踪,目标检测和识别方面等方面.对于自己不太熟悉的领域比如摄像机标定和立体视觉,仅仅列出上google上引用次数比较多的文献.有一些刚刚出版的 ...

随机推荐

- (九)Centos之搜索命令whereis、which和字符串搜索命令grep

一.Centos之命令搜索命令whereis与which 1.1 whereis 命令名(搜索命令所在路径及帮助文档所在位置) 选项: -b :只查找可执行文件位置 -m:只查找帮助文件 1.2 wh ...

- python:一行代码实现局域网共享文件

其实就是使用python内置的一个模块http server 在python2中是下面这样的 python -m SimpleHTTPServer 80 解释下上面的参数,-m表示让python使用一 ...

- Java面试 - final、finally、finalize的区别?

final:用于声明属性, 方法和类,分别表示属性不可变.方法不可覆盖.被其修饰的类不可继承. finally:异常处理语句结构的一部分,表示总是执行. finalize:Object 类的一个方法, ...

- 5、1 es 数据库和mysql 数据库同步 (Windows操作系统)

(1)在logstash-5.6.8安装目录下创建文件夹mysqletc (名称随意) (2)文件夹下创建mysql.conf (名称随意) ,内容如下: input { jdbc { #sc表 jd ...

- 结合 Nginx 谈谈 Http 状态码

[Http状态码简介] [百度百科]HTTP状态码(英语:HTTP Status Code)是用以表示网页服务器超文本传输协议响应状态的3位数字代码.它由 RFC 2616 规范定义的,并得到 RFC ...

- [转帖]CPU时间片

CPU时间片 https://www.cnblogs.com/xingzc/p/6077214.html CPU的时间片 CPU的利用率好CPU的 load average 是不一样的 Conntex ...

- [转帖]持久化journalctl日志清空命令查看配置参数详解

持久化journalctl日志清空命令查看配置参数详解 最近 linux上面部署服务 习惯使用systemd 进行处理 这样最大的好处能够 使用journalctl 进行查看日志信息. 今天清理了下 ...

- 获取Android手机日志

方式一:使用USB连接 1.在手机上启用USB调试2.在终端输入adb devices 3.获取日志 只连接一个设备:1)清除已缓存日志:adb logcat -c2)获取日志并保存到本地:adb l ...

- Lucas定理的运用及组合数奇偶性的判断

组合数奇偶性的判断 对于C(n,k),若n&k == k 则c(n,k)为奇数,否则为偶数. 最直观的方法就是计算一下,然后看它的奇偶性:但是这个时间以及数据范围上都不允许: 另外一种方法就是 ...

- ubuntu 上不了网,解决方案之一

每个人的情况可能不同,我的情况是由于强制关机网卡坏了,网络没有自动分配ip,ens33网卡没有ip,这时得手动启动命令 sudo dhclient 来自动获取ip地址.这里要感谢这篇博客,让我意识到自 ...