HDFS02 HDFS的Shell操作

HDFS的Shell操作(开发重点)

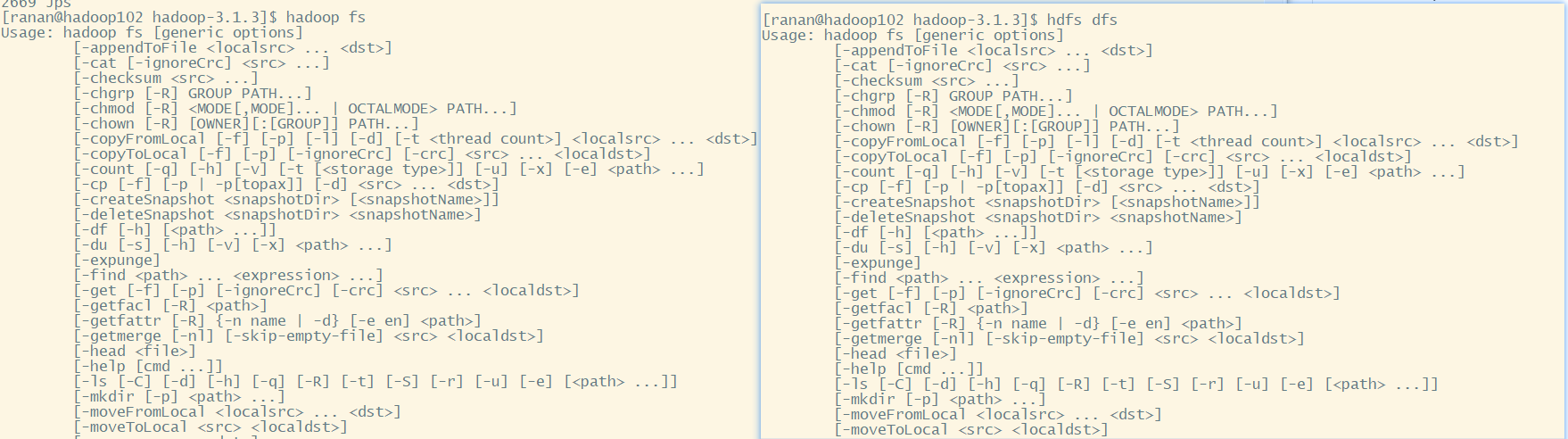

基本语法

方式1: hadoop fs 具体命令

方式2: hdfs dfs 具体命令

常用命令

一共分三大类命令:上传、下载、HDFS直接操作

准备工作

1.启动Hadoop集群

[ranan@hadoop102 hadoop-3.1.3]$ myhadoop.sh start

# 或者也可以像之前一样分别在102,103上使用以下两个命令:

[ranan@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh

[ranana@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh

2.查看命令帮助,如果对某个命令的用法不清楚

[ranan@hadoop102 ~]$ hadoop fs -help rm

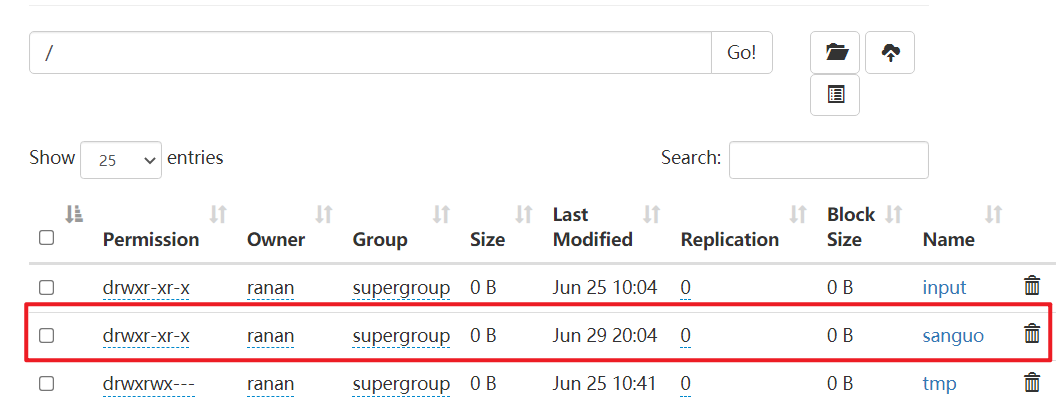

3.创建/sanguo文件

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -mkdir /sanguo

后续的命令在该文件夹下操作

上传

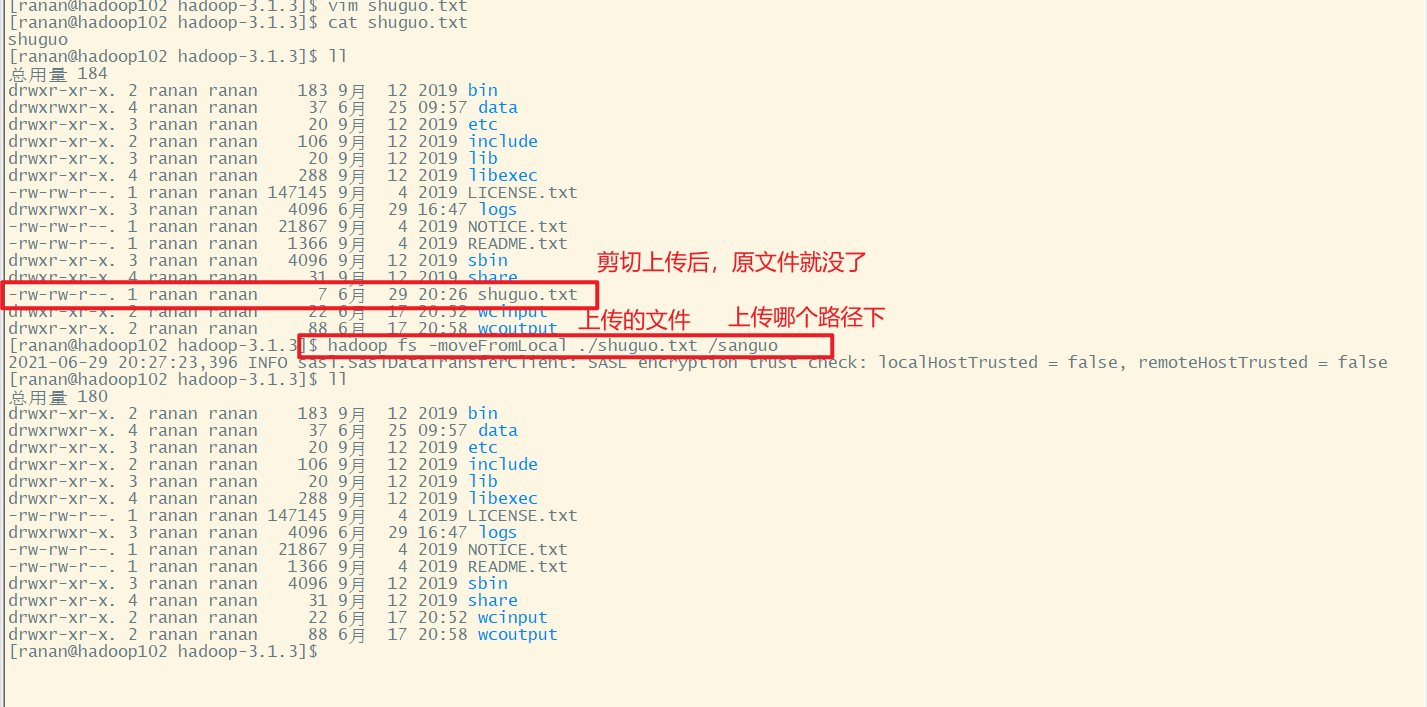

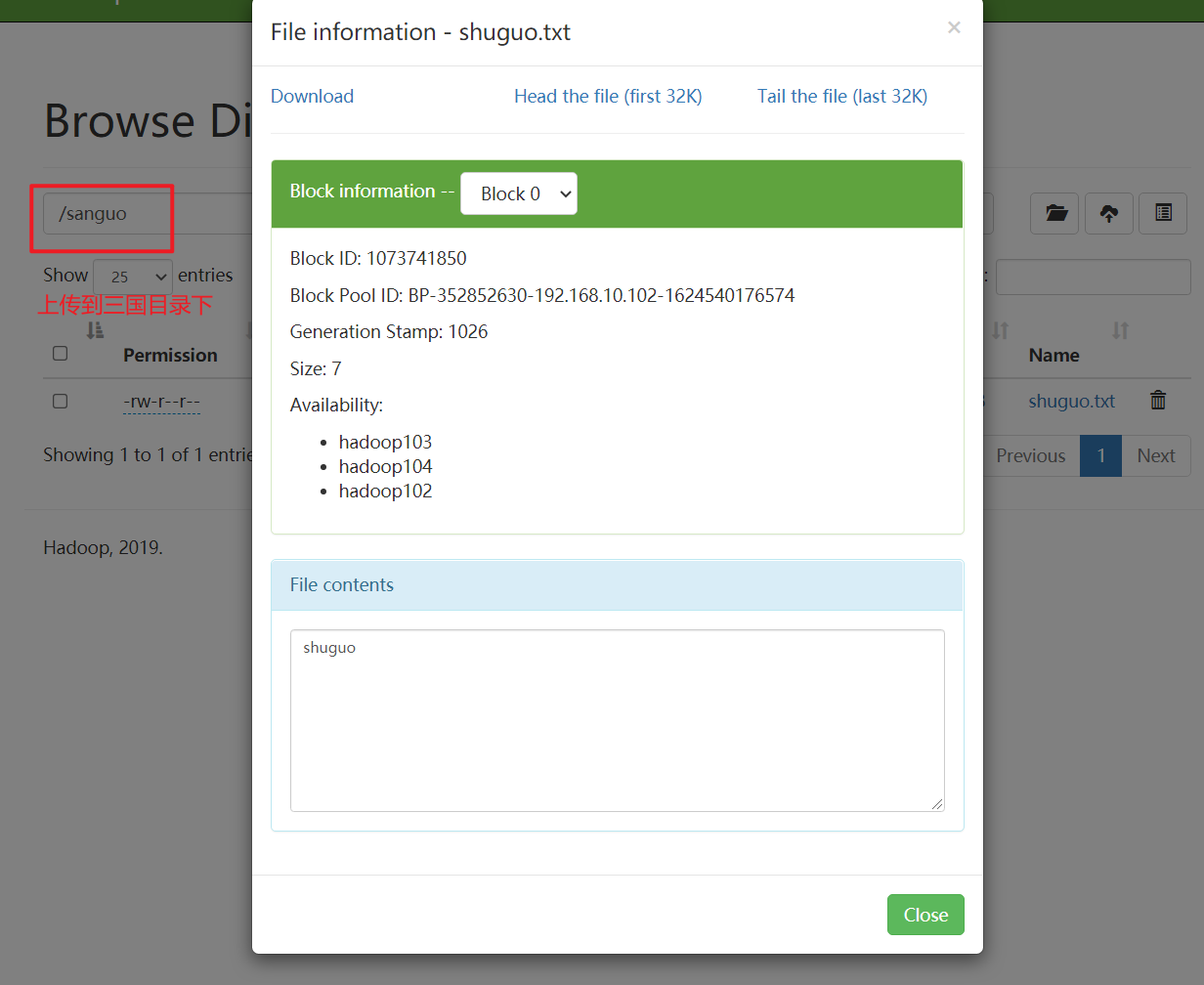

-moveFromLocal 剪切

从本地剪切粘贴到HDFS

基本语法:hadoop fs -moveFromLocal 原文件 上传路径

[ranan@hadoop102 hadoop-3.1.3]$ vim shuguo.txt

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -moveFromLocal ./shuguo.txt /sanguo

-copyFromLocal 拷贝

从本地文件系统中拷贝文件到HDFS路径

基本语法:hadoop fs -copyFromLocal 原文件 上传路径

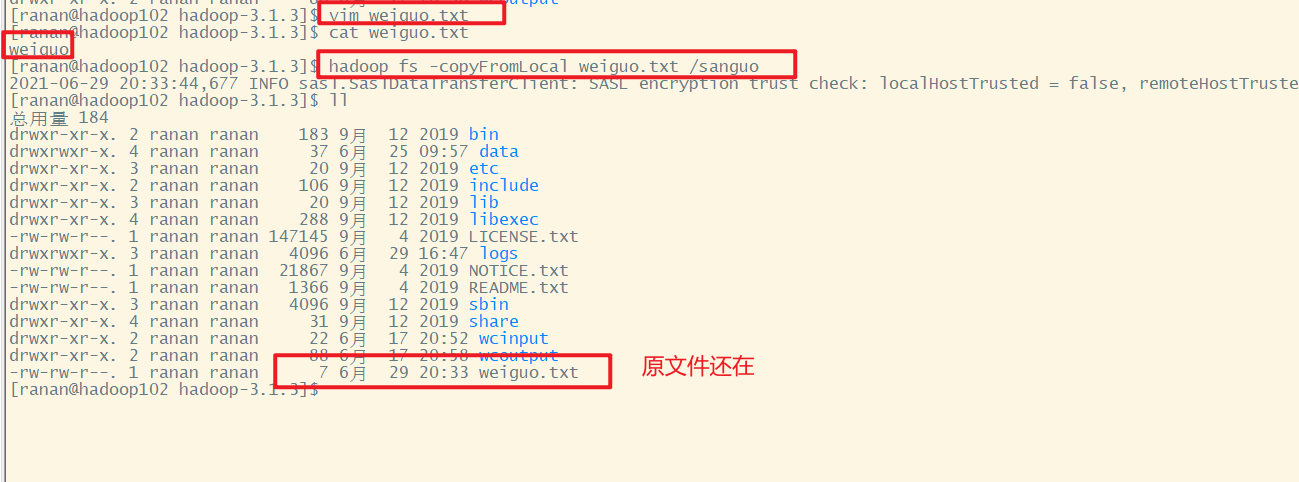

[ranan@hadoop102 hadoop-3.1.3]$ vim weiguo.txt

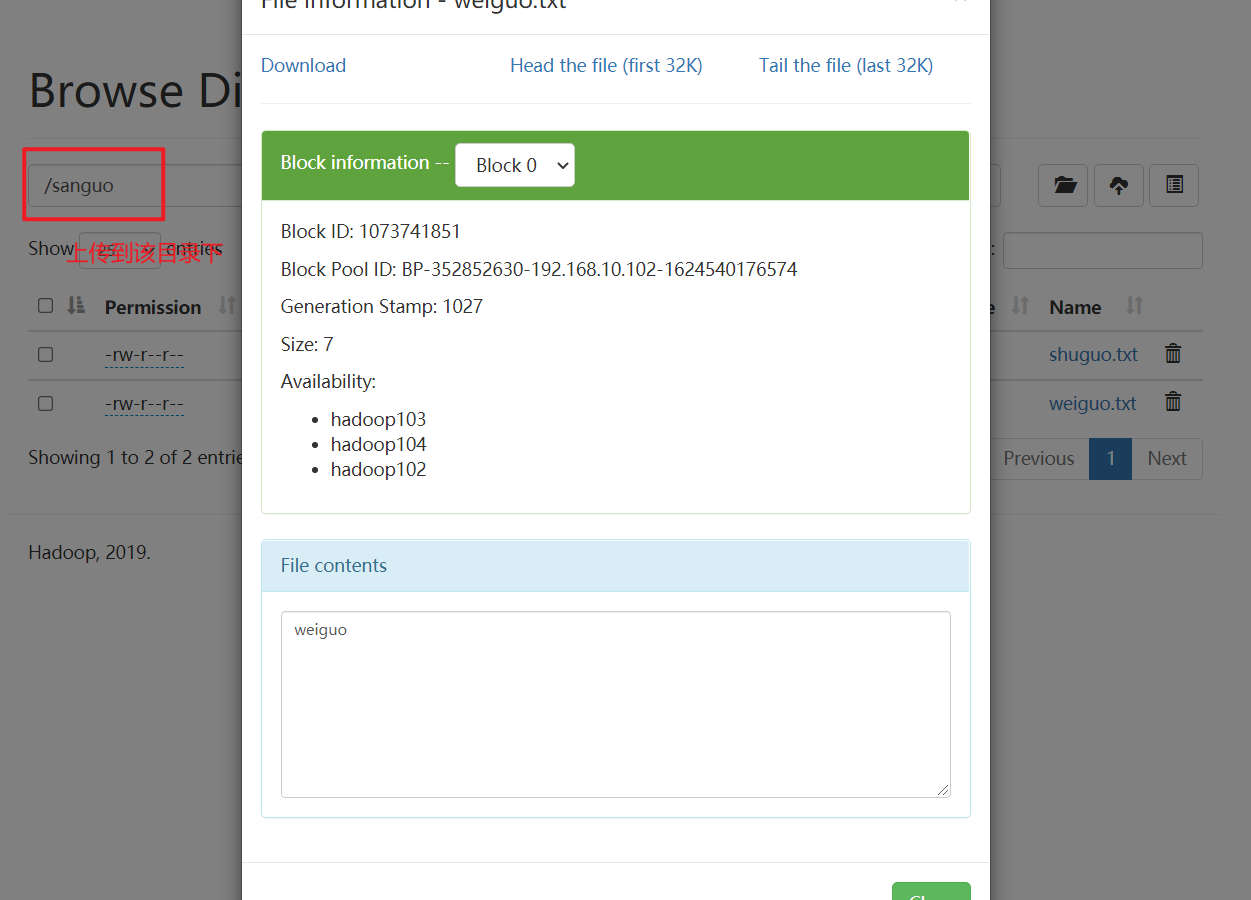

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -copyFromLocal weiguo.txt /sanguo

-put 拷贝 (常用)

等同于copyFromLocal,生产环境更习惯用put

基本语法:hadoop fs -put 原文件 上传路径

[ranan@hadoop102 hadoop-3.1.3]$ vim wuguo.txt

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -put wuguo.txt /sanguo

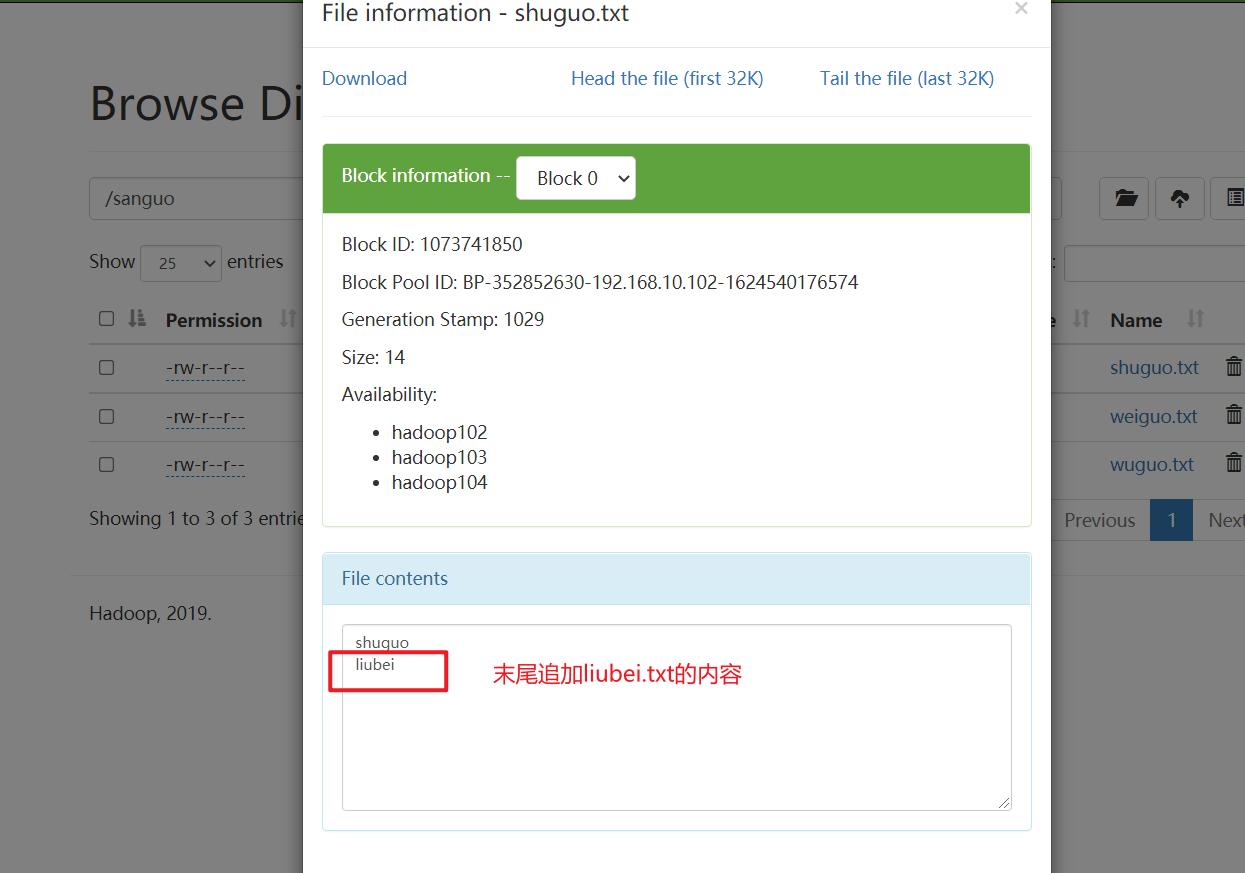

-appendToFile 追加

追加一个文件到已经存在的文件末尾

文件只能追加,不能修改

基本语法:hadoop fs -appendToFile 追加的文件 被追加的文件

[ranan@hadoop102 hadoop-3.1.3]$ vim liubei.txt

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -appendToFile liubei.txt /sanguo/shuguo.txt

下载

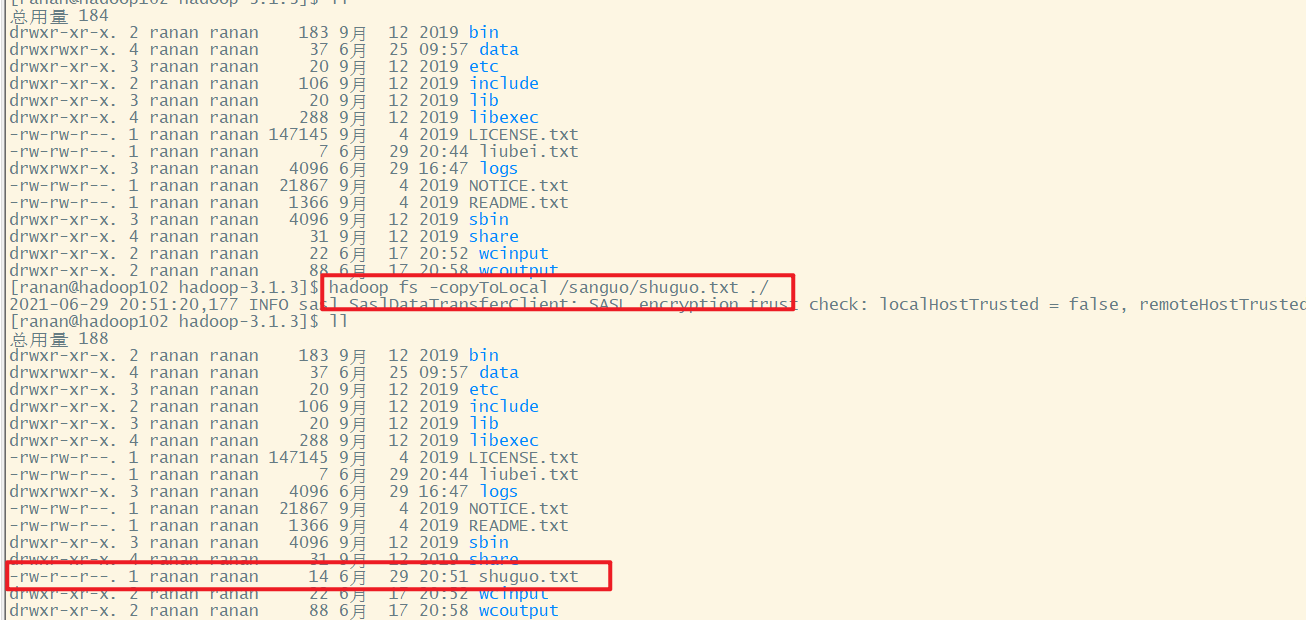

-copyToLocal 下载

从HDFS拷贝到本地

基本语法:hadoop fs -copyToLocal HDFS的路径 拷贝到本地的路径

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -copyToLocal /sanguo/shuguo.txt ./

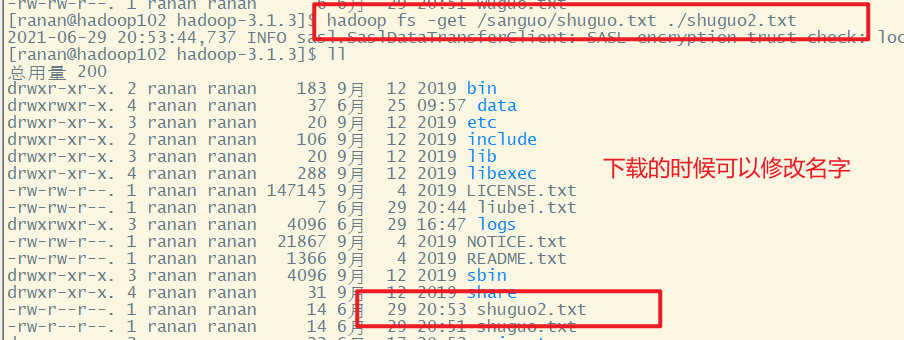

-get 下载

等同于copyToLocal,生产环境更习惯用get

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -get /sanguo/shuguo.txt ./shuguo2.txt

下载的时候可以改文件名

HDFS直接操作

基本使用于linux相同

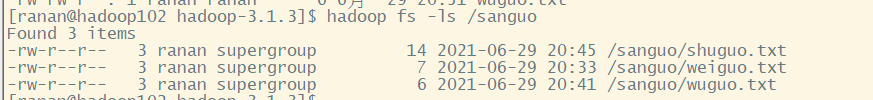

-ls 显示目录信息

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -ls /sanguo

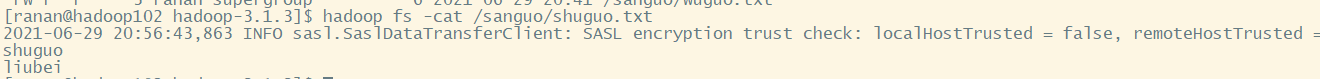

-cat 显示文件内容

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -cat /sanguo/shuguo.txt

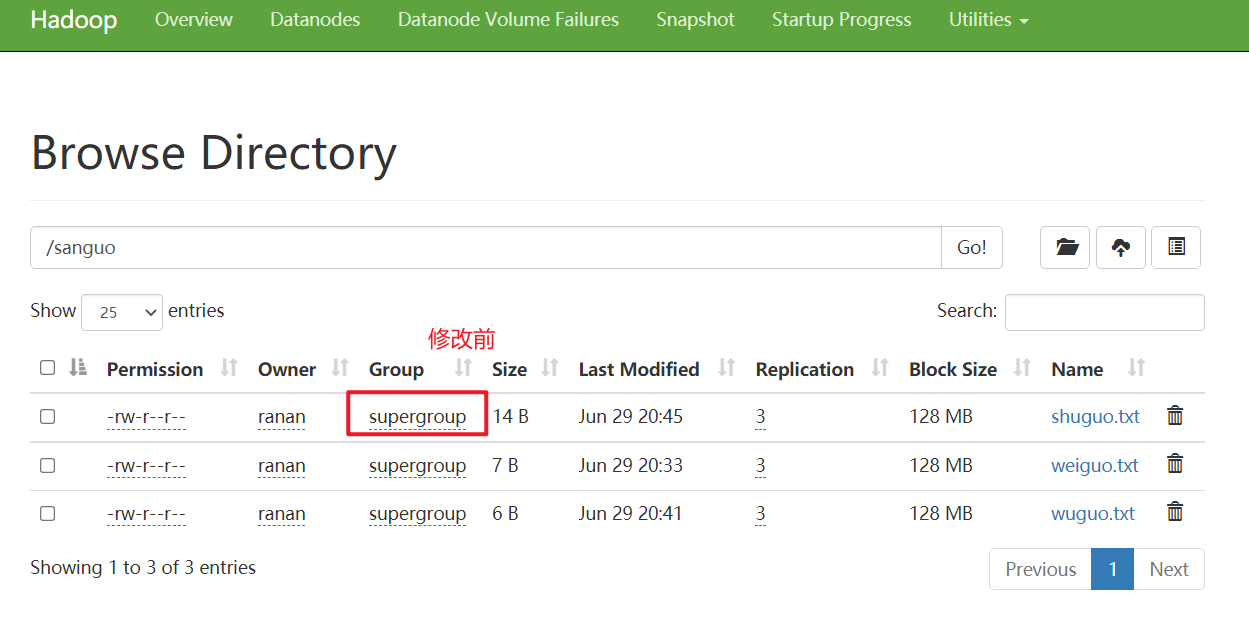

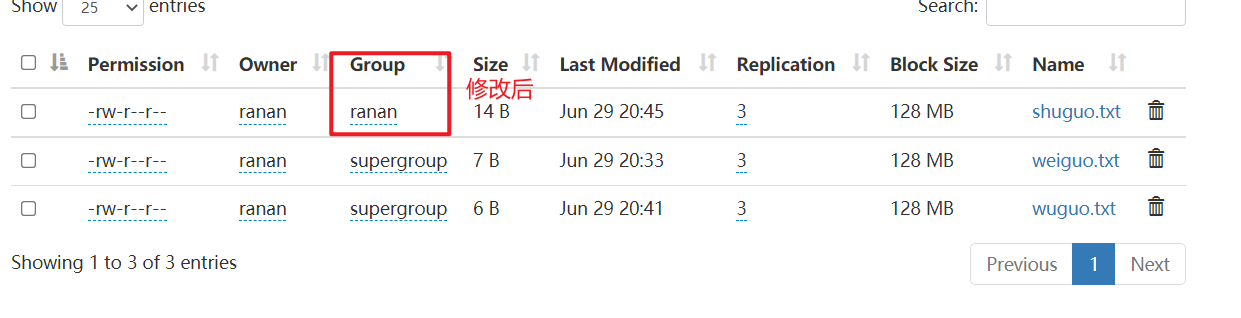

-chgrp/-chmod/-chown/ 修改文件所属权限

和Linux文件系统中的用法一样

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -chgrp ranan /sanguo/shuguo.txt

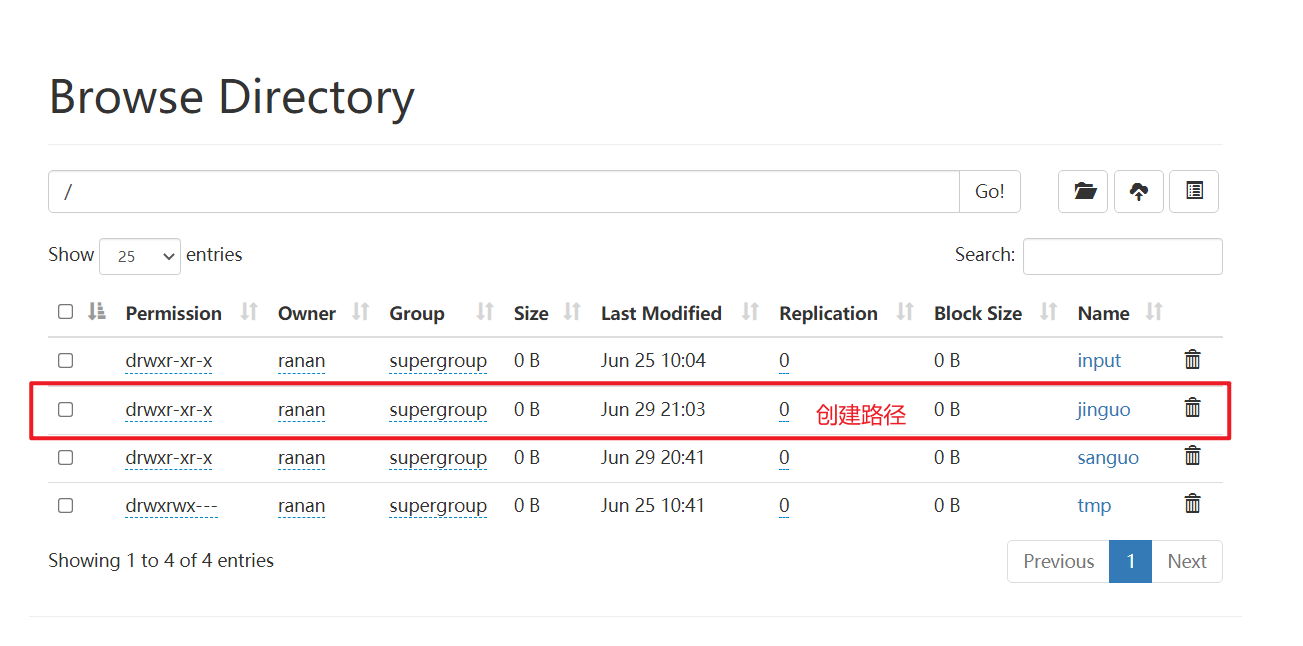

-mkdir 创建路径

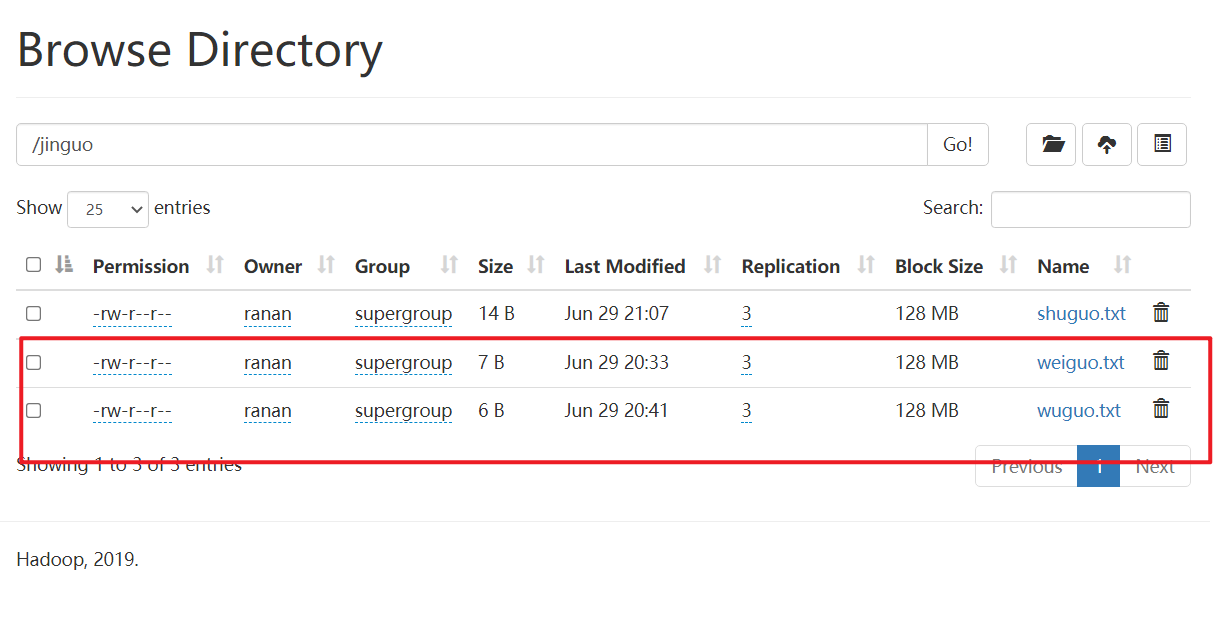

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -mkdir /jinguo

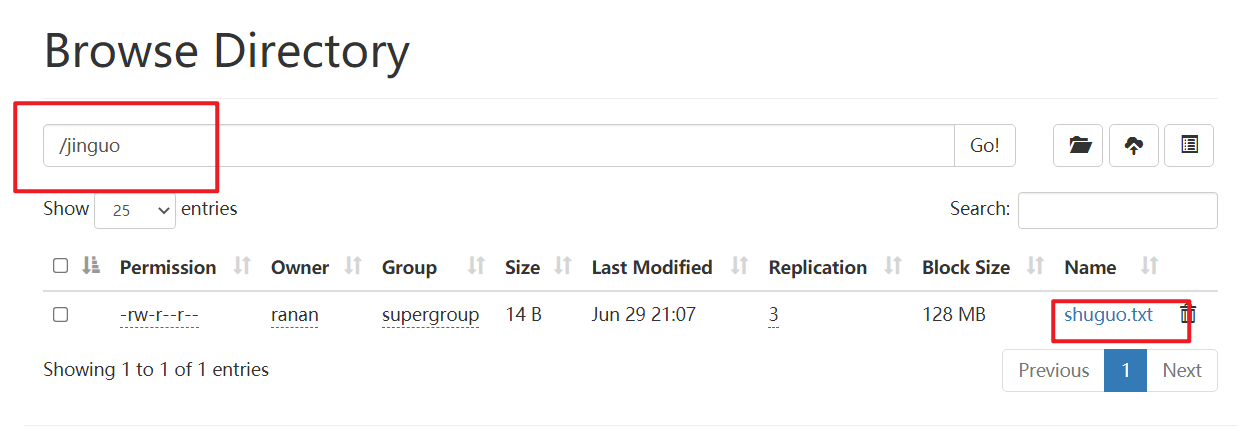

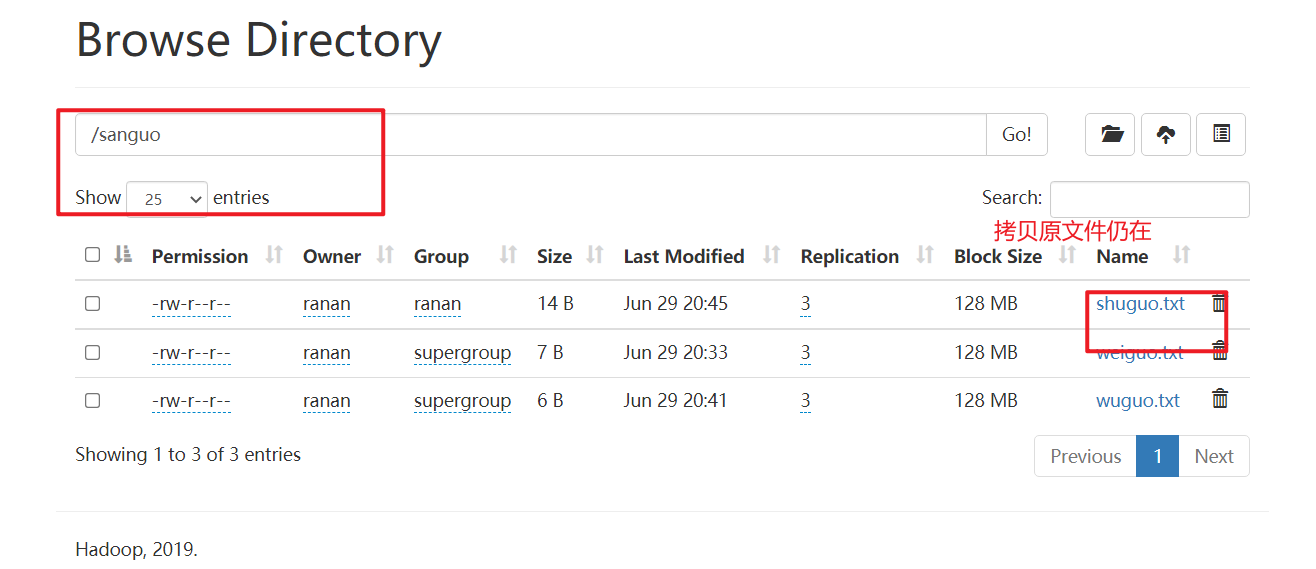

-cp HDFS中拷贝

将shuguo.txt拷贝到/jinguo

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -cp /sanguo/shuguo.txt /jinguo

-mv 在HDFS目录中移动文件

mv oldNameFile newNameFile(重命名)

mv 原目录 目标目录(移动剪切)

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -mv /sanguo/wuguo.txt /jinguo

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -mv /sanguo/weiguo.txt /jinguo

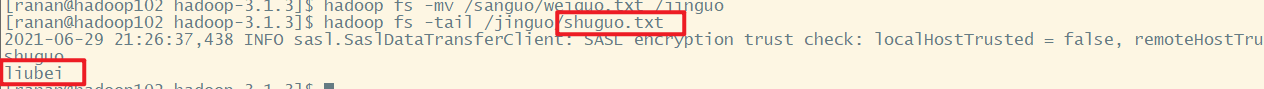

-tail 显示文件末尾的数据

显示文件末尾1kb的数据。因为只能追加修改,末尾的一般是最新的。

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -tail /jinguo/shuguo.txt

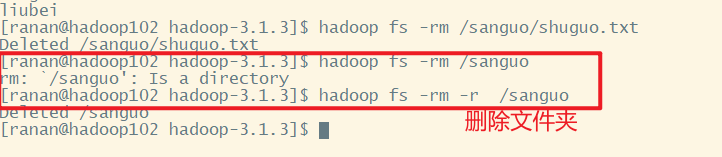

-rm 删除文件/文件夹

删除指令要注意使用

-rm 删除文件或文件夹

-rm -r 递归删除文件夹及文件夹里面的类容

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -rm /sanguo/shuguo.txt

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -rm -r /sanguo

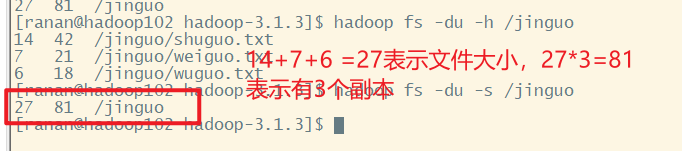

-du 统计文件夹的大小信息

-s 显示总共的

-h 显示具体的细节

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -du -s /jinguo

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -du -h /jinguo

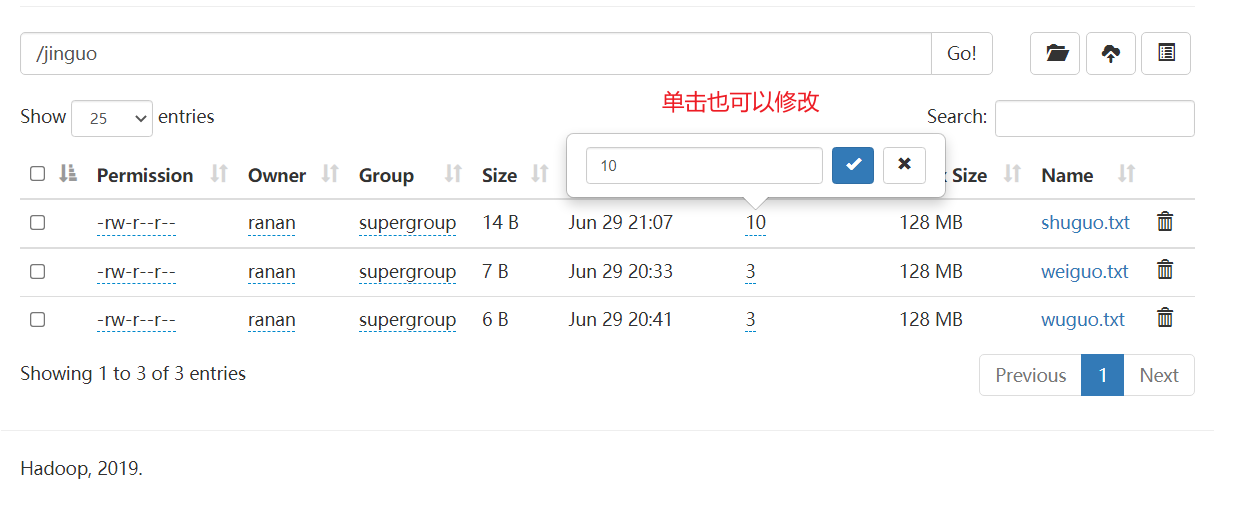

-setrep 设置HDFS中文件的副本数量

[ranan@hadoop102 hadoop-3.1.3]$ hadoop fs -setrep 10 /jinguo/shuguo.txt

但是我们只有三台服务器,实际还是只有3个副本。因为每台机器只能存储其一份副本

副本数会记录在 NameNode 的元数据中,如果后续增加服务器,会拷贝副本过去。

HDFS02 HDFS的Shell操作的更多相关文章

- Hadoop开发第6期---HDFS的shell操作

一.HDFS的shell命令简介 我们都知道HDFS 是存取数据的分布式文件系统,那么对HDFS 的操作,就是文件系统的基本操作,比如文件的创建.修改.删除.修改权限等,文件夹的创建.删除.重命名等. ...

- 大数据:Hadoop(JDK安装、HDFS伪分布式环境搭建、HDFS 的shell操作)

所有的内容都来源与 Hadoop 官方文档 一.Hadoop 伪分布式安装步骤 1)JDK安装 解压:tar -zxvf jdk-7u79-linux-x64.tar.gz -C ~/app 添加到系 ...

- Hadoop读书笔记(二)HDFS的shell操作

Hadoop读书笔记(一)Hadoop介绍:http://blog.csdn.net/caicongyang/article/details/39898629 1.shell操作 1.1全部的HDFS ...

- HDFS基本shell操作

在客户端输入Hadoop fs,可以查看所有的,hadoop shell # -help [cmd] //显示命令的帮助信息,如: hadoop fs -help ls # -ls(r) <pa ...

- HDFS的shell操作

bin/hadoop命令操作: namenode -format 格式化文件系统 fs(缩写:FileSystem) 运行一个文件系统的用户客户端 bin/hadoop fs常用命令操作: -ls h ...

- [HDFS_2] HDFS 的 Shell 操作

0. 说明 在 Shell 下完成对 HDFS 的增删改查操作 1. 在 Shell 下完成对 HDFS 的增删改查操作 [1.0 查看帮助] [centos@s101 ~]$ hdfs dfs -h ...

- Hadoop框架之HDFS的shell操作

既然HDFS是存取数据的分布式文件系统,那么对HDFS的操作,就是文件系统的基本操作,比如文件的创建.修改.删除.修改权限等,文件夹的创建.删除.重命名等.对HDFS的操作命令类似于Linux的she ...

- Hadoop HDFS的Shell操作实例

本文发表于本人博客. 我们知道HDFS是Hadoop的分布式文件系统,那既然是文件系统那最起码会有管理文件.文件夹之类的功能吧,这个类似我们的Windows操作系统一样的吧,创建.修改.删除.移动.复 ...

- 4 weekend110的hdfs&mapreduce测试 + hdfs的实现机制初始 + hdfs的shell操作 + 无密登陆配置

Hdfs是根/目录,windows是每一个盘符, 1 从Linux里传一个到,hdfs里去 2 从hdfs里下一个到,linux里去 想从hdfs里,下载到linux, 涨知识,记住,hdfs是建 ...

随机推荐

- 字符串与模式匹配算法(四):BM算法

一.BM算法介绍 BM算法(Boyer-Moore算法)是罗伯特·波义尔(Robert Boyer)和杰·摩尔(J·Moore)在1977年共同提出的.与KMP算法不同的是,BM算法是模式串P由左向右 ...

- Spark面试题整理(三)

1.为什么要进行序列化序列化? 可以减少数据的体积,减少存储空间,高效存储和传输数据,不好的是使用的时候要反序列化,非常消耗CPU. 2.Yarn中的container是由谁负责销毁的,在Hadoop ...

- Go并发编程--Mutex/RWMutex

目录 一.前言 二. Mutex 2.1 案例 三. 实现原理 3.1 锁的实现模式 3.2 Go Mutex 实现原理 3.2.1 加锁 3.2.2 解锁 四. 源码分析 4.1 Mutex基本结构 ...

- 面试官:JavaScript如何实现数组拍平(扁平化)方法?

面试官:JavaScript如何实现数组拍平(扁平化)方法? 1 什么叫数组拍平? 概念很简单,意思是将一个"多维"数组降维,比如: // 原数组是一个"三维" ...

- Jmeter二次开发实现自定义functions函数(九)

在Jmeter->选项->函数助手对话框中我们可以看到Jmeter内置的一些常用函数,但考虑到测试过程中的实际情况,我们经常需要在脚本引用或者实现自定义的函数.那么如何在"函数助 ...

- log4j日志集成

一.介绍 Log4j是Apache的一个开放源代码项目,通过使用Log4j,我们可以控制日志信息输送的目的地是控制台.文件.GUI组件.甚至是套接口服务 器.NT的事件记录器.UNIX Syslog ...

- Fiddler抓包工具简介:(二)下载安装及配置证书和代理

Fiddler下载安装及配置 一.安装过程: 下载官网:https://www.telerik.com/fiddler 安装过程:一路next即可 启动Fiddler:当你启动了Fiddler,程序将 ...

- uni-app视频组件设置圆角

无法实现,建议写个image在中间位置加个播放按钮,点击播放跳转新页面只需要在跳转参数里面把视频链接加上,在onLoad里面获取视频链接,自动播放视频,很多app目前都是这样做的,关闭页面后视频会自动 ...

- LeetCode 199. 二叉树的右视图 C++ 用时超100%

/** * Definition for a binary tree node. * struct TreeNode { * int val; * TreeNode *left; * TreeNode ...

- PLSQL批量执行SQL文件方法

当需要执行多个sql文件,或者某个脚本中,sql语句数量很多时,手动逐个逐条执行不是一个明智的选择. PLSQL为我们提供了便捷的工具.使用方式如下: [工具]--[导入表]--[SQL插入]--[选 ...