4.基于梯度的攻击——MIM

MIM攻击原论文地址——https://arxiv.org/pdf/1710.06081.pdf

1.MIM攻击的原理

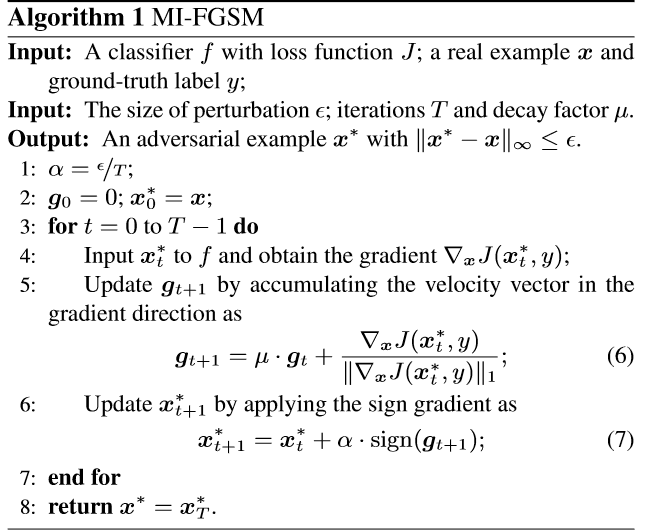

MIM攻击全称是 Momentum Iterative Method,其实这也是一种类似于PGD的基于梯度的迭代攻击算法。它的本质就是,在进行迭代的时候,每一轮的扰动不仅与当前的梯度方向有关,还与之前算出来的梯度方向相关。其中的衰减因子就是用来调节相关度的,decay_factor在(0,1)之间,decay_factor越小,那么迭代轮数靠前算出来的梯度对当前的梯度方向影响越小。其实仔细想想,这样做也很有道理,由于之前的梯度对后面的迭代也有影响,那么这使得,迭代的方向不会跑偏,使得总体的大方向是对的。到目前为止都是笔者对MIM比较感性的认识,下面贴出论文中比较学术的观点。

其实为了加速梯度下降,通过累积损失函数的梯度方向上的矢量,从而(1)稳定更新(2)有助于通过 narrow valleys, small humps and poor local minima or maxima.(专业名词不知道怎么翻译,可以脑补函数图像,大致意思就是,可以有效避免局部最优)

是decay_factor,另外,在原论文中,每一次迭代对x的导数是直接算的1-范数,然后求平均,但在各个算法库以及论文实现的补充中,并没有求平均,估计这个对结果影响不太大。

是decay_factor,另外,在原论文中,每一次迭代对x的导数是直接算的1-范数,然后求平均,但在各个算法库以及论文实现的补充中,并没有求平均,估计这个对结果影响不太大。

2.代码实现(直接把advertorch里的代码贴过来了)

class MomentumIterativeAttack(Attack, LabelMixin):

"""

The L-inf projected gradient descent attack (Dong et al. 2017).

The attack performs nb_iter steps of size eps_iter, while always staying

within eps from the initial point. The optimization is performed with

momentum.

Paper: https://arxiv.org/pdf/1710.06081.pdf

""" def __init__(

self, predict, loss_fn=None, eps=0.3, nb_iter=40, decay_factor=1.,

eps_iter=0.01, clip_min=0., clip_max=1., targeted=False):

"""

Create an instance of the MomentumIterativeAttack. :param predict: forward pass function.

:param loss_fn: loss function.

:param eps: maximum distortion.

:param nb_iter: number of iterations

:param decay_factor: momentum decay factor.

:param eps_iter: attack step size.

:param clip_min: mininum value per input dimension.

:param clip_max: maximum value per input dimension.

:param targeted: if the attack is targeted.

"""

super(MomentumIterativeAttack, self).__init__(

predict, loss_fn, clip_min, clip_max)

self.eps = eps

self.nb_iter = nb_iter

self.decay_factor = decay_factor

self.eps_iter = eps_iter

self.targeted = targeted

if self.loss_fn is None:

self.loss_fn = nn.CrossEntropyLoss(reduction="sum") def perturb(self, x, y=None):

"""

Given examples (x, y), returns their adversarial counterparts with

an attack length of eps. :param x: input tensor.

:param y: label tensor.

- if None and self.targeted=False, compute y as predicted

labels.

- if self.targeted=True, then y must be the targeted labels.

:return: tensor containing perturbed inputs.

"""

x, y = self._verify_and_process_inputs(x, y) delta = torch.zeros_like(x)

g = torch.zeros_like(x) delta = nn.Parameter(delta) for i in range(self.nb_iter): if delta.grad is not None:

delta.grad.detach_()

delta.grad.zero_() imgadv = x + delta

outputs = self.predict(imgadv)

loss = self.loss_fn(outputs, y)

if self.targeted:

loss = -loss

loss.backward() g = self.decay_factor * g + normalize_by_pnorm(

delta.grad.data, p=1)

# according to the paper it should be .sum(), but in their

# implementations (both cleverhans and the link from the paper)

# it is .mean(), but actually it shouldn't matter delta.data += self.eps_iter * torch.sign(g)

# delta.data += self.eps / self.nb_iter * torch.sign(g) delta.data = clamp(

delta.data, min=-self.eps, max=self.eps)

delta.data = clamp(

x + delta.data, min=self.clip_min, max=self.clip_max) - x rval = x + delta.data

return rval

个人觉得,advertorch中在迭代过程中,应该是对imgadv求导,而不是对delta求导,笔者查看了foolbox和cleverhans的实现,都是对每一轮的对抗样本求导,大家自己实现的时候可以改一下。

4.基于梯度的攻击——MIM的更多相关文章

- 3 基于梯度的攻击——MIM

MIM攻击原论文地址——https://arxiv.org/pdf/1710.06081.pdf 1.MIM攻击的原理 MIM攻击全称是 Momentum Iterative Method,其实这也是 ...

- 2.基于梯度的攻击——FGSM

FGSM原论文地址:https://arxiv.org/abs/1412.6572 1.FGSM的原理 FGSM的全称是Fast Gradient Sign Method(快速梯度下降法),在白盒环境 ...

- 1 基于梯度的攻击——FGSM

FGSM原论文地址:https://arxiv.org/abs/1412.6572 1.FGSM的原理 FGSM的全称是Fast Gradient Sign Method(快速梯度下降法),在白盒环境 ...

- 3.基于梯度的攻击——PGD

PGD攻击原论文地址——https://arxiv.org/pdf/1706.06083.pdf 1.PGD攻击的原理 PGD(Project Gradient Descent)攻击是一种迭代攻击,可 ...

- 2 基于梯度的攻击——PGD

PGD攻击原论文地址——https://arxiv.org/pdf/1706.06083.pdf 1.PGD攻击的原理 PGD(Project Gradient Descent)攻击是一种迭代攻击,可 ...

- 5.基于优化的攻击——CW

CW攻击原论文地址——https://arxiv.org/pdf/1608.04644.pdf 1.CW攻击的原理 CW攻击是一种基于优化的攻击,攻击的名称是两个作者的首字母.首先还是贴出攻击算法的公 ...

- 基于梯度场和Hessian特征值分别获得图像的方向场

一.我们想要求的方向场的定义为: 对于任意一点(x,y),该点的方向可以定义为其所在脊线(或谷线)位置的切线方向与水平轴之间的夹角: 将一条直线顺时针或逆时针旋转 180°,直线的方向保持不变. 因 ...

- 4 基于优化的攻击——CW

CW攻击原论文地址——https://arxiv.org/pdf/1608.04644.pdf 1.CW攻击的原理 CW攻击是一种基于优化的攻击,攻击的名称是两个作者的首字母.首先还是贴出攻击算法的公 ...

- C / C ++ 基于梯度下降法的线性回归法(适用于机器学习)

写在前面的话: 在第一学期做项目的时候用到过相应的知识,觉得挺有趣的,就记录整理了下来,基于C/C++语言 原贴地址:https://helloacm.com/cc-linear-regression ...

随机推荐

- Django------多表操作

一. 创建模型 实例:我们来假定下面这些概念,字段和关系 作者模型:一个作者有姓名和年龄. 作者详细模型:把作者的详情放到详情表,包含生日,手机号,家庭住址等信息.作者详情模型和作者模型之间是一对一的 ...

- 2.3 os 模块

目录 2.3.1 功能 2.3.2 常用方法 2.3.2.1 创建相关 2.3.2.2 切换相关 2.3.2.3 查看相关 2.3.2.4 编辑相关 2.3.2.5 删除相关 2.3.1 功能 2.3 ...

- CodeForces666E Forensic Examination

题目描述 给你一个串S以及一个字符串数组T[1..m],q次询问,每次问S的子串S[pl..pr]在T[l..r]中的哪个串里的出现次数最多,并输出出现次数. 如有多解输出最靠前的那一个. 题解 ...

- 柳叶刀重磅出击!全外显子测序在胎儿结构异常的评估Whole-exome sequencing in the evaluation of fetal structural anomalies: a prospective cohort study

柳叶刀发表的文献解读:Whole-exome sequencing in the evaluation of fetal structural anomalies: a prospective coh ...

- input输入框自动获取焦点

只要在该input标签后添加autofocus="autofocus"即可 代码实例: <html> <head></head> <bod ...

- 第五节:WebApi的三大过滤器

一. 基本说明 1. 简介: WebApi下的过滤器和MVC下的过滤器有一些区别,首先我们要注意的是通常建WebApi项目时,会自动把MVC的程序集也引入进来,所以我们在使用WebApi下的过滤器的 ...

- 原生js封装cookie获取、设置及删除

使用cookie(key,value,options) 参数key,value,options(可选) function cookie(key,value,options){ if(typeof va ...

- KL散度

摘自: https://www.jianshu.com/p/43318a3dc715?from=timeline&isappinstalled=0 一.解决的问题 量化两种概率分布P和Q可以使 ...

- 一篇文让你看懂NB-IoT、LoRa、eMTC、Sigfox及ZigBee的应用场景【转】

转自:https://blog.csdn.net/nicholas_dlut/article/details/81051269

- 【easy】263. Ugly Number 判断丑数

class Solution { public: bool isUgly(int num) { ) return false; ) return true; && num % == ) ...