spark复习笔记(3)

在windows上实现wordcount单词统计

一、编写scala程序,引入spark类库,完成wordcount

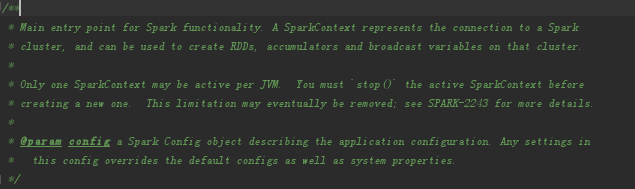

1.sparkcontextAPI

sparkcontext是spark功能的主要入口点,代表着到spark集群的连接,可用于在这些集群上创建RDD(弹性分布式数据集),累加器和广播变量。在每一个JVM上面只允许一个活跃的sparkcontext。在创建一个新的RDD之前,你应该停止这个活跃的SparkContext

2.sparkconf配置对象

sparkconf是对spark应用的配置,用来设置键值对的各种spark参数。大多数的时候,你需要通过new sparkconf的方式来创建一个对象,会从任何的spark系统属性中记性加载,从这个方面来讲,你在sparkconf上设置的参数会直接影响你在整个系统属性中的优先级

3.scala版单词统计:wordCount

import org.apache.spark.SparkContext

import org.apache.spark.SparkConf

object WordCount {

def main(args: Array[String]): Unit = {

//创建spark配置对象

val conf = new SparkConf();

//设置app名字

conf.setAppName("WordConf")

//创建master

conf.setMaster("local");

//创建spark上下文对象

val sc = new SparkContext(conf);

//加载文本文件

val rdd1 = sc.textFile("E:\\studyFile\\data\\test.txt")

//对rdd1中的对象压扁

val rdd2 = rdd1.flatMap(line=>line.split(" "))

//映射w=>(w,1)

val rdd3 = rdd2.map((_,))

val rdd4 = rdd3.reduceByKey(_ + _)

val r= rdd4.collect()

//遍历打印

r.foreach(println)

}

}

3.java版单词统计:wordCount

import org.apache.spark.SparkConf;

import org.apache.spark.api.java.JavaPairRDD;

import org.apache.spark.api.java.JavaRDD;

import org.apache.spark.api.java.JavaSparkContext;

import org.apache.spark.api.java.function.FlatMapFunction;

import org.apache.spark.api.java.function.Function2;

import org.apache.spark.api.java.function.PairFunction;

import scala.Tuple2; import java.util.ArrayList;

import java.util.Iterator;

import java.util.List; public class WordCountJava2 {

//创建conf对象

public static void main(String[] args){

SparkConf conf = new SparkConf();

conf.setAppName("WordCountJava2");

conf.setMaster("local");

//创建java版的sparkContext上下文对象

JavaSparkContext sc = new JavaSparkContext(conf);

JavaRDD<String> rdd1=sc.textFile("E:/studyFile/data/test.txt");

//先将单词压扁

JavaRDD<String> rdd2 = rdd1.flatMap(new FlatMapFunction<String, String>() {

//迭代的方法

public Iterator<String> call(String s) throws Exception {

List<String> list = new ArrayList<String>();

String[] arr = s.split(" ");

for(String ss:arr){

list.add(ss);

}

return list.iterator();

}

});

//映射,将单词映射为:word===>(word,1)

JavaPairRDD<String,Integer> rdd3=rdd2.mapToPair(new PairFunction<String, String, Integer>() { public Tuple2<String, Integer> call(String s) throws Exception {

return new Tuple2<String, Integer>(s,);

}

});

JavaPairRDD<String,Integer> rdd4 = rdd3.reduceByKey(new Function2<Integer, Integer, Integer>() {

public Integer call(Integer v1, Integer v2) throws Exception {

//函数捏合的过程

return v1+v2;

}

});

List<Tuple2<String,Integer>> list=rdd4.collect();

for(Tuple2<String,Integer> t :list){

System.out.println(t._1+":"+t._2);

}

}

}

4.提交作业到完全分布式spark集群上来运行

1)到处jar包

2)spark-submit --master local --name WordCount --class com.jd.spark.scala.WordCountDemoScala spark-daemon1-1.0-SNAPSHOT.jar /home/centos/test.txt

5.提交作业到完全分布式spark集群上来运行(只需要hdfs)

1)需要启动hadoop集群

$>start-dfs.sh

2)put文件到hdfs

hdfs dfs -put test.txt /user/centos/hadoop/

2)spark-submit提交命令运行job

$>spark-submit --master spark://s11:7070 --name WordCount --class com.jd.spark.scala.WordCountDemoScala spark-daemon1-1.0-SNAPSHOT.jar hdfs://s11:8020/user/centos/hadoop/test.txt

spark复习笔记(3)的更多相关文章

- spark复习笔记(1)

使用spark实现work count ---------------------------------------------------- (1)用sc.textFile(" &quo ...

- spark复习笔记(7):sparkstreaming

一.介绍 1.sparkStreaming是核心模块Spark API的扩展,具有可伸缩,高吞吐量以及容错的实时数据流处理等.数据可以从许多来源(如Kafka,Flume,Kinesis或TCP套接字 ...

- spark复习笔记(7):sparkSQL

一.saprkSQL模块,使用类sql的方式访问Hadoop,实现mr计算,底层使用的是rdd 1.hive //hadoop mr sql 2.phenoix //hbase上构建sql的交互过 ...

- spark复习笔记(6):RDD持久化

在spark中最重要的功能之一是跨操作在内存中持久化数据集.当你持久化一个RDD的时候,每个节点都存放了一个它在内存中计算的一个分区,并在该数据集的其他操作中进行重用,持久化一个RDD的时候,节点上的 ...

- spark复习笔记(6):数据倾斜

一.数据倾斜 spark数据倾斜,map阶段对key进行重新划分.大量的数据在经过hash计算之后,进入到相同的分区中,zao

- spark复习笔记(4):RDD变换

一.RDD变换 1.返回执行新的rdd的指针,在rdd之间创建依赖关系.每个rdd都有一个计算函数和指向父rdd的指针 Spark是惰性的,因此除非调用某个转换或动作,否则不会执行任何操作,否则将触发 ...

- spark复习笔记(5):API分析

0.spark是基于hadoop的mr模型,扩展了MR,高效实用MR模型,内存型集群计算,提高了app处理速度. 1.特点:(1)在内存中存储中间结果 (2)支持多种语言:java scala pyt ...

- spark复习笔记(4):spark脚本分析

1.[start-all.sh] #!/usr/bin/env bash # # Licensed to the Apache Software Foundation (ASF) under one ...

- spark复习笔记(3):使用spark实现单词统计

wordcount是spark入门级的demo,不难但是很有趣.接下来我用命令行.scala.Java和python这三种语言来实现单词统计. 一.使用命令行实现单词的统计 1.首先touch一个a. ...

随机推荐

- npm cache clean --force

当出现这个问题时npm ERR! Unexpected end of JSON input while parsing near '...,"dist":{"shasum ...

- Quantitative Strategies for Achieving Alpha(一)

1. 怎么构建测试 所有的测试五等分,表明我们的回测的universe被分为五个组,根据我们要测试的公司因子的值. Quintiles provide a clear answer to that q ...

- Spring AOP expose-proxy

写在前面 expose-proxy.为是否暴露当前代理对象为ThreadLocal模式. SpringAOP对于最外层的函数只拦截public方法,不拦截protected和private方法(后续讲 ...

- vs 2010创建Windows服务定时timer程序

vs 2010创建Windows服务定时timer程序: 版权声明:本文为搜集借鉴各类文章的原创文章,转载请注明出处: http://www.cnblogs.com/2186009311CFF/p/ ...

- 理解厂商前缀 -webkit- / -moz- / -ms- / -o-

CSS3规范如果想要达到W3C的推荐标准状态还需要不断改进.浏览器则通常在W3C开发标准的过程中就会体现这些特性.这样,标准在最终敲定之前就能知道哪些地方还能进一步改进. 在包含某个特性的的初始阶段, ...

- python multiprocessing pool

python 本身是不是单线程这个我真心搞不懂 但是我是来吐槽的: multiprocessing.Pool(precesses = 2) 这个语句曾经让我的内存爆满,死机不解释. 在重装 pytho ...

- HDU-6709 Fishing Master

Description Heard that eom is a fishing MASTER, you want to acknowledge him as your mentor. As every ...

- linux-解决添加的网卡无法识别的问题

添加网卡之后,网卡无法被正确的识别和使用排错方法 查看/etc/udev/rules.d/70-persistent-net.rules的内容,该文件中可以查看到新添加的网卡的MAC地址 修改/etc ...

- ASYNC_NETWORK_IO等待事件和调优

测试反应测试数据库整体出现hang的情况,检查对应的等待事件,发现大量的resource_semaphore等待事件, 查看内存占用情况: SELECT * FROM sys.dm_exe ...

- cookie格式化

#coding=utf- import requests url = 'http://www.baidu.com' f=open(r'cookies.txt','r') cookies={} for ...