爬取猫眼电影TOP100

本文所讲的爬虫项目实战属于基础、入门级别,使用的是Python3.5实现的。

本项目基本目标:在猫眼电影中把top100的电影名,排名,海报,主演,上映时间,评分等爬取下来

爬虫原理和步骤

爬虫,就是从网页中爬取自己所需要的东西,如文字、图片、视频等,这样我们就需要读取网页,然后获取网页源代码,从源代码中用正则表达式进行匹配,把匹配成功的信息存入相关文档中。这就是爬虫的简单原理。

操作步骤:

1.确定抓取的数据字段(排名,海报,电影名,主演,上映时间,评分)

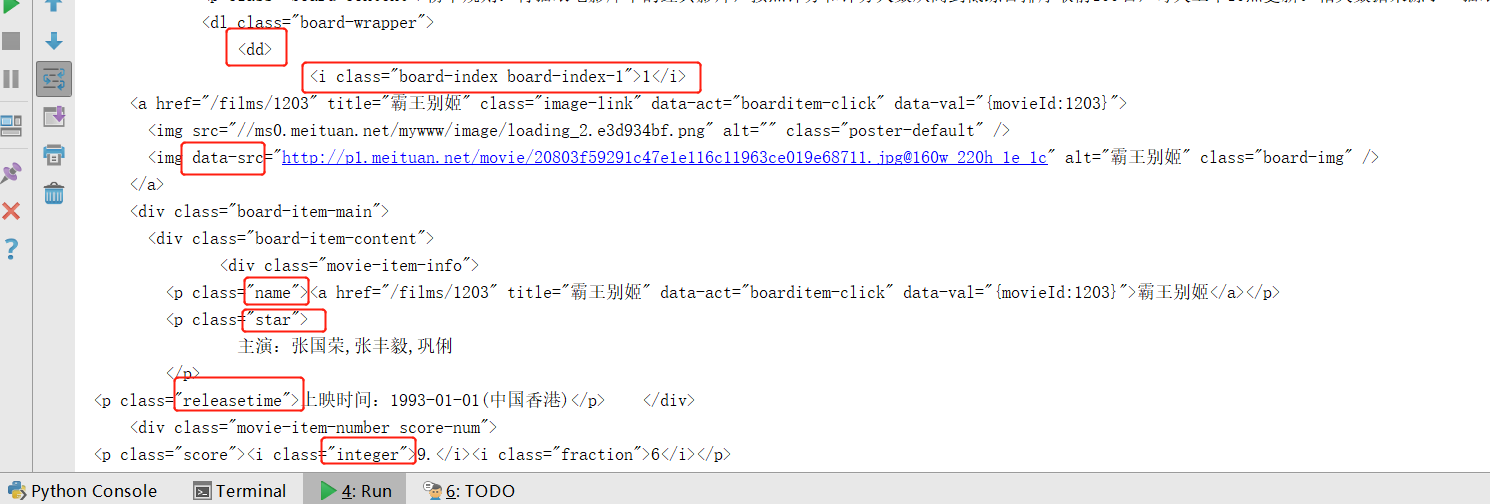

2.分析页面html标签结构,找到数据所在位置

3.选择实现方法及数据存储位置(存在在mysql 数据库中)

4.代码写入(requests+re+pymysql)

5.代码调试

确定抓取的页面目标URL:http://maoyan.com/board/4

1.导入库/模块

import re

import requests

import pymysql

from requests.exceptions import RequestException #捕获异常

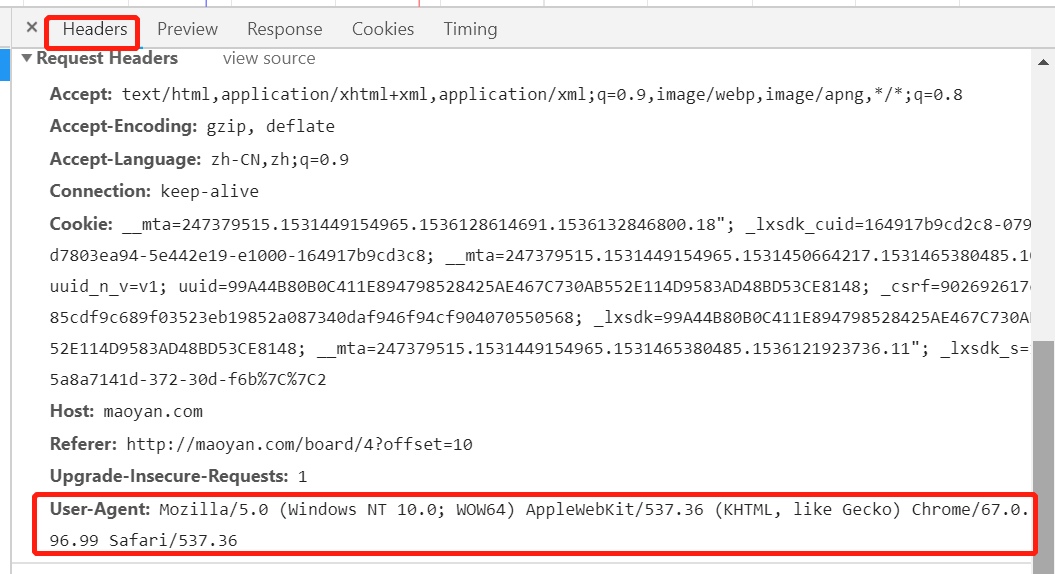

2.请求头域,在网页中查看headers,复制User-Agent内容

请求一个单页内容拿到HTML,定义函数,构建headers,请求成功则代码为200,否则失败重新写入代码

def get_one_page(url):

try:

#构建headers

headers={'User-Agent':'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/67.0.3396.99 Safari/537.36'}

response=requests.get(url,headers=headers)

if response.status_code==200:

return response.text

except RequestException:

return '请求异常'

3.解析HTML,用正则表达式匹配字符,为非贪婪模式.*?匹配

def parse_one_page(html):

# 创建一个正则表达式对象

#使用re.S可以使元字符.匹配到换行符

pattern=re.compile('<dd>.*?board-index.*?>(\d+)</i>.*?data-src="(.*?)".*?name">'

+ '<a.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>'

+ '.*?integer">(.*?)</i>.*?fraction">(.*?)</i>.*?</dd>', re.S)

items = re.findall(pattern, html)

# print(items)

运行已经匹配好的第一页内容

运行结果没有处理的如下:

4.进行数据处理,格式美化,按字段依次排列,去掉不必要的空格符

for item in items:

yield {

'index': item[0],

'image': item[1],

'title': item[2],

'actor': item[3].strip()[3:], # strip():删除前后空白

'time': item[4].strip()[5:],

'score': item[5] + item[6]

}

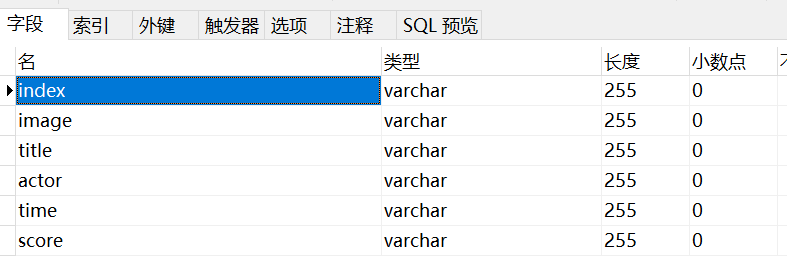

5.创建MySQL数据库,库名movie1表名maoyan,添加我们爬取的6个字段名

6.在python中创建数据库连接,把爬取的数据存储到MySQL

def write_to_mysql(content):

conn=pymysql.connect(host='localhost',user='root',passwd='',

db='movie1',charset='utf8')

cursor=conn.cursor()

index=content['index']

image=content['image']

title=content['title']

actor=content['actor']

time=content['time']

score=content['score']

sql='insert into maoyan values(%s,%s,%s,%s,%s,%s)'

parm=(index,image,title,actor,time,score)

cursor.execute(sql,parm)

conn.commit()

cursor.close()

conn.close()

调用主函数,运行后得到结果如下:

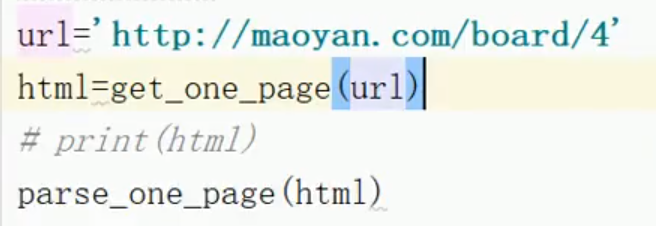

以上为调取的一页数据,只有TOP10的电影排名,如果需要得到TOP100,则要重新得到URL来构建

第一页的URL为:http://maoyan.com/board/4

第二页的URL为:http://maoyan.com/board/4?offset=10

第三页的URL为:http://maoyan.com/board/4?offset=20

得到页面都是以10来递增URL为:

url='http://maoyan.com/board/4?offset='+str(offset)

需要循环10次即可得到排名前100的电影,并把它写入到数据库中

def main(offset):

url='http://maoyan.com/board/4?offset='+str(offset)

html=get_one_page(url)

for item in parse_one_page(html):

print(item)

write_to_mysql(item) if __name__=='__main__':

for i in range(0,10):

main(i*10)

运行后进入MySQL查看写入的数据

以上是爬取猫眼top100完整代码,如有错误请多指教。

爬取猫眼电影TOP100的更多相关文章

- 爬虫系列(1)-----python爬取猫眼电影top100榜

对于Python初学者来说,爬虫技能是应该是最好入门,也是最能够有让自己有成就感的,今天在整理代码时,整理了一下之前自己学习爬虫的一些代码,今天先上一个简单的例子,手把手教你入门Python爬虫,爬取 ...

- 50 行代码教你爬取猫眼电影 TOP100 榜所有信息

对于Python初学者来说,爬虫技能是应该是最好入门,也是最能够有让自己有成就感的,今天,恋习Python的手把手系列,手把手教你入门Python爬虫,爬取猫眼电影TOP100榜信息,将涉及到基础爬虫 ...

- 40行代码爬取猫眼电影TOP100榜所有信息

主要内容: 一.基础爬虫框架的三大模块 二.完整代码解析及效果展示 1️⃣ 基础爬虫框架的三大模块 1.HTML下载器:利用requests模块下载HTML网页. 2.HTML解析器:利用re正则表 ...

- 用requests库爬取猫眼电影Top100

这里需要注意一下,在爬取猫眼电影Top100时,网站设置了反爬虫机制,因此需要在requests库的get方法中添加headers,伪装成浏览器进行爬取 import requests from re ...

- PYTHON 爬虫笔记八:利用Requests+正则表达式爬取猫眼电影top100(实战项目一)

利用Requests+正则表达式爬取猫眼电影top100 目标站点分析 流程框架 爬虫实战 使用requests库获取top100首页: import requests def get_one_pag ...

- python 爬取猫眼电影top100数据

最近有爬虫相关的需求,所以上B站找了个视频(链接在文末)看了一下,做了一个小程序出来,大体上没有修改,只是在最后的存储上,由txt换成了excel. 简要需求:爬虫爬取 猫眼电影TOP100榜单 数据 ...

- # [爬虫Demo] pyquery+csv爬取猫眼电影top100

目录 [爬虫Demo] pyquery+csv爬取猫眼电影top100 站点分析 代码君 [爬虫Demo] pyquery+csv爬取猫眼电影top100 站点分析 https://maoyan.co ...

- # 爬虫连载系列(1)--爬取猫眼电影Top100

前言 学习python有一段时间了,之前一直忙于学习数据分析,耽搁了原本计划的博客更新.趁着这段空闲时间,打算开始更新一个爬虫系列.内容大致包括:使用正则表达式.xpath.BeautifulSoup ...

- python应用-爬取猫眼电影top100

import requests import re import json import time from requests.exceptions import RequestException d ...

- Python爬虫项目--爬取猫眼电影Top100榜

本次抓取猫眼电影Top100榜所用到的知识点: 1. python requests库 2. 正则表达式 3. csv模块 4. 多进程 正文 目标站点分析 通过对目标站点的分析, 来确定网页结构, ...

随机推荐

- html-display标签

标签可以分为行内标签和行间块级标签, 块级标签:占一行,如果父标签没有限高度,子标签会自动扩展父标签的高度,行内标签不能, 可以设置宽度 高度 padding margin 行内标签: 不能设置 ...

- Spring cloud和Dubbo

dubbo由于是二进制的传输,占用带宽会更少springCloud是http协议传输,带宽会比较多,同时使用http协议一般会使用JSON报文,消耗会更大 dubbo的开发难度较大,原因是dubbo的 ...

- jquery 中prop和 attr

prop就是给html中元素固有的属性赋值 而attr是给元素定义新的属性值.

- 找不到 EntityType “ ” 的映射和元数据信息。

意思是: 数据库里边有添加的新字段DB1,而程序中的的实体即“元数据”中没有这个新字段Et1,由于EntityFramework更新模型时已自动默认对DB1和Et1进行了映射(默认认为实体中存在这个字 ...

- ALGO-151_蓝桥杯_算法训练_6-2递归求二进制表示位数

记: 进制转换 AC代码: #include <stdio.h> #define K 2 int main(void) { ; scanf("%d",&n); ...

- 【Linux】使用fsck对磁盘进行修复

在后台执行 磁盘修复 nohup fsck.ext3 -y /dev/sdb1 > /root/fsck.log 2>&1 & 使用nohup和& 让进程在后台执行 ...

- Dubbo(3)Dubbo admin管理控制台

dubbo-admin管理控制台: 可以管理服务,消费,以及其他配置: 在dubbo项目的zip包中有个demo-admin项目,可以打成war包,发布到tomcat运行里面: 我这里将dubbo-a ...

- docker entrypoint入口文件详解

docker entrypoint入口文件详解 pasting Dockerfile创建自定义Docker镜像以及CMD与ENTRYPOINT指令的比较 [k8s]args指令案例-彻底理解docke ...

- 理一下docker在各平台上的运行机制

理一下docker在各平台上的运行机制 首先,从内核共享与否 docker在linux上共享内核,无需虚拟化,完全支持native功能(https://docs.docker.com/engine/i ...

- SEO 图片用IMG插入好还是用Background定义好?

主要的区别就是,background搜索引擎室不知道图片内容说什么的.而img,是可以通过alt标签向搜索引擎描述你图片的内容.所以如果这张图片对你网站内容有帮助,那最好用img,如果没有什么用处的话 ...