英伟达CUVID硬解,并通过FFmpeg读取文件

虽然FFmpeg本身有cuvid硬解,但是找不到什么好的资料,英伟达的SDK比较容易懂,参考FFmpeg源码,将NVIDIA VIDEO CODEC SDK的数据获取改为FFmpeg获取,弥补原生SDK不能以流作为数据源的不足。所用SDK版本为Video_Codec_SDK_7.1.9,英伟达官网可下载。

1.修改数据源

首先是FFmpeg的一些常规的初始化

bool VideoSource::init(const std::string sFileName, FrameQueue *pFrameQueue)

{

assert(0 != pFrameQueue);

oSourceData_.hVideoParser = 0;

oSourceData_.pFrameQueue = pFrameQueue; int i;

AVCodec *pCodec; av_register_all();

avformat_network_init();

pFormatCtx = avformat_alloc_context(); if (avformat_open_input(&pFormatCtx, sFileName.c_str(), NULL, NULL) != 0){

printf("Couldn't open input stream.\n");

return false;

}

if (avformat_find_stream_info(pFormatCtx, NULL)<0){

printf("Couldn't find stream information.\n");

return false;

}

videoindex = -1;

for (i = 0; i<pFormatCtx->nb_streams; i++)

if (pFormatCtx->streams[i]->codec->codec_type == AVMEDIA_TYPE_VIDEO){

videoindex = i;

break;

} if (videoindex == -1){

printf("Didn't find a video stream.\n");

return false;

} pCodecCtx = pFormatCtx->streams[videoindex]->codec; pCodec = avcodec_find_decoder(pCodecCtx->codec_id);

if (pCodec == NULL){

printf("Codec not found.\n");

return false;

} //Output Info-----------------------------

printf("--------------- File Information ----------------\n");

av_dump_format(pFormatCtx, 0, sFileName.c_str(), 0);

printf("-------------------------------------------------\n"); memset(&g_stFormat, 0, sizeof(CUVIDEOFORMAT)); switch (pCodecCtx->codec_id) {

case AV_CODEC_ID_H263:

g_stFormat.codec = cudaVideoCodec_MPEG4;

break; case AV_CODEC_ID_H264:

g_stFormat.codec = cudaVideoCodec_H264;

break; case AV_CODEC_ID_HEVC:

g_stFormat.codec = cudaVideoCodec_HEVC;

break; case AV_CODEC_ID_MJPEG:

g_stFormat.codec = cudaVideoCodec_JPEG;

break; case AV_CODEC_ID_MPEG1VIDEO:

g_stFormat.codec = cudaVideoCodec_MPEG1;

break; case AV_CODEC_ID_MPEG2VIDEO:

g_stFormat.codec = cudaVideoCodec_MPEG2;

break; case AV_CODEC_ID_MPEG4:

g_stFormat.codec = cudaVideoCodec_MPEG4;

break; case AV_CODEC_ID_VP8:

g_stFormat.codec = cudaVideoCodec_VP8;

break; case AV_CODEC_ID_VP9:

g_stFormat.codec = cudaVideoCodec_VP9;

break; case AV_CODEC_ID_VC1:

g_stFormat.codec = cudaVideoCodec_VC1;

break;

default:

return false;

} //这个地方的FFmoeg与cuvid的对应关系不是很确定,不过用这个参数似乎最靠谱

switch (pCodecCtx->sw_pix_fmt)

{

case AV_PIX_FMT_YUV420P:

g_stFormat.chroma_format = cudaVideoChromaFormat_420;

break;

case AV_PIX_FMT_YUV422P:

g_stFormat.chroma_format = cudaVideoChromaFormat_422;

break;

case AV_PIX_FMT_YUV444P:

g_stFormat.chroma_format = cudaVideoChromaFormat_444;

break;

default:

g_stFormat.chroma_format = cudaVideoChromaFormat_420;

break;

} //找了好久,总算是找到了FFmpeg中标识场格式和帧格式的标识位

//场格式是隔行扫描的,需要做去隔行处理

switch (pCodecCtx->field_order)

{

case AV_FIELD_PROGRESSIVE:

case AV_FIELD_UNKNOWN:

g_stFormat.progressive_sequence = true;

break;

default:

g_stFormat.progressive_sequence = false;

break;

} pCodecCtx->thread_safe_callbacks = 1; g_stFormat.coded_width = pCodecCtx->coded_width;

g_stFormat.coded_height = pCodecCtx->coded_height; g_stFormat.display_area.right = pCodecCtx->width;

g_stFormat.display_area.left = 0;

g_stFormat.display_area.bottom = pCodecCtx->height;

g_stFormat.display_area.top = 0; if (pCodecCtx->codec_id == AV_CODEC_ID_H264 || pCodecCtx->codec_id == AV_CODEC_ID_HEVC) {

if (pCodecCtx->codec_id == AV_CODEC_ID_H264)

h264bsfc = av_bitstream_filter_init("h264_mp4toannexb");

else

h264bsfc = av_bitstream_filter_init("hevc_mp4toannexb");

} return true;

}

这里面非常重要的一段代码是

if (pCodecCtx->codec_id == AV_CODEC_ID_H264 || pCodecCtx->codec_id == AV_CODEC_ID_HEVC) {

if (pCodecCtx->codec_id == AV_CODEC_ID_H264)

h264bsfc = av_bitstream_filter_init("h264_mp4toannexb");

else

h264bsfc = av_bitstream_filter_init("hevc_mp4toannexb");

}

网上有许多代码和伪代码都说实现了把数据源修改为FFmpeg,但我在尝试的时候发现cuvidCreateVideoParser创建的Parser的回调函数都没有调用。经过一番折腾,综合英伟达网站、stackoverflow和FFmpeg源码,才发现对H264数据要做一个处理才能把AVPacket有效的转为CUVIDSOURCEDATAPACKET。其中h264bsfc的定义为AVBitStreamFilterContext* h264bsfc = NULL;

2.AVPacket转CUVIDSOURCEDATAPACKET,并交给cuvidParseVideoData

void VideoSource::play_thread(LPVOID lpParam)

{

AVPacket *avpkt;

avpkt = (AVPacket *)av_malloc(sizeof(AVPacket));

CUVIDSOURCEDATAPACKET cupkt;

int iPkt = 0;

CUresult oResult;

while (av_read_frame(pFormatCtx, avpkt) >= 0){

if (bThreadExit){

break;

}

bStarted = true;

if (avpkt->stream_index == videoindex){ cuCtxPushCurrent(g_oContext); if (avpkt && avpkt->size) {

if (h264bsfc)

{

av_bitstream_filter_filter(h264bsfc, pFormatCtx->streams[videoindex]->codec, NULL, &avpkt->data, &avpkt->size, avpkt->data, avpkt->size, 0);

} cupkt.payload_size = (unsigned long)avpkt->size;

cupkt.payload = (const unsigned char*)avpkt->data; if (avpkt->pts != AV_NOPTS_VALUE) {

cupkt.flags = CUVID_PKT_TIMESTAMP;

if (pCodecCtx->pkt_timebase.num && pCodecCtx->pkt_timebase.den){

AVRational tb;

tb.num = 1;

tb.den = AV_TIME_BASE;

cupkt.timestamp = av_rescale_q(avpkt->pts, pCodecCtx->pkt_timebase, tb);

}

else

cupkt.timestamp = avpkt->pts;

}

}

else {

cupkt.flags = CUVID_PKT_ENDOFSTREAM;

} oResult = cuvidParseVideoData(oSourceData_.hVideoParser, &cupkt);

if ((cupkt.flags & CUVID_PKT_ENDOFSTREAM) || (oResult != CUDA_SUCCESS)){

break;

}

iPkt++;

//printf("Succeed to read avpkt %d !\n", iPkt);

checkCudaErrors(cuCtxPopCurrent(NULL));

}

av_free_packet(avpkt);

} oSourceData_.pFrameQueue->endDecode();

bStarted = false;

}

这里FFmpeg读取数据包后,对H264和HEVC格式,有一个重要的处理,就是前面提到的,

if (h264bsfc)

{

av_bitstream_filter_filter(h264bsfc, pFormatCtx->streams[videoindex]->codec, NULL, &avpkt->data, &avpkt->size, avpkt->data, avpkt->size, 0);

}

这个处理的含义见雷霄华的博客http://blog.csdn.net/leixiaohua1020/article/details/39767055。

这样,通过FFmpeg,CUVID就可以对流进行处理了。个人尝试过读取本地文件和rtsp流。FFmpeg读取rtsp流的方式竟然只需要把文件改为rtsp流的地址就可以,以前没做过流式的,我还以为会很复杂的。

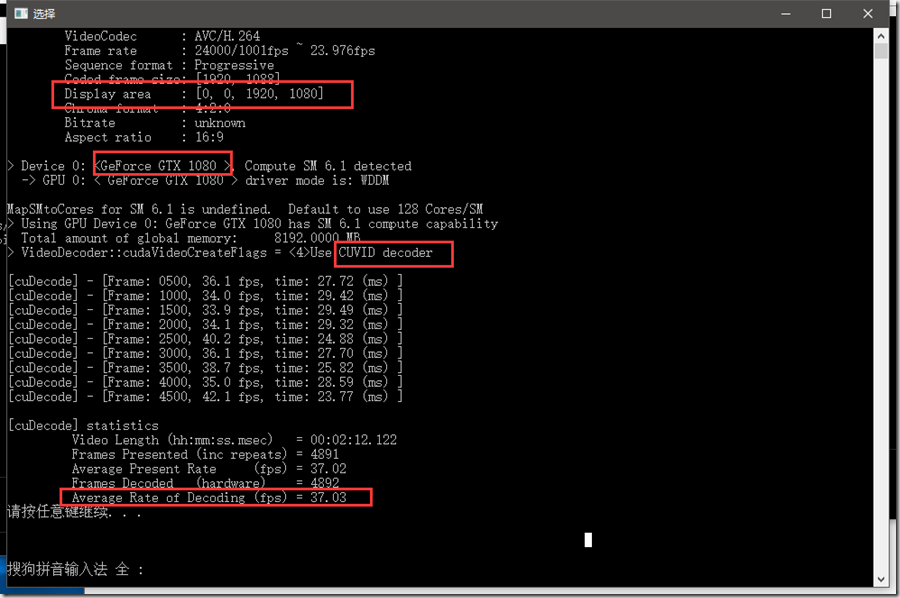

3.一点数据

这是在GTX 1080上把解码进程(没做显示)开了20路解码得到的数据。20路1920X1080解码还能到平局37fps,这显卡也是6得不行。

工程源码:http://download.csdn.net/download/qq_33892166/9792997

源码遇到了一个问题,没找到原因。代码在GTX 1080和Tesla P4上的解码效果很好。P4由于驱动模式是TCC模式,所以只能解码,不能显示;1080上可解码,可显示。但是在我自己电脑上的GT940M上,即时是原生SDK在cuvidCreateDecoder的时候也总是报错CUDA_ERROR_NO_DEVICE。驱动似乎没问题,试了CUDA的demo,CUDA运算也是正常的,查的资料表明GT940M应该是支持CUVID的。希望知道原因的朋友能指教一二。

-----------------------------------------2017.7.7更新----------------------------------------

修改代码中的一处内存泄漏问题:

把play_thread()中的

if (avpkt && avpkt->size) {

if (h264bsfc)

{

av_bitstream_filter_filter(h264bsfc, pFormatCtx->streams[videoindex]->codec, NULL, &avpkt->data, &avpkt->size, avpkt->data, avpkt->size, 0);

}

cupkt.payload_size = (unsigned long)avpkt->size;

cupkt.payload = (const unsigned char*)avpkt->data;

if (avpkt->pts != AV_NOPTS_VALUE) {

cupkt.flags = CUVID_PKT_TIMESTAMP;

if (pCodecCtx->pkt_timebase.num && pCodecCtx->pkt_timebase.den){

AVRational tb;

tb.num = 1;

tb.den = AV_TIME_BASE;

cupkt.timestamp = av_rescale_q(avpkt->pts, pCodecCtx->pkt_timebase, tb);

}

else

cupkt.timestamp = avpkt->pts;

}

}

else {

cupkt.flags = CUVID_PKT_ENDOFSTREAM;

}

oResult = cuvidParseVideoData(oSourceData_.hVideoParser, &cupkt);

if ((cupkt.flags & CUVID_PKT_ENDOFSTREAM) || (oResult != CUDA_SUCCESS)){

break;

}

iPkt++;

为

AVPacket new_pkt = *avpkt; if (avpkt && avpkt->size)

{

if (h264bsfc){ int a = av_bitstream_filter_filter(h264bsfc, pFormatCtx->streams[videoindex]->codec, NULL,

&new_pkt.data, &new_pkt.size,

avpkt->data, avpkt->size,

avpkt->flags & AV_PKT_FLAG_KEY); if (a>0){

if (new_pkt.data != avpkt->data)//-added this

{

av_free_packet(avpkt); avpkt->data = new_pkt.data;

avpkt->size = new_pkt.size;

}

}

else if (a<0){

goto LOOP0;

} *avpkt = new_pkt;

} cupkt.payload_size = (unsigned long)avpkt->size;

cupkt.payload = (const unsigned char*)avpkt->data; if (avpkt->pts != AV_NOPTS_VALUE)

{

cupkt.flags = CUVID_PKT_TIMESTAMP;

if (pCodecCtx->pkt_timebase.num && pCodecCtx->pkt_timebase.den)

{

AVRational tb;

tb.num = 1;

tb.den = AV_TIME_BASE;

cupkt.timestamp = av_rescale_q(avpkt->pts, pCodecCtx->pkt_timebase, tb);

}

else

cupkt.timestamp = avpkt->pts;

}

}

else

{

cupkt.flags = CUVID_PKT_ENDOFSTREAM;

} oResult = cuvidParseVideoData(oSourceData_.hVideoParser, &cupkt);

if ((cupkt.flags & CUVID_PKT_ENDOFSTREAM) || (oResult != CUDA_SUCCESS))

{

break;

} av_free(new_pkt.data);

这个泄漏是av_bitstream_filter_filter造成的,解决办法参考http://blog.csdn.net/lg1259156776/article/details/73283920 。

-----------------------------2017.8.30 补-----------------------------------

貌似还是有小伙伴被内存泄漏难住了,这里我给出我最新的读取数据包线程函数的完整代码,希望有所帮助

void VideoSource::play_thread(LPVOID lpParam)

{

AVPacket *avpkt;

avpkt = (AVPacket *)av_malloc(sizeof(AVPacket));

CUVIDSOURCEDATAPACKET cupkt;

CUresult oResult;

while (av_read_frame(pFormatCtx, avpkt) >= 0){

LOOP0:

if (bThreadExit){

break;

} if (avpkt->stream_index == videoindex)

{

AVPacket new_pkt = *avpkt; if (avpkt && avpkt->size)

{

if (h264bsfc){ int a = av_bitstream_filter_filter(h264bsfc, pFormatCtx->streams[videoindex]->codec, NULL,

&new_pkt.data, &new_pkt.size,

avpkt->data, avpkt->size,

avpkt->flags & AV_PKT_FLAG_KEY); if (a>0){

if (new_pkt.data != avpkt->data)//-added this

{

av_free_packet(avpkt); avpkt->data = new_pkt.data;

avpkt->size = new_pkt.size;

}

}

else if (a<0){

goto LOOP0;

} *avpkt = new_pkt;

} cupkt.payload_size = (unsigned long)avpkt->size;

cupkt.payload = (const unsigned char*)avpkt->data; if (avpkt->pts != AV_NOPTS_VALUE)

{

cupkt.flags = CUVID_PKT_TIMESTAMP;

if (pCodecCtx->pkt_timebase.num && pCodecCtx->pkt_timebase.den)

{

AVRational tb;

tb.num = 1;

tb.den = AV_TIME_BASE;

cupkt.timestamp = av_rescale_q(avpkt->pts, pCodecCtx->pkt_timebase, tb);

}

else

cupkt.timestamp = avpkt->pts;

}

}

else

{

cupkt.flags = CUVID_PKT_ENDOFSTREAM;

} oResult = cuvidParseVideoData(oSourceData_.hVideoParser, &cupkt);

if ((cupkt.flags & CUVID_PKT_ENDOFSTREAM) || (oResult != CUDA_SUCCESS))

{

break;

} av_free(new_pkt.data);

}

else

av_free_packet(avpkt);

} oSourceData_.pFrameQueue->endDecode();

bStarted = false; if (pCodecCtx->codec_id == AV_CODEC_ID_H264 || pCodecCtx->codec_id == AV_CODEC_ID_HEVC) {

av_bitstream_filter_close(h264bsfc);

}

}

英伟达CUVID硬解,并通过FFmpeg读取文件的更多相关文章

- 【视频开发】【CUDA开发】英伟达CUVID硬解,并通过FFmpeg读取文件

虽然FFmpeg本身有cuvid硬解,但是找不到什么好的资料,英伟达的SDK比较容易懂,参考FFmpeg源码,将NVIDIA VIDEO CODEC SDK的数据获取改为FFmpeg获取,弥补原生SD ...

- 不用写代码就能实现深度学习?手把手教你用英伟达 DIGITS 解决图像分类问题

2006年,机器学习界泰斗Hinton,在Science上发表了一篇使用深度神经网络进行维数约简的论文 ,自此,神经网络再次走进人们的视野,进而引发了一场深度学习革命.深度学习之所以如此受关注,是因为 ...

- 【并行计算与CUDA开发】英伟达硬件加速编解码

硬件加速 并行计算 OpenCL OpenCL API VS SDK 英伟达硬件编解码方案 基于 OpenCL 的 API 自己写一个编解码器 使用 SDK 中的编解码接口 使用编码器对于 OpenC ...

- 【并行计算-CUDA开发】英伟达硬件解码器分析

这篇文章主要分析 NVCUVID 提供的解码器,里面提到的所有的源文件都可以在英伟达的 nvenc_sdk 中找到. 解码器的代码分析 SDK 中的 sample 文件夹下的 NvTranscoder ...

- CentOS7.X安装英伟达显卡采坑之路

1.系统信息 操作系统版本:CentOS7.X 显卡版本:英伟达 Tesla P100 其他软件包安装信息: CUDA 9.0 CUDNN 7.4.2.24 lightgbm 2.2.X Boost ...

- 第一篇:CUDA 6.0 安装及配置( WIN7 64位 / 英伟达G卡 / VS2010 )

前言 本文讲解如何在VS 2010开发平台中搭建CUDA开发环境. 当前配置: 系统:WIN7 64位 开发平台:VS 2010 显卡:英伟达G卡 CUDA版本:6.0 若配置不同,请谨慎参考本文. ...

- Ubuntu18.04安装英伟达显卡驱动

前几天买了一张RTX2060显卡,想自学一下人工智能,跑一些图形计算,安装Ubuntu18.04后发现英伟达显卡驱动安装还是有点小麻烦,所以这里记录一下安装过程,以供参考: 1.卸载系统里低版本的英伟 ...

- NCCL(Nvidia Collective multi-GPU Communication Library) Nvidia英伟达的Multi-GPU多卡通信框架NCCL 学习;PCIe 速率调研;

为了了解,上来先看几篇中文博客进行简单了解: 如何理解Nvidia英伟达的Multi-GPU多卡通信框架NCCL?(较为优秀的文章) 使用NCCL进行NVIDIA GPU卡之间的通信(GPU卡通信模式 ...

- 玩深度学习选哪块英伟达 GPU?有性价比排名还不够!

本文來源地址:https://www.leiphone.com/news/201705/uo3MgYrFxgdyTRGR.html 与“传统” AI 算法相比,深度学习(DL)的计算性能要求,可以说完 ...

随机推荐

- 2017<java技术>预备作业计科冀浩然

1.阅读邹欣老师的博客,谈谈你期望的师生关系是什么样的? 我期望的师生关系是相互融洽的,老师能够在上课的时候尽量多的教我们专业知识,可以尽量多和我们进行互动,课下能和我们如同朋友一般就可以了. 2.你 ...

- ConnectString ()函数的介绍

ConnectString ()函数的介绍: connectstring 函数主要负责数据库的连接工作 Public Function ConnectString() As String ...

- iis7.0 ExtensionlessUrlHandler-Integrated-4.0解决方法

IIS7.0上部署网站,打开后500错误: 处理程序“ExtensionlessUrlHandler-Integrated-4.0” 在其模块列表中有一个错误模块“ManagedPipelineHan ...

- Glusterfs下读写请求的处理流程

Glusterfs基于内核的fuse模块,fuse模块除了创建fuse文件系统外,还提供了一个字符设备(/dev/fuse),通过这个字符设备,Glusterfs可以读取请求,并发送响应,并且可以发送 ...

- JavaScript中国象棋程序(6) - 克服水平线效应、检查重复局面

"JavaScript中国象棋程序" 这一系列教程将带你从头使用JavaScript编写一个中国象棋程序.这是教程的第6节. 这一系列共有9个部分: 0.JavaScript中国象 ...

- linux下常用语言的语法检查插件整理

linux下常用语言的语法检查插件 可以结合vim语法检查插件syntastic使用,具体请参考syntastic使用说明 如php,sql,json,css,js,html,shell,c等语法插件 ...

- BZOJ 3402: [Usaco2009 Open]Hide and Seek 捉迷藏(最短路)

这个= =一看就是最短路了= = PS:最近有点懒 = = 刚才看到一道平衡树的裸题还嫌懒不去写= =算了等刷完这堆水题再去理= = CODE: #include<cstdio>#incl ...

- 百度网盘免费扩容 免费扩容到2048G

您可以用手机端扩容 http://yun.baidu.com/1t 免费扩容到2048G

- 第十八篇 js高级知识---作用域链

一直有想法去写写js方面的东西,我个人是最喜欢js这门语言,喜欢的他的自由和强大,虽然作为脚本语言有很多限制的地方,但也不失为一个好的语言,尤其是在H5出现之后.下面开始说说js的方面的东西,由于自己 ...

- 《Django By Example》第七章 中文 翻译 (个人学习,渣翻)

书籍出处:https://www.packtpub.com/web-development/django-example 原作者:Antonio Melé (译者@ucag注:咳咳,第七章终于来了.其 ...