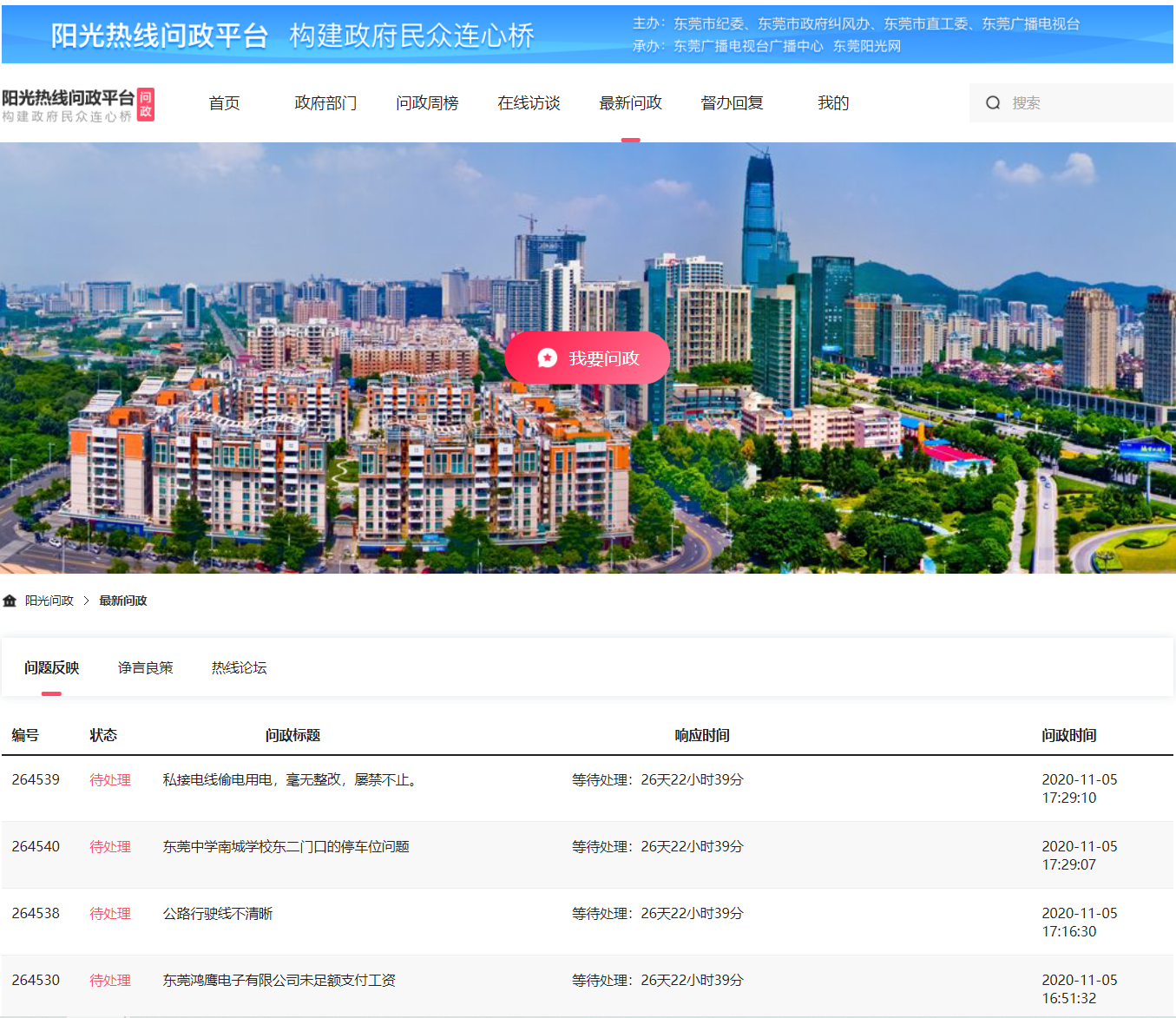

Scrapy项目_阳光热线问政平台

目的:

爬取阳光热线问政平台问题中每个帖子的标题、详情URL、详情内容、图片以及发布时间

步骤:

1、创建爬虫项目

1 scrapy startproject yangguang

2 cd yangguang

3 scrapy genspider yangguang sun0769.com

2、设置item.py文件

import scrapy class YangguangItem(scrapy.Item):

# 每条帖子的标题

title = scrapy.Field()

# 帖子链接

href = scrapy.Field()

# 发布日期

publish_time = scrapy.Field()

# 详情内容

content = scrapy.Field()

# 详情图片

content_img = scrapy.Field()

3、编写爬虫文件

1 import scrapy

2 from yangguang.items import YangguangItem

3

4

5 class YgSpider(scrapy.Spider):

6 name = 'yg'

7 allowed_domains = ['sun0769.com']

8 start_urls = ['http://wz.sun0769.com/political/index/politicsNewest?id=1&page=1']

9

10 page = 1

11 url = "http://wz.sun0769.com/political/index/politicsNewest?id=1&page= {}"

12

13 def parse(self, response):

14 # 分组

15 li_list = response.xpath("//ul[@class='title-state-ul']/li")

16 for li in li_list:

17 item = YangguangItem()

18 item["title"] = li.xpath("./span[@class='state3']/a/text()").extract_first()

19 item["href"] = "http://wz.sun0769.com" + li.xpath("./span[@class='state3']/a/@href").extract_first()

20 item["publish_time"] = li.xpath("./span[@class='state5 ']/text()").extract_first()

21

22 yield scrapy.Request(

23 item["href"],

24 callback=self.parse_detail,

25 meta={

26 "item": item,

27 "proxy": "http://171.12.221.51:9999"

28 }

29 )

30 # 翻页

31 if self.page < 10:

32 self.page += 1

33 next_url = self.url.format(self.page)

34

35 yield scrapy.Request(next_url, callback=self.parse, meta={"proxy": "http://123.163.118.71:9999"})

36

37 def parse_detail(self, response): # 处理详情页

38 item = response.meta["item"]

39 item["content"] = response.xpath("//div[@class='details-box']/pre/text()").extract_first()

40 item["content_img"] = response.xpath("//div[@class='clear details-img-list Picture-img']/img/@src").extract()

41 yield item

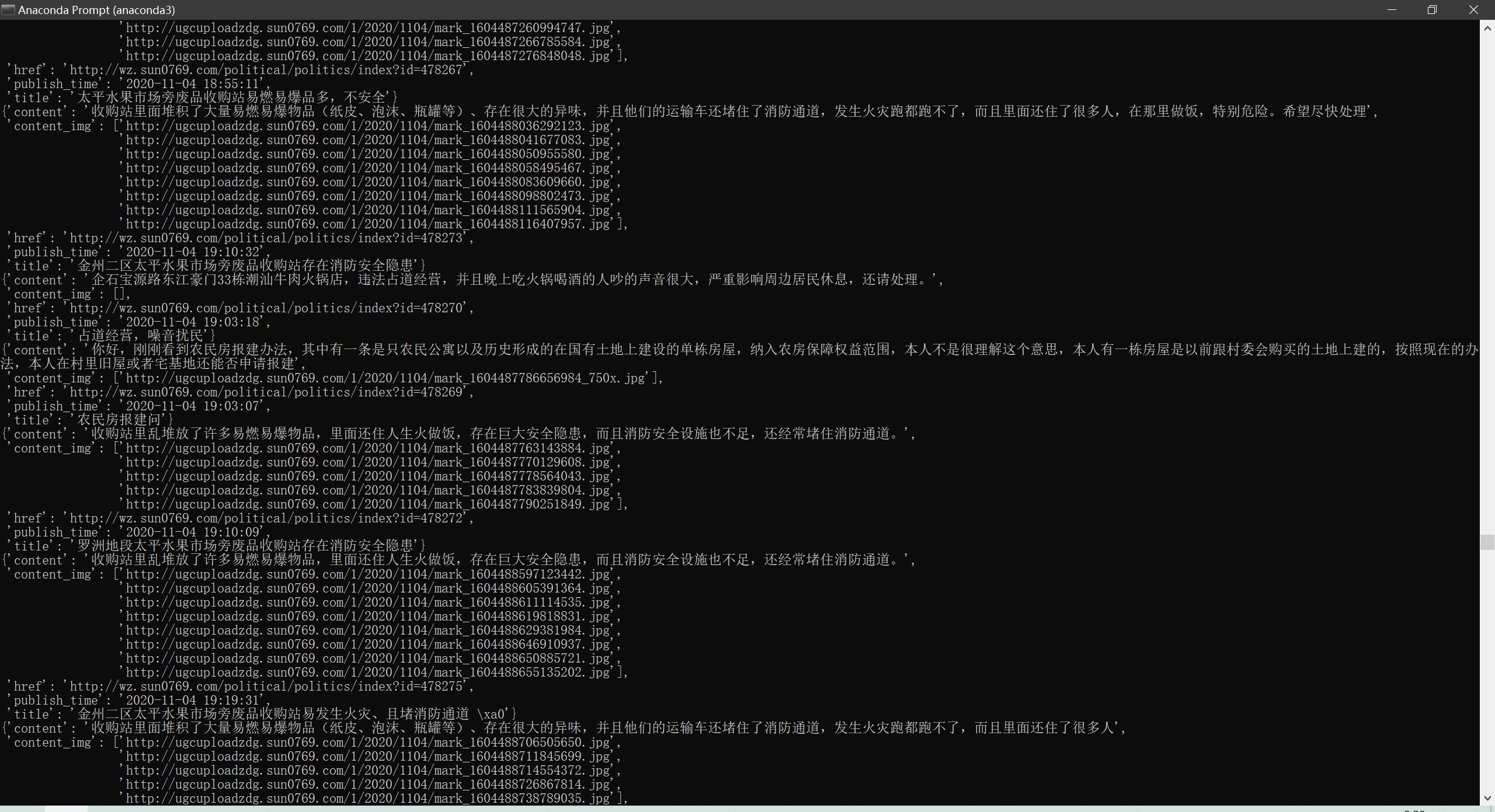

4、测试

scrapy crawl yg

Scrapy项目_阳光热线问政平台的更多相关文章

- scrapy爬虫案例--爬取阳关热线问政平台

阳光热线问政平台:http://wz.sun0769.com/political/index/politicsNewest?id=1&page=1 爬取最新问政帖子的编号.投诉标题.投诉内容以 ...

- Scrapy项目_苏宁图书信息

苏宁图书(https://book.suning.com/) 目标: 1.图书一级分类 2.图书二级分类 3.图书三级分类 4.图书名字 5.图书作者 6.图书价格 7.通过Scrapy获取以上数据 ...

- 爬虫——Scrapy框架案例二:阳光问政平台

阳光热线问政平台 URL地址:http://wz.sun0769.com/index.php/question/questionType?type=4&page= 爬取字段:帖子的编号.投诉类 ...

- scrapy爬虫案例:问政平台

问政平台 http://wz.sun0769.com/index.php/question/questionType?type=4 爬取投诉帖子的编号.帖子的url.帖子的标题,和帖子里的内容. it ...

- C++框架_之Qt的开始部分_概述_安装_创建项目_快捷键等一系列注意细节

C++框架_之Qt的开始部分_概述_安装_创建项目_快捷键等一系列注意细节 1.Qt概述 1.1 什么是Qt Qt是一个跨平台的C++图形用户界面应用程序框架.它为应用程序开发者提供建立艺术级图形界面 ...

- python爬虫scrapy项目详解(关注、持续更新)

python爬虫scrapy项目(一) 爬取目标:腾讯招聘网站(起始url:https://hr.tencent.com/position.php?keywords=&tid=0&st ...

- 亲测——pycharm下运行第一个scrapy项目 ©seven_clear

最近在学习scrapy,就想着用pycharm调试,但不知道怎么弄,从网上搜了很多方法,这里总结一个我试成功了的. 首先当然是安装scrapy,安装教程什么的网上一大堆,这里推荐一个详细的:http: ...

- 凡客副总裁崔晓琦离职 曾负责旗下V+商城项目_科技_腾讯网

凡客副总裁崔晓琦离职 曾负责旗下V+商城项目_科技_腾讯网 凡客副总裁崔晓琦离职 曾负责旗下V+商城项目 腾讯科技[微博]乐天2013年09月18日12:44 分享 微博 空间 微信 新浪微博 邮箱 ...

- scrapy(一)建立一个scrapy项目

本项目实现了获取stack overflow的问题,语言使用python,框架scrapy框架,选取mongoDB作为持久化数据库,redis做为数据缓存 项目源码可以参考我的github:https ...

随机推荐

- apache https 双向证书生成

Https分单向认证和双向认证 单向认证表现形式:网站URL链接为https://xxx.com格式 双向认证表现心事:网站URL链接为https://xxx.com格式,并且需要客户端浏览器安装一个 ...

- springboot基础配置-->Properties配置

Spring Boot项目中的application.properties配置文件一共可以出现在如下4个位置: 项目根目录下的config文件夹中. 项目根目录下. classpath下的config ...

- 【STM32】串口

一. 串口中断使能问题 错误: 串口只能接收一次数据,从串口助手发第二个数据时接收不到. 分析: 在UART_Receive_IT(huart)函数里,回调函数的上面有如下代码: 这几行代码的作用是关 ...

- Java多线程操作同一份资源

现在两个线程,可以操作初始值为零的一个变量,实现一个线程对该变量加1,一个线程对该变量减1,实现交替,来10轮,变量初始值为零. package com.yangyuanyuan.juc1205; i ...

- Manacher(马拉车)算法详解

给定一个字符串,求出其最长回文子串 eg: abcba 第一步: 在字符串首尾,及各字符间各插入一个字符(前提这个字符未出现在串里). 如 原来ma /* a b a b c ...

- CodeForces - 612D 思维

题意: 给你n个线段和一个整数k,你需要找出来所有能被任意k条线段同时覆盖的区间个数的最小值,并按从左到右的顺序输出每个区间. 题解: 对于题目输入的n个线段的左端点L,右端点R,把它们分开放在结构体 ...

- div 水平居中 内容居左

<div style="margin:0 auto;width:500px;text-align:left"> </div> https://zhidao. ...

- C#之Dispose

前言 谈到Dispose,首先需要理解C#的资源 资源类型 托管资源:由CLR创建和释放 非托管资源:资源的创建和释放不由CLR管理.比如IO.网络连接.数据库连接等等.需要开发人员手动释放. 如何释 ...

- dart类详细讲解

dart 是一个面向对象的语言;面向对象有 (1)继承 (2)封装 (3)多态 dart的所有东西都是对象,所有的对象都是继承与object类 一个类通常是由属性和方法组成的哈: 在dart中如果你要 ...

- K8S(04)核心插件-coredns服务

K8S核心插件-coredns服务 目录 K8S核心插件-coredns服务 1 coredns用途 1.1 为什么需要服务发现 2 coredns的部署 2.1 获取coredns的docker镜像 ...