python网络爬虫之解析网页的XPath(爬取Path职位信息)[三]

@

前言

本章同样是解析网页,不过使用的解析技术为XPath。

相对于之前的BeautifulSoup,我感觉还行,也是一个比较常用的一种解析方式

,

并且更加的符合我们之前的一个逻辑思维,不过看情况吧,看各位准备怎么用吧。

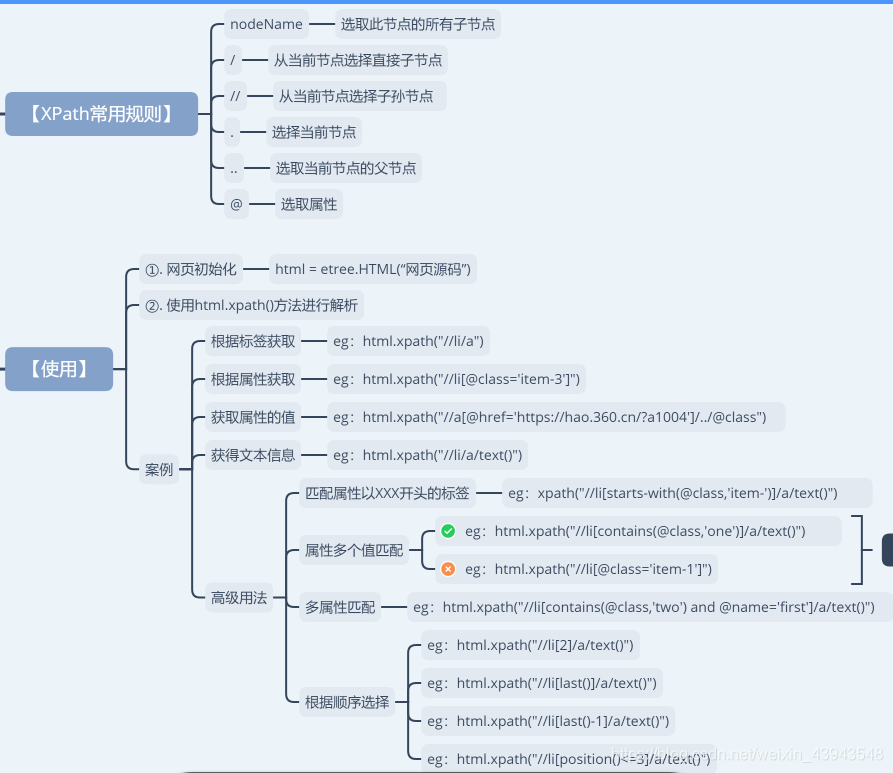

XPath的使用方法

同样的先下载lxml插件,并且导入里面的etree

"""

XPath的学习

"""

from lxml import etree

# 案例文件

html_doc = """

<div>

<ul>

<li class="item-0"><a href="www.baidu.com">baidu</a>

<li class="item-1 one" name="first"><a href="https://blog.csdn.net/qq_25343557">myblog</a>

<li class="item-1 two" name="first"><a href="https://blog.csdn.net/qq_25343557">myblog2</a>

<li class="item-2"><a href="https://www.csdn.net/">csdn</a>

<li class="item-3"><a href="https://hao.360.cn/?a1004">bbb</a>

<li class="aaa"><a href="https://hao.360.cn/?a1004">aaa</a>

"""

html = etree.HTML(html_doc)

# 1、获取所有li下的所有a标签

print(html.xpath("//li/a"))

#2、获取指定的li标签item-0

print(html.xpath("//li[@class='item-0']"))

#3、获取指定的li标签item-0下面的a标签

print(html.xpath("//li[@class='item-0']/a"))

#4、获取指定的li标签item-0下面的a标签里面的内容

print(html.xpath("//li[@class='item-0']/a/text()"))

# 高级进阶用法

# 1、匹配属性以什么类型开头的class(starts-with())

print(html.xpath("//li[starts-with(@class,'item-')]"))

# 2、匹配里面所有相同的item-1,(contains())

print(html.xpath("//li[contains(@class,'item-1')]"))

# 3、多属性的匹配(and)

print(html.xpath("//li[contains(@class,'one') and contains(@name,'first')]/a/text()"))

# 4、按顺序来排序

# 第2个

print(html.xpath("//li[2]/a/text()"))

# 最后一个

print(html.xpath("//li[last()]/a/text()"))

# 最后一个-1个

print(html.xpath("//li[last()-1]/a/text()"))

# 小于等于3的序号li

print(html.xpath("//li[position()<=3]/a/text()"))

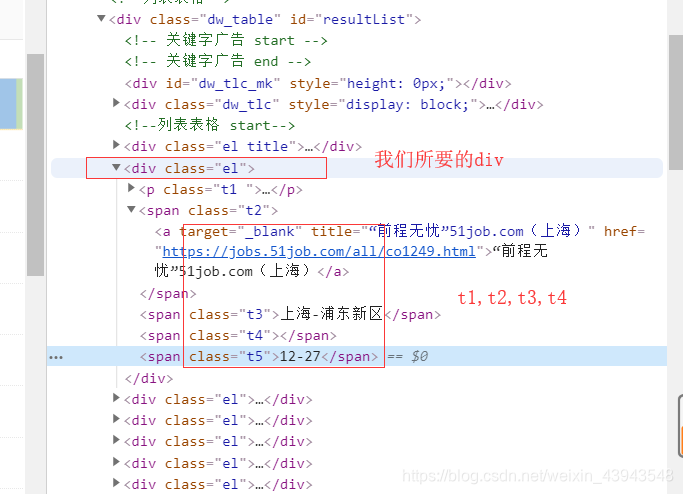

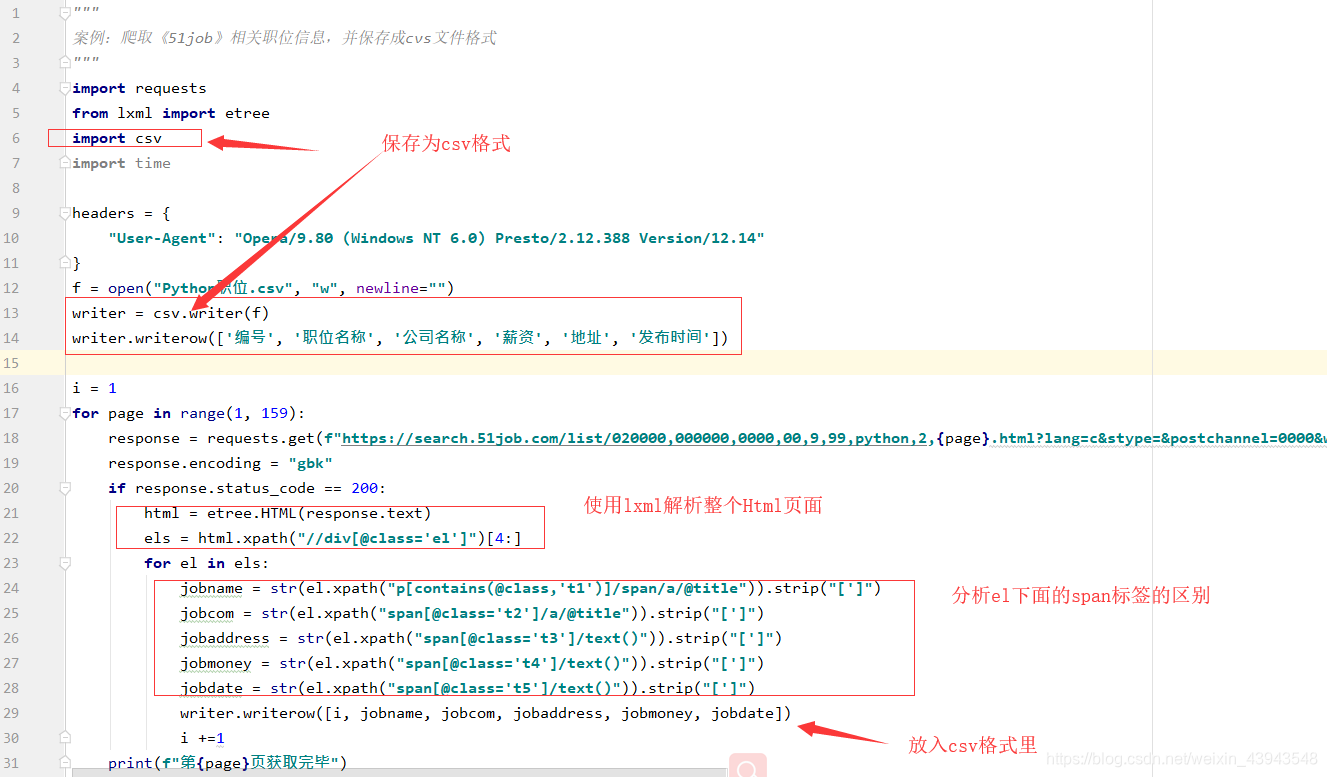

XPath爬取数据

"""

案例:爬取《51job》相关职位信息,并保存成cvs文件格式

"""

import requests

from lxml import etree

import csv

import time

headers = {

"User-Agent": "Opera/9.80 (Windows NT 6.0) Presto/2.12.388 Version/12.14"

}

f = open("Python职位.csv", "w", newline="")

writer = csv.writer(f)

writer.writerow(['编号', '职位名称', '公司名称', '薪资', '地址', '发布时间'])

i = 1

for page in range(1, 159):

response = requests.get(f"https://search.51job.com/list/020000,000000,0000,00,9,99,python,2,{page}.html?lang=c&stype=&postchannel=0000&workyear=99&cotype=99°reefrom=99&jobterm=99&companysize=99&providesalary=99&lonlat=0%2C0&radius=-1&ord_field=0&confirmdate=9&fromType=&dibiaoid=0&address=&line=&specialarea=00&from=&welfare=", headers=headers)

response.encoding = "gbk"

if response.status_code == 200:

html = etree.HTML(response.text)

els = html.xpath("//div[@class='el']")[4:]

for el in els:

jobname = str(el.xpath("p[contains(@class,'t1')]/span/a/@title")).strip("[']")

jobcom = str(el.xpath("span[@class='t2']/a/@title")).strip("[']")

jobaddress = str(el.xpath("span[@class='t3']/text()")).strip("[']")

jobmoney = str(el.xpath("span[@class='t4']/text()")).strip("[']")

jobdate = str(el.xpath("span[@class='t5']/text()")).strip("[']")

writer.writerow([i, jobname, jobcom, jobaddress, jobmoney, jobdate])

i +=1

print(f"第{page}页获取完毕")

后言

多学一种解析网页的方式多一种选择

python网络爬虫之解析网页的XPath(爬取Path职位信息)[三]的更多相关文章

- python网络爬虫之解析网页的BeautifulSoup(爬取电影图片)[三]

目录 前言 一.BeautifulSoup的基本语法 二.爬取网页图片 扩展学习 后记 前言 本章同样是解析一个网页的结构信息 在上章内容中(python网络爬虫之解析网页的正则表达式(爬取4k动漫图 ...

- python网络爬虫之解析网页的正则表达式(爬取4k动漫图片)[三]

前言 hello,大家好 本章可是一个重中之重,因为我们今天是要爬取一个图片而不是一个网页或是一个json 所以我们也就不用用到selenium模块了,当然有兴趣的同学也一样可以使用selenium去 ...

- 爬虫系列2:Requests+Xpath 爬取租房网站信息

Requests+Xpath 爬取租房网站信息 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参考前文 ...

- Python 网络爬虫 007 (编程) 通过网站地图爬取目标站点的所有网页

通过网站地图爬取目标站点的所有网页 使用的系统:Windows 10 64位 Python 语言版本:Python 2.7.10 V 使用的编程 Python 的集成开发环境:PyCharm 2016 ...

- (转)Python网络爬虫实战:世纪佳缘爬取近6万条数据

又是一年双十一了,不知道从什么时候开始,双十一从“光棍节”变成了“双十一购物狂欢节”,最后一个属于单身狗的节日也成功被攻陷,成为了情侣们送礼物秀恩爱的节日. 翻着安静到死寂的聊天列表,我忽然惊醒,不行 ...

- 爬虫系列3:Requests+Xpath 爬取租房网站信息并保存本地

数据保存本地 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参考前文 爬虫系列2:https://www ...

- 爬虫系列4:Requests+Xpath 爬取动态数据

爬虫系列4:Requests+Xpath 爬取动态数据 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参 ...

- 【图文详解】scrapy爬虫与动态页面——爬取拉勾网职位信息(2)

上次挖了一个坑,今天终于填上了,还记得之前我们做的拉勾爬虫吗?那时我们实现了一页的爬取,今天让我们再接再厉,实现多页爬取,顺便实现职位和公司的关键词搜索功能. 之前的内容就不再介绍了,不熟悉的请一定要 ...

- Python开发爬虫之BeautifulSoup解析网页篇:爬取安居客网站上北京二手房数据

目标:爬取安居客网站上前10页北京二手房的数据,包括二手房源的名称.价格.几室几厅.大小.建造年份.联系人.地址.标签等. 网址为:https://beijing.anjuke.com/sale/ B ...

随机推荐

- Python_包

包 包是一种通过使用‘.模块名’来组织python模块名称空间的方式. 1. 无论是import形式还是from...import形式,凡是在导入语句中(而不是在使用时)遇到带点的,都要第一时间提高警 ...

- 【译】PHP 内核 — 字符串管理

[译]PHP 内核 - 字符串管理 (Strings management: zend_string 译文) 原文地址:http://www.phpinternalsbook.com/php7/int ...

- object转为string

object为null时 错误:object.tostring() 空指针 正确:(string)object

- Flask 教程 第十七章:Linux上的部署

本文翻译自The Flask Mega-Tutorial Part XVII: Deployment on Linux 这是Flask Mega-Tutorial系列的第十七部分,我将把Microbl ...

- kuangbin专题 专题九 连通图 POJ 1236 Network of Schools

题目链接:https://vjudge.net/problem/POJ-1236 题目:有向图,有若干个连通图,点之间有单向边边就可以单向传递信息,问: (1)至少需要发送几份信息才能使得每个点都传递 ...

- 吴裕雄 python 机器学习——数据预处理标准化MinMaxScaler模型

from sklearn.preprocessing import MinMaxScaler #数据预处理标准化MinMaxScaler模型 def test_MinMaxScaler(): X=[[ ...

- nginx配置访问密码,输入用户名和密码才能访问

1. 安装 htpasswd 工具 yum install httpd-tools -y 设置用户名和密码,并把用户名.密码保存到指定文件中: [sandu@bogon conf]$ sudo mkd ...

- 每天进步一点点------Sobel算子(2)

转载 http://blog.csdn.net/tianhai110 索贝尔算子(Sobel operator)主要用作边缘检测,在技术上,它是一离散性差分算子,用来运算图像亮度函数的灰度之近似值. ...

- yii components文件到底应该放些什么代码

项目全局用的代码,比如项目所有controller和model的共通操作或者放一些第三方的组件.插件之类的项目全局用的代码

- 部署DVWA时的一些问题和解决办法(二)

DVWA reCAPTCHA key: Missing解决方法 编辑 dvwa/config/config.inc.php这个配置文件 $_DVWA[ 'recaptcha_public_key' ] ...