爬取5K分辨率超清唯美壁纸

@

爬取5K分辨率超清唯美壁纸

简介

壁纸的选择其实很大程度上能看出电脑主人的内心世界,有的人喜欢风景,有的人喜欢星空,有的人喜欢美女,有的人喜欢动物。然而,终究有一天你已经产生审美疲劳了,但你下定决定要换壁纸的时候,又发现网上的壁纸要么分辨率低,要么带有水印。

这里有一款Mac下的小清新壁纸神器Pap.er,可能是Mac下最好的壁纸软件,自带5K超清分辨率壁纸,富有多种类型壁纸,当我们想在Windows或者Linux下使用的时候,就可以考虑将5K超清分辨率壁纸爬取下来。

编写思路

首先,打开Charles软件,进行抓包。打开Pap.er,开始抓包。(由于是Mac系统下的APP,所以非Mac系统的朋友可以直接看抓包结果)

抓包分析结果如下:

参数page不用改动,per_page指的是每页提取的数量,也就是我们想要提取的图片数量。

抓完包之后,我们开始编写5K壁纸解析程序

# 爬取不同类型图片

def crawler_photo(type_id, photo_count):

# 最新 1, 最热 2, 女生 3, 星空 4

if(type_id == 1):

url = 'https://service.paper.meiyuan.in/api/v2/columns/flow/5c68ffb9463b7fbfe72b0db0?page=1&per_page=' + str(photo_count)

elif(type_id == 2):

url = 'https://service.paper.meiyuan.in/api/v2/columns/flow/5c69251c9b1c011c41bb97be?page=1&per_page=' + str(photo_count)

elif(type_id == 3):

url = 'https://service.paper.meiyuan.in/api/v2/columns/flow/5c81087e6aee28c541eefc26?page=1&per_page=' + str(photo_count)

elif(type_id == 4):

url = 'https://service.paper.meiyuan.in/api/v2/columns/flow/5c81f64c96fad8fe211f5367?page=1&per_page=' + str(photo_count)

headers = {"User-Agent": "Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36"}

# 获取图片链接列表数据,json格式

respond = requests.get(url, headers=headers)

# 对json格式转化为python对象

photo_data = json.loads(respond.content)

# 已经下载的图片张数

now_photo_count = 1

# 所有图片张数

all_photo_count = len(photo_data)

# 开始下载并保存5K分辨率壁纸

for photo in photo_data:

# 创建一个文件夹存放我们下载的图片(若存在则不用重新创建)

if not os.path.exists('./' + str(type_id)):

os.makedirs('./' + str(type_id))

# 准备下载的图片链接,5K超清壁纸链接

file_url = photo['urls']['raw']

# 准备下载的图片名称,不包含扩展名

file_name_only = file_url.split('/')

file_name_only = file_name_only[len(file_name_only) -1]

# 准备保存到本地的完整路径

file_full_name = './' + str(type_id) + '/' + file_name_only

# 开始下载图片

Down_load(file_url, file_full_name, now_photo_count, all_photo_count)

# 已经下载的图片数量加1

now_photo_count = now_photo_count + 1

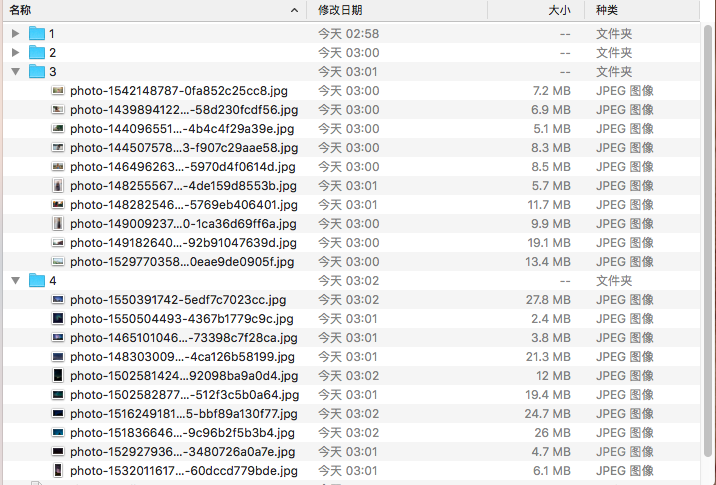

根据不同类型的壁纸,创建不同的文件夹编号进行分类。

上面的Down_load()函数是下载文件的意思,调用requests库,具体代码如下:

# 文件下载器

def Down_load(file_url, file_full_name, now_photo_count, all_photo_count):

headers = {"User-Agent": "Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36"}

# 开始下载图片

with closing(requests.get(file_url, headers=headers, stream=True)) as response:

chunk_size = 1024 # 单次请求最大值

content_size = int(response.headers['content-length']) # 文件总大小

data_count = 0 # 当前已传输的大小

with open(file_full_name, "wb") as file:

for data in response.iter_content(chunk_size=chunk_size):

file.write(data)

done_block = int((data_count / content_size) * 50)

data_count = data_count + len(data)

now_jd = (data_count / content_size) * 100

print("\r %s:[%s%s] %d%% %d/%d" % (file_full_name, done_block * '█', ' ' * (50 - 1 - done_block), now_jd, now_photo_count, all_photo_count), end=" ")

# 下载完图片后获取图片扩展名,并为其增加扩展名

file_type = filetype.guess(file_full_name)

os.rename(file_full_name, file_full_name + '.' + file_type.extension)

chunk_size指的是单次请求的最大值,content_size指的就是我们下载5K超清壁纸的大小,为了能够直观显示下载情况,所以添加了下载进度条的显示效果。核心代码为file.write(data)。

下载完毕后,为了方便我们查看文件,所以需要给图片添加对应的扩展名,比如jpg,png,gif,这里使用到filetype库对文件进行解析,判断其类型。

最后,开始在main中爬取5K高清壁纸:

if __name__ == '__main__':

# 最新 1, 最热 2, 女生 3, 星空 4

# 爬取类型为3的图片(女生),一共准备爬取100张

print("程序已经开始运行,请稍等……")

crawler_photo(1, 100)

crawler_photo(2, 100)

crawler_photo(3, 100)

crawler_photo(4, 100)

使用教程

- 确保以下库均已安装:

# 如果没有安装,请使用pip install module安装

import requests

import filetype

import os

import json

from contextlib import closing

演示图片

完整源代码

项目源代码在GitHub仓库

项目持续更新,欢迎您star本项目

爬取5K分辨率超清唯美壁纸的更多相关文章

- Python爬虫教程-爬取5K分辨率超清唯美壁纸源码

简介 壁纸的选择其实很大程度上能看出电脑主人的内心世界,有的人喜欢风景,有的人喜欢星空,有的人喜欢美女,有的人喜欢动物.然而,终究有一天你已经产生审美疲劳了,但你下定决定要换壁纸的时候,又发现网上的壁 ...

- python 爬取王者荣耀高清壁纸

代码地址如下:http://www.demodashi.com/demo/13104.html 一.前言 打过王者的童鞋一般都会喜欢里边设计出来的英雄吧,特别想把王者荣耀的英雄的高清图片当成电脑桌面 ...

- Python爬虫-爬取科比职业生涯高清图集

前面学习了Python爬取豆瓣电影Top250的数据,爬取的信息是电影信息的文本信息,但是在互联网上流行的图片才有更大的吸引力,本篇我们来使用python爬取网页上的图片并保存在本地硬盘上,很兴奋吧, ...

- xpath+多进程爬取全书网纯爱耽美类别的所有小说。

# 需要的库 import requests from lxml import etree from multiprocessing import Pool import os # 请求头 heade ...

- Requests库入门——应用实例-网络图片的爬取与保存(好看的小姐姐≧▽≦)

在B站学习这一节的时候,弹幕最为激烈,不管大家是出于什么目的都想体验一下网络爬虫爬取图片的魅力,毕竟之前的实例实话说都是一些没有太大作用的信息. 好了,直接上代码: import requests i ...

- Python爬取 | 唯美女生图片

这里只是代码展示,且复制后不能直接运行,需要配置一些设置才行,具体请查看下方链接介绍: Python爬取 | 唯美女生图片 from selenium import webdriver from fa ...

- Python抓取花瓣网高清美图

一:前言 嘀嘀嘀,上车请刷卡.昨天看到了不错的图片分享网——花瓣,里面的图片质量还不错,所以利用selenium+xpath我把它的妹子的栏目下爬取了下来,以图片栏目名称给文件夹命名分类保存到电脑中. ...

- Node JS爬虫:爬取瀑布流网页高清图

原文链接:Node JS爬虫:爬取瀑布流网页高清图 静态为主的网页往往用get方法就能获取页面所有内容.动态网页即异步请求数据的网页则需要用浏览器加载完成后再进行抓取.本文介绍了如何连续爬取瀑布流网页 ...

- Python爬虫爬取美剧网站

一直有爱看美剧的习惯,一方面锻炼一下英语听力,一方面打发一下时间.之前是能在视频网站上面在线看的,可是自从广电总局的限制令之后,进口的美剧英剧等貌似就不在像以前一样同步更新了.但是,作为一个宅diao ...

随机推荐

- 【专题教程第8期】基于emWin模拟器的USB BULK上位机开发,仅需C即可,简单易实现

说明:1.如果你会emWin话的,就可以轻松制作上位机.做些通信和控制类上位机,比使用C#之类的方便程度一点不差,而且你仅会C语言就可以.2.并且成功将emWin人性化,可以做些Windows系统上的 ...

- windows下 jdk1.7安装教程图解

java编程的初学者在开始编码前都会遇到一个难题,那就是jdk1.7环境变量配置怎么操作,怎么安装,针对这个难题,小编特地为大家整理相关教程,不了解的朋友可以前往查看使用. 软件说明 虽然现在jdk出 ...

- 从壹开始前后端分离【 .NET Core2.0 +Vue2.0 】框架之十二 || 三种跨域方式比较,DTOs(数据传输对象)初探

更新反馈 1.博友@落幕残情童鞋说到了,Nginx反向代理实现跨域,因为我目前还没有使用到,给忽略了,这次记录下,为下次补充.此坑已填 2.提示:跨域的姊妹篇——<三十三║ ⅖ 种方法实现完美跨 ...

- 多元线性回归公式推导及R语言实现

多元线性回归 多元线性回归模型 实际中有很多问题是一个因变量与多个自变量成线性相关,我们可以用一个多元线性回归方程来表示. 为了方便计算,我们将上式写成矩阵形式: Y = XW 假设自变量维度为N W ...

- Chrome浏览器下自动填充的输入框背景

记录下从张鑫旭老师的微博中看到关于input输入框的属性 1.autocomplete="off" autocomplete 属性规定输入字段是否应该启用自动完成功能 自动完成允许 ...

- swagger文档转换为WebApiClient声明式代码

1 swagger简介 Swagger是一个规范且完整的框架,提供描述.生产.消费和可视化RESTful Web Service.其核心是使用json来规范描述RESTful接口,另外有提供UI来查看 ...

- [JavaScript] Cookie,localStorage,sessionStorage概述

Cookie Cookie 是一些数据, 存储于你电脑上的文本文件中,当 web 服务器向浏览器发送 web 页面时,在连接关闭后,服务端不会记录用户的信息.Cookie 的作用就是存储 web 页面 ...

- Unity 3D游戏开发学习路线(方法篇)

Unity 3D本来是由德国的一些苹果粉丝开发的一款游戏引擎,一直只能用于Mac平台,所以一直不被业外人士所知晓.但是后来也推出了2.5版,同时发布了PC版本,并将其发布方向拓展到手持移动设备.Uni ...

- MySQL 笔记整理(17) --如何正确地显示随机消息?

笔记记录自林晓斌(丁奇)老师的<MySQL实战45讲> (本篇内图片均来自丁奇老师的讲解,如有侵权,请联系我删除) 17) --如何正确地显示随机消息? 如果有这么一个英语单词表,需要每次 ...

- revit二次开发wpf里button按钮无法实现事务

不能在revit提供的api外部使用事务,解决此方法, 1.把button里要实现的功能写到外部事件IExternalEventHandler中,注册外部事件,在button事件中.raise()使用 ...