基于python的scrapy框架爬取豆瓣电影及其可视化

1.Scrapy框架介绍

主要介绍,spiders,engine,scheduler,downloader,Item pipeline

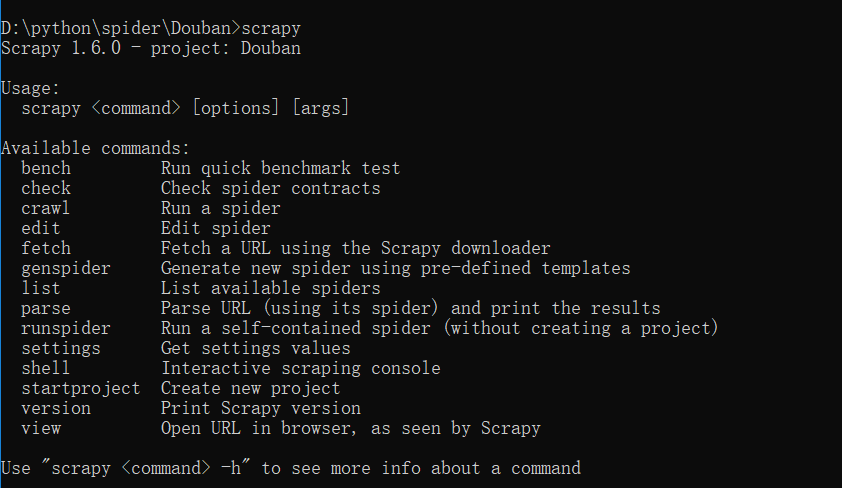

scrapy常见命令如下:

对应在scrapy文件中有,自己增加爬虫文件,系统生成items,pipelines,setting的配置文件就这些。

items写需要爬取的属性名,pipelines写一些数据流操作,写入文件,还是导入数据库中。主要爬虫文件写domain,属性名的xpath,在每页添加属性对应的信息等。

movieRank = scrapy.Field()

movieName = scrapy.Field()

Director = scrapy.Field()

movieDesc = scrapy.Field()

movieRate = scrapy.Field()

peopleCount = scrapy.Field()

movieDate = scrapy.Field()

movieCountry = scrapy.Field()

movieCategory = scrapy.Field()

moviePost = scrapy.Field()

import json class DoubanPipeline(object):

def __init__(self):

self.f = open("douban.json","w",encoding='utf-8') def process_item(self, item, spider):

content = json.dumps(dict(item),ensure_ascii = False)+"\n"

self.f.write(content)

return item def close_spider(self,spider):

self.f.close()

这里xpath使用过程中,安利一个chrome插件xpathHelper。

allowed_domains = ['douban.com']

baseURL = "https://movie.douban.com/top250?start="

offset = 0

start_urls = [baseURL + str(offset)] def parse(self, response):

node_list = response.xpath("//div[@class='item']") for node in node_list:

item = DoubanItem()

item['movieName'] = node.xpath("./div[@class='info']/div[1]/a/span/text()").extract()[0]

item['movieRank'] = node.xpath("./div[@class='pic']/em/text()").extract()[0]

item['Director'] = node.xpath("./div[@class='info']/div[@class='bd']/p[1]/text()[1]").extract()[0]

if len(node.xpath("./div[@class='info']/div[@class='bd']/p[@class='quote']/span[@class='inq']/text()")):

item['movieDesc'] = node.xpath("./div[@class='info']/div[@class='bd']/p[@class='quote']/span[@class='inq']/text()").extract()[0]

else:

item['movieDesc'] = "" item['movieRate'] = node.xpath("./div[@class='info']/div[@class='bd']/div[@class='star']/span[@class='rating_num']/text()").extract()[0]

item['peopleCount'] = node.xpath("./div[@class='info']/div[@class='bd']/div[@class='star']/span[4]/text()").extract()[0]

item['movieDate'] = node.xpath("./div[2]/div[2]/p[1]/text()[2]").extract()[0].lstrip().split('\xa0/\xa0')[0]

item['movieCountry'] = node.xpath("./div[2]/div[2]/p[1]/text()[2]").extract()[0].lstrip().split('\xa0/\xa0')[1]

item['movieCategory'] = node.xpath("./div[2]/div[2]/p[1]/text()[2]").extract()[0].lstrip().split('\xa0/\xa0')[2]

item['moviePost'] = node.xpath("./div[@class='pic']/a/img/@src").extract()[0]

yield item if self.offset <250:

self.offset += 25

url = self.baseURL+str(self.offset)

yield scrapy.Request(url,callback = self.parse)

这里基本可以爬虫,产生需要的json文件。

接下来是可视化过程。

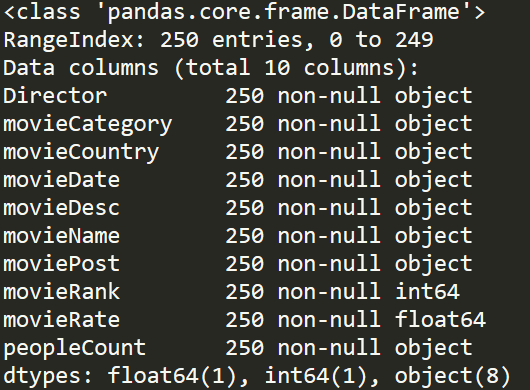

我们先梳理一下,我们掌握的数据情况。

douban = pd.read_json('douban.json',lines=True,encoding='utf-8')

douban.info()

基本我们可以分析,电影国家产地,电影拍摄年份,电影类别以及一些导演在TOP250中影响力。

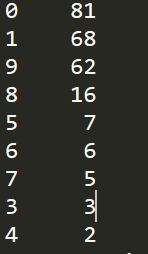

先做个简单了解,可以使用value_counts()函数。

douban = pd.read_json('douban.json',lines=True,encoding='utf-8')

df_Country = douban['movieCountry'].copy()

for i in range(len(df_Country)):

item = df_Country.iloc[i].strip()

df_Country.iloc[i] = item[0]

print(df_Country.value_counts())

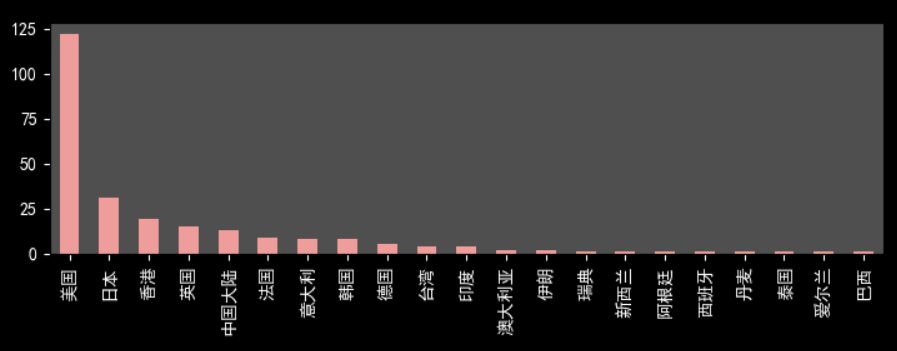

美国电影占半壁江山,122/250,可以反映好莱坞电影工业之强大。同样,日本电影和香港电影在中国也有着重要地位。令人意外是,中国大陆地区电影数量不是令人满意。豆瓣影迷对于国内电影还是非常挑剔的。

douban = pd.read_json('douban.json',lines=True,encoding='utf-8')

df_Date = douban['movieDate'].copy()

for i in range(len(df_Date)):

item = df_Date.iloc[i].strip()

df_Date.iloc[i] = item[2]

print(df_Date.value_counts())

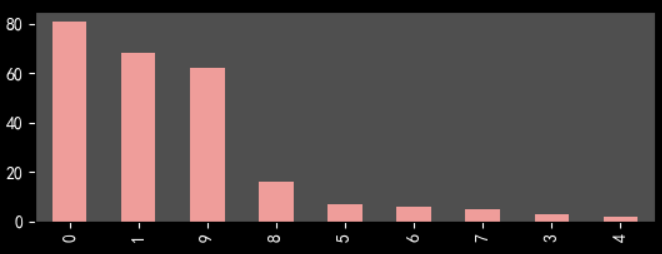

2000年以来电影数目在70%以上,考虑10代才过去9年和打分滞后性,总体来说越新的电影越能得到受众喜爱。这可能和豆瓣top250选取机制有关,必须人数在一定数量以上。

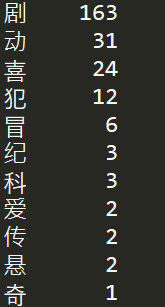

douban = pd.read_json('douban.json',lines=True,encoding='utf-8')

df_Cate = douban['movieCategory'].copy()

for i in range(len(df_Cate)):

item = df_Cate.iloc[i].strip()

df_Cate.iloc[i] = item[0]

print(df_Cate.value_counts())

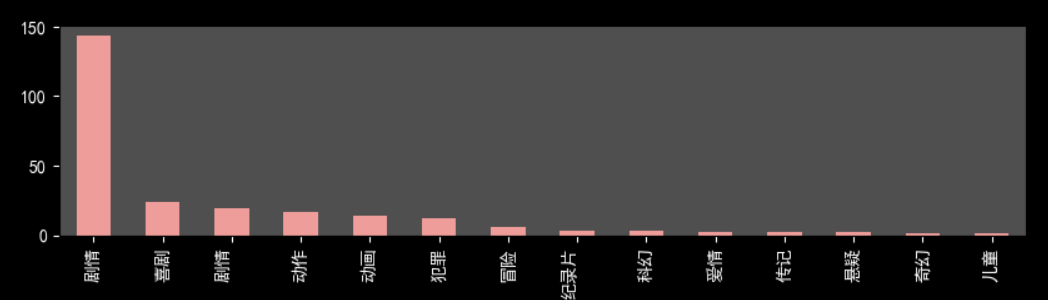

剧情电影情节起伏更容易得到观众认可。

下面展示几张可视化图片

不太会用python进行展示,有些难看。其实,推荐用Echarts等插件,或者用Excel,BI软件来处理图片,比较方便和美观。

第一次做这种爬虫和可视化,多有不足之处,恳请指出。

基于python的scrapy框架爬取豆瓣电影及其可视化的更多相关文章

- Python爬虫入门:爬取豆瓣电影TOP250

一个很简单的爬虫. 从这里学习的,解释的挺好的:https://xlzd.me/2015/12/16/python-crawler-03 分享写这个代码用到了的学习的链接: BeautifulSoup ...

- Python使用Scrapy框架爬取数据存入CSV文件(Python爬虫实战4)

1. Scrapy框架 Scrapy是python下实现爬虫功能的框架,能够将数据解析.数据处理.数据存储合为一体功能的爬虫框架. 2. Scrapy安装 1. 安装依赖包 yum install g ...

- scrapy框架爬取豆瓣读书(1)

1.scrapy框架 Scrapy,Python开发的一个快速.高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构化的数据.Scrapy用途广泛,可以用于数据挖掘.监测和自动化测试 ...

- Python的scrapy之爬取豆瓣影评和排名

基于scrapy框架的爬影评 爬虫主程序: import scrapy from ..items import DoubanmovieItem class MoviespiderSpider(scra ...

- python爬虫scrapy框架——爬取伯乐在线网站文章

一.前言 1. scrapy依赖包: 二.创建工程 1. 创建scrapy工程: scrapy staratproject ArticleSpider 2. 开始(创建)新的爬虫: cd Artic ...

- python利用scrapy框架爬取起点

先上自己做完之后回顾细节和思路的东西,之后代码一起上. 1.Mongodb 建立一个叫QiDian的库,然后建立了一个叫Novelclass(小说类别表)Novelclass(可以把一级类别二级类别都 ...

- python scrapy框架爬取豆瓣

刚刚学了一下,还不是很明白.随手记录. 在piplines.py文件中 将爬到的数据 放到json中 class DoubanmoviePipelin2json(object):#打开文件 open_ ...

- 初识python 之 爬虫:爬取豆瓣电影最热评论

主要用到lxml的etree解析网页代码,xpath获取HTML标签. 代码如下: 1 #!/user/bin env python 2 # author:Simple-Sir 3 # time:20 ...

- scrapy爬虫框架教程(二)-- 爬取豆瓣电影TOP250

scrapy爬虫框架教程(二)-- 爬取豆瓣电影TOP250 前言 经过上一篇教程我们已经大致了解了Scrapy的基本情况,并写了一个简单的小demo.这次我会以爬取豆瓣电影TOP250为例进一步为大 ...

随机推荐

- Java阶段性总结与获奖感想

一.获奖感想 这次能获得小黄衫,可以说是对我自己这半学期以来努力学习的一种肯定,也是激励我继续努力的动力. 首先,我要感谢给予我们耳目一新的学习方式的娄老师.我曾在我期望的师生关系中提到,我的高中班主 ...

- 【转】Android SDK,ADT,API 版本的对应关系

写对应关系之前,先了解一下几个名字的含义. 一. Android ADT: 按照官方网站的开发介绍:Android Development Tools (ADT) is a plugin for th ...

- 【转】PHP面试题总结

PHP面试总结 PHP基础 1:变量的传值与引用. 2:变量的类型转换和判断类型方法. 3:php运算符优先级,一般是写出运算符的运算结果. 4:PHP中函数传参,闭包,判断输出的echo,print ...

- 20145203盖泽双 《Java程序设计》第十周学习总结

20145203盖泽双 <Java程序设计>第十周学习总结 教材学习内容总结 一.网络概述 1.网络编程就是两个或多个设备(程序)之间的数据交换. 2.识别网络上的每个设备:①IP地址②域 ...

- Ubuntu16.04如何彻底删除Apache2

虽然作为运维人员通常情况不建议随意删除Linux系统上面的任何软件,主要指生产环境下,测试环境也不能太随意. 但是有的时候,比如系统环境要变一变,我们就需要替换一些淘汰的软件,对此我们一般都会删除. ...

- 定义抽象类Shape,抽象方法为showArea(),求出面积并显示,定义矩形类Rectangle,正方形类Square,圆类 Circle,根据各自的属性,用showArea方法求出各自的面积,在main方法中构造3个对象,调用showArea方法。(体现多态)

实现多态的三个条件:1.要有继承2.要有抽象方法重写3.用父类指针(引用)指向子类对象 重载重写重定义的区别: 1.重载:在同一个类中进行; 编译时根据参数类型和个数决定方法调用; 子类无法重载父类; ...

- CentOS中配置xrdp,通过微软远程桌面访问CentOS桌面

环境:CentOS 6.4 1.安装相关软件 yum groupinstall "Desktop" (已安装桌面的就可以缺略这条命令) yum install xrdp yum i ...

- 前端获取table表格里面的所有(单个)tr和所有(单个)td,用js实现

今天在做项目遇到了一个问题,就是获取不到table里面的td. 本来是打算使用jq来解决的,但网上大部分人使用的都是获取到table标签然后点出他的children函数,我的前端页面没有这个函数,然后 ...

- mysql5.7.22 下载过程

进入官网www.mysql.com ,选择downloads: 选择 Community 再选择MySQL community server 选择5.7的版本,这个看自己选择,有问题看标题 选择5.7 ...

- 五、Delphi10.3通过REST单元使类和JSON数据互相转换

一.我们定义一个简单的类 TPeople = class private FName: string; FScore: Integer; FAge: TDateTime; public propert ...