073 HBASE的读写以及client API

一:读写思想

1.系统表

hbase:namespace

存储hbase中所有的namespace的信息

hbase:meta

rowkey:hbase中所有表的region的名称

column:regioninfo:region的名称,region的范围

server:该region在哪台regionserver上

2.读写流程

tbname,rowkey -> region -> regionserver -> store -> storefile

但是这些都是加载过meta表之后,然后meta表如何寻找?

3.读的流程

-》根据表名和rowkey找到对应的region

-》zookeeper中存储了meta表的region信息

-》从meta表中获取相应的region的信息

-》找到对应的regionserver

-》查找对应的region

-》读memstore

-》storefile

4.写的流程

-》根据表名和rowkey找到对应的region

-》zookeeper中存储了meta表的region信息

-》从meta表中获取相应的region的信息

-》找到对应的regionserver

-》正常情况

-》WAL(write ahead log预写日志),一个regionserver维护一个hlog

-》memstore (达到一定大小,flush到磁盘)

-》当多个storefile达到一定大小以后,会进行compact,合并成一个storefile

-》当单个storefile达到一定大小以后,会进行split操作,等分割region

5.注意点

关于版本的合并和删除是在compact阶段完成的。hbase只负责数据的增加存储

hmaster短暂的不参与实际的读写

二:HBase Client API 的书写

1.添加依赖

2.添加配置文件

core-site.xml

hdfs-site.xml

hbase-site.xml

log4j.properties

regionservers

3.get的书写

4.put的书写

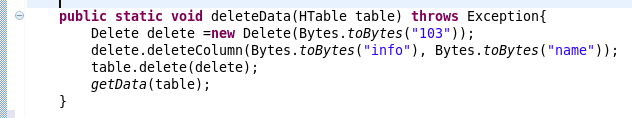

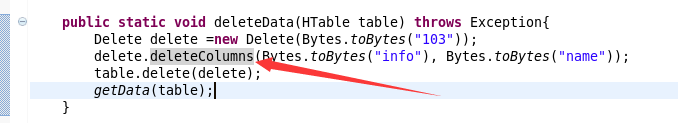

5.delete的书写

注意全部删除:

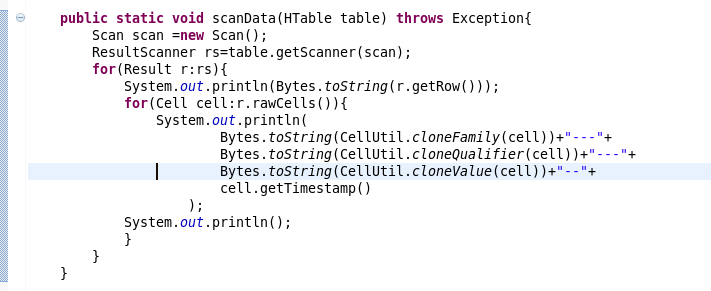

6.scan的书写

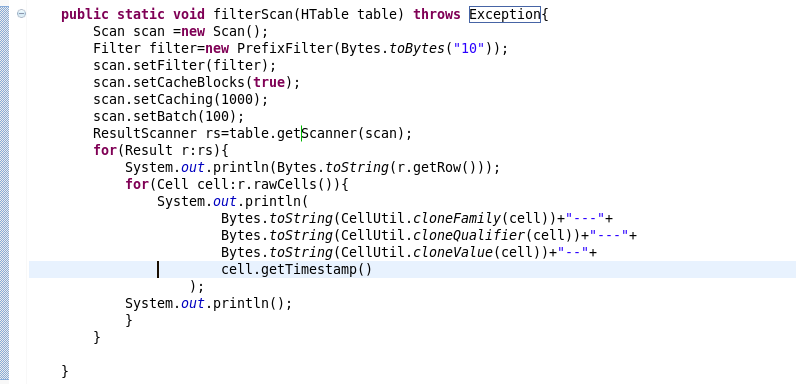

7.过滤条件的scan的书写

三:复制源代码

package com.beifeng.bigdat; import java.io.IOException; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.hbase.Cell;

import org.apache.hadoop.hbase.CellUtil;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.client.Delete;

import org.apache.hadoop.hbase.client.Get;

import org.apache.hadoop.hbase.client.HTable;

import org.apache.hadoop.hbase.client.Put;

import org.apache.hadoop.hbase.client.Result;

import org.apache.hadoop.hbase.client.ResultScanner;

import org.apache.hadoop.hbase.client.Scan;

import org.apache.hadoop.hbase.filter.Filter;

import org.apache.hadoop.hbase.filter.PrefixFilter;

import org.apache.hadoop.hbase.util.Bytes; public class HbaseClientTest {

public static HTable getTable(String name) throws Exception{

Configuration conf=HBaseConfiguration.create();

HTable table=new HTable(conf,name);

return table; }

public static void getData(HTable table) throws Exception{

Get get=new Get(Bytes.toBytes("103"));

get.addFamily(Bytes.toBytes("info"));

Result rs=table.get(get);

for(Cell cell:rs.rawCells()){

System.out.println(

Bytes.toString(CellUtil.cloneFamily(cell))+"--"+

Bytes.toString(CellUtil.cloneQualifier(cell))+"---"+

Bytes.toString(CellUtil.cloneValue(cell))+"----"+

cell.getTimestamp()

);

System.out.println("----------------------------------------------");

}

} public static void putData(HTable table) throws Exception{

Put put=new Put(Bytes.toBytes("103"));

put.add(Bytes.toBytes("info"),

Bytes.toBytes("name"),

Bytes.toBytes("zhaoliu"));

table.put(put);

getData(table);

} public static void deleteData(HTable table) throws Exception{

Delete delete =new Delete(Bytes.toBytes("103"));

delete.deleteColumns(Bytes.toBytes("info"), Bytes.toBytes("name"));

table.delete(delete);

getData(table);

} public static void scanData(HTable table) throws Exception{

Scan scan =new Scan();

ResultScanner rs=table.getScanner(scan);

for(Result r:rs){

System.out.println(Bytes.toString(r.getRow()));

for(Cell cell:r.rawCells()){

System.out.println(

Bytes.toString(CellUtil.cloneFamily(cell))+"---"+

Bytes.toString(CellUtil.cloneQualifier(cell))+"---"+

Bytes.toString(CellUtil.cloneValue(cell))+"--"+

cell.getTimestamp()

);

System.out.println();

}

}

} public static void filterScan(HTable table) throws Exception{

Scan scan =new Scan();

Filter filter=new PrefixFilter(Bytes.toBytes("10"));

scan.setFilter(filter);

scan.setCacheBlocks(true);

scan.setCaching(1000);

scan.setBatch(100);

ResultScanner rs=table.getScanner(scan);

for(Result r:rs){

System.out.println(Bytes.toString(r.getRow()));

for(Cell cell:r.rawCells()){

System.out.println(

Bytes.toString(CellUtil.cloneFamily(cell))+"---"+

Bytes.toString(CellUtil.cloneQualifier(cell))+"---"+

Bytes.toString(CellUtil.cloneValue(cell))+"--"+

cell.getTimestamp()

);

System.out.println();

}

} } public static void main(String[] args) throws Exception {

HTable table=getTable("nstest1:tb1");

//getData(table);

//putData(table);

//deleteData(table);

//scanData(table);

filterScan(table);

} }

073 HBASE的读写以及client API的更多相关文章

- HBASE的读写以及client API

一:读写思想 1.系统表 hbase:namespace 存储hbase中所有的namespace的信息 hbase:meta rowkey:hbase中所有表的region的名称 column:re ...

- HBase 二次开发 java api和demo

1. 试用thrift python/java以及hbase client api.结论例如以下: 1.1 thrift的安装和公布繁琐.可能会遇到未知的错误,且hbase.thrift的版本 ...

- hbase的读写过程

hbase的读写过程: hbase的架构: Hbase真实数据hbase真实数据存储在hdfs上,通过配置文件的hbase.rootdir属性可知,文件在/user/hbase/下hdfs dfs - ...

- Hbase的读写流程

HBase读写流程 1.HBase读数据流程 HRegionServer保存着meta表以及表数据,要访问表数据,首先Client先去访问zookeeper,从zookeeper里面获取meta表所在 ...

- HBase 数据读写流程

HBase 数据读写流程 2016-10-18 杜亦舒 读数据 HBase的表是按行拆分为一个个 region 块儿,这些块儿被放置在各个 regionserver 中 假设现在想在用户表中获取 ro ...

- ecshop /api/client/api.php、/api/client/includes/lib_api.php SQL Injection Vul

catalog . 漏洞描述 . 漏洞触发条件 . 漏洞影响范围 . 漏洞代码分析 . 防御方法 . 攻防思考 1. 漏洞描述 ECShop存在一个盲注漏洞,问题存在于/api/client/api. ...

- Memcached Java Client API详解

针对Memcached官方网站提供的java_memcached-release_2.0.1版本进行阅读分析,Memcached Java客户端lib库主要提供的调用类是SockIOPool和MemC ...

- Jersey(1.19.1) - Client API, Uniform Interface Constraint

The Jersey client API is a high-level Java based API for interoperating with RESTful Web services. I ...

- Jersey(1.19.1) - Client API, Ease of use and reusing JAX-RS artifacts

Since a resource is represented as a Java type it makes it easy to configure, pass around and inject ...

随机推荐

- <hr />改变颜色

其实,<hr />是有默认的border的,改变border颜色即可改变hr颜色. 例如: <hr style="position: relative;top: 2.3re ...

- sqlite limit offset

limit 0,20 表示从第1条开始取20条数据 limit 20 offset 2 表示从第2条开始取出20条数据

- 课程4:黑马程序员_spring2.5视频教程--视频列表

\黑马程序员_spring2.5视频教程\01Struts相关基础理论介绍.mp4; \黑马程序员_spring2.5视频教程\02搭建struts开发环境.mp4; \黑马程序员_spring2.5 ...

- windows cmd相关操作

一:文件夹1. 新建文件夹方式一:md[盘符:\][路径\]新目录例如:md c:\test\newtest 方式二:先使用cmd进入需要新建文件的根目录下,使用md或者mkdir 直接创建文件夹ne ...

- HTML中Meta标签中http-equiv属性

HTML中Meta标签中http-equiv的用法: <meta http-equiv="这里是参数" content="这里是参数值"> 1.Ex ...

- 【Python】批量查询-提取站长之家IP批量查询的结果加强版本v3.0

1.工具说明 写报告的时候为了细致性,要把IP地址对应的地区给整理出来.500多条IP地址找出对应地区复制粘贴到报告里整了一个上午. 为了下次更好的完成这项重复性很高的工作,所以写了这个小的脚本. 某 ...

- C# 关于用7zip压缩文件提示win32exception 系统找不到文件解决方案(win7 x64)

网上已经很多这方面的资料了,我就简单的说下好了 为了方便以后的查看 --------------------- 1.需要下载7zSharp:http://7zsharp.codeplex.com/re ...

- C++ virtual函数重写,在继承的时候没有在函数前写virtual关键字也依然是虚函数吗?

比如: class Base { Base() {}; ~Base() {}; virtual void Init(); }; class Derived:public Base { virtual ...

- Day5----------------------文件合并与文件归档

一.文件合并 1.命令: >:覆盖式 >>:追加式 例如:cat /etc/passwd > a.txt 把/etc/passwd下的内容合并到a.txt内,若没有文 ...

- Java内存泄漏问题

1:java中垃圾回收机制主要完成下面两件事情: 跟踪并监控每个java对象,当某个对象处于不可达状态时,回收该对象所占的内存 清理内存分配,回收过程中产生的内存碎片 2:对于JVM的垃圾回收机制来说 ...