流式大数据计算实践(7)----Hive安装

一、前言

1、这一文学习使用Hive

二、Hive介绍与安装

Hive介绍:Hive是基于Hadoop的一个数据仓库工具,可以通过HQL语句(类似SQL)来操作HDFS上面的数据,其原理就是将用户写的HQL语句转换成MapReduce任务去执行,这样不用开发者去写繁琐的MapReduce程序,直接编写简单的HQL语句,降低了很多学习成本。由于Hive实际上是执行MapReduce,所以Hive的查询速度较慢,不适合用于实时的计算任务

1、下载Hive的tar包,并解压

tar zxvf /work/soft/installer/apache-hive-2.3.-bin.tar.gz

2、配置环境变量

vim /etc/profile #set hive env

export HIVE_HOME=/work/soft/apache-hive-2.3.-bin

export PATH=$PATH:$HIVE_HOME/bin source /etc/profile

3、修改配置文件(进入Hive的config目录)

(1)先把模板配置文件复制一份,并编辑(配置一些目录,以及将数据库引擎换成MySQL,这里需要有MySQL环境)

cp hive-default.xml.template hive-site.xml

(2)配置的hdfs目录手动创建

hadoop fs -mkdir -p /user/hive/warehouse

hadoop fs -mkdir -p /user/hive/tmp

hadoop fs -mkdir -p /user/hive/log

(3)将配置文件中的${system:java.io.tmpdir}全部替换成/work/tmp(要记得创建目录)

(4)将配置文件中的${system:user.name}全部替换成${user.name}

(5)下面配置中,配置MySQL驱动的包名,如果像我一样使用高版本的驱动,包名注意是(com.mysql.cj.jdbc.Driver)

cp hive-default.xml.template hive-site.xml <property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive/warehouse</value>

<description>location of default database for the warehouse</description>

</property>

<property>

<name>hive.exec.scratchdir</name>

<value>/user/hive/tmp</value>

<description>HDFS root scratch dir for Hive jobs which gets created with write all () permission. For each connecting user, an HDFS scratch dir: ${hive.exec.scratchdir}/<username> is created, with ${hive.scratch.dir.permission}.</description>

</property>

<property>

<name>hive.querylog.location</name>

<value>/user/hive/log/hadoop</value>

<description>Location of Hive run time structured log file</description>

</property>

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://192.168.3.123:3306/myhive?createDatabaseIfNotExist=true&serverTimezone=UTC</value>

<description>

JDBC connect string for a JDBC metastore.

To use SSL to encrypt/authenticate the connection, provide database-specific SSL flag in the connection URL.

For example, jdbc:postgresql://myhost/db?ssl=true for postgres database.

</description>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.cj.jdbc.Driver</value>

<description>Driver class name for a JDBC metastore</description>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>Username to use against metastore database</description>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value></value>

<description>password to use against metastore database</description>

</property>

(5)下载好MySQL的驱动包(mysql-connector-java-8.0.13.jar),并放到lib目录下

(6)接下来修改脚本文件,同样将模板复制一份并编辑

cp hive-env.sh.template hive-env.sh HADOOP_HOME=/work/soft/hadoop-2.6. export HIVE_CONF_DIR=/work/soft/apache-hive-2.3.-bin/conf

三、Hive启动

1、首先初始化MySQL,进入到bin目录下,执行初始化命令

bash schematool -initSchema -dbType mysql

2、看到如下打印,说明初始化ok

3、启动之前先设置一下HDFS的目录权限,改成777(可读可写可执行)

hadoop fs -chmod -R /

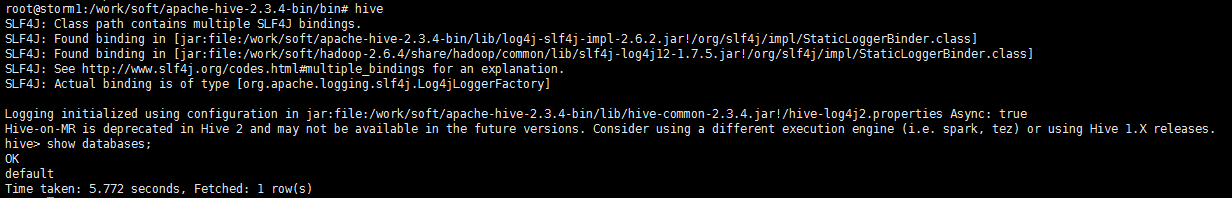

4、执行命令启动Hive,见到如下打印,说明启动ok

hive show databases;

流式大数据计算实践(7)----Hive安装的更多相关文章

- 流式大数据计算实践(1)----Hadoop单机模式

一.前言 1.从今天开始进行流式大数据计算的实践之路,需要完成一个车辆实时热力图 2.技术选型:HBase作为数据仓库,Storm作为流式计算框架,ECharts作为热力图的展示 3.计划使用两台虚拟 ...

- 流式大数据计算实践(6)----Storm简介&使用&安装

一.前言 1.这一文开始进入Storm流式计算框架的学习 二.Storm简介 1.Storm与Hadoop的区别就是,Hadoop是一个离线执行的作业,执行完毕就结束了,而Storm是可以源源不断的接 ...

- 流式大数据计算实践(5)----HBase使用&SpringBoot集成

一.前言 1.上文中我们搭建好了一套HBase集群环境,这一文我们学习一下HBase的基本操作和客户端API的使用 二.shell操作 先通过命令进入HBase的命令行操作 /work/soft/hb ...

- 流式大数据计算实践(4)----HBase安装

一.前言 1.前面我们搭建好了高可用的Hadoop集群,本文正式开始搭建HBase 2.HBase简介 (1)Master节点负责管理数据,类似Hadoop里面的namenode,但是他只负责建表改表 ...

- 流式大数据计算实践(3)----高可用的Hadoop集群

一.前言 1.上文中我们已经搭建好了Hadoop和Zookeeper的集群,这一文来将Hadoop集群变得高可用 2.由于Hadoop集群是主从节点的模式,如果集群中的namenode主节点挂掉,那么 ...

- 流式大数据计算实践(2)----Hadoop集群和Zookeeper

一.前言 1.上一文搭建好了Hadoop单机模式,这一文继续搭建Hadoop集群 二.搭建Hadoop集群 1.根据上文的流程得到两台单机模式的机器,并保证两台单机模式正常启动,记得第二台机器core ...

- 大数据系列之数据仓库Hive安装

Hive系列博文,持续更新~~~ 大数据系列之数据仓库Hive原理 大数据系列之数据仓库Hive安装 大数据系列之数据仓库Hive中分区Partition如何使用 大数据系列之数据仓库Hive命令使用 ...

- 大数据系列之数据仓库Hive命令使用及JDBC连接

Hive系列博文,持续更新~~~ 大数据系列之数据仓库Hive原理 大数据系列之数据仓库Hive安装 大数据系列之数据仓库Hive中分区Partition如何使用 大数据系列之数据仓库Hive命令使用 ...

- 大数据系列之数据仓库Hive原理

Hive系列博文,持续更新~~~ 大数据系列之数据仓库Hive原理 大数据系列之数据仓库Hive安装 大数据系列之数据仓库Hive中分区Partition如何使用 大数据系列之数据仓库Hive命令使用 ...

随机推荐

- CMD 中常见命令

引自百度经验:https://jingyan.baidu.com/article/67508eb41d44a09cca1ce4f1.html ipConfig:查询ip ping:查询连接速度: pi ...

- jsonp 请求

$.ajax()方法详解 $.ajax() 方法详解:来源 http://www.cnblogs.com/tylerdonet/p/3520862.html jsonp 调用 无法进入 success ...

- Python函数式编程之闭包

-------------------------函数式编程之*******闭包------------------------ Note: 一:简介 函数式编程不是程序必须要的,但是对于简化程序有很 ...

- Android Studio 直播弹幕

我只是搬运:https://blog.csdn.net/HighForehead/article/details/55520199 写的很好很详细,挺有参考价值的 demo直通车:https://do ...

- spring MVC 的MultipartFile转File读取

转自:http://www.cnblogs.com/hahaxiaoyu/p/5102900.html 第一种方法: MultipartFile file = xxx; Commo ...

- OJ002

register:这个关键字请求编译器尽可能的将变量存在CPU内部寄存器中,而不是通过内存寻址访问,以提高效率.注意是尽可能,不是绝对. 因为,如果定义了很多register变量,可能会超过CPU的寄 ...

- qt5.4解决输出中文乱码问题

需要在字符串前添加 QString::fromUtf8 例: b2 = new QPushButton(this); b2->setText(QString::fromUtf8("变化 ...

- JDK、JRE

JRE: java Runtime environment (java运行环境) JVM:java virtual machine (java 虚拟机) java程序就在jvm中运行. JDK: ja ...

- [Swift]LeetCode28. 实现strStr() | Implement strStr()

Implement strStr(). Return the index of the first occurrence of needle in haystack, or -1 if needle ...

- [Swift]LeetCode125. 验证回文串 | Valid Palindrome

Given a string, determine if it is a palindrome, considering only alphanumeric characters and ignori ...