Sqoop(三)将关系型数据库中的数据导入到HDFS(包括hive,hbase中)

一、说明:

将关系型数据库中的数据导入到 HDFS(包括 Hive, HBase) 中,如果导入的是 Hive,那么当 Hive 中没有对应表时,则自动创建。

二、操作

1、创建一张跟mysql中的im表一样的hive表im:

sqoop create-hive-table \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--hive-table im

过程中报错总结:

ERROR Could not register mbeans java.security.AccessControlException: access denied

("javax.management.MBeanTrustPermission" "register

解决方法:

1、将hive-site.xml复制到${SQOOP_HOME}/conf下

2、vim $JAVA_HOME/jre/lib/security/java.policy:

在grant{}内部添加如下内容:

permission javax.management.MBeanTrustPermission "register";

Could not load org.apache.hadoop.hive.conf.HiveConf. Make sure HIVE_CONF_DIR

解决方法:

将hive 里面的lib下的hive-exec-**.jar 放到sqoop 的lib 下

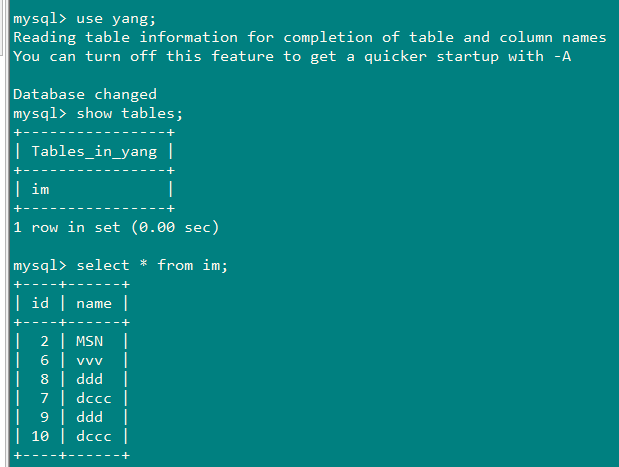

2、将mysql中的数据导入到HDFS

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209\

--table im \

-m 1

3、将mysql中的数据导入到HDFS(按照指定分隔符和路径进行导入)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--target-dir /test/ \

--fields-terminated-by ',' \

-m 1

4、将mysql中的数据导入到HDFS(带where条件)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--where "name='dccc'" \

--table im \

--target-dir /test/ \

-m 1

带where条件,查询指定列(相当于select name from im where name="dccc")

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--columns "name" \

--where "name='dccc'" \

--table im \

--target-dir /test/ \

-m 1

5、将mysql中的数据导入到HDFS(自定义查询SQL)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--target-dir /test/ \

--query 'select id,name from im where $CONDITIONS ' \

--split-by id \

--fields-terminated-by '\t' \

-m 2

说明:

--split-by:

1.split-by 根据不同的参数类型有不同的切分方法,如int型,Sqoop会取最大和最小split-by字段值,然后根据传入的num-mappers来 确定划分几个区域。比如select max(split_by),min(split-by) from得到的max(split-by)和min(split-by)分别为1000和1,而num-mappers(-m)为2的话,则会分成两个区域 (1,500)和(501-1000),同时也会分成2个sql给2个map去进行导入操作,分别为select XXX from table where split-by>=1 and split-by<500和select XXX from table where split-by>=501 and split-by<=1000.最后每个map各自获取各自SQL中的数据进行导入工作。

2.当split-by不是int型时出现如上场景中的问题。目前想到的解决办法是:将-m 设置称1,split-by不设置,即只有一个map运行,缺点是不能并行map录入数据。(注意,当-m 设置的值大于1时,split-by必须设置字段)

3.split-by即便是int型,若不是连续有规律递增的话,各个map分配的数据是不均衡的,可能会有些map很忙,有些map几乎没有数据处理的情况

CONDITIONS:

SQoop Query imports自由查询模式下$CONDITIONS的作用:

1、必须制定目标文件的位置:--target-dir

2、必须使用$CONDITIONS关键字

3、选择使用--split-by分片(分区,结果分成多个小文件)

6、将mysql中的数据导入到Hive

sqoop import --connect jdbc:mysql://192.168.200.100:3306/yang --username root --password 010209 --table im --hive-import -m 1

7、指定分隔符和列分隔符,指定hive-import,指定覆盖导入,指定自动创建Hive表,指定表名,指定删除中间结果数据目录

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--fields-terminated-by "\t" \

--lines-terminated-by "\n" \

--hive-import \

--hive-overwrite \

--create-hive-table \

--delete-target-dir \

--hive-database yang \

--hive-table im

-m 1

8、将Mysql数据库中的表数据导入到Hbase(普通导入)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--hbase-table im \

--column-family cf \

--hbase-row-key keyid

Sqoop(三)将关系型数据库中的数据导入到HDFS(包括hive,hbase中)的更多相关文章

- sqoop数据导入到Hdfs 或者hive

用java代码调用shell脚本执行sqoop将hive表中数据导出到mysql http://www.cnblogs.com/xuyou551/p/7999773.html 用sqoop将mysql ...

- 大数据入门到精通18--sqoop 导入关系库到hdfs中和hive表中

一,选择数据库,这里使用标准mysql sakila数据库 mysql -u root -D sakila -p 二.首先尝试把表中的数据导入到hdfs文件中,这样后续就可以使用spark来dataf ...

- Sqoop1.99.7将MySQL数据导入到HDFS中

准备 本示例将实现从MySQL数据库中将数据导入到HDFS中 参考文档: http://sqoop.apache.org/docs/1.99.7/user/Sqoop5MinutesDemo.html ...

- 如何使用免费控件将Word表格中的数据导入到Excel中

我通常使用MS Excel来存储和处理大量数据,但有时候经常会碰到一个问题—我需要的数据存储在word表格中,而不是在Excel中,这样处理起来非常麻烦,尤其是在数据比较庞大的时候, 这时我迫切地需要 ...

- 使用sqoop将MySQL数据库中的数据导入Hbase

使用sqoop将MySQL数据库中的数据导入Hbase 前提:安装好 sqoop.hbase. 下载jbdc驱动:mysql-connector-java-5.1.10.jar 将 mysql-con ...

- 如何将数据库中的数据导入到Solr中

要使用solr实现网站中商品搜索,需要将mysql数据库中数据在solr中创建索引. 1.需要在solr的schema.xml文件定义要存储的商品Field. 商品表中的字段为: 配置内容是: < ...

- phpexcel的写操作将数据库中的数据导入到excel中

这个版本据说是可以支持excel2007,但是我使用2007编辑的xlsx是无法获得该库的支持.于是乎我就将它转化为2003.感觉支持地很好. 下面介绍一下具体的使用: require_once('. ...

- 用ttBulkCp把excel中的数据导入到timesten数据库中

最近要做数据预处理,需要用到数据库.而且是以前从来没听说过的TimesTen. 首要目标是要把Excel里的数据,导入到TimesTen数据库中.而TimesTen在win10里用不了,于是我就在虚拟 ...

- 如何将redis中的数据导入到本地MongoDB和MySQL数据库

将redis中的数据导入到本地MongoDB数据库 创建一个process_items_mongodb.py文件(文件名自定义): #!/usr/bin/env python # -*- coding ...

随机推荐

- PyQt(Python+Qt)学习随笔:Qt Designer中部件的enabled属性

enabled属性非常简单,最开始老猿没准备介绍该属性的,因为大家都应该知道,但仔细看了看官网文章,觉得还是有些细节可能很少有人注意到,因此还是在此介绍一下. enabled属性用于表示部件是否可用, ...

- AWD不死马与克制方法

一个简单的不死马如: <?php ignore_user_abort(true); set_time_limit(0); unlink(__FILE__); $file = '.3.php'; ...

- linux c++ 内存泄漏检测工具:AddressSanitizer(ASan)

1.介绍 AddressSanitizer(ASan),该工具为gcc自带,4.8以上版本均可以使用. 2.使用 编译的方式很简单,只需要添加 -fsanitize=address -g 即可,如 g ...

- Pytorch训练时显存分配过程探究

对于显存不充足的炼丹研究者来说,弄清楚Pytorch显存的分配机制是很有必要的.下面直接通过实验来推出Pytorch显存的分配过程. 实验实验代码如下: import torch from torch ...

- python+eclipse 引用 import requests报错解决。

用pip install requests命令执行安装下 再重启eclipse就好了. 用pip install requests命令执行安装下 再重启eclipse就好了. 用pip install ...

- redis学习之——持久化RDB 和AOF

RDB: 在指定的时间间隔内将内存中的数据集快照写入磁盘, 也就是行话讲的Snapshot快照,它恢复时是将快照文件直接读到内存里.rdb 保存的是dump.rdb文件 RDB工作原理: Redis会 ...

- Mysql8.0新特性【详细版本】

1. 账户与安全 用户创建与授权 之前:创建用户并授权 1 grant all privileges on *.* to 'myuser'@'%' identified by '3edc#EDC'; ...

- IOS开发中实现UITableView按照首字母将集合进行检索分组

在开发公司项目中遇到了将图书目录进行按照首字母分组排序的问题 1.在项目添加解析汉字拼音的Pinyin.h文件 /* * pinyin.c */ #define HANZI_START 19968 # ...

- easyUI验证框赋值

下面来看看easyui的各种验证框赋值的方式: <input name="userId" id="userId" class="easyui-n ...

- pandas的学习2-选择数据

import pandas as pd import numpy as np dates = pd.date_range('20130101', periods=6) df = pd.DataFram ...