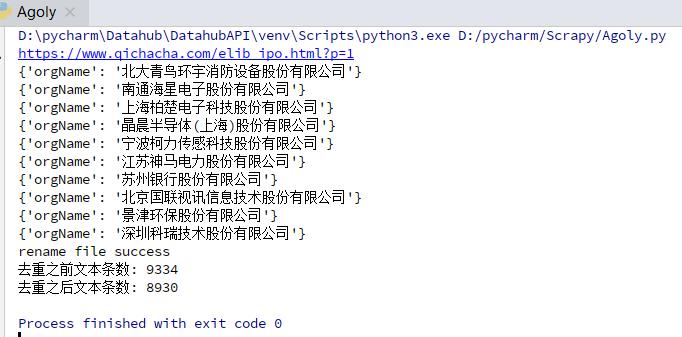

python爬取网业信息案例

需求:爬取网站上的公司信息

代码如下:

import json

import os

import shutil

import requests

import re

import time requests.packages.urllib3.disable_warnings() #通过url请求接口,获取返回数据

def getPage(url,headers):

try:

response = requests.get(url=url, headers=headers, verify=False)

response.encoding = 'utf-8'

if response.status_code == 200:

#print (response.text)

return response.text

else:

print('请求异常:{} status:{}'.format(url, response.status_code))

except Exception as e:

print('请求异常: {} error: {}'.format(url, e))

return None #删除文件的重复行

def file2uniq(file,destpath):

sum = 0

sum_pre = 0

addrs = set()

with open(file, 'r',encoding='utf8') as scan_file:

for line in scan_file.readlines():

sum_pre += 1

# addr = get_addr(line)

# line.decode('utf8')

addrs.add(line)

scan_file.close()

with open(destpath, 'w',encoding='utf8') as infile:

while len(addrs) > 0:

sum += 1

infile.write(addrs.pop())

infile.close() if (os.path.exists(file)):

os.remove(file)

try:

os.rename(destpath, file)

except Exception as e:

print (e)

print ('rename file fail\r')

else:

print ('rename file success\r')

#print(addrs)

print("去重之前文本条数: "+str(sum_pre))

print("去重之后文本条数: "+str(sum))

return sum_pre,sum #通过正则表达式提取页面内容

def parseHtml(html):

#pattern = re.compile(r'<tr> <td class="tx">.+\s(.+)', re.I) # 不区分大小写 匹配股票名称 # 不区分大小写 获取完整公司名

pattern = re.compile(r'<td class="text-center">.+</td> <td> <a href="/firm_.+">\s(.+)', re.I) # 获取证券公司

#pattern = re.compile(r'\t(.+)[\s]+</a> </td> <td class="text-center">.+</td> <td class="text-center">.+</td> </tr>', re.I)

#pattern = re.compile(r'\t(.+)\s\t\t\t\t\t\t\t </a> </td> <td class="text-center">.+</td> <td class="text-center">.+</td> </tr> <tr> <td class="tx">', re.I) # 不区分大小写

#pattern = re.compile(r'</a>\s</td>\s<td class="text-center">.+</td> <td> <a href="/firm_.+.html">\s(.+)[\s]+</a> </td> <td> <a href="/firm_.+.html">\s(.+)', re.I) # 不区分大小写 匹配股票名称 items = re.findall(pattern, html)

#print (items)

for item in items:

yield {

'orgName': item.strip(),

} def write2txt(content):

with open(file, 'a', encoding='utf-8') as f:

f.write(json.dumps(content, ensure_ascii=False) + '\n') def removeStr(old_str,new_str):

"""

with open('sanban.txt', 'a', encoding='utf-8') as fpr:

content = fpr.read()

content = content.replace(r'{"orgName": "', '')

content = content.replace(r'"}', '')

"""

file_data = ""

with open(file, 'r', encoding='utf-8') as f:

for line in f:

if old_str in line:

line = line.replace(old_str,new_str)

file_data += line

with open(file, 'w', encoding='utf-8') as f:

f.write(file_data) def main(page):

#url = 'https://www.qichacha.com/elib_sanban.html?p=' + str(page)

url = 'https://www.qichacha.com/elib_ipo.html?p=' + str(page) # https://www.qichacha.com/elib_ipo.html?p=2

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.100 Safari/537.36',

}

print (url)

html = getPage(url,headers)

#print (html)

for item in parseHtml(html):

print(item)

write2txt(item)

removeStr(r'{"orgName": "','')

removeStr(r'"}', '') file2uniq(file, destpath) if __name__ == '__main__':

file = r'orgName.txt'

#file = r'midOrg.txt'

#sourcepath = r'sanban.txt'

destpath = r'temp.txt'

for page in range(1,2):

main(page)

time.sleep(1)

python爬取网业信息案例的更多相关文章

- Python爬取网易云音乐歌手歌曲和歌单

仅供学习参考 Python爬取网易云音乐网易云音乐歌手歌曲和歌单,并下载到本地 很多人学习python,不知道从何学起.很多人学习python,掌握了基本语法过后,不知道在哪里寻找案例上手.很多已经做 ...

- 用Python爬取网易云音乐热评

用Python爬取网易云音乐热评 本文旨在记录Python爬虫实例:网易云热评下载 由于是从零开始,本文内容借鉴于各种网络资源,如有侵权请告知作者. 要看懂本文,需要具备一点点网络相关知识.不过没有关 ...

- Python爬取网易云热歌榜所有音乐及其热评

获取特定歌曲热评: 首先,我们打开网易云网页版,击排行榜,然后点击左侧云音乐热歌榜,如图: 关于如何抓取指定的歌曲的热评,参考这篇文章,很详细,对小白很友好: 手把手教你用Python爬取网易云40万 ...

- Python 爬取网易云歌手的50首热门作品

使用 requests 爬取网易云音乐 Python 代码: import json import os import time from bs4 import BeautifulSoup impor ...

- Python爬取网易云歌单

目录 1. 关键点 2. 效果图 3. 源代码 1. 关键点 使用单线程爬取,未登录,爬取网易云歌单主要有三个关键点: url为https://music.163.com/discover/playl ...

- 爬虫实战(二) 用Python爬取网易云歌单

最近,博主喜欢上了听歌,但是又苦于找不到好音乐,于是就打算到网易云的歌单中逛逛 本着 "用技术改变生活" 的想法,于是便想着写一个爬虫爬取网易云的歌单,并按播放量自动进行排序 这篇 ...

- Python爬取拉勾网招聘信息并写入Excel

这个是我想爬取的链接:http://www.lagou.com/zhaopin/Python/?labelWords=label 页面显示如下: 在Chrome浏览器中审查元素,找到对应的链接: 然后 ...

- python爬取豆瓣视频信息代码

目录 一:代码 二:结果如下(部分例子) 这里是爬取豆瓣视频信息,用pyquery库(jquery的python库). 一:代码 from urllib.request import quote ...

- python爬取网易云音乐歌曲评论信息

网易云音乐是广大网友喜闻乐见的音乐平台,区别于别的音乐平台的最大特点,除了“它比我还懂我的音乐喜好”.“小清新的界面设计”就是它独有的评论区了——————各种故事汇,各种金句频出.我们可以透过歌曲的评 ...

随机推荐

- 【CV现状-3.0】"目标"是什么

#磨染的初心--计算机视觉的现状 [这一系列文章是关于计算机视觉的反思,希望能引起一些人的共鸣.可以随意传播,随意喷.所涉及的内容过多,将按如下内容划分章节.已经完成的会逐渐加上链接.] 缘起 三维感 ...

- Android JSON解析插件

JSON是一种轻量级的数据格式,用于数据的交互. Android交互数据主要两种方式:JSON和 XML.XML格式比JSON格式数量略大,所以大多都使用Json数据格式. 在Android开发的过程 ...

- 使用VMware安装CentOS 7

环境:Windows10 , VMware Workstation 15 Player, CentOS 7 为什么选择CentOS ? 主流: 目前的Linux操作系统主要应用于生产环境,主流企业级L ...

- RabbitMQ 离线安装(带视频)

疯狂创客圈 Java 高并发[ 亿级流量聊天室实战]实战系列 [博客园总入口 ] 架构师成长+面试必备之 高并发基础书籍 [Netty Zookeeper Redis 高并发实战 ] 疯狂创客圈 高并 ...

- 源码角度分析-newFixedThreadPool线程池导致的内存飙升问题

前言 使用无界队列的线程池会导致内存飙升吗?面试官经常会问这个问题,本文将基于源码,去分析newFixedThreadPool线程池导致的内存飙升问题,希望能加深大家的理解. (想自学习编程的小伙伴请 ...

- python函数编程-装饰器decorator

函数是个对象,并且可以赋值给一个变量,通过变量也能调用该函数: >>> def now(): ... print('2017-12-28') ... >>> l = ...

- 【Cef编译】 CefSharp编译失败,检测到“RuntimeLibrary”的不匹配项: 值“MT_StaticRelease”不匹配值“MD_DynamicRelease”

编译CefSharp生成后一个libcef_dll_wrapper.lib时,供CefSharp使用.结果CefSharp编译的时候报错.遇到以下异常: libcef_dll_wrapper.lib( ...

- MySQL 重置Mysql root用户账号密码

重置Mysql root用户账号密码 By:授客 QQ:1033553122 问题描述: 使用mysqladmin.exe执行命令时出现以下错误提示: mysqladmin: connect to ...

- BlockStack常见词语

Browser: 用户用来浏览并使用基于 blockstack 网络开发的 app. CLI: Cli 工具用来管理个人的 blockstack id. blockstack.js (and othe ...

- double小数位数的显示

不显示小数点后的0,只显示2位小数 DecimalFormat df = new DecimalFormat(".##"); double num = 450.029000089; ...