Python 之scrapy框架58同城招聘爬取案例

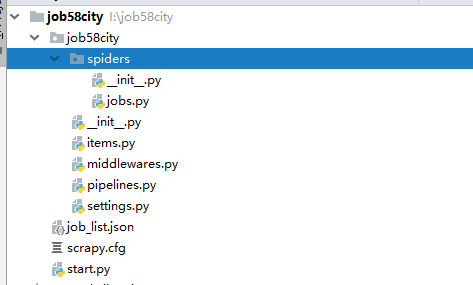

一、项目目录结构:

代码如下:

# -*- coding: utf-8 -*- # Define here the models for your scraped items

#

# See documentation in:

# https://doc.scrapy.org/en/latest/topics/items.html import scrapy class Job58CityItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

job_name = scrapy.Field()

money = scrapy.Field()

job_wel = scrapy.Field()

company = scrapy.Field()

position_type = scrapy.Field()

xueli = scrapy.Field()

jingyan = scrapy.Field()

address = scrapy.Field()

# -*- coding: utf-8 -*-

import scrapy

from ..items import Job58CityItem class JobsSpider(scrapy.Spider):

name = 'jobs'

allowed_domains = ['58.com']

# 配置起始页url

offset = 1

url = "https://cd.58.com/job/pn{0}/"

start_urls = [url.format(str(offset))] #解析html内容

def parse(self, response):

for each in response.xpath("//ul[@id='list_con']/li"):

item = Job58CityItem()

item['job_name'] = each.xpath(".//span[@class='name']/text()").extract()[0]

money_list = each.xpath(".//p[@class='job_salary']/text()").extract()

money = "未知"

if len(money_list) > 0:

money = money_list[0]

item['money'] = money

span = each.xpath(".//div[@class='job_wel clearfix']/span")

item['job_wel'] = []

for i in span:

item['job_wel'].append(i.xpath("./text()").extract()[0])

item['company'] = each.xpath(".//div[@class='comp_name']/a/text()").extract()[0]

item['position_type'] = each.xpath(".//span[@class='cate']/text()").extract()[0]

item['xueli'] = each.xpath(".//span[@class='xueli']/text()").extract()[0]

item['jingyan'] = each.xpath(".//span[@class='jingyan']/text()").extract()[0]

item['address'] = each.xpath("//span[@class='address']/text()").extract()[0]

yield item

if self.offset < 100:

self.offset += 1

yield scrapy.Request("https://cd.58.com/job/pn{0}/".format(str(self.offset)), callback=self.parse)

from scrapy import cmdline if __name__ == '__main__':

cmdline.execute("scrapy crawl jobs".split())

数据:

源码链接:https://github.com/yangsphp/Scrapy-master

Python 之scrapy框架58同城招聘爬取案例的更多相关文章

- python爬虫 scrapy框架(一)爬取壁纸照片

此项目仅供学习参考, 不用于任何商业用途 若侵权留言,立刻删除 刚入门爬虫不久,一心想找个网站试试,然后朋友推荐了这个壁纸网站

- Scrapy 框架 CrawlSpider 全站数据爬取

CrawlSpider 全站数据爬取 创建 crawlSpider 爬虫文件 scrapy genspider -t crawl chouti www.xxx.com import scrapy fr ...

- scrapy框架用CrawlSpider类爬取电影天堂.

本文使用CrawlSpider方法爬取电影天堂网站内国内电影分类下的所有电影的名称和下载地址 CrawlSpider其实就是Spider的一个子类. CrawlSpider功能更加强大(链接提取器,规 ...

- 爬虫(十七):Scrapy框架(四) 对接selenium爬取京东商品数据

1. Scrapy对接Selenium Scrapy抓取页面的方式和requests库类似,都是直接模拟HTTP请求,而Scrapy也不能抓取JavaScript动态谊染的页面.在前面的博客中抓取Ja ...

- python爬虫scrapy框架

Scrapy 框架 关注公众号"轻松学编程"了解更多. 一.简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量 ...

- python爬虫scrapy框架——人工识别登录知乎倒立文字验证码和数字英文验证码(2)

操作环境:python3 在上一文中python爬虫scrapy框架--人工识别知乎登录知乎倒立文字验证码和数字英文验证码(1)我们已经介绍了用Requests库来登录知乎,本文如果看不懂可以先看之前 ...

- Python爬虫(四)——开封市58同城数据模型训练与检测

前文参考: Python爬虫(一)——开封市58同城租房信息 Python爬虫(二)——对开封市58同城出租房数据进行分析 Python爬虫(三)——对豆瓣图书各模块评论数与评分图形化分析 数据的构建 ...

- [Python爬虫] 使用 Beautiful Soup 4 快速爬取所需的网页信息

[Python爬虫] 使用 Beautiful Soup 4 快速爬取所需的网页信息 2018-07-21 23:53:02 larger5 阅读数 4123更多 分类专栏: 网络爬虫 版权声明: ...

- 【图文详解】scrapy爬虫与动态页面——爬取拉勾网职位信息(2)

上次挖了一个坑,今天终于填上了,还记得之前我们做的拉勾爬虫吗?那时我们实现了一页的爬取,今天让我们再接再厉,实现多页爬取,顺便实现职位和公司的关键词搜索功能. 之前的内容就不再介绍了,不熟悉的请一定要 ...

随机推荐

- 非常适合新手的jq/zepto源码分析06 -- 事件模型

复习下事件的有关内容: 1.现在用的绑定/删除: obj.addEventListener(type,fn,false) obj.removeEventListener(type) obj.attac ...

- 关于static静态块的使用和static list的使用

public class CorsConfiguration { /** * Wildcard representing <em>all</em> origins, metho ...

- [Elasticsearch] 集群的工作原理 - 第一部分

本文翻译自Elasticsearch官方指南的life inside a cluster一章. ES就是为高可用和可扩展而生的. 扩展能够通过购置性能更强的server(垂直扩展或者向上扩展,Vert ...

- 输入两个整数n 和m,从数列1,2,3.......n 中任意取几个数, 使其和等于m ,要求将当中全部的可能组合列出来

中兴面试题之中的一个.难度系数中. 题目描写叙述例如以下:输入两个整数n 和m,从数列1,2.3.......n 中任意取几个数, 使其和等于m ,要求将当中全部的可能组合列出来. 逻辑分析: 1.比 ...

- JavaWeb开发环境搭建

Tomcat 的主要配置 Tomcat:tomcat是实现了一个JavaEE标准的最小的Webserver,是Apche组织开发的,免费的server,能够在网络中直接下载. 最新的版本号应该是8的版 ...

- CSS垂直居中完美有用实例

<!DOCTYPE HTML> <html> <head> <meta meta chars ...

- Boost Replaceable by C++11 language features or libraries

Replaceable by C++11 language features or libraries Foreach → Range-based for Functional/Forward → P ...

- PowerDesigner中导入MYSQL数据库结构的步骤及问题解决

今天在使用PowerDesigner,要导入MySql的表结构到PowerDesginer里, 记录下详细的操作步骤: 1.首先要确保机器安装了MySql的ODBC驱动,去http://dev.mys ...

- Tiny4412 开发板 编译环境搭建【转】

本文转载自:http://blog.csdn.net/beijiwei/article/details/51055369 版权声明:本文为博主原创文章,未经博主允许不得转载. /*********** ...

- cookie domain and cookie path

https://developer.mozilla.org/en-US/docs/Web/HTTP/Headers/Set-Cookie Domain=<domain-value> Opt ...