Computational Network Toolkit (CNTK) 是微软出品的开源深度学习工具包

Computational Network Toolkit (CNTK) 是微软出品的开源深度学习工具包

用 CNTK 搞深度学习 (一) 入门

Computational Network Toolkit (CNTK) 是微软出品的开源深度学习工具包。本文介绍CNTK的基本内容,如何写CNTK的网络定义语言,以及跑通一个简单的例子。

根据微软开发者的描述,CNTK的性能比Caffe,Theano, TensoFlow等主流工具都要强。它支持CPU和GPU模式,所以没有GPU,或者神经网络比较小的实验,直接用CPU版的CNTK跑就行了。 其开源主页在 https://github.com/Microsoft/CNTK 它把神经网络描述成一个有向图的结构,叶子节点代表输入或者网络参数,其他节点计算步骤。 它支持卷积神经网络和递归神经网络。 由于CNTK刚推出不久,大众教程估计不多,而且bug估计也不少。我学习的时候,主要参考三个资料:

1 官方入门教程 https://github.com/Microsoft/CNTK/wiki/Tutorial 本文也主要以这里的教程为例

2 官方论坛 https://github.com/Microsoft/CNTK/issues

3 官方论文 http://research.microsoft.com/pubs/226641/CNTKBook-20160217..pdf 这个有150页,我是当作字典来用,遇到问题的时候就在里面搜

安装CNTK: https://github.com/Microsoft/CNTK/wiki/CNTK-Binary-Download-and-Configuration 去这个页面找符合自己系统的版本。 我是Windows用户,CNTK有编译好的CPU和GPU版本。由于本人的显卡不是英伟达的,所以无奈只能用CPU版凑合用用。已经编译好的包最方便了,解压,然后把目录(类似%...%、CNTK-2016-02-08-Windows-64bit-CPU-Only\cntk\cntk)添加到PATH变量中就行了。 有条件的人也可以自己编译源代码,稍微麻烦一些,各种依赖关系,好处是源码更新的比较快,CNTK一大特点就是目前各种小bug比较多,比如我现在用的编译好的包还是两个月前发布的,已经自己填了好多坑了。

安装好CNTK之后,运行一个程序,就是一个简单的命令行: CNTK configFile=your_config_file , 其中,your_config_file 是网络的定义文件,大概长这样:

command=Train:Test

Train=[

action="train"

NDLNetworkBuilder = [

...

]

SGD = [

...

]

reader = [

...

]

]Test=[ ... ]

运行的入口就是command命令,command后面接需要依次运行的模块,用冒号分开。 每个模块里面需要定义的事情比较类似,主要是定义输入的格式,网络结构,学习算法(目前只有SGD)和参数。 在定义网络结构的时候,会指明哪些节点是优化目标,哪些是评价指标,以及哪些是输出的点。

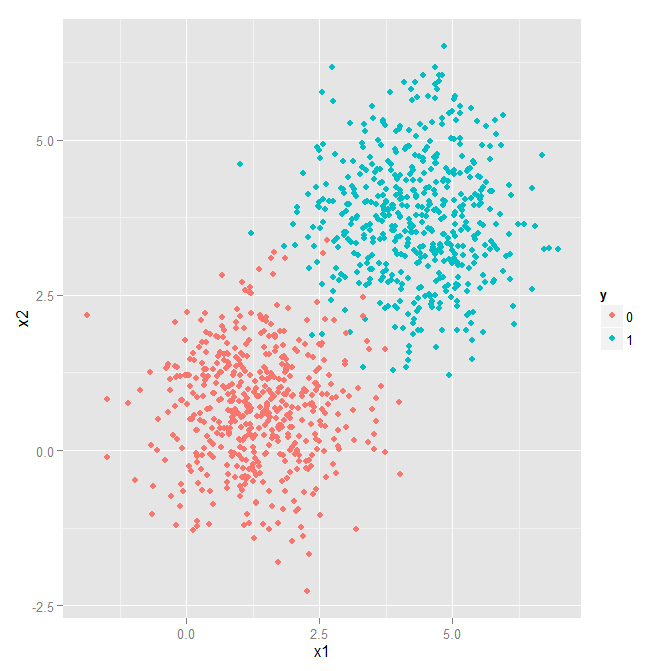

众所周知,把神经网络的隐藏层去掉之后,输入直接连到输出层,这样就行成了一个logistics regression分类器。所以https://github.com/Microsoft/CNTK/wiki/Tutorial 这个教程就指导大家如何构建一个LR。 我这里稍微变一下,学习一下如何构建带有一层隐藏层的neural network,如下图:

定义网络结构

CNTK用网络描述语言(network description language, NDL)描述一个神经网络。 简单的说,我们要描述输入的feature,输入的label,一些参数,参数和输入之间的计算关系,以及目标节点是什么。

NDLNetworkBuilder=[

run=ndlLR

ndlLR=[

# sample and label dimensions

SDim=$dimension$

LDim=1

features=Input(SDim, 1)

labels=Input(LDim, 1)

# parameters to learn

B0 = Parameter(4)

W0 = Parameter(4, SDim)

B = Parameter(LDim)

W = Parameter(LDim, 4)

# operations

t0 = Times(W0, features)

z0 = Plus(t0, B0)

s0 = Sigmoid(z0)

t = Times(W, s0)

z = Plus(t, B)

s = Sigmoid(z)

LR = Logistic(labels, s)

EP = SquareError(labels, s)

# root nodes

FeatureNodes=(features)

LabelNodes=(labels)

CriteriaNodes=(LR)

EvalNodes=(EP)

OutputNodes=(s,t,z,s0,W0)

]

]

features=Input(SDim, 1) labels=Input(LDim, 1) 和 B0 = Parameter(4) 等可以想象成是在定义变量。 输入是列向量,CNTK里面的运算全是矩阵运算,所以就把输入当做只有一列的矩阵。 t0 = Times(W0, features) 是做矩阵乘法,t0把输入和权重相乘,z0 是在t0上面加了一个bias,

s0表示经过一个激活函数。 B0,W0,t0,z0,s0构成了隐层的操作,这里定义的隐层有4个节点。 t,z,s是输出层的操作,s就是输出节点的值。 框架定义好之后,还需要指定一些根节点,用来指定特殊的任务,例如 FeatureNodes=(features) 和LabelNodes=(labels)分别规定了输入和输出节点,CriteriaNodes 是训练的

时候优化的目标,EvalNodes 是在做评测的时候输出的参考值。OutputNodes 指定了需要输出到文件的节点。

设置训练算法

SGD = [

epochSize=0 # 每轮迭代使用的样例数, =0 表示使用整个训练集

minibatchSize=25 # 训练25个样本就更新一次参数

learningRatesPerMB=0.1 # learning rates per MB

maxEpochs=50 #迭代50次

]

目前只有SGD(以及在SGD上的各种变种),可以在里面设置各种参数。

设置输入格式

reader = [

#customDelimiter = " "

readerType = "UCIFastReader"

file = "Train.txt"

miniBatchMode = "partial"

verbosity = 1

randomize = "none" features=[

dim = $dimension$

start = 0

] labels=[

start = $dimension$ # skip $dimension$ elements before reading the label (i.e. the first two dimensions so we have "x1 x2 y" basically)

dim = 1 # label has 1 dimension

labelType=regression

labelMappingFile = "SimpleMapping.txt"

]

]

这也是CNTK的一个特点(吐槽点), 指定用什么方式读取数据文件。 readerType = "UCIFastReader" 指定用普通的扁平化表格的格式(一行一个样例,同一行内用空格隔开不同的数值),还有别的格式类型,例如图像格式,文本语料格式等。UCIFastReader 是将被弃用的,而且在目前最新的binary包中是有bug的 (所以说,有条件的同学尽量自己编译最新的源码)。 用官方教程里的设置直接跑回出bug,以上是我修改过的代码。 输入格式主要描述了feature是哪几列,维度是多少,label是哪几列, label的类型等等。

综上,Train这个模块就是定义了这几件事情:输入格式,网络内容,训练模式。 运行的时候也是这个步骤: 读取数据-> SGD 训练.

其他

除了Train之外的模块的流程比较类似,它们不需要再定义网络结构和训练模式,但是输入格式还是要指定的。 例如Test模块的流程是: 读取数据->计算网络->得到预测值->评估. 评估针对的是在网络结构中被定义为EvalNodes 的节点。 SquareError 只是其中的一种评估指标。如果想用别的误差函数,可以去查字典http://research.microsoft.com/pubs/226641/CNTKBook-20160217..pdf

Test=[

action="test"

reader=[

readerType="UCIFastReader"

file="Test.txt"

features=[

dim=2

start=0

]

labels=[

start=$dimension$

dim=1

labelDim=2

]

]

]

Output模块和Test的流程基本一样,只不过最后一个不是评估,而是把属于OutputNodes的值给输出到文件。 Output模块会指定一个输出目录 outputPath = "LR.txt" , 输出的文件以“LR.txt”为前缀,再加上变量命作为文件名。例如"LR.txt.W0"。

# output the results

Output=[

action="write"

reader=[

readerType="UCIFastReader"

file="Test.txt"

features=[

dim=$dimension$

start=0

]

labels=[

start=2

dim=1

labelType=regression

]

]

outputPath = "LR.txt" # dump the output as text

]

dumpNodeInfo 用来输出参数的值。这在调试中很有用,例如去看看网络的参数是如何变化的:

dumpNodeInfo=[

action=dumpnode

printValues=true

] ####################################################################

B=LearnableParameter [1,1] NeedGradient=true

-6.67130613

####################################################################

EP=SquareError ( labels , s )

features=InputValue [ 2 x 1 {1,2} ]

labels=InputValue [ 1 x 1 {1,1} ]

LR=Logistic ( labels , s )

s=Sigmoid ( z )

t=Times ( W , features )

W=LearnableParameter [1,2] NeedGradient=true

1.23924482 1.59913719

####################################################################

z=Plus ( t , B )

全部的代码如下。 train文件 https://github.com/Microsoft/CNTK/wiki/Tutorial/Train-3Classes.txt test 文件 https://github.com/Microsoft/CNTK/wiki/Tutorial/Test-3Classes.txt。 数据是2维的:

# Copyright (c) Microsoft. All rights reserved.

# Licensed under the MIT license. See LICENSE file in the project root for full license information. # logistic regression cntk script -- Network Description Language # which commands to run

command=Train:Output:dumpNodeInfo:Test #required...

modelPath="Models/LR_reg.dnn" # where to write the model to

deviceId=-1 # CPU

dimension=2 # input data dimensions # training config

Train=[

action="train"

traceLevel = 1

NDLNetworkBuilder=[ run=ndlLR ndlLR=[

# sample and label dimensions

SDim=$dimension$

LDim=1 features=Input(SDim, 1)

labels=Input(LDim, 1) # parameters to learn

B0 = Parameter(4)

W0 = Parameter(4, SDim) B = Parameter(LDim)

W = Parameter(LDim, 4) # operations

t0 = Times(W0, features)

z0 = Plus(t0, B0)

s0 = Sigmoid(z0) t = Times(W, s0)

z = Plus(t, B)

s = Sigmoid(z) LR = Logistic(labels, s)

EP = SquareError(labels, s) # root nodes

FeatureNodes=(features)

LabelNodes=(labels)

CriteriaNodes=(LR)

EvalNodes=(EP)

OutputNodes=(s,t,z,s0,W0)

]

] SGD = [

epochSize=0 # =0 means size of the training set

minibatchSize=25

learningRatesPerMB=0.1 # learning rates per MB

maxEpochs=50

] # parameter values for the reader

reader = [

#customDelimiter = " "

readerType = "UCIFastReader"

file = "Train.txt"

miniBatchMode = "partial"

verbosity = 1

randomize = "none" features=[

dim = $dimension$

start = 0

] labels=[

start = $dimension$ # skip $dimension$ elements before reading the label (i.e. the first two dimensions so we have "x1 x2 y" basically)

dim = 1 # label has 1 dimension

labelType=regression

labelMappingFile = "SimpleMapping.txt"

]

]

] # test

Test=[

action="test"

reader=[

readerType="UCIFastReader"

randomize = "none"

file="Test.txt"

features=[

dim=$dimension$

start=0

]

labels=[

start = $dimension$ # skip $dimension$ elements before reading the label (i.e. the first two dimensions so we have "x1 x2 y" basically)

dim = 1 # label has 1 dimension

labelType=regression

labelMappingFile = "SimpleMapping.txt"

]

]

] # output the results

Output=[

action="write"

reader=[

readerType="UCIFastReader"

file="Test.txt"

randomize = "none"

features=[

dim=$dimension$

start=0

] labels=[

start = $dimension$ # skip $dimension$ elements before reading the label (i.e. the first two dimensions so we have "x1 x2 y" basically)

dim = 1 # label has 1 dimension

labelType=regression

labelMappingFile = "SimpleMapping.txt"

]

]

outputPath = "LR.txt" # dump the output as text

] dumpNodeInfo=[

action=dumpnode

printValues=false

]

后一篇:

用CNTK搞深度学习 (二) 训练基于RNN的自然语言模型 ( language model )

http://www.cnblogs.com/sylvanas2012/p/5419477.html

原创博客,未经允许,请勿转载。

Computational Network Toolkit (CNTK) 是微软出品的开源深度学习工具包的更多相关文章

- 用 CNTK 搞深度学习 (一) 入门

Computational Network Toolkit (CNTK) 是微软出品的开源深度学习工具包.本文介绍CNTK的基本内容,如何写CNTK的网络定义语言,以及跑通一个简单的例子. 根据微软开 ...

- CNTK 搞深度学习-1

CNTK 搞深度学习 Computational Network Toolkit (CNTK) 是微软出品的开源深度学习工具包.本文介绍CNTK的基本内容,如何写CNTK的网络定义语言,以及跑通一个简 ...

- Google、亚马逊、微软 、阿里巴巴开源软件一览

Google.亚马逊.微软 .阿里巴巴开源软件一览 大公司为什么要发布开源项目?一是开源能够帮助他人更快地开发软件,促进世界创新,主要是社会价值层面的考虑.二是开源能够倒逼工程师写出更好的代码.三是开 ...

- 微软亚洲研究院开源图数据库GraphView

我们很高兴地宣布,由微软亚洲研究院系统算法组开发的图数据库GraphView通过GitHub平台开源.GraphView是一款中间件软件,方便用户使用关系数据库SQL Server 或Azure SQ ...

- YARN之上的大数据框架REEF:微软出品,是否值得期待?

YARN之上的大数据框架REEF:微软出品,是否值得期待? 摘要:微软即将开源大数据框架REEF,REEF运行于Hadoop新一代资源管理器YARN的上层.对于机器学习等在数据传输.任务监控和结果 ...

- 微软 深度学习 cntk ,我目前见过 安装方式最简单的一个框架,2.0之后开始支持C# 咯

嗨,你也是我这种手残党么?之前试着安装着mxnet和tensorflow,但是因为时间比较短所以往往来不及安装完就失去兴趣,今天看到微软的cntk可以用了,一次性安装好了,并且测试通过 本人环境: W ...

- 微软的深度学习框架cntk ,我目前见过 安装方式最简单的一个框架,2.0之后开始支持C# 咯

wiki:https://github.com/Microsoft/CNTK/wiki 嗨,你也是我这种手残党么?之前试着安装着mxnet和tensorflow,但是因为时间比较短所以往往来不及安装完 ...

- 由微软打造的深度学习开放联盟ONNX成立

导读 如今的微软已经一跃成为全球市值最高的高科技公司之一.2018年11月底,微软公司市值曾两次超越了苹果,成为全球市值最高的公司,之后也一直处于与苹果胶着的状态.市场惊叹微软是一家有能力改造自己并取 ...

- 用CNTK搞深度学习 (二) 训练基于RNN的自然语言模型 ( language model )

前一篇文章 用 CNTK 搞深度学习 (一) 入门 介绍了用CNTK构建简单前向神经网络的例子.现在假设读者已经懂得了使用CNTK的基本方法.现在我们做一个稍微复杂一点,也是自然语言挖掘中很火 ...

随机推荐

- hdu4725 The Shortest Path in Nya Graph

这道题看了下很多人都是把每一层拆成两个点然后建图做的. 我的思路很直接,也不用建图,直接在更新每个点时更新他相邻的边和相邻的层,当然前提是每个点只更新一次,每个层也只更新一次,这样才能确保时间复杂度. ...

- 基于visual Studio2013解决C语言竞赛题之1062高与矮

题目 解决代码及点评 /************************************************************************/ /* 62 ...

- 人人网javascript面试题

JavaScript面试题要求:以下题目必须从一至四题中,选出三道题,使用原生代码实现,不可使用任何框架,第五题为选作题. 一. 在页面的固定区域内实现图片的展示 <ignore_ ...

- 获取TBitMap图像缓冲区,提高图像处理速度

使用Dephi进行图像处理可以有多种方法,最常用的应该算是TBitmap,它提供方便的图像存取能力,结合Canvas可进行画线.画圆.图像拷贝等操作.不过在进行大量的图像处理操作时,为了获得更高的速度 ...

- JQuery+AJAX实现搜索文本框的输入提示功能

平时使用谷歌搜索的时候发现只要在文本框里输入部分单词或字母,下面马上会弹出一个相关信息的内容框可供选择.感觉这个功能有较好的用户体验,所以也想在自己的网站上加上这种输入提示框. 实现的原理其实很简单, ...

- CSS样式渐变写法

.first_tree li:hover{ color:#FFF; cursor:pointer; background-color:#ff8a00; background: -ms-linear-g ...

- 一些关于linux 下的jni下问题

编译的细节我就不写了,主要写一些linux下的注意事项,mask一下错误(太多windows的例子了) 编译教程:http://www.cnblogs.com/youxilua/archive/201 ...

- 线段树菜鸟一题+归并排序【求逆序数】POJ2299

题目链接:http://poj.org/problem?id=2299 归并排序解法链接:http://blog.csdn.net/lyy289065406/article/details/66473 ...

- 实现web多语言的一种解决办法

实现web多语言可能有多种解决办法,现在分享一种比较简单的思路,这篇文章主要用于记录学习过程,肯定存在不少谬误,欢迎批评指正. web多语言实现最简单的一种方法可能是每一种语言一套代码,但这样存在一个 ...

- Swift - 类扩展(extension)

Swift语言的类扩展是一个强大的工具,我们可以通过类扩展完成如下事情: 1,给已有的类添加计算属性和计算静态属性 2,定义新的实例方法和类方法 3,提供新的构造器 4,定义下标脚本 5,是一个已有的 ...