RabbitMQ、Memcache、Redis(队列、缓存)

RabbitMQ

一、解释

RabbitMQ是一个在AMQP基础上完整的,可复用的企业消息系统。他遵循Mozilla Public License开源协议。

MQ全称为Message Queue, 消息队列(MQ)是一种应用程序对应用程序的通信方法。应用程序通过读写出入队列的消息(针对应用程序的数据)来通信,而无需专用连接来链接它们。消 息传递指的是程序之间通过在消息中发送数据进行通信,而不是通过直接调用彼此来通信,直接调用通常是用于诸如远程过程调用的技术。排队指的是应用程序通过 队列来通信。队列的使用除去了接收和发送应用程序同时执行的要求。

二、安装

pip install pika

三、简单队列

1、使用API操作RabbitMQ

基于Queue实现生产者消费者模型

#!/usr/bin/env python

# -*- coding:utf-8 -*-

import Queue

import threading message = Queue.Queue(10) def producer(i):

while True:

message.put(i) def consumer(i):

while True:

msg = message.get() for i in range(12):

t = threading.Thread(target=producer, args=(i,))

t.start() for i in range(10):

t = threading.Thread(target=consumer, args=(i,))

t.start()

对于RabbitMQ来说,生产和消费不再针对内存里的一个Queue对象,而是某台服务器上的RabbitMQ Server实现的消息队列。

生产者

# !/usr/bin/env python

# -*- coding:utf-8 -*- import pika connection = pika.BaseConnection(pika.ConnectionParameters(host='10.211.55.4')) # 封装socket逻辑部分

channel = connection.channel() # 拿到操作句柄 channel.queue_declare(queue='hello') # 通过channel创建一个队列,再给给队列取名字 channel.basic_publish(exchange='', # 通过句柄给

routing_key='hello', # 把body的数据放到名为hello的队列里去

body='Hello World!', ))

print("[x] Sent 'Hello World!")

connection.close()

消费者

# !/usr/bin/env python

# -*- coding:utf-8 -*- import pika connection = pika.BaseConnection(pika.ConnectionParameters(host='10.211.55.4'))

channel = connection.channel() channel.queue_declare(queue='hello') # 创建队列 def callback(ch, method, properties, body): # 就是个回调函数

print(" [x] Received %r" % body) channel.basic_consume(callback, # 函数名;取出数据就执行这个函数

queue='hello', # 队列名

no_ack=Ture) # 无应答是(Ture);有应答(False) print(' [*] Waiting for messages.To exit press CTRL+C')

channel.start_consuming()

2、acknowledgment 消息不丢失

no-ack = False,如果消费者遇到情况(its channel is closed, connection is closed, or TCP connection is lost)挂掉了,那么,RabbitMQ会重新将该任务添加到队列中。

# !/usr/bin/env python

# -*- coding:utf- -*- import pika connection = pika.BaseConnection(pika.ConnectionParameters(host='10.211.55.4'))

channel = connection.channel() channel.queue_declare(queue='hello') # 创建队列 def callback(ch, method, properties, body): # 就是个回调函数

print(" [x] Received %r" % body)

import time

time.sleep()

print('ok')

ch.basic_ack(delivery_tag=method.delivery_tag) # 调为有应答要加上的(下面的要改no_ack=False) channel.basic_qos(prefetch_count=) channel.basic_consume(callback, # 函数名;取出数据就执行这个函数

queue='hello', # 队列名

no_ack=False) # 无应答是(Ture);有应答(False)

print(' [*] Waiting for messages.To exit press CTRL+C')

channel.start_consuming()

消费者

3、durable 消息不丢失

生产者

import pika connection = pika.BlockingConnection(pika.ConnectionParameters(host='10.211.55.4'))

channel = connection.channel() # make message persistent

channel.queue_declare(queue='hello', durable=True) # durable=True这个参数是把数据保存到硬盘 channel.basic_publish(exchange='',

routing_key='hello',

body='Hello World!',

properties=pika.BasicProperties(

delivery_mode=2, # 传递模式从默认的1,改为2

))

print(" [x] Sent 'Hello World!'")

connection.close()

消费者

#!/usr/bin/env python

# -*- coding:utf-8 -*-

import pika connection = pika.BlockingConnection(pika.ConnectionParameters(host='10.211.55.4'))

channel = connection.channel() # make message persistent

channel.queue_declare(queue='hello', durable=True) def callback(ch, method, properties, body):

print(" [x] Received %r" % body)

import time

time.sleep(10)

print 'ok'

ch.basic_ack(delivery_tag = method.delivery_tag) # 把无应答调整为有应答 channel.basic_consume(callback,

queue='hello',

no_ack=False) # 改为False,表示有应答 print(' [*] Waiting for messages. To exit press CTRL+C')

channel.start_consuming()

4、消息获取顺序

默认消息队列里的数据是按照顺序被消费者拿走,例如:消费者1 去队列中获取 奇数 序列的任务,消费者1去队列中获取 偶数 序列的任务。

channel.basic_qos(prefetch_count=1) 表示谁来谁取,不再按照奇偶数排列

#!/usr/bin/env python

# -*- coding:utf- -*-

import pika connection = pika.BlockingConnection(pika.ConnectionParameters(host='10.211.55.4'))

channel = connection.channel() # make message persistent

channel.queue_declare(queue='hello') def callback(ch, method, properties, body):

print(" [x] Received %r" % body)

import time

time.sleep()

print 'ok'

ch.basic_ack(delivery_tag = method.delivery_tag) channel.basic_qos(prefetch_count=) # prefetch_count=1这个参数就让取的方式改变,不在顺序取数据 channel.basic_consume(callback,

queue='hello',

no_ack=False) print(' [*] Waiting for messages. To exit press CTRL+C')

channel.start_consuming()

消费者

四、exchange

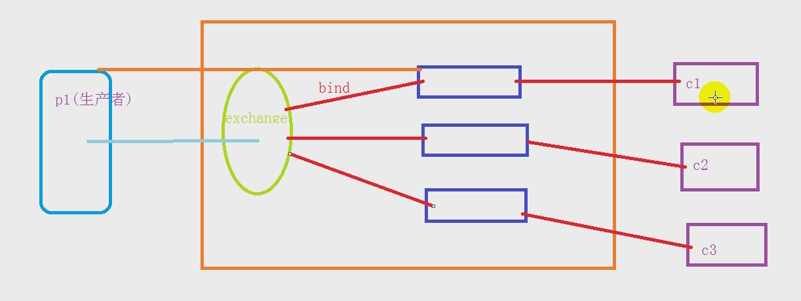

1、fanout模式

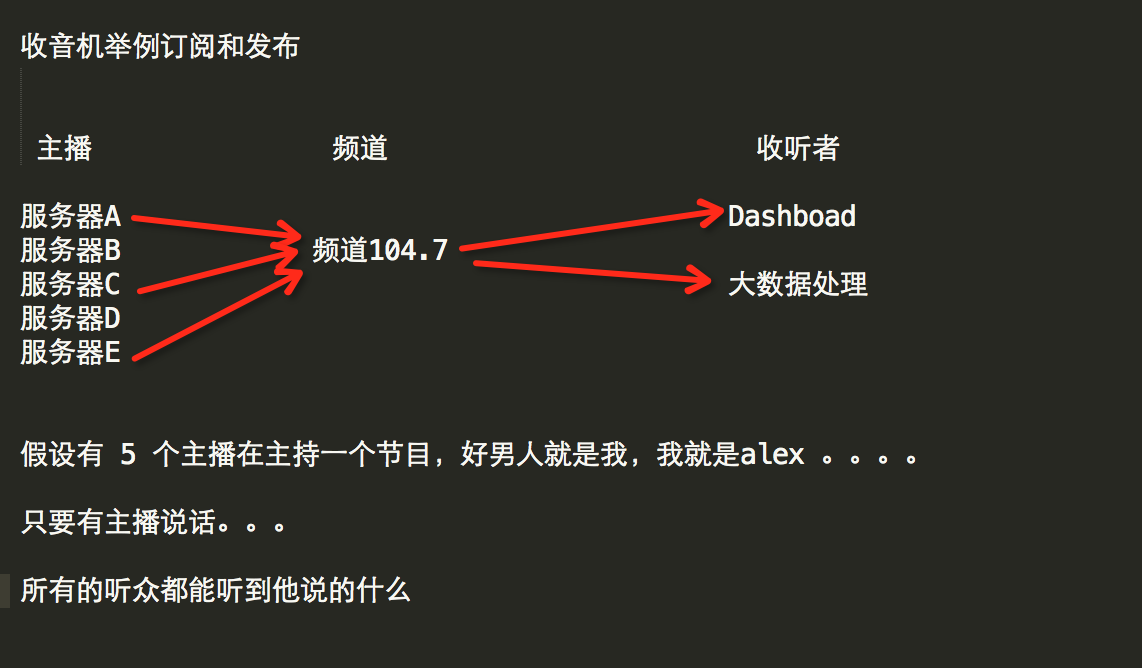

发布订阅

发布订阅和简单的消息队列区别在于,发布订阅会将消息发送给所有的订阅者,而消息队列中的数据被消费一次便消失。

所以,RabbitMQ实现发布和订阅时,会为每一个订阅者创建一个队列,而发布者发布消息时,会将消息放置在所有相关队列中。

exchange type = fanout

发布者

#!/usr/bin/env python

import pika

import sys connection = pika.BlockingConnection(pika.ConnectionParameters(

host='localhost'))

channel = connection.channel() # 创建交换机

channel.exchange_declare(exchange='logs', # 名字

type='fanout') # 类型 message = ' '.join(sys.argv[1:]) or "info: Hello World!"

channel.basic_publish(exchange='logs', # 往名字为logs的交换机里

routing_key='', # 把数据直接放到交换机里,不用放到队列中,所以默认为空

body=message)

print(" [x] Sent %r" % message)

connection.close() # 关闭

订阅者

#!/usr/bin/env python

import pika connection = pika.BlockingConnection(pika.ConnectionParameters(

host='localhost'))

channel = connection.channel() #创建交换机

channel.exchange_declare(exchange='logs',

type='fanout') # 随机创建一个队列

result = channel.queue_declare(exclusive=True)

queue_name = result.method.queue channel.queue_bind(exchange='logs', # 随机生成的队列绑定交换机

queue=queue_name) print(' [*] Waiting for logs. To exit press CTRL+C') def callback(ch, method, properties, body):

print(" [x] %r" % body) channel.basic_consume(callback, # 在下面阻塞后,如果得到数据后才执行这个函数

queue=queue_name,

no_ack=True) channel.start_consuming() # 阻塞住,等待生产者把数据放到消费者,并监听

图形解释

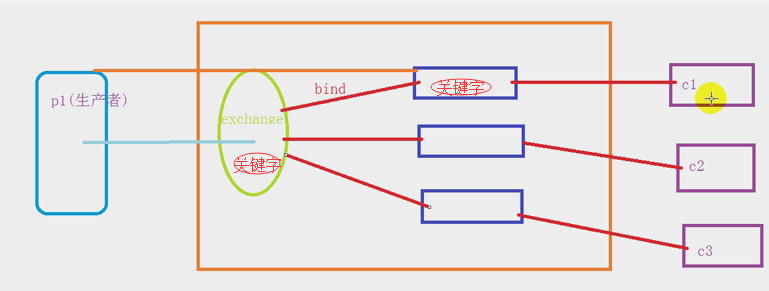

2、dirct模式

关键字发送

RabbitMQ还支持根据关键字发送,即:队列绑定关键字,发送者将数据根据关键字发送到消息exchange,

exchange根据 关键字 判定应该将数据发送至指定队列。

exchange type = direct

#!/usr/bin/env python

import pika

import sys connection = pika.BlockingConnection(pika.ConnectionParameters(

host='localhost'))

channel = connection.channel() channel.exchange_declare(exchange='direct_logs',

type='direct') result = channel.queue_declare(exclusive=True)

queue_name = result.method.queue severities = sys.argv[:]

if not severities:

sys.stderr.write("Usage: %s [info] [warning] [error]\n" % sys.argv[])

sys.exit() for severity in severities: # 用循环是可以绑定多个队列

channel.queue_bind(exchange='direct_logs',

queue=queue_name,

routing_key='severity') # 定义的参数(关键字) channel.queue_bind(exchange='direct_logs',

queue=queue_name,

routing_key='alex') print(' [*] Waiting for logs. To exit press CTRL+C') def callback(ch, method, properties, body):

print(" [x] %r:%r" % (method.routing_key, body)) channel.basic_consume(callback,

queue=queue_name,

no_ack=True) channel.start_consuming() 消费者

消费者

#!/usr/bin/env python

import pika

import sys connection = pika.BlockingConnection(pika.ConnectionParameters(

host='localhost'))

channel = connection.channel() channel.exchange_declare(exchange='direct_logs',

type='direct') severity = sys.argv[] if len(sys.argv) > else 'info'

message = ' '.join(sys.argv[:]) or 'Hello World!'

channel.basic_publish(exchange='direct_logs',

routing_key=severity,

body=message)

print(" [x] Sent %r:%r" % (severity, message))

connection.close()

生产者

图解

在交换机中用一关键字,只有队列里有关键字交换机才会发送数据给绑定的队列

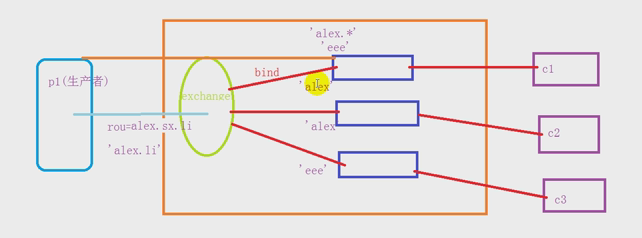

3、topic

模糊匹配

在topic类型下,可以让队列绑定几个模糊的关键字,之后发送者将数据发送到exchange,exchange将传入”路由值“和 ”关键字“进行匹配,

匹配成功,则将数据发送到指定队列。exchange type = topic

# 表示可以匹配 0 个 或 多个 单词

* 表示只能匹配 一个 单词 发送者路由值 队列中

old.boy.python old.* -- 不匹配

old.boy.python old.# -- 匹配

#!/usr/bin/env python

import pika

import sys connection = pika.BlockingConnection(pika.ConnectionParameters(

host='localhost'))

channel = connection.channel() channel.exchange_declare(exchange='topic_logs',

type='topic') result = channel.queue_declare(exclusive=True)

queue_name = result.method.queue binding_keys = sys.argv[:]

if not binding_keys:

sys.stderr.write("Usage: %s [binding_key]...\n" % sys.argv[])

sys.exit() for binding_key in binding_keys:

channel.queue_bind(exchange='topic_logs',

queue=queue_name,

routing_key=binding_key) print(' [*] Waiting for logs. To exit press CTRL+C') def callback(ch, method, properties, body):

print(" [x] %r:%r" % (method.routing_key, body)) channel.basic_consume(callback,

queue=queue_name,

no_ack=True) channel.start_consuming()

消费者

#!/usr/bin/env python

import pika

import sys connection = pika.BlockingConnection(pika.ConnectionParameters(

host='localhost'))

channel = connection.channel() channel.exchange_declare(exchange='topic_logs',

type='topic') routing_key = sys.argv[] if len(sys.argv) > else 'anonymous.info'

message = ' '.join(sys.argv[:]) or 'Hello World!'

channel.basic_publish(exchange='topic_logs',

routing_key=routing_key,

body=message)

print(" [x] Sent %r:%r" % (routing_key, message))

connection.close()

生产者

图解

Memcache(缓存)

一、解析

Memcached 是一个高性能的分布式内存对象缓存系统,用于动态Web应用以减轻数据库负载。

它通过在内存中缓存数据和对象来减少读取数据库的次数,从而提高动态、数据库驱动网站的速度

二、安装

1、Memcached安装和基本使用

Memcached安装:

wget http://memcached.org/latest

tar -zxvf memcached-1.x.x.tar.gz

cd memcached-1.x.x

./configure && make && make test && sudo make install PS:依赖libevent

yum install libevent-devel

apt-get install libevent-dev

启动Memcached

memcached -d -m 10 -u root -l 10.211.55.4 -p 12000 -c 256 -P /tmp/memcached.pid 参数说明:

-d 是启动一个守护进程

-m 是分配给Memcache使用的内存数量,单位是MB

-u 是运行Memcache的用户

-l 是监听的服务器IP地址

-p 是设置Memcache监听的端口,最好是1024以上的端口

-c 选项是最大运行的并发连接数,默认是1024,按照你服务器的负载量来设定

-P 是设置保存Memcache的pid文件

Memcached命令

存储命令: set/add/replace/append/prepend/cas

获取命令: get/gets

其他命令: delete/stats..

2、Python操作Memcached

安装API

python操作Memcached使用Python-memcached模块

下载安装:https://pypi.python.org/pypi/python-memcached

三、操作

1、模板

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

mc.set("dee", "bar") # 存储命令

ret = mc.get_multi('dee') # 获取命令

print(ret)

Ps:debug = True 表示运行出现错误时,现实错误信息,上线后移除该参数。

2、天生支持集群

python-memcached模块原生支持集群操作,其原理是在内存维护一个主机列表,且集群中主机的权重值和主机在列表中重复出现的次数成正比

主机 权重

1.1.1.1 1

1.1.1.2 2

1.1.1.3 1 那么在内存中主机列表为:

host_list = ["1.1.1.1", "1.1.1.2", "1.1.1.2", "1.1.1.3", ]

如果用户根据如果要在内存中创建一个键值对(如:k1 = "v1"),那么要执行一下步骤:

- 根据算法将 k1 转换成一个数字

- 将数字和主机列表长度求余数,得到一个值 N( 0 <= N < 列表长度 )

- 在主机列表中根据 第2步得到的值为索引获取主机,例如:host_list[N]

- 连接 将第3步中获取的主机,将 k1 = "v1" 放置在该服务器的内存中

mc = memcache.Client([('1.1.1.1:12000', 1),

('1.1.1.2:12000', 2),

('1.1.1.3:12000', 1)], debug=True)

mc.set('k1', 'v1')

3、add

添加一条键值对,如果已经存在的 key,重复执行add操作异常

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.add("yui", "123") # 添加

ret = mc.get('yui') # 获取

print(ret)

4、replace

replace 修改某个key的值,如果key不存在,则异常

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.set("asd", "678") # (设置)存储

mc.replace("asd", "456") # 修改“qwe”这个key的值

# 如果memcache中存在asd,则替换成功,否则异常

ret = mc.get('asd') # 获取

print(ret)

5、set 和 get

set 设置一个键值对,如果key不存在,则创建,如果key存在,则修改

get 获取一个键值对

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.set("zxc", "888") # 设置(set设置单个)

ret = mc.get("zxc") # 获取(get获取单个)

print(ret)

6、 set_multi和 get_multi

set_multi 设置多个键值对,如果key不存在,则创建,如果key存在,则修改

get_multi 获取多一个键值对

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.set_multi({"zxc": "888", "fgh": "999", "jkl": "777"}) # 设置(set_multi设置多个)

ret = mc.get_multi(["zxc", "fgh", "jkl"]) # 获取(get_multi获取多个)

print(ret)

7、delete 和 delete_multi

delete 在Memcached中删除指定的一个键值对

delete_multi 在Memcached中删除指定的多个键值对

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.set("zxc", "666")

ret = mc.delete("zxc") # (delete)删除指定的一个键值对

print(ret)

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.set_multi({"zxc": "666", "zxl": "888", "fgh": "999", "jkl": "777"})

ret = mc.delete_multi(["zxc", "zxl", "fgh", "jkl"]) # (delete_multi)删除多个键值对

print(ret)

8、append 和 prepend

append 修改指定key的值,在该值 后面 追加内容

prepend 修改指定key的值,在该值 前面 插入内容

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

mc.set('zxl', '')

# mc.append('zxl', 'after') # 在该值 后面 追加内容

# # zxl = "2222after" # 结果

ret = mc.get('zxl') # 获取

print(ret)

append

# import memcache

#

# mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.prepend('zxl', 'before') # 在该值 前面 插入内容

# # # zxl = "before2222" # 结果

# ret = mc.get('zxl') # 获取

# print(ret)

prepend

9、decr 和 incr

incr 自增,将Memcached中的某一个值增加 N ( N默认为1 )

decr 自减,将Memcached中的某一个值减少 N ( N默认为1 )

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

mc.set('sdf', '')

mc.incr('sdf') # 自增,默认为1

ret = mc.get('sdf') # 获取

# # # 结果

print(ret) mc.incr('sdf', ) # 后面的参数是自增10

ret = mc.get('sdf') # 获取

# # # 结果

print(ret)

incr

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True)

# mc.set('zsd', '')

# mc.decr('zsd') # 自减(默认为1)

# ret = mc.get('zsd') # 获取

# # # # 结果

# print(ret) mc.decr('zsd', ) # 自减(参数表示自减10)

ret = mc.get('zsd') # 获取

# # # 结果

print(ret)

decr

10、gets 和 cas

避免出现脏数据,比如京东购买商品,客户A买一件商品;客户B也买了件同样的商品。

在客户A买了件商品,在商品的总数量中减少一件;客户B也买了件也只是在商品的总数量基础上减少一件,

这样就出现总商品只是减少一件,但事实上总商品减少两件。

如果想避免出现此类情况,就使用gets和cas。

import memcache mc = memcache.Client(['192.168.126.131:12000'], debug=True, cache_cas=True)

v = mc.gets('fgh')

# 如果有人在gets之后和cas之前修改了fgh,那么,下面的设置将会执行失败,出现异常,从而避免非正常数据的产生

mc.cas('fgh', "888")

print(v)

PS:本质上每次执行gets时,会从memcache中获取一个自增的数字,通过cas去修改gets的值时,会携带之前获取的自增值

和memcache中的自增值进行比较,如果相同,则可以提交;如果不相同,那表示在gets和cas执行之间又有其他人执行了

gets(获取了缓冲的指定值),这样有可能出现脏数据,则不允许修改。

Redis(缓存)

一、解析

redis是一个key-value存储系统。和Memcached类似,它支持存储的value类型相对更多,包括string(字符串)、list(链表)、set(集合)、zset(sorted set --有序集合)和hash(哈希类型)。这些数据类型都支持push/pop、add/remove及取交集并集和差集及更丰富的操作,而且这些操作都是原子性的。在此基础上,redis支持各种不同方式的排序。与memcached一样,为了保证效率,数据都是缓存在内存中。区别的是redis会周期性的把更新的数据写入磁盘或者把修改操作写入追加的记录文件,并且在此基础上实现了master-slave(主从)同步。

二、安装

1、Redis安装和基本使用

wget http://download.redis.io/releases/redis-3.0.6.tar.gz

tar xzf redis-3.0.6.tar.gz

cd redis-3.0.6

make

2、启动服务端

src/redis-server

3、启动客户端

src/redis-cli

redis> set foo bar

OK

redis> get foo

"bar"

4、Python操作Redis

sudo pip install redis

or

sudo easy_install redis

or

源码安装 详见:https://github.com/WoLpH/redis-py

三、API使用

1、操作模式

redis-py提供两个类Redis和StrictRedis用于实现Redis的命令,StrictRedis用于实现大部分官方的命令,并使用官方的语法和命令,Redis是StrictRedis的子类,用于向后兼容旧版本的redis-py。

import redis r = redis.Redis(host='192.168.126.131', port=6379)

r.set('Bar', '8888') # 存储

ret = r.get('Bar') # 获取

print(ret)

2、连接池

redis-py使用connection pool来管理对一个redis server的所有连接,避免每次建立、释放连接的开销。默认,每个Redis实例都会维护一个自己的连接池。可以直接建立一个连接池,然后作为参数Redis,这样就可以实现多个Redis实例共享一个连接池。

import redis pool = redis.ConnectionPool(host='192.168.126.131', port=6379) r = redis.Redis(connection_pool=pool)

r.set('Wer', '9999')

ret = r.get('Wer')

print(ret)

3、操作

String 操作

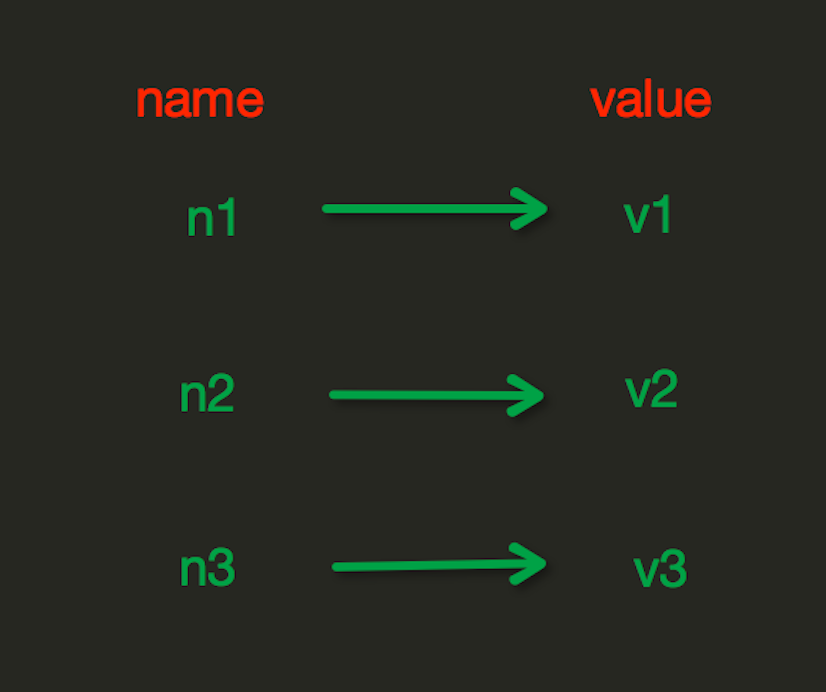

String操作,redis中的String在在内存中按照一个name对应一个value来存储

set(name, value, ex=None, px=None, nx=False, xx=False)

在Redis中设置值,默认,不存在则创建,存在则修改

参数: ex,过期时间(秒) px,过期时间(毫秒) nx,如果设置为True,则只有name不存在时,当前set操作才执行 xx,如果设置为True,则只有name存在时,岗前set操作才执行import redis r = redis.Redis(host='192.168.126.131', port=6379) # r.set(name, value, ex=None, px=None, nx=False, xx=False)

r.set('Bar', '8888', ex=5, px=None, nx=True, xx=False) # 存储 ret = r.get('Bar') # 获取

print(ret)

setnx(name, value)

设置值,只有name不存在时,执行设置操作(添加)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

r.setnx('Bac', '999') # setnx在不存在key就是这里的'Bac'才会设置操作

ret = r.get('Bac') # 获取

print(ret)

setex(name, value, time)

设置值:参数time,过期时间(数字秒 或 timedelta对象)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.setex('Bsc', '8888', 2) # setex在第三个参数(时间;时间的单位是秒)内设置操作

ret = r.get('Bsc') # 获取

print(ret)

psetex(name, time_ms, value)

设置值:参数time,过期时间(数字毫秒 或 timedelta对象)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

r.psetex('Bsv', '8888', 10) # psetex在第三个参数(时间;时间的单位是毫秒)内设置操作

ret = r.get('Bsv') # 获取

print(ret)

mset(*args, **kwargs) /mget(keys, *args) 批量设置、获取

批量设置值

如:

mset(k1='v1', k2='v2')

或

mget({'k1': 'v1', 'k2': 'v2'}) 批量获取

如:

mget('ylr', 'wupeiqi')

或

r.mget(['ylr', 'wupeiqi'])

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.mset({'Bsz': '8888', 'Dzx': '7777'}) # 批量设置值

ret = r.mget(['Bsz', 'Dzx']) # 批量获取值

print(ret)

getset(name, value)

设置新值并获取原来的值

import redis r = redis.Redis(host='192.168.126.131', port=6379)

r.set('Bsn', '8888') # 设置值

ret = r.getset('Bsn', '6666') # 设置新值并获取原来的值

print(ret)

getrange(key, start, end)

# 获取子序列(根据字节获取,非字符)

# 参数:

# name,Redis 的 name

# start,起始位置(字节)

# end,结束位置(字节)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.set('Ban', '孔维奇') # 设置值

ret = r.getrange('Ban', '6', '9') # 获取子序列(根据字节获取,非字符)

# # b'\xe5\xa5\x87' # 获取的结果

print(ret)

setrange(name, offset, value)

# 修改字符串内容,从指定字符串索引开始向后替换(新值太长时,则向后添加)

# 参数:

# offset,字符串的索引,字节(一个汉字三个字节)

# value,要设置的值

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.setrange('Bzn', '7', '孔维奇热爱生活') # 修改字符串内容,从指定字符串索引开始向后替换

ret = r.get('Bzn') # 获取子序列(根据字节获取,非字符)

print(ret)

setbit(name, offset, value)

# 对name对应值的二进制表示的位进行操作 # 参数:

# name,redis的name

# offset,位的索引(将值变换成二进制后再进行索引)

# value,值只能是 1 或 0 # 注:如果在Redis中有一个对应: n1 = "foo",

那么字符串foo的二进制表示为:01100110 01101111 01101111

所以,如果执行 setbit('n1', 7, 1),则就会将第7位设置为1,

那么最终二进制则变成 01100111 01101111 01101111,即:"goo" # 扩展,转换二进制表示: # source = "武沛齐"

source = "foo" for i in source:

num = ord(i)

print bin(num).replace('b','') 特别的,如果source是汉字 "武沛齐"怎么办?

答:对于utf-8,每一个汉字占 3 个字节,那么 "武沛齐" 则有 9个字节

对于汉字,for循环时候会按照 字节 迭代,那么在迭代时,将每一个字节转换 十进制数,然后再将十进制数转换成二进制

11100110 10101101 10100110 11100110 10110010 10011011 11101001 10111101 10010000

getbit(name, offset)

获取name对应的值的二进制表示中的某位的值 (0或1)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.setrange('Bzn', '7', '孔维奇热爱生活') # 修改字符串内容,从指定字符串索引开始向后替换

ret = r.getbit('Bzn', '5') # 获取name对应的值的二进制表示中的某位的值 (0或1)

print(ret)

# 执行结果 0

bitcount(key, start=None, end=None)

# 获取name对应的值的二进制表示中 1 的个数

# 参数:

# key,Redis的name

# start,位起始位置

# end,位结束位置

bitop(operation, dest, *keys)

# 获取多个值,并将值做位运算,将最后的结果保存至新的name对应的值 # 参数:

# operation,AND(并) 、 OR(或) 、 NOT(非) 、 XOR(异或)

# dest, 新的Redis的name

# *keys,要查找的Redis的name # 如:

bitop("AND", 'new_name', 'n1', 'n2', 'n3')

# 获取Redis中n1,n2,n3对应的值,然后讲所有的值做位运算(求并集),然后将结果保存 new_name 对应的值中

strlen(name)

返回name对应值的字节长度(一个汉字3个字节)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.set('Bcx', '孔维奇') # 设置值

ret = r.strlen('Bcx') # 返回name对应值的字节长度

print(ret)

# 执行结果 9

incr(self, name, amount=1) 自增(整数型)

# 自增 name对应的值,当name不存在时,则创建name=amount,否则,则自增。 # 参数:

# name,Redis的name

# amount,自增数(必须是整数) # 注:同incrby

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.set('Der', '555')

ret = r.incr('Der', 7) # incr自增(整数型)

print(ret)

# 执行结果 562

incrbyfloat(self, name, amount=1.0) 自增数(浮点型)

# 自增 name对应的值,当name不存在时,则创建name=amount,否则,则自增。 # 参数:

# name,Redis的name

# amount,自增数(浮点型)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.set('Dej', '555')

ret = r.incrbyfloat('Dej', 7.5) # incrbyfloat自增(浮点型)

print(ret)

# 执行结果 562.5

decr(self, name, amount=1) 自减数(整数)

# 自减 name对应的值,当name不存在时,则创建name=amount,否则,则自减。 # 参数:

# name,Redis的name

# amount,自减数(整数)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.set('Daj', '555')

ret = r.decr('Daj', 7) # decr自减

print(ret)

# 执行结果 548

append(key, value)

# 在redis name对应的值后面追加内容 # 参数:

key, redis的name

value, 要追加的字符串

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.set('Daj', '555')

r.append('Dah', '666')

res = r.get('Dah')

print(res)

# 执行结果 b'555666'

Hash 操作

Hash操作,redis中Hash在内存中的存储格式如下图

hset(name, key, value)/hget(name、key)

hset:name看做是一个键;'key, value'看做是name的值;'key, value'是一个键值对

hget:在name对应的hash中获取根据key获取value

# name对应的hash中设置一个键值对(不存在,则创建;否则,修改) # 参数:

# name,redis的name

# key,name对应的hash中的key

# value,name对应的hash中的value # 注:

# hsetnx(name, key, value),当name对应的hash中不存在当前key时则创建(相当于添加)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

r.hset('Dav', 'srf', '555') # 设置

# ret = r.hget('Dav', 'srf') # 获得Dav这个键对应值里的键'srf'的值

# print(ret)

hmset(name, mapping)/hmget(name, keys, *args)

hmset:在name对应的hash中批量设置键值对

hmget:在name对应的hash中获取多个key的值

hmset

# 参数:

# name,redis的name

# mapping,字典,如:{'k1':'v1', 'k2': 'v2'} # 如:

# r.hmset('xx', {'k1':'v1', 'k2': 'v2'})

hmget

# 参数:

# name,reids对应的name

# keys,要获取key集合,如:['k1', 'k2', 'k3']

# *args,要获取的key,如:k1,k2,k3 # 如:

# r.mget('xx', ['k1', 'k2'])

# 或

# print r.hmget('xx', 'k1', 'k2')

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'}) # # 在name对应的hash中批量设置键值对

ret = r.hmget('Fbn', ['frt', 'yui']) # 在name对应的hash中获取多个key的值

print(ret)

hgetall(name)

获取name对应hash的所有键值

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hgetall('Fbn') # 获取'Fbn'对应hash的所有键值

print(ret)

hlen(name)

获取name对应的hash中键值对的个数

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hlen('Fbn') # 获取'Fbn'对应的hash中键值对的个数

print(ret)

hkeys(name)

获取name对应的hash中所有的key的值

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hkeys('Fbn') # 获取'Fbn'对应的hash中所有的key的值

print(ret)

hvals(name)

获取name对应的hash中所有的value的值

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hvals('Fbn') # 获取'Fbn'对应的hash中所有的value的值

print(ret)

# 结果 [b'8888', b'6666', b'5555']

hexists(name, key)

检查name对应的hash是否存在当前传入的key

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hexists('Fbn', 'yui') # 获取'Fbn'对应的hash中所有的value的值

print(ret)

# True 返回的结果

hdel(name,*keys)

将name对应的hash中指定key的键值对删除

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hdel('Fbn', 'yui') # 将'Fbn'对应的hash中指定key的键值对删除

print(ret)

# 1 执行的结果(表示删除,如果没有执行结果是0)

hincrby(name, key, amount=1)

自增name对应的hash中的指定key的值,不存在则创建key=amount

# 参数:

# name,redis中的name

# key, hash对应的key

# amount,自增数(整数)

import redis r = redis.Redis(host='192.168.126.131', port=6379)

# r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

ret = r.hincrby('Fbn', 'yui', amount=1) # 自增name对应的hash中的指定key的值,不存在则创建key=amount

print(ret)

# 执行结果 5556

hincrbyfloat(name, key, amount=1.0)

自增name对应的hash中的指定key的值,不存在则创建key=amount

# 参数:

# name,redis中的name

# key, hash对应的key

# amount,自增数(浮点数) # 自增name对应的hash中的指定key的值,不存在则创建key=amount

# import redis

#

# r = redis.Redis(host='192.168.126.131', port=6379)

# # r.hmset('Fbn', {'frt':'6666', 'yui':'5555', 'kiu':'8888'})

# ret = r.hincrbyfloat('Fbn', 'yui', amount=7.7) # 自增name对应的hash中的指定key的值,不存在则创建key=amount;自增数(浮点数)

# print(ret)

# # 执行结果5562.7

hscan(name, cursor=0, match=None, count=None)

# 增量式迭代获取,对于数据大的数据非常有用,hscan可以实现分片的获取数据,并非一次性将数据全部获取完,从而放置内存被撑爆 # 参数:

# name,redis的name

# cursor,游标(基于游标分批取获取数据)

# match,匹配指定key,默认None 表示所有的key

# count,每次分片最少获取个数,默认None表示采用Redis的默认分片个数 # 如:

# 第一次:cursor1, data1 = r.hscan('xx', cursor=0, match=None, count=None)

# 第二次:cursor2, data1 = r.hscan('xx', cursor=cursor1, match=None, count=None)

# ...

# 直到返回值cursor的值为0时,表示数据已经通过分片获取完毕

hscan_iter(name, match=None, count=None)

# 利用yield封装hscan创建生成器,实现分批去redis中获取数据 # 参数:

# match,匹配指定key,默认None 表示所有的key

# count,每次分片最少获取个数,默认None表示采用Redis的默认分片个数 # 如:

# for item in r.hscan_iter('xx'):

# print item

List 操作

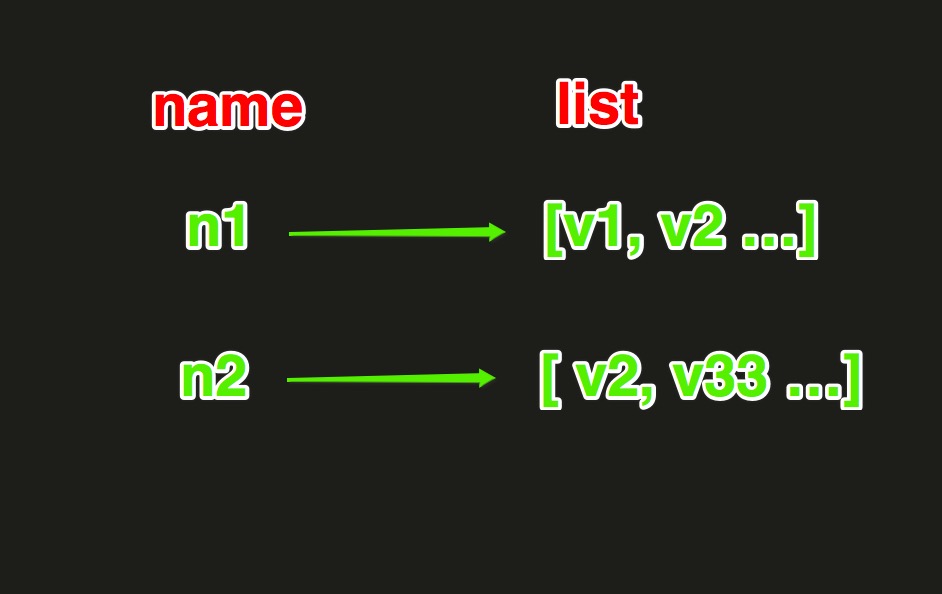

List操作,redis中的List在在内存中按照一个name对应一个List来存储

lpush(name,values)

# 在name对应的list中添加元素,每个新的元素都添加到列表的最左边 # 如:

# r.lpush('oo', 11,22,33)

# 保存顺序为: 33,22,11 # 扩展:

# rpush(name, values) 表示从右向左操作

lpushx(name,value)

# 在name对应的list中添加元素,只有name已经存在时,值添加到列表的最左边 # 更多:

# rpushx(name, value) 表示从右向左操作

llen(name)

# name对应的list元素的个数

linsert(name, where, refvalue, value))

# 在name对应的列表的某一个值前或后插入一个新值 # 参数:

# name,redis的name

# where,BEFORE或AFTER

# refvalue,标杆值,即:在它前后插入数据

# value,要插入的数据

lset(name, index, value)

# 对name对应的list中的某一个索引位置重新赋值 # 参数:

# name,redis的name

# index,list的索引位置

# value,要设置的值

lrem(name, value, num)

# 在name对应的list中删除指定的值 # 参数:

# name,redis的name

# value,要删除的值

# num, num=0,删除列表中所有的指定值;

# num=2,从前到后,删除2个;

# num=-2,从后向前,删除2个

lpop(name)

# 在name对应的列表的左侧获取第一个元素并在列表中移除,返回值则是第一个元素 # 更多:

# rpop(name) 表示从右向左操作

lindex(name, index)

在name对应的列表中根据索引获取列表元素

lrange(name, start, end)

# 在name对应的列表分片获取数据

# 参数:

# name,redis的name

# start,索引的起始位置

# end,索引结束位置

ltrim(name, start, end)

# 在name对应的列表中移除没有在start-end索引之间的值

# 参数:

# name,redis的name

# start,索引的起始位置

# end,索引结束位置

rpoplpush(src, dst)

# 从一个列表取出最右边的元素,同时将其添加至另一个列表的最左边

# 参数:

# src,要取数据的列表的name

# dst,要添加数据的列表的name

blpop(keys, timeout)

# 将多个列表排列,按照从左到右去pop对应列表的元素 # 参数:

# keys,redis的name的集合

# timeout,超时时间,当元素所有列表的元素获取完之后,阻塞等待列表内有数据的时间(秒), 0 表示永远阻塞 # 更多:

# r.brpop(keys, timeout),从右向左获取数据

brpoplpush(src, dst, timeout=0)

# 从一个列表的右侧移除一个元素并将其添加到另一个列表的左侧 # 参数:

# src,取出并要移除元素的列表对应的name

# dst,要插入元素的列表对应的name

# timeout,当src对应的列表中没有数据时,阻塞等待其有数据的超时时间(秒),0 表示永远阻塞

自定义增量迭代

# 由于redis类库中没有提供对列表元素的增量迭代,如果想要循环name对应的列表的所有元素,那么就需要:

# 1、获取name对应的所有列表

# 2、循环列表

# 但是,如果列表非常大,那么就有可能在第一步时就将程序的内容撑爆,所有有必要自定义一个增量迭代的功能: def list_iter(name):

"""

自定义redis列表增量迭代

:param name: redis中的name,即:迭代name对应的列表

:return: yield 返回 列表元素

"""

list_count = r.llen(name)

for index in xrange(list_count):

yield r.lindex(name, index) # 使用

for item in list_iter('pp'):

print item

Set 操作

Set操作,Set集合就是不允许重复的列表

sadd(name,values)

name对应的集合中添加元素

scard(name)

获取name对应的集合中元素个数

sdiff(keys, *args)

在第一个name对应的集合中且不在其他name对应的集合的元素集合

sdiffstore(dest, keys, *args)

获取第一个name对应的集合中且不在其他name对应的集合,再将其新加入到dest对应的集合中

sinter(keys, *args)

获取多一个name对应集合的并集

sinterstore(dest, keys, *args)

获取多一个name对应集合的并集,再讲其加入到dest对应的集合中

sismember(name, value)

检查value是否是name对应的集合的成员

smembers(name)

获取name对应的集合的所有成员

smove(src, dst, value)

将某个成员从一个集合中移动到另外一个集合

spop(name)

从集合的右侧(尾部)移除一个成员,并将其返回

srandmember(name, numbers)

从name对应的集合中随机获取 numbers 个元素

srem(name, values)

在name对应的集合中删除某些值

sunion(keys, *args)

获取多一个name对应的集合的并集

sunionstore(dest,keys, *args)

获取多一个name对应的集合的并集,并将结果保存到dest对应的集合中

sscan(name, cursor=0, match=None, count=None)

sscan_iter(name, match=None, count=None)

同字符串的操作,用于增量迭代分批获取元素,避免内存消耗太大

Sort Set 操作

有序集合,在集合的基础上,为每元素排序;元素的排序需要根据另外一个值来进行比较,所以,对于有序集合,每一个元素有两个值,即:值和分数,分数专门用来做排序。

zadd(name, *args, **kwargs)

# 在name对应的有序集合中添加元素

# 如:

# zadd('zz', 'n1', 1, 'n2', 2)

# 或

# zadd('zz', n1=11, n2=22)

zcard(name)

获取name对应的有序集合元素的数量

zcount(name, min, max)

获取name对应的有序集合中分数 在 [min,max] 之间的个数

zincrby(name, value, amount)

自增name对应的有序集合的 name 对应的分数

zrange( name, start, end, desc=False, withscores=False, score_cast_func=float)

# 按照索引范围获取name对应的有序集合的元素 # 参数:

# name,redis的name

# start,有序集合索引起始位置(非分数)

# end,有序集合索引结束位置(非分数)

# desc,排序规则,默认按照分数从小到大排序

# withscores,是否获取元素的分数,默认只获取元素的值

# score_cast_func,对分数进行数据转换的函数 # 更多:

# 从大到小排序

# zrevrange(name, start, end, withscores=False, score_cast_func=float) # 按照分数范围获取name对应的有序集合的元素

# zrangebyscore(name, min, max, start=None, num=None, withscores=False, score_cast_func=float)

# 从大到小排序

# zrevrangebyscore(name, max, min, start=None, num=None, withscores=False, score_cast_func=float)

zrank(name, value)

# 获取某个值在 name对应的有序集合中的排行(从 0 开始) # 更多:

# zrevrank(name, value),从大到小排序

zrangebylex(name, min, max, start=None, num=None)

# 当有序集合的所有成员都具有相同的分值时,有序集合的元素会根据成员的 值 (lexicographical ordering)来进行排序,

而这个命令则可以返回给定的有序集合键 key 中, 元素的值介于 min 和 max 之间的成员

# 对集合中的每个成员进行逐个字节的对比(byte-by-byte compare), 并按照从低到高的顺序, 返回排序后的集合成员。

如果两个字符串有一部分内容是相同的话, 那么命令会认为较长的字符串比较短的字符串要大 # 参数:

# name,redis的name

# min,左区间(值)。 + 表示正无限; - 表示负无限; ( 表示开区间; [ 则表示闭区间

# min,右区间(值)

# start,对结果进行分片处理,索引位置

# num,对结果进行分片处理,索引后面的num个元素 # 如:

# ZADD myzset 0 aa 0 ba 0 ca 0 da 0 ea 0 fa 0 ga

# r.zrangebylex('myzset', "-", "[ca") 结果为:['aa', 'ba', 'ca'] # 更多:

# 从大到小排序

# zrevrangebylex(name, max, min, start=None, num=None)

zrem(name, values)

# 删除name对应的有序集合中值是values的成员

# 如:zrem('zz', ['s1', 's2'])

zremrangebyrank(name, min, max)

根据排行范围删除

zremrangebyscore(name, min, max)

根据分数范围删除

zremrangebylex(name, min, max)

根据值返回删除

zscore(name, value)

获取name对应有序集合中 value 对应的分数

zinterstore(dest, keys, aggregate=None)

获取两个有序集合的交集,如果遇到相同值不同分数,则按照aggregate进行操作

aggregate的值为: SUM MIN MAX

zunionstore(dest, keys, aggregate=None)

# 获取两个有序集合的并集,如果遇到相同值不同分数,则按照aggregate进行操作

# aggregate的值为: SUM MIN MAX

zscan(name, cursor=0, match=None, count=None, score_cast_func=float)

zscan_iter(name, match=None, count=None,score_cast_func=float)

同字符串相似,相较于字符串新增score_cast_func,用来对分数进行操作

其他常用操作

delete(*names)

根据删除redis中的任意数据类型

exists(name)

检测redis的name是否存在

keys(pattern='*')

# 根据模型获取redis的name # 更多:

# KEYS * 匹配数据库中所有 key 。

# KEYS h?llo 匹配 hello , hallo 和 hxllo 等。

# KEYS h*llo 匹配 hllo 和 heeeeello 等。

# KEYS h[ae]llo 匹配 hello 和 hallo ,但不匹配 hillo

expire(name ,time)

# 为某个redis的某个name设置超时时间

rename(src, dst)

对redis的name重命名为

move(name, db))

将redis的某个值移动到指定的db下

randomkey()

随机获取一个redis的name(不删除)

type(name)

获取name对应值的类型

scan(cursor=0, match=None, count=None)

scan_iter(match=None, count=None)

同字符串操作,用于增量迭代获取key

4、管道

redis-py默认在执行每次请求都会创建(连接池申请连接)和断开(归还连接池)一次连接操作,

如果想要在一次请求中指定多个命令,则可以使用pipline实现一次请求指定多个命令,并且默认情况下

一次pipline是原子性操作。

import redis

pool = redis.ConnectionPool(host='192.168.126.131', port=6379)

r = redis.Redis(connection_pool=pool)

# pipe = r.pipeline(transaction=True)

# r.set('name', 'alex')

# r.set('svon', 'evn')

# pipe.execute()

print(r.get('name'))

print(r.get('svon'))

5、发布订阅

发布者:服务器

订阅者:Dashboad和数据处理

import redis r = redis.Redis(host='192.168.126.131')

r.publish('fm9999', 'sb')

发布者

import redis r = redis.Redis(host='192.168.126.131') pub = r.pubsub()

pub.subscribe('fm9999')

while True:

msg = pub.parse_response()

print(msg)

订阅者

更多参见:https://github.com/andymccurdy/redis-py/

http://doc.redisfans.com/

更多详见:http://www.cnblogs.com/wupeiqi/articles/5132791.html

http://www.rabbitmq.com/getstarted.html

http://www.cnblogs.com/yuanchenqi/articles/5755198.html

RabbitMQ、Memcache、Redis(队列、缓存)的更多相关文章

- .NET 环境中使用RabbitMQ RabbitMQ与Redis队列对比 RabbitMQ入门与使用篇

.NET 环境中使用RabbitMQ 在企业应用系统领域,会面对不同系统之间的通信.集成与整合,尤其当面临异构系统时,这种分布式的调用与通信变得越发重要.其次,系统中一般会有很多对实时性要求不高的 ...

- RabbitMQ与Redis队列对比

本文仅针对RabbitMQ与Redis做队列应用时的情况进行对比具体采用什么方式实现,还需要取决于系统的实际需求 简要介绍 RabbitMQ RabbitMQ是实现AMQP(高级消息队列协议)的消息中 ...

- 高并发简单解决方案————redis队列缓存+mysql 批量入库(ThinkPhP)

问题分析 问题一:要求日志最好入库:但是,直接入库mysql确实扛不住,批量入库没有问题,done.[批量入库和直接入库性能差异] 问题二:批量入库就需要有高并发的消息队列,决定采用redis lis ...

- 转载:【高并发简单解决方案 | 靠谱崔小拽 】redis队列缓存 + mysql 批量入库 + php离线整合

需求背景:有个调用统计日志存储和统计需求,要求存储到mysql中:存储数据高峰能达到日均千万,瓶颈在于直接入库并发太高,可能会把mysql干垮. 问题分析 思考:应用网站架构的衍化过程中,应用最新的框 ...

- redis 队列缓存 + mysql 批量入库 + php 离线整合

问题分析 思考:应用网站架构的衍化过程中,应用最新的框架和工具技术固然是最优选择:但是,如果能在现有的框架的基础上提出简单可依赖的解决方案,未尝不是一种提升自我的尝试. 解决: 问题一:要求日志最好入 ...

- 【高并发简单解决方案】redis队列缓存 + mysql 批量入库 + php离线整合

需求背景:有个调用统计日志存储和统计需求,要求存储到mysql中:存储数据高峰能达到日均千万,瓶颈在于直接入库并发太高,可能会把mysql干垮. 问题分析 思考:应用网站架构的衍化过程中,应用最新的框 ...

- ehcache memcache redis 三大缓存

最近项目组有用到这三个缓存,去各自的官方看了下,觉得还真的各有千秋!今天特意归纳下各个缓存的优缺点,仅供参考! Ehcache 在Java项目广泛的使用.它是一个开源的.设计于提高在数据从RDBMS ...

- ehcache memcache redis 三大缓存男高音

最近项目组有用到这三个缓存,去各自的官方看了下,觉得还真的各有千秋!今天特意归纳下各个缓存的优缺点,仅供参考! Ehcache 在java项目广泛的使用.它是一个开源的.设计于提高在数据从RDBMS ...

- FW:: ehcache memcache redis 三大缓存男高音

最近项目组有用到这三个缓存,去各自的官方看了下,觉得还真的各有千秋!今天特意归纳下各个缓存的优缺点,仅供参考! Ehcache 在java项目广泛的使用.它是一个开源的.设计于提高在数据从RDBMS ...

- NoSQL分类及ehcache memcache redis 三大缓存的对比

NoSQL分类 由于NoSQL中没有像传统数据库那样定义数据的组织方式为关系型的,所以只要内部的数据组织采用了非关系型的方式,就可以称之为NoSQL数据库.目前,可以将众多的NoSQL数据库按照内部的 ...

随机推荐

- javaee包含的服务和组件

参考自 http://blog.itpub.net/29990276/viewspace-1318551/

- android快速入门

1.安装环境(jre java 运行环境,jdk java 开发工具包) 2.android studio 一.快捷键的使用 1. To open any class in the editor q ...

- java 异常

异常简介 java中有Error和Exception Error:是程序无法处理的错误,表示运行应用程序中较严重问题.大多数错误与代码编写者执行操作无关,而表示运行时JVM出现的问题. Excepti ...

- Data storage on the batch layer

4.1 Storage requirements for the master dataset To determine the requirements for data storage, you ...

- Java xml object 互转

public class ClassRoom { private int id; private String name; private int grade; public int getId() ...

- IIS 工作原理之非托管代码旅程(一)

IIS6改变 IIS6可以为每个不同的虚拟目录创建不同的程序池,这样缩小了IIS的Application Pool的颗粒度,不同的虚拟目录之间是互不影响的. IIS6(和IIS7经典模式)与IIS7集 ...

- 系统不支持curl

解决安装pinphp时出现的“系统不支持curl!” 今天在本机安装phppin开源程序时,提示“系统不支持curl!”错误. 由于我本机是UBUNTU系统,所以直接通过apt-get进行安装. ...

- redis linux 安装及jedis连接测试

一.安装配置 1:下载redis下载地址 http://code.google.com/p/redis/downloads/list推荐下载redis-1.2.6.tar.gz,之前这个版本同事已经有 ...

- POJ 1637 Sightseeing tour (混合图欧拉路判定)

Sightseeing tour Time Limit: 1000MS Memory Limit: 10000K Total Submissions: 6986 Accepted: 2901 ...

- React Native交互组件之Touchable

React Native交互组件之Touchable:只要在组件外面包一个Touchable组件就可以实现点击交互. TouchableHighlight:高亮触摸 当点击时,组件的透明度会改变,可以 ...