k8s通过service访问pod(五)--技术流ken

service

每个 Pod 都有自己的 IP 地址。当 controller 用新 Pod 替代发生故障的 Pod 时,新 Pod 会分配到新的 IP 地址。这样就产生了一个问题:

如果一组 Pod 对外提供服务(比如 HTTP),它们的 IP 很有可能发生变化,那么客户端如何找到并访问这个服务呢?

Kubernetes 给出的解决方案是 Service。

创建 Service

Kubernetes Service 从逻辑上代表了一组 Pod,具体是哪些 Pod 则是由 label 来挑选。Service 有自己 IP,而且这个 IP 是不变的。客户端只需要访问 Service 的 IP,Kubernetes 则负责建立和维护 Service 与 Pod 的映射关系。无论后端 Pod 如何变化,对客户端不会有任何影响,因为 Service 没有变。

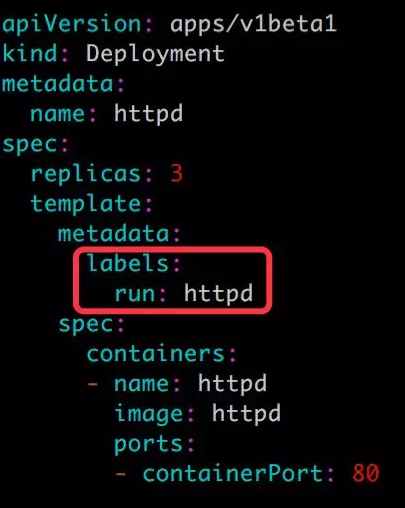

第一步:创建下面的这个 Deployment:

查看支持的apiversion使用命令kubectl api-versions

第二步:部署并查看pod

我们启动了三个 Pod,运行 httpd 镜像,label 是 run: httpd,Service 将会用这个 label 来挑选 Pod。

[root@ken ~]# kubectl apply -f httpd.yml

deployment.apps/httpd created

[root@ken ~]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

httpd-8c6c4bd9b-ljvlb / Running 41s 10.244.1.27 host1 <none> <none>

httpd-8c6c4bd9b-ngxqv / Running 41s 10.244.1.28 host1 <none> <none>

httpd-8c6c4bd9b-wxblj / Running 41s 10.244.2.18 host2 <none> <none>

第三步:集群内部测试连通性

Pod 分配了各自的 IP,这些 IP 只能被 Kubernetes Cluster 中的容器和节点访问。

[root@ken ~]# curl 10.244.1.28

<html><body><h1>It works!</h1></body></html>

[root@ken ~]# curl 10.244.1.27

<html><body><h1>It works!</h1></body></html>

[root@ken ~]# curl 10.244.2.18

<html><body><h1>It works!</h1></body></html>

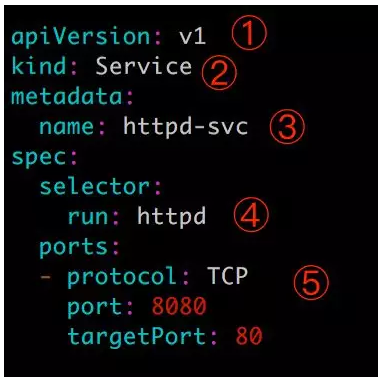

第四步:接下来创建 Service,其配置文件如下:

① v1 是 Service 的 apiVersion。

② 指明当前资源的类型为 Service。

③ Service 的名字为 httpd-svc。

④ selector 指明挑选那些 label 为 run: httpd 的 Pod 作为 Service 的后端。

⑤ 将 Service 的 8080 端口映射到 Pod 的 80 端口,使用 TCP 协议。

第五步: 执行 kubectl apply 创建 Service httpd-svc。

[root@ken ~]# kubectl apply -f service.yml

service/httpd-svc created

[root@ken ~]# kubectl get service

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

httpd-svc ClusterIP 10.106.64.97 <none> /TCP 17s

kubernetes ClusterIP 10.96.0.1 <none> /TCP 11h

httpd-svc 分配到一个 CLUSTER-IP 10.106.64.97。可以通过该 IP 访问后端的 httpd Pod。

[root@ken ~]# curl 10.106.64.97:

<html><body><h1>It works!</h1></body></html>

根据前面的端口映射,这里要使用 8080 端口。另外,除了我们创建的 httpd-svc,还有一个 Service kubernetes,Cluster 内部通过这个 Service 访问 kubernetes API Server。

通过 kubectl describe 可以查看 httpd-svc 与 Pod 的对应关系。

[root@ken ~]# kubectl describe service httpd-svc

Name: httpd-svc

Namespace: default

Labels: <none>

Annotations: kubectl.kubernetes.io/last-applied-configuration:

{"apiVersion":"v1","kind":"Service","metadata":{"annotations":{},"name":"httpd-svc","namespace":"default"},"spec":{"ports":[{"port":,"...

Selector: run=httpd

Type: ClusterIP

IP: 10.106.64.97

Port: <unset> /TCP

TargetPort: /TCP

Endpoints: 10.244.1.27:,10.244.1.28:,10.244.2.18:

Session Affinity: None

Events: <none>

Endpoints 罗列了三个 Pod 的 IP 和端口。

DNS访问service

在 Cluster 中,除了可以通过 Cluster IP 访问 Service,Kubernetes 还提供了更为方便的 DNS 访问。

第一步:查看coredns

kubeadm 部署时会默认安装 coredns 组件。

[root@ken ~]# kubectl get deployment --namespace=kube-system

NAME READY UP-TO-DATE AVAILABLE AGE

coredns / 11h

coredns 是一个 DNS 服务器。每当有新的 Service 被创建,coredns 会添加该 Service 的 DNS 记录。Cluster 中的 Pod 可以通过 <SERVICE_NAME>.<NAMESPACE_NAME> 访问 Service。

第二步:dns访问

比如可以用 httpd-svc.default 访问 Service httpd-svc。

[root@ken ~]# kubectl run busybox --rm -it --image=busybox /bin/sh

/ # wget httpd-svc:

Connecting to httpd-svc: (10.106.64.97:)

index.html % |*************| :: ETA

/ # ls

bin home root usr

dev index.html sys var

etc proc tmp

/ # cat index.html

<html><body><h1>It works!</h1></body></html>

由于这个 Pod 与 httpd-svc 同属于 default namespace,可以省略 default 直接用 httpd-svc 访问 Service。

第三步:查看namespace

如果要访问其他 namespace 中的 Service,就必须带上 namesapce 了。kubectl get namespace 查看已有的 namespace。

[root@ken ~]# kubectl get namespace

NAME STATUS AGE

default Active 11h

kube-public Active 11h

kube-system Active 11h

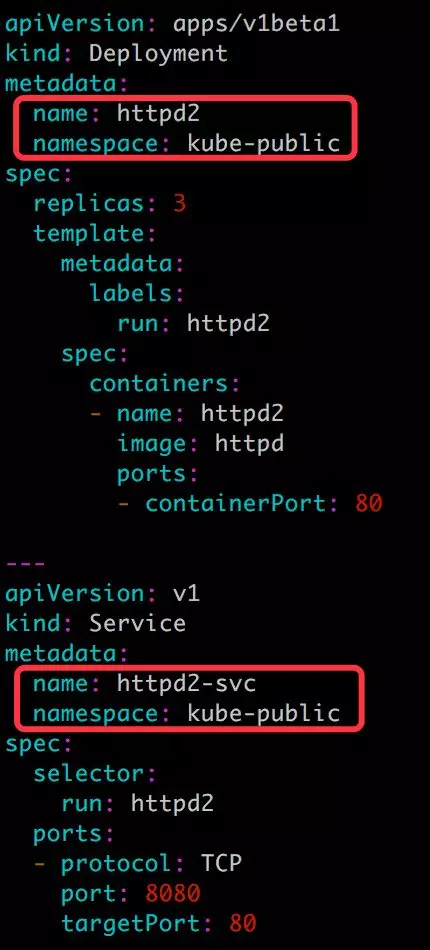

第四步:在 kube-public 中部署 Service httpd2-svc

配置如下:

第五步:创建资源

通过 namespace: kube-public 指定资源所属的 namespace。多个资源可以在一个 YAML 文件中定义,用 --- 分割。执行 kubectl apply 创建资源:

[root@ken ~]# kubectl apply -f service.yml

deployment.apps/httpd2 created

service/httpd2-svc created

第六步:查看 kube-public 的 Service:

[root@ken ~]# kubectl get service --namespace=kube-public

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

httpd2-svc ClusterIP 10.111.175.138 <none> /TCP 63s

第七步:在 busybox Pod 中访问 httpd2-svc:

[root@ken ~]# kubectl run busybox --rm -it --image=busybox /bin/sh

/ # wget httpd2-svc:

wget: bad address 'httpd2-svc:8080'

/ # wget httpd2-svc.kube-public:

Connecting to httpd2-svc.kube-public: (10.111.175.138:)

index.html % |*************| :: ETA

因为属于不同的 namespace,必须使用 httpd2-svc.kube-public 才能访问到。

外网访问service

除了 Cluster 内部可以访问 Service,很多情况我们也希望应用的 Service 能够暴露给 Cluster 外部。Kubernetes 提供了多种类型的 Service,默认是 ClusterIP。

ClusterIP

Service 通过 Cluster 内部的 IP 对外提供服务,只有 Cluster 内的节点和 Pod 可访问,这是默认的 Service 类型,前面实验中的 Service 都是 ClusterIP。

NodePort

Service 通过 Cluster 节点的静态端口对外提供服务。Cluster 外部可以通过 <NodeIP>:<NodePort> 访问 Service。

LoadBalancer

Service 利用 cloud provider 特有的 load balancer 对外提供服务,cloud provider 负责将 load balancer 的流量导向 Service。目前支持的 cloud provider 有 GCP、AWS、Azur 等。

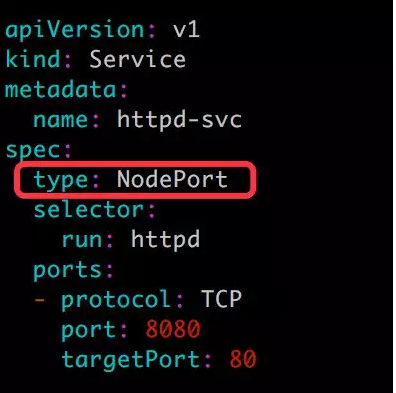

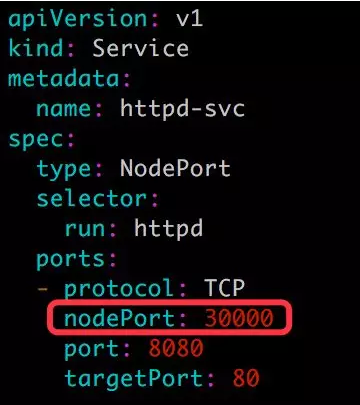

第一步:实践 NodePort,Service httpd-svc 的配置文件修改如下:

添加 type: NodePort,重新创建 httpd-svc。

第二步:创建service

[root@ken ~]# kubectl apply -f service.yml

service/httpd-svc created

[root@ken ~]# kubectl get service httpd-svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

httpd-svc NodePort 10.108.118.202 <none> :/TCP 12s

Kubernetes 依然会为 httpd-svc 分配一个 ClusterIP,不同的是:

EXTERNAL-IP 为 nodes,表示可通过 Cluster 每个节点自身的 IP 访问 Service。

PORT(S) 为 8080:31785。8080 是 ClusterIP 监听的端口(每个节点都有该端口),31785 则是节点上监听的端口。Kubernetes 会从 30000-32767 中分配一个可用的端口,每个节点都会监听此端口并将请求转发给 Service。

[root@ken ~]# ss -tnl | grep

LISTEN ::: :::*

第三步:测试nodeport是否正常工作

[root@ken ~]# curl 172.20.10.2:

<html><body><h1>It works!</h1></body></html>

[root@ken ~]# curl 172.20.10.7:

<html><body><h1>It works!</h1></body></html>

[root@ken ~]# curl 172.20.10.9:

<html><body><h1>It works!</h1></body></html>

通过三个节点 IP + 32312 端口都能够访问 httpd-svc。

第四步:指定特定端口

NodePort 默认是的随机选择,不过我们可以用 nodePort 指定某个特定端口。

现在配置文件中就有三个 Port 了:

nodePort 是节点上监听的端口。

port 是 ClusterIP 上监听的端口。

targetPort 是 Pod 监听的端口。

最终,Node 和 ClusterIP 在各自端口上接收到的请求都会通过 iptables 转发到 Pod 的 targetPort。

第四步:应用新的 nodePort 并验证:

[root@ken ~]# kubectl apply -f service.yml

service/httpd-svc configured [root@ken ~]# kubectl get service httpd-svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

httpd-svc NodePort 10.108.118.202 <none> :/TCP 6m8s [root@ken ~]# curl 172.20.10.2:

<html><body><h1>It works!</h1></body></html>

[root@ken ~]# curl 172.20.10.7:

<html><body><h1>It works!</h1></body></html>

[root@ken ~]# curl 172.20.10.9:

<html><body><h1>It works!</h1></body></html>

nodePort: 30000 已经生效了。

k8s通过service访问pod(五)--技术流ken的更多相关文章

- linux运维、架构之路-K8s通过Service访问Pod

一.通过Service访问Pod 每个Pod都有自己的IP地址,当Controller用新的Pod替换发生故障的Pod时,新Pod会分配到新的IP地址,例如:有一组Pod对外提供HTTP服务,它们的I ...

- k8s架构分析(二)--技术流ken

master节点 k8s的集群由master和node组成,节点上运行着若干k8s服务. master节点之上运行着的后台服务有kube-apiserver .kube-scheduler.kube- ...

- k8s通过service访问pod(五)

service 每个 Pod 都有自己的 IP 地址.当 controller 用新 Pod 替代发生故障的 Pod 时,新 Pod 会分配到新的 IP 地址.这样就产生了一个问题: 如果一组 Pod ...

- k8s通过Service访问Pod

如何创建服务 1.创建Deployment #启动三个pod,运行httpd镜像,label是run:mcw-httpd,Seveice将会根据这个label挑选PodapiVersion: apps ...

- k8s重要概念及部署k8s集群(一)--技术流ken

重要概念 1. cluster cluster是 计算.存储和网络资源的集合,k8s利用这些资源运行各种基于容器的应用. 2.master master是cluster的大脑,他的主要职责是调度,即决 ...

- k8s健康检查(七)--技术流ken

默认的健康检查 强大的自愈能力是 Kubernetes 这类容器编排引擎的一个重要特性.自愈的默认实现方式是自动重启发生故障的容器.除此之外,用户还可以利用 Liveness 和 Readiness ...

- k8s滚动更新(六)--技术流ken

实践 滚动更新是一次只更新一小部分副本,成功后,再更新更多的副本,最终完成所有副本的更新.滚动更新的最大的好处是零停机,整个更新过程始终有副本在运行,从而保证了业务的连续性. 下面我们部署三副本应用, ...

- k8s集群监控(十一)--技术流ken

Weave Scope 在我之前的docker监控中<Docker容器监控(十)--技术流ken>就已经提到了weave scope. Weave Scope 是 Docker 和 K ...

- 五分钟彻底学会iptables防火墙--技术流ken

iptables简介 IPTABLES 是与最新的 3.5 版本 Linux内核集成的 IP 信息包过滤系统.如果 Linux 系统连接到因特网或 LAN.服务器或连接 LAN 和因特网的代理服务器, ...

随机推荐

- java课程之团队开发冲刺阶段1.6

一.总结昨天进度 1.依照视频学习了sqlite,但是由于视频的不完整性导致并不知道代码的实际效果怎么样. 二.遇到的问题 1.依据上一条,在date目录下date文件夹中,的确发现了数据库的文件,但 ...

- PHP实现微信模板消息发送给指定用户

使用公众号的模板消息功能,必须是认证过的服务号,需要发送微信号的openid,同一微信号在不同公众号下的openid是不同的,在公众号下是唯一的,获取不到微信号 进入公众平台 功能->模板消息 ...

- CF F. Shovels Shop(前缀和预处理+贪心+dp)

F. Shovels Shop time limit per test 2 seconds memory limit per test 256 megabytes input standard inp ...

- NET Core微服务之路:基于Ocelot的API网关Relay实现--RPC篇

前言 我们都知道,API网关是工作在应用层上网关程序,为何要这样设计呢,而不是将网关程序直接工作在传输层.或者网络层等等更底层的环境呢?让我们先来简单的了解一下TCP/IP的五层模型. (图片 ...

- PuppeteerSharp+AngleSharp的爬虫实战之汽车之家数据抓取

参考了DotNetSpider示例, 感觉DotNetSpider太重了,它是一个比较完整的爬虫框架. 对比了以下各种无头浏览器,最终采用PuppeteerSharp+AngleSharp写一个爬虫示 ...

- C#的几种文件操作方法

创建或覆盖文件 需求:如果文件不存在,创建之,如果存在,覆盖之. 1,可能有问题的方法 using (FileStream fs = File.OpenWrite(@"d:\work\1.t ...

- [Swift]LeetCode80. 删除排序数组中的重复项 II | Remove Duplicates from Sorted Array II

Given a sorted array nums, remove the duplicates in-place such that duplicates appeared at most twic ...

- [Swift]LeetCode124. 二叉树中的最大路径和 | Binary Tree Maximum Path Sum

Given a non-empty binary tree, find the maximum path sum. For this problem, a path is defined as any ...

- [Swift]LeetCode299. 猜数字游戏 | Bulls and Cows

You are playing the following Bulls and Cows game with your friend: You write down a number and ask ...

- python安装whl文件

在命令指示符下(cmd)的Python3安装命令为: pip3 install 文件名.whl 安装出错: matplotlib-2.0.0-cp34-cp34m-win_amd64.whl is n ...