Andrew Ng机器学习课程,第一周作业,python版本

Liner Regression

1.梯度下降算法

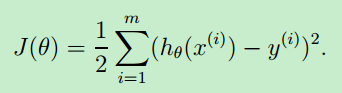

Cost Function

对其求导:

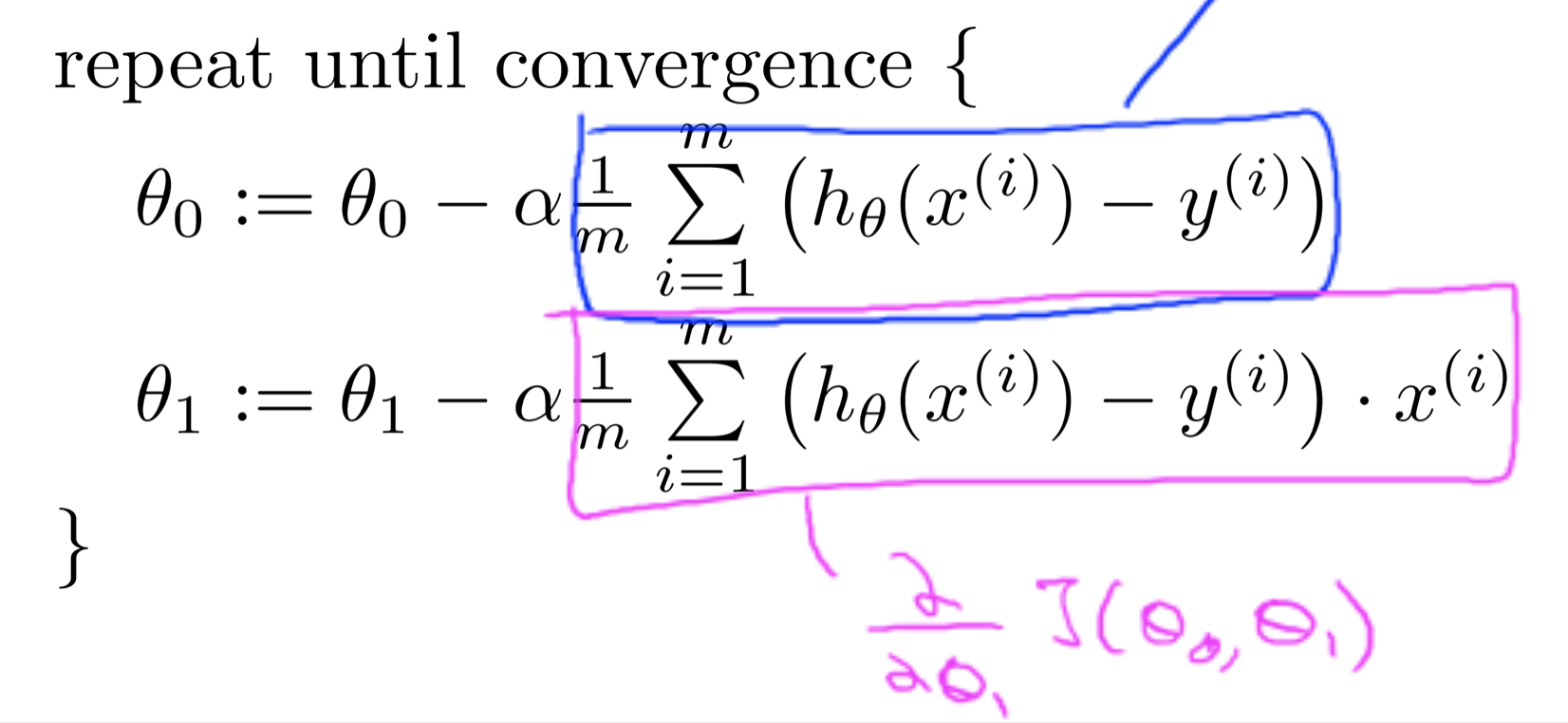

theta更新函数:

代码如下:

from numpy import *

import numpy as np

import matplotlib.pyplot as plt def loadDataSet(filename):

data = []

label = []

fr = open(filename)

for line in fr.readlines():

curLine = line.strip().split(',')

a = [1.0]

a.append(float(curLine[0]))

data.append(a)

label.append([float(curLine[1])])

return data, label def computeCost(X, Y, theta):

theta = mat(theta)

m = shape(X)[0]

J = 1 / (2 * m) * sum(array((X * theta - Y))**2)

return J #矩阵形式的梯度下降算法

def gradientDescentMatrix(X, y, theta, alpha, iterations):

m = shape(y)[0]

theta_s = theta.copy()

for i in range(iterations):

theta = theta - alpha/m * (X.T *(X * theta - y))

return theta #梯度下降算法

def gradientDescent(X, y, theta, alpha, iterations):

m = len(y)

# theta_s = theta :此表达式中共享内存空间

theta_s = theta.copy()

for i in range(iterations):

theta[0] = theta[0] - (alpha/m) * np.sum(np.mat(X)*np.mat(theta_s) - np.mat(y))

p1 = np.mat(X)*np.mat(theta_s) - np.mat(y)

p2 = X[:, 1]*p1

# print(p2)

theta[1] = theta[1] - (alpha / m) * p2

# print(theta[1])

theta_s = theta.copy()

return theta def Plotting(x, y, theta):

f2 = plt.figure(2)

p1 = plt.scatter(x, y, marker='x', color='r', label='Training Data', s=30) x1 = np.linspace(0, 25, 30)

y1 = theta[0] + theta[1] * x1 plt.plot(x1, y1, label="Test Data", color='b') plt.legend(loc='upper right')

plt.show() dataSet, label = loadDataSet("ex1data1.txt")

theta = zeros((2, 1))

iterations = 1500

alpha = 0.01 #数组格式X, Y

X = array(dataSet)

Y = array(label) #矩阵格式 XMat, YMat

XMat = mat(X)

YMat = mat(Y) if 1: #梯度下降算法

theta = gradientDescent(X, Y, theta, alpha, iterations)

else: #矩阵形式的梯度下降算法

theta = gradientDescentMatrix(XMat, YMat, mat(theta), alpha, iterations)

print(theta) x = []

for k in dataSet:

x.append([k[1]])

Plotting(array(x), Y, theta)

代码中对于梯度下降算法有两种形式,一种就是一般形式 gradientDescent(),另一种就是矩阵形式gradientDescentMatrix()

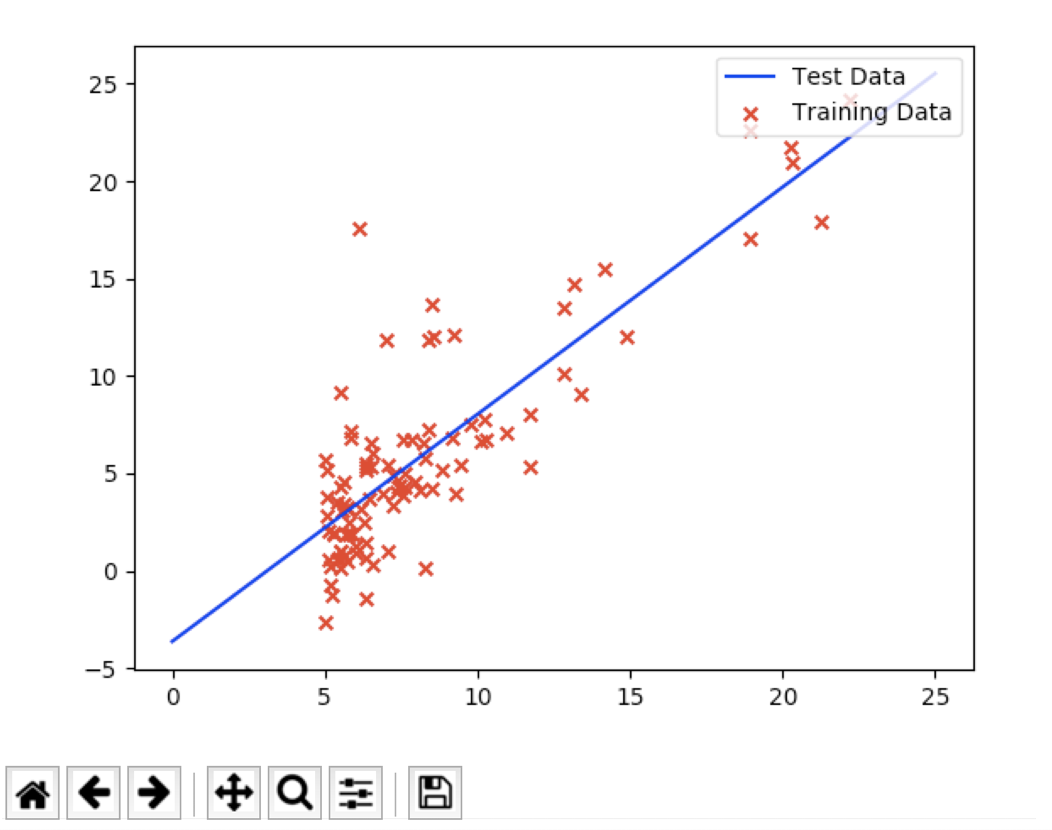

运行效果:

Andrew Ng机器学习课程,第一周作业,python版本的更多相关文章

- Stanford coursera Andrew Ng 机器学习课程第二周总结(附Exercise 1)

Exercise 1:Linear Regression---实现一个线性回归 重要公式 1.h(θ)函数 2.J(θ)函数 思考一下,在matlab里面怎么表达?如下: 原理如下:(如果你懂了这道作 ...

- Andrew Ng机器学习课程笔记(五)之应用机器学习的建议

Andrew Ng机器学习课程笔记(五)之 应用机器学习的建议 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7368472.h ...

- Andrew Ng机器学习课程笔记(四)之神经网络

Andrew Ng机器学习课程笔记(四)之神经网络 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7365730.html 前言 ...

- Andrew Ng机器学习课程笔记(三)之正则化

Andrew Ng机器学习课程笔记(三)之正则化 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7365475.html 前言 ...

- Andrew Ng机器学习课程笔记(一)之线性回归

Andrew Ng机器学习课程笔记(一)之线性回归 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7364598.html 前言 ...

- Andrew Ng机器学习课程笔记--week1(机器学习介绍及线性回归)

title: Andrew Ng机器学习课程笔记--week1(机器学习介绍及线性回归) tags: 机器学习, 学习笔记 grammar_cjkRuby: true --- 之前看过一遍,但是总是模 ...

- Andrew Ng机器学习课程笔记--汇总

笔记总结,各章节主要内容已总结在标题之中 Andrew Ng机器学习课程笔记–week1(机器学习简介&线性回归模型) Andrew Ng机器学习课程笔记--week2(多元线性回归& ...

- Andrew Ng机器学习课程笔记(六)之 机器学习系统的设计

Andrew Ng机器学习课程笔记(六)之 机器学习系统的设计 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7392408.h ...

- Andrew Ng机器学习课程笔记(二)之逻辑回归

Andrew Ng机器学习课程笔记(二)之逻辑回归 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7364636.html 前言 ...

- Andrew Ng机器学习课程6

Andrew Ng机器学习课程6 说明 在前面尾随者台大机器学习基石课程和机器学习技法课程的设置,对机器学习所涉及到的大部分的知识有了一个较为全面的了解,可是对于没有动手敲代码并加以使用的情况,基本上 ...

随机推荐

- 继承类中static数据值

class A{ static int num = 1; public static void Display(){ System.out.println( num ); } } class B ex ...

- LOJ#6503.「雅礼集训 2018 Day4」Magic[容斥+NTT+启发式合并]

题意 \(n\) 张卡牌 \(m\) 种颜色,询问有多少种本质不同的序列满足相邻颜色相同的位置数量等于 \(k\). 分析 首先本质不同不好直接处理,可以将同种颜色的卡牌看作是不相同的,求出答案后除以 ...

- 【Orleans开胃菜系列1】不要被表象迷惑

[Orleans开胃菜系列1]不要被表象迷惑 /** * prism.js Github theme based on GitHub's theme. * @author Sam Clarke */ ...

- python3绝对路径,相对路径

from __future__ import absolute_import的作用: 直观地看就是说”加入绝对引入这个新特性”.说到绝对引入,当然就会想到相对引入.那么什么是相对引入呢?比如说,你的包 ...

- [翻译]:Cinemachine 官方文档(0)

目录 Overview : Installation and Getting Started :安装并开始 User Guide :用户指南 What is Cinemachine? : 什么是Cin ...

- coinmarketcap前20之cardano卡尔达诺(ADA艾达币)

1. 在开始讲述cardano前,我先说说自己在coinmarketcap前20系列的"学习方法". 最初,我把前20做了一个简单表格,不做任何功课的基础上,记录自己对它们的简要认 ...

- 【Alpha】第七次Scrum meeting

今日任务一览: 姓名 今日完成任务 所耗时间 刘乾 今日没有做很多事...一天都在沟通细化需求与画电路图 2 鲁聃 生成物理报告实验页面的生成 Issue链接:https://github.com/b ...

- ElasticSearch 2 (3) - Breaking Changes

ElasticSearch 2.1.1 (3) - Breaking Changes Search Changes search_type = scan Deprecated GET /my_ind ...

- PAT 甲级 1105 Spiral Matrix

https://pintia.cn/problem-sets/994805342720868352/problems/994805363117768704 This time your job is ...

- HDU 2015 偶数求和

http://acm.hdu.edu.cn/showproblem.php?pid=2015 Problem Description 有一个长度为n(n<=100)的数列,该数列定义为从2开始的 ...