python爬虫——用selenium爬取京东商品信息

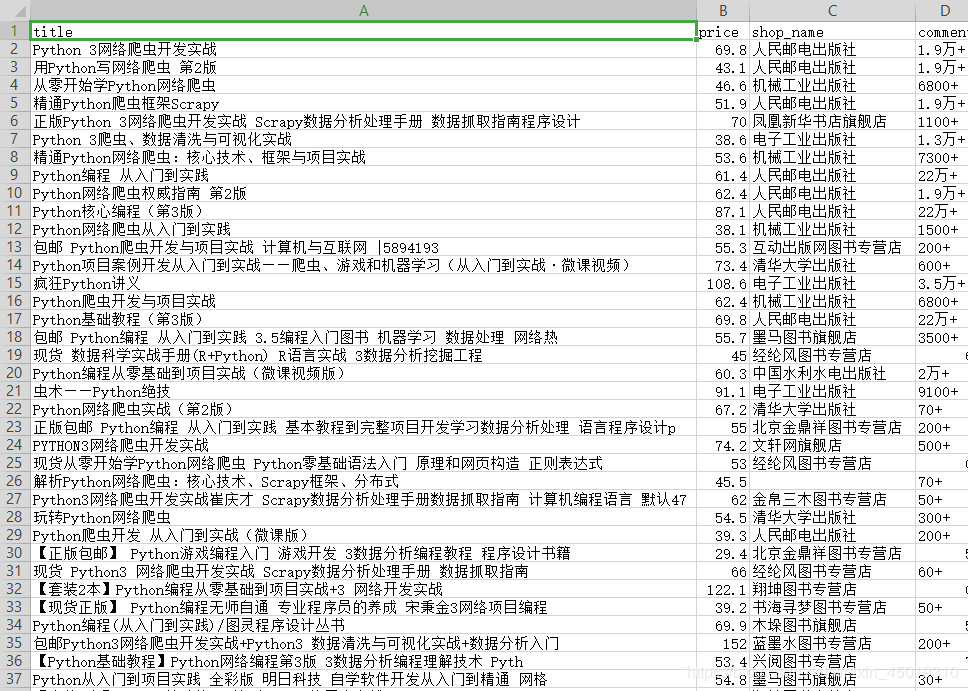

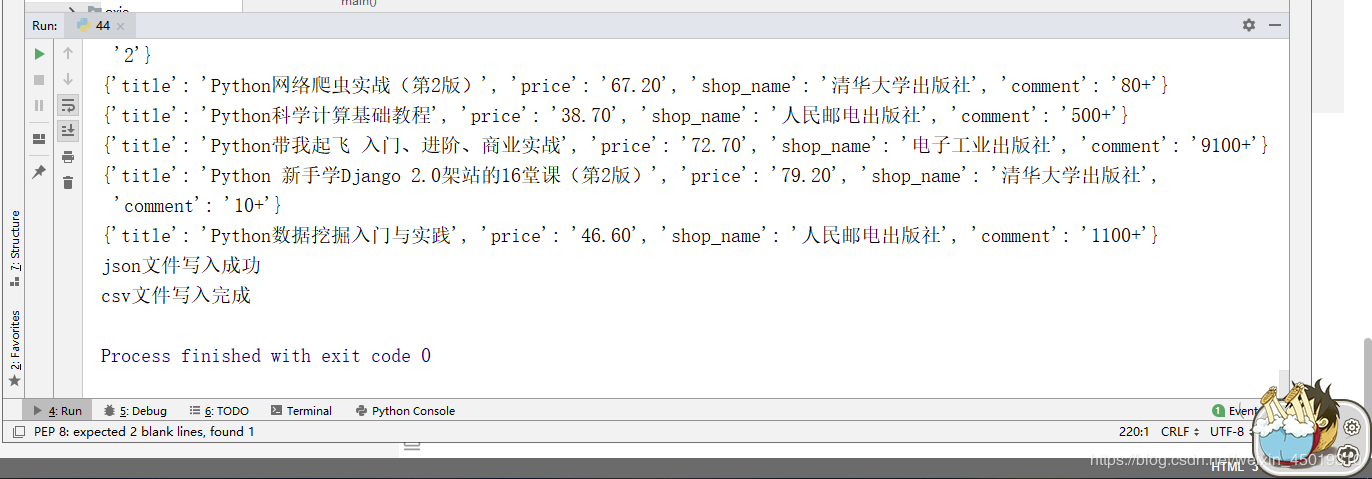

1.先附上效果图(我偷懒只爬了4页)

2.京东的网址https://www.jd.com/

3.我这里是不加载图片,加快爬取速度,也可以用Headless无弹窗模式

options = webdriver.ChromeOptions()

options.add_experimental_option('prefs', {'profile.managed_default_content_settings.images': 2})

#不加载图片

browser = webdriver.Chrome(options=options)

wait =WebDriverWait(browser,50)#设置等待时间

url = 'https://www.jd.com/'

data_list = []#设置全局变量用来存储数据

keyword="python爬虫"#关键词

4.先找到搜索框并用selenium模拟点击(这里发现京东不需要登录就能看到商品信息)

def search():

browser.get('https://www.jd.com/')

try:

input = wait.until(

EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#key"))

) #等到搜索框加载出来

submit = wait.until(

EC.element_to_be_clickable((By.CSS_SELECTOR, "#search > div > div.form > button"))

)#等到搜索按钮可以被点击

input[0].send_keys(keyword)#向搜索框内输入关键词

submit.click()#点击

total = wait.until(

EC.presence_of_all_elements_located(

(By.CSS_SELECTOR, '#J_bottomPage > span.p-skip > em:nth-child(1) > b')

)

)#记录一下总页码,等到总页码加载出来

html = browser.page_source#获取网页信息

prase_html(html)#调用提取数据的函数(后面才写到)

return total[0].text

except TimeoutError:

search()

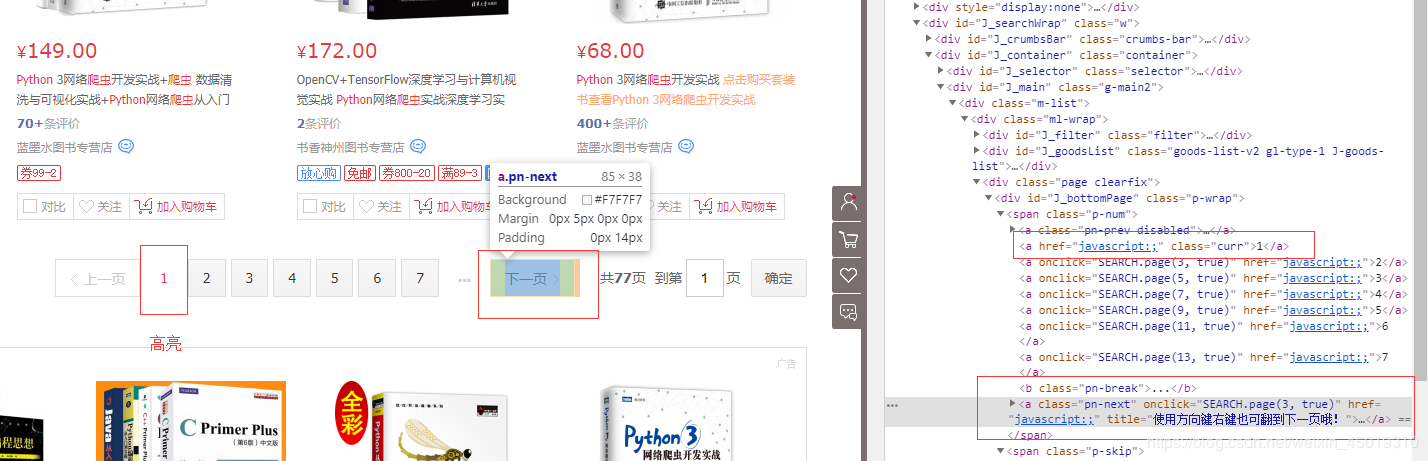

5.进入了第一页,先写好翻页的函数,需要滑动到底部才能加载后30个商品,总共有60个商品

def next_page(page_number):

try:

# 滑动到底部

browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(random.randint(1, 3))#设置随机延迟

button = wait.until(

EC.element_to_be_clickable((By.CSS_SELECTOR, '#J_bottomPage > span.p-num > a.pn-next > em'))

)#翻页按钮

button.click()# 翻页动作

wait.until(

EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#J_goodsList > ul > li:nth-child(30)"))

)#等到30个商品都加载出来

# 滑动到底部,加载出后三十个货物信息

browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

wait.until(

EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#J_goodsList > ul > li:nth-child(60)"))

)#等到60个商品都加载出来

wait.until(

EC.text_to_be_present_in_element((By.CSS_SELECTOR, "#J_bottomPage > span.p-num > a.curr"), str(page_number))

)# 判断翻页成功,高亮的按钮数字与设置的页码一样

html = browser.page_source#获取网页信息

prase_html(html)#调用提取数据的函数

except TimeoutError:

return next_page(page_number)

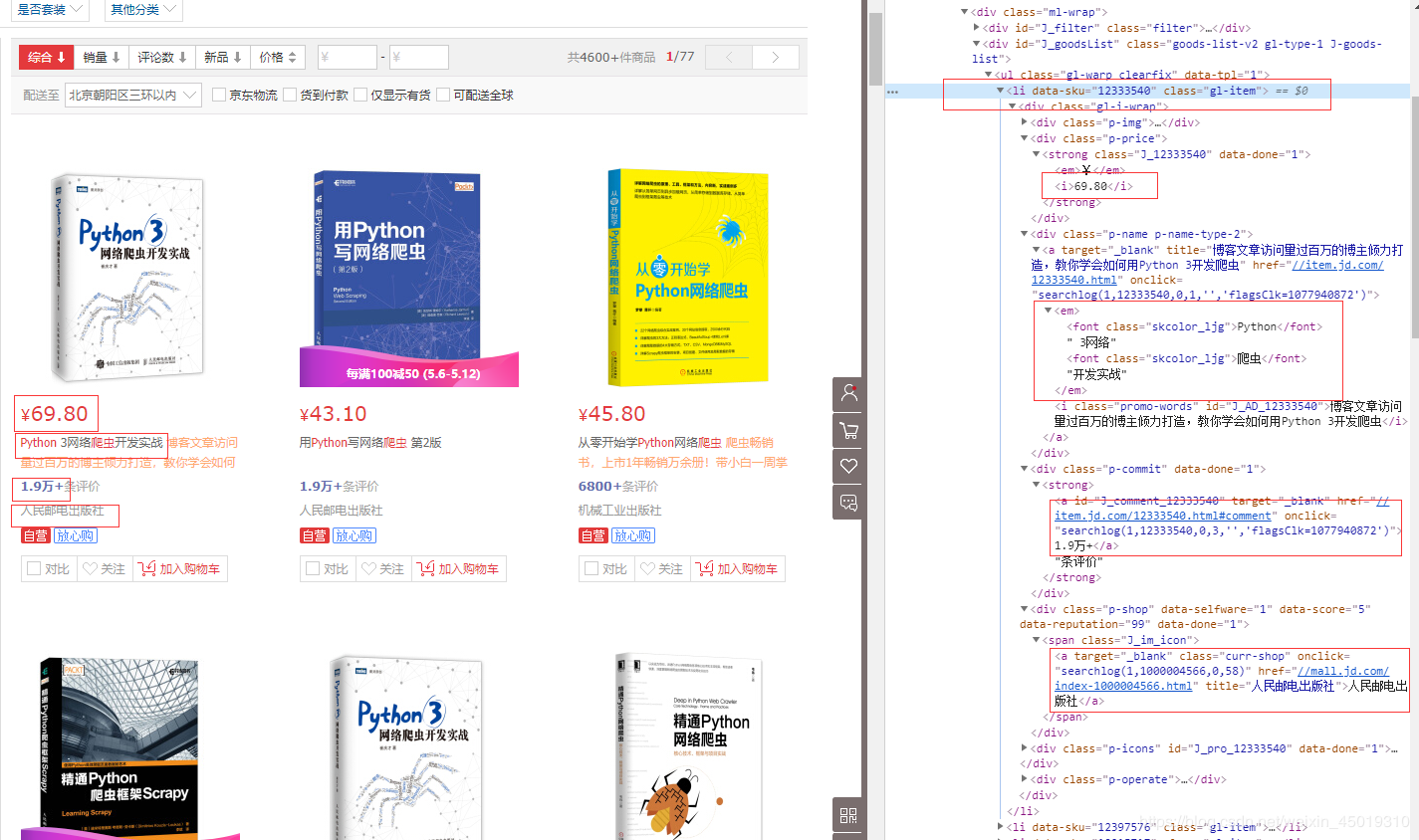

6.能正常翻页就简单很多了,开始抽取需要的商品信息,搜索不同的关键词,页面的布局会有变化,需要重新写定位商品信息

def prase_html(html):

html = etree.HTML(html)

# 开始提取信息,找到ul标签下的全部li标签

try:

lis = browser.find_elements_by_class_name('gl-item')

# 遍历

for li in lis:

# 名字

title = li.find_element_by_xpath('.//div[@class="p-name p-name-type-2"]//em').text

# 价格

price = li.find_element_by_xpath('.//div[@class="p-price"]//i').text

# 评论数

comment = li.find_elements_by_xpath('.//div[@class="p-commit"]//a')

# 商铺名字

shop_name = li.find_elements_by_xpath('.//div[@class="p-shop"]//a')

if comment:

comment = comment[0].text

else:

comment = None

if shop_name:

shop_name = shop_name[0].text

else:

shop_name = None

data_dict ={}#写入字典

data_dict["title"] = title

data_dict["price"] = price

data_dict["shop_name"] = shop_name

data_dict["comment"] = comment

print(data_dict)

data_list.append(data_dict)#写入全局变量

except TimeoutError:

prase_html(html)

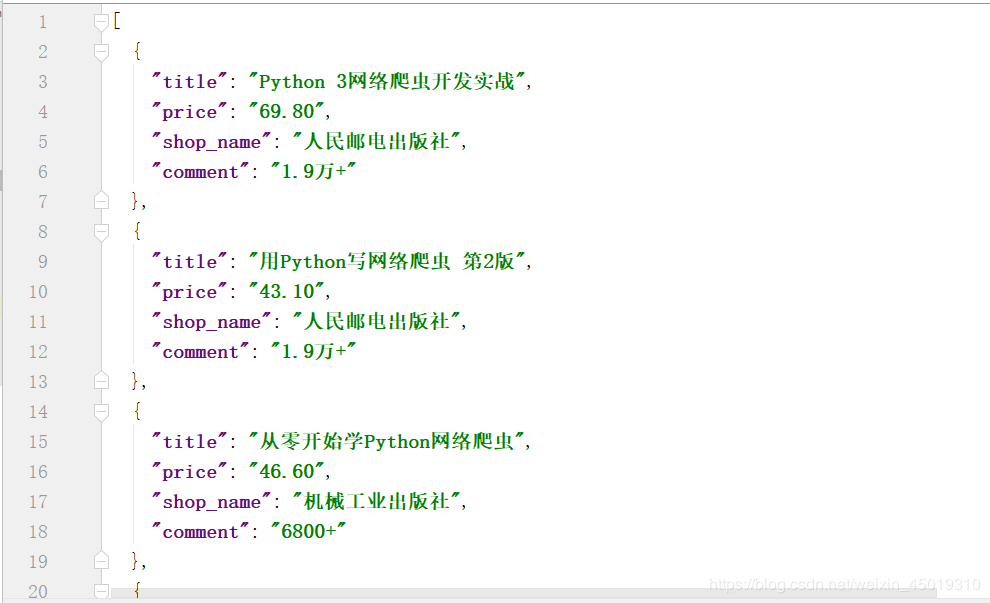

7.存储方法

def save_html():

content = json.dumps(data_list, ensure_ascii=False, indent=2)

#把全局变量转化为json数据

with open("jingdong.json", "a+", encoding="utf-8") as f:

f.write(content)

print("json文件写入成功") with open('jingdong.csv', 'w', encoding='utf-8', newline='') as f:

# 表头

title = data_list[0].keys()

# 声明writer

writer = csv.DictWriter(f, title)

# 写入表头

writer.writeheader()

# 批量写入数据

writer.writerows(data_list)

print('csv文件写入完成')

8.开始调用

def main():

print("第", 1, "页:")

total = int(search())

for i in range(2, 5):

# for i in range(2, total + 1):#想全爬的就用这个循环

time.sleep(random.randint(1, 3))#设置随机延迟

print("第", i, "页:")

next_page(i)

save_html() if __name__ == "__main__":

main()

9.附上完整代码

import time

from selenium import webdriver

from selenium.webdriver.support import expected_conditions as EC

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

import random

import json

import csv

from lxml import etree options = webdriver.ChromeOptions()

options.add_experimental_option('prefs', {'profile.managed_default_content_settings.images': 2})

#不加载图片

browser = webdriver.Chrome(options=options)

wait =WebDriverWait(browser,50)#设置等待时间

url = 'https://www.jd.com/'

data_list= []#设置全局变量用来存储数据

keyword ="python爬虫"#关键词 def search():

browser.get('https://www.jd.com/')

try:

input = wait.until(

EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#key"))

) #等到搜索框加载出来

submit = wait.until(

EC.element_to_be_clickable((By.CSS_SELECTOR, "#search > div > div.form > button"))

)#等到搜索按钮可以被点击

input[0].send_keys(keyword)#向搜索框内输入关键词

submit.click()#点击

total = wait.until(

EC.presence_of_all_elements_located(

(By.CSS_SELECTOR, '#J_bottomPage > span.p-skip > em:nth-child(1) > b')

)

)#记录一下总页码,等到总页码加载出来

# # 滑动到底部,加载出后三十个货物信息

# browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

# wait.until(

# EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#J_goodsList > ul > li:nth-child(60)"))

# )

html = browser.page_source#获取网页信息

prase_html(html)#调用提取数据的函数

return total[0].text#返回总页数

except TimeoutError:

search() def next_page(page_number):

try:

# 滑动到底部

browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(random.randint(1, 3))#设置随机延迟

button = wait.until(

EC.element_to_be_clickable((By.CSS_SELECTOR, '#J_bottomPage > span.p-num > a.pn-next > em'))

)#翻页按钮

button.click()# 翻页动作

wait.until(

EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#J_goodsList > ul > li:nth-child(30)"))

)#等到30个商品都加载出来

# 滑动到底部,加载出后三十个货物信息

browser.execute_script("window.scrollTo(0, document.body.scrollHeight);")

wait.until(

EC.presence_of_all_elements_located((By.CSS_SELECTOR, "#J_goodsList > ul > li:nth-child(60)"))

)#等到60个商品都加载出来

wait.until(

EC.text_to_be_present_in_element((By.CSS_SELECTOR, "#J_bottomPage > span.p-num > a.curr"), str(page_number))

)# 判断翻页成功,高亮的按钮数字与设置的页码一样

html = browser.page_source#获取网页信息

prase_html(html)#调用提取数据的函数

except TimeoutError:

return next_page(page_number) def prase_html(html):

html = etree.HTML(html)

# 开始提取信息,找到ul标签下的全部li标签

try:

lis = browser.find_elements_by_class_name('gl-item')

# 遍历

for li in lis:

# 名字

title = li.find_element_by_xpath('.//div[@class="p-name p-name-type-2"]//em').text

# 价格

price = li.find_element_by_xpath('.//div[@class="p-price"]//i').text

# 评论数

comment = li.find_elements_by_xpath('.//div[@class="p-commit"]//a')

# 商铺名字

shop_name = li.find_elements_by_xpath('.//div[@class="p-shop"]//a')

if comment:

comment = comment[0].text

else:

comment = None

if shop_name:

shop_name = shop_name[0].text

else:

shop_name = None

data_dict ={}#写入字典

data_dict["title"] = title

data_dict["price"] = price

data_dict["shop_name"] = shop_name

data_dict["comment"] = comment

print(data_dict)

data_list.append(data_dict)#写入全局变量

except TimeoutError:

prase_html(html) def save_html():

content = json.dumps(data_list, ensure_ascii=False, indent=2)

#把全局变量转化为json数据

with open("jingdong1.json", "a+", encoding="utf-8") as f:

f.write(content)

print("json文件写入成功") with open('jingdong1.csv', 'w', encoding='utf-8', newline='') as f:

# 表头

title = data_list[0].keys()

# 声明writer

writer = csv.DictWriter(f, title)

# 写入表头

writer.writeheader()

# 批量写入数据

writer.writerows(data_list)

print('csv文件写入完成') def main():

print("第", 1, "页:")

total = int(search())

for i in range(2, 5):

# for i in range(2, total + 1):

time.sleep(random.randint(1, 3)) # 设置随机延迟

print("第", i, "页:")

next_page(i)

save_html() if __name__ == "__main__":

main()

最后再分享一些小福利

链接:https://pan.baidu.com/s/1sMxwTn7P2lhvzvWRwBjFrQ

提取码:kt2v

链接容易被举报过期,如果失效了就在这里领取吧

python爬虫——用selenium爬取京东商品信息的更多相关文章

- 爬虫之selenium爬取京东商品信息

import json import time from selenium import webdriver """ 发送请求 1.1生成driver对象 2.1窗口最大 ...

- selenium模块使用详解、打码平台使用、xpath使用、使用selenium爬取京东商品信息、scrapy框架介绍与安装

今日内容概要 selenium的使用 打码平台使用 xpath使用 爬取京东商品信息 scrapy 介绍和安装 内容详细 1.selenium模块的使用 # 之前咱们学requests,可以发送htt ...

- 利用selenium爬取京东商品信息存放到mongodb

利用selenium爬取京东商城的商品信息思路: 1.首先进入京东的搜索页面,分析搜索页面信息可以得到路由结构 2.根据页面信息可以看到京东在搜索页面使用了懒加载,所以为了解决这个问题,使用递归.等待 ...

- 爬虫系列(十三) 用selenium爬取京东商品

这篇文章,我们将通过 selenium 模拟用户使用浏览器的行为,爬取京东商品信息,还是先放上最终的效果图: 1.网页分析 (1)初步分析 原本博主打算写一个能够爬取所有商品信息的爬虫,可是在分析过程 ...

- Python爬虫-爬取京东商品信息-按给定关键词

目的:按给定关键词爬取京东商品信息,并保存至mongodb. 字段:title.url.store.store_url.item_id.price.comments_count.comments 工具 ...

- selenium+phantomjs爬取京东商品信息

selenium+phantomjs爬取京东商品信息 今天自己实战写了个爬取京东商品信息,和上一篇的思路一样,附上链接:https://www.cnblogs.com/cany/p/10897618. ...

- 爬虫—Selenium爬取JD商品信息

一,抓取分析 本次目标是爬取京东商品信息,包括商品的图片,名称,价格,评价人数,店铺名称.抓取入口就是京东的搜索页面,这个链接可以通过直接构造参数访问https://search.jd.com/Sea ...

- Python爬虫使用selenium爬取qq群的成员信息(全自动实现自动登陆)

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者: python小爬虫 PS:如有需要Python学习资料的小伙伴可以 ...

- 八个commit让你学会爬取京东商品信息

我发现现在不用标题党的套路还真不好吸引人,最近在做相关的事情,从而稍微总结出了一些文字.我一贯的想法吧,虽然才疏学浅,但是还是希望能帮助需要的人.博客园实在不适合这种章回体的文章.这里,我贴出正文的前 ...

随机推荐

- kerberos系列之flink认证配置

大数据安全系列的其它文章 https://www.cnblogs.com/bainianminguo/p/12548076.html-----------安装kerberos https://www. ...

- Gin框架系列01:极速上手

Gin是什么? Gin是Go语言编写的web框架,具备中间件.崩溃处理.JSON验证.内置渲染等多种功能. 准备工作 本系列演示所有代码都在Github中,感兴趣的同学可以自行查阅,欢迎大家一起完善. ...

- CodeForces 506B/505D Mr. Kitayuta's Technology

Portal:http://codeforces.com/problemset/problem/506/B http://codeforces.com/problemset/problem/505/D ...

- NKOJ3751 扫雷游戏

问题描述 有一款有趣的手机游戏.棋盘上有n颗地雷,玩家需要至少扫掉其中的k颗雷.每一步,玩家可以用手指在手机屏幕上划一条直线,该直线经过的地雷都会被扫除掉.问,最少需要划几次就能扫除k颗以上的地雷? ...

- Oracle 12C安装教程

Oracle 12C安装教程 由 Alma 创建, 最后一次修改 2018-06-04 10:32:31 Oracle 12c,全称Oracle Database 12c,是Oracle 11g的升级 ...

- 【Mongodb】聚合查询 && 固定集合

概述 数据存储是为了可查询,统计.若数据只需存储,不需要查询,这种数据也没有多大价值 本篇介绍Mongodb 聚合查询(Aggregation) 固定集合(Capped Collections) 准备 ...

- Jenkins Pipeline 持续集成

Jenkins Pipeline 持续集成 Pipeline Script 执行流程 在使用Pipeline之前请确保Jenkins是2.x版本以上,并且安装了Pipeline插件. Jenkins提 ...

- 微信小程序H5预览页面框架

<!DOCTYPE html> <html> <head> <meta http-equiv="Content-Type" content ...

- 汇编刷题:在M单元和N单元分别存有一个8位无符号数36H和95H,要求比较并输出 M大于N 或者 M小于N

DATA SEGMENT M DB 36H N DB 95H RESAULT1 DB 'M>N$' RESAULT2 DB 'M<N$' DATA ENDS ...

- Linux 压缩备分篇(一 备份数据)

备份文件 dump dump: -S 仅列出待备份数据需要多少磁盘空间才能够备份完毕 -u 将 ...