TensorFlow系列专题(五):BP算法原理

欢迎大家关注我们的网站和系列教程:http://www.tensorflownews.com/

,学习更多的机器学习、深度学习的知识!

一.反向传播算法简介

二.前馈计算的过程

- 第一层隐藏层的计算

- 第二层隐藏层的计算

- 输出层的计算

三.反向传播的计算

- 计算偏导数

四.参考文献

一.反向传播算法

反向传播算法[1](Backpropagation Algorithm,简称BP算法)是深度学习的重要思想基础,对于初学者来说也是必须要掌握的基础知识,在这一小节里,我们会较为详细的介绍这一重点知识。

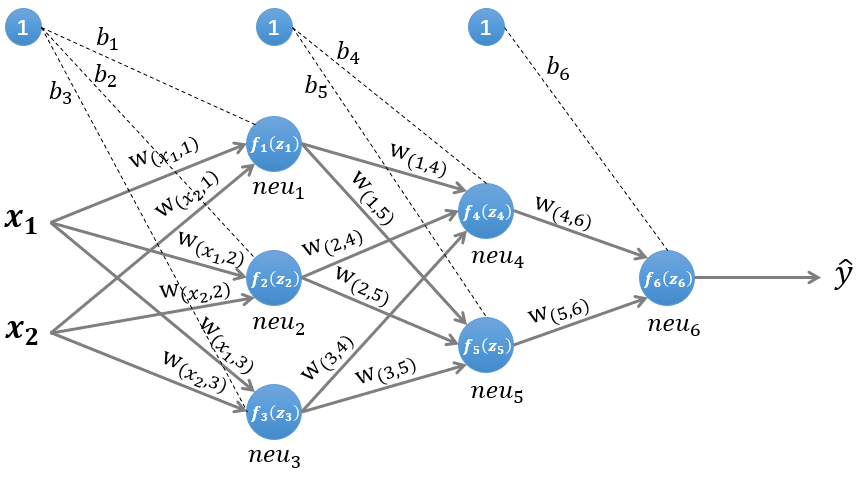

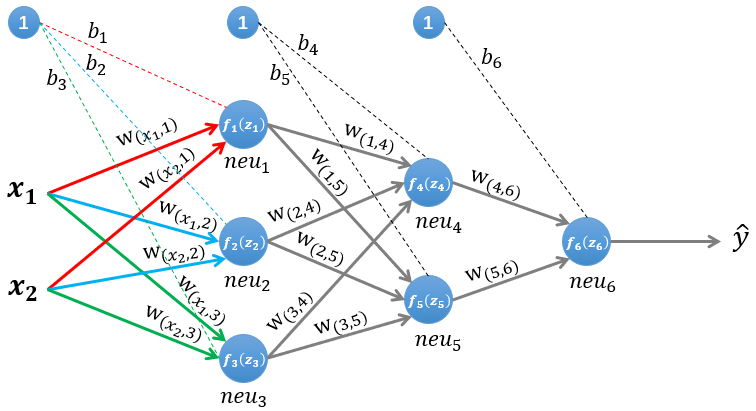

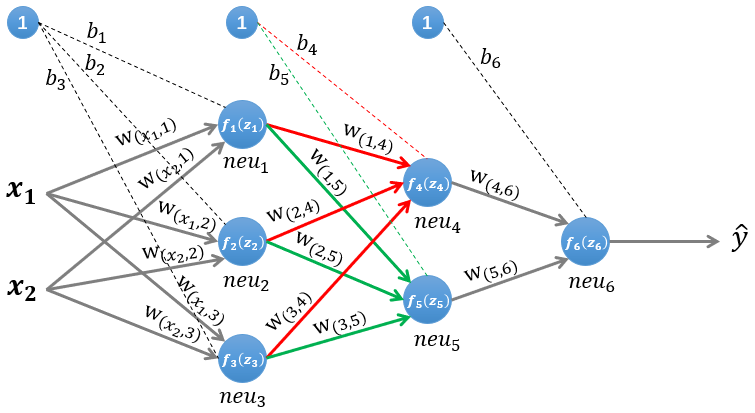

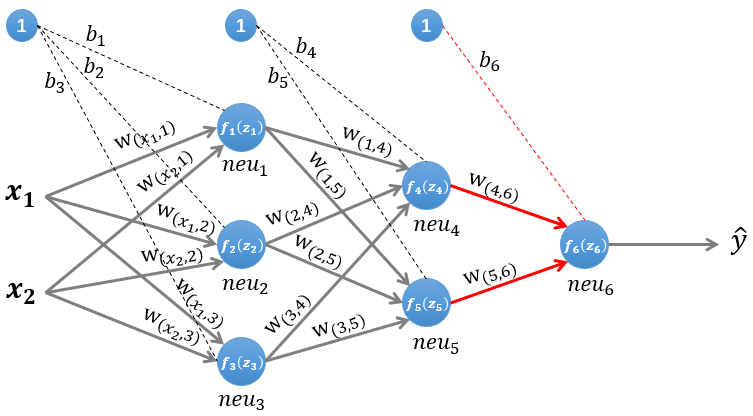

我们使用一个如图1所示的神经网络,该图所示是一个三层神经网络,两层隐藏层和一层输出层,输入层有两个神经元,接收输入样本 , 为网络的输出。

图1 一个三层神经网络

二.前馈计算的过程

为了理解神经网络的运算过程,我们需要先搞清楚前馈计算,即数据沿着神经网络前向传播的计算过程,以图1所示的网络为例:

输入的样本为:

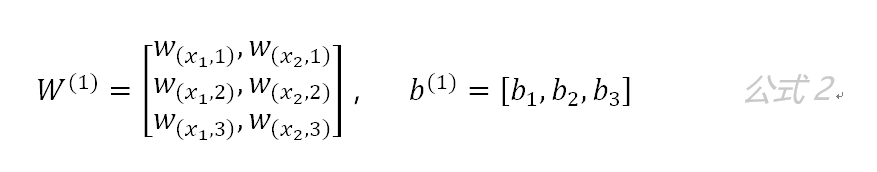

第一层网络的参数为:

第二层网络的参数为:

第三层网络的参数为:

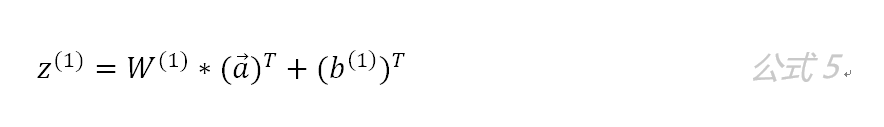

- 第一层隐藏层的计算

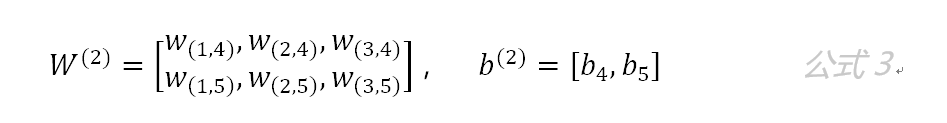

图2 计算第一层隐藏层

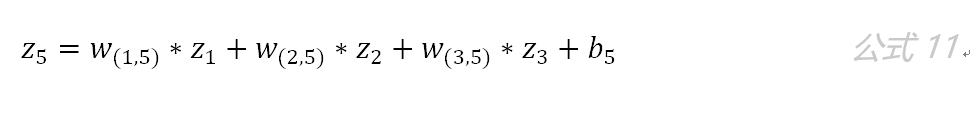

第一层隐藏层有三个神经元:neu1 、neu2 和neu3 。该层的输入为:

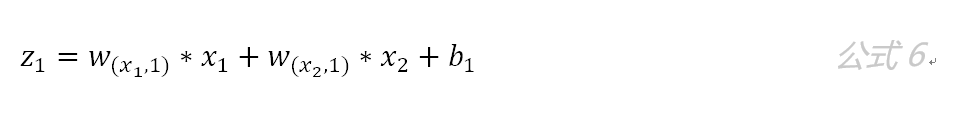

以 neu1神经元为例,则其输入为:

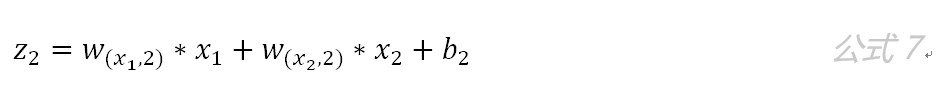

同理有:

假设我们选择函数 作为该层的激活函数(图1中的激活函数都标了一个下标,一般情况下,同一层的激活函数都是一样的,不同层可以选择不同的激活函数),那么该层的输出为: f1(z1)、f2(z2) 和f3(z3) 。

·第二层隐藏层的计算

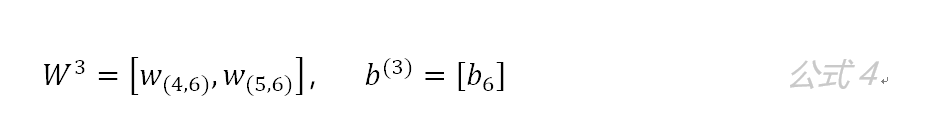

图3 计算第二层隐藏层

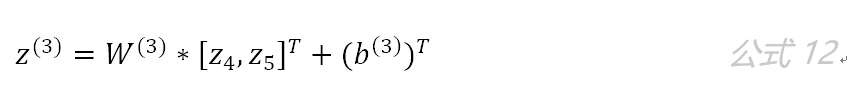

第二层隐藏层有两个神经元:neu4 和neu5 。该层的输入为:

即第二层的输入是第一层的输出乘以第二层的权重,再加上第二层的偏置。因此得到 和 的输入分别为:

该层的输出分别为: f4(z4)和f5(z5) 。

- 输出层的计算

图4 计算输出层

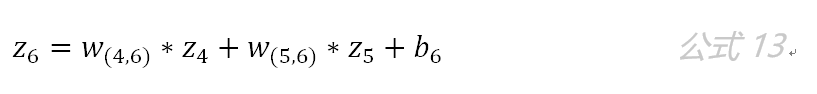

输出层只有一个神经元:neu6 。该层的输入为:

即:

因为该网络要解决的是一个二分类问题,所以输出层的激活函数也可以使用一个Sigmoid型函数,神经网络最后的输出为: f6(z6)。

三.反向传播的计算

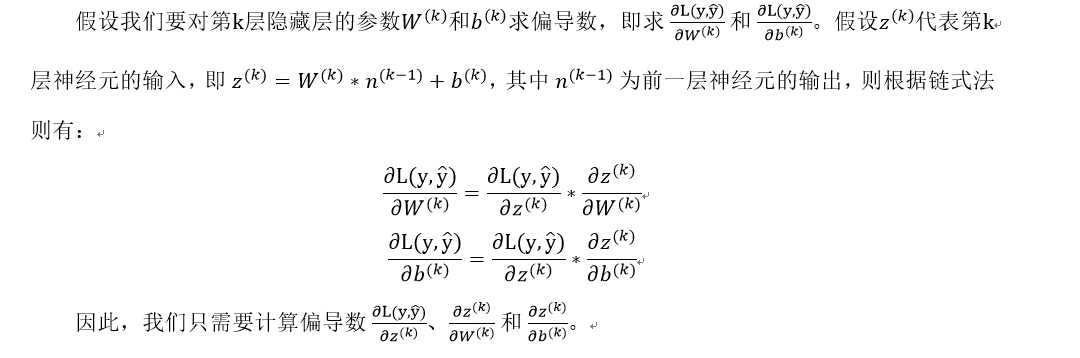

上一小节里我们已经了解了数据沿着神经网络前向传播的过程,这一节我们来介绍更重要的反向传播的计算过程。假设我们使用随机梯度下降的方式来学习神经网络的参数,损失函数定义为 ,其中 是该样本的真实类标。使用梯度下降进行参数的学习,我们必须计算出损失函数关于神经网络中各层参数(权重w和偏置b)的偏导数。

下面是基于随机梯度下降更新参数的反向传播算法:

输入:训练集:D={(xi,yi)}, i=1,2,…,N

学习率:γ

训练回合数(epoch):T

初始化网络各层参数w(t) 和b(t)

for t=1 …T do

打乱训练集中样本的顺序

for i=1… N do

(1)获取一个训练样本,前馈计算每一层的输入 和输出

(2)利用公式*反向传播计算每一层的误差项

(3)利用公式和公式*计算每一层参数的导数

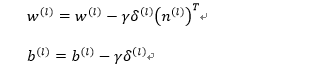

(4)更新参数:

以上是BP算法的介绍,下次文章中有一个BP算法计算的完整示例,希望加深理解的读者可以跟着示例计算一遍。

四.参考文献

[1]. Learing representations by back-propagating erros.David E.Rumelhart,Geoffrey E.Hinton,Ronald J.Williams

本篇文章出自http://www.tensorflownews.com,对深度学习感兴趣,热爱Tensorflow的小伙伴,欢迎关注我们的网站!

TensorFlow系列专题(五):BP算法原理的更多相关文章

- TensorFlow系列专题(七):一文综述RNN循环神经网络

欢迎大家关注我们的网站和系列教程:http://panchuang.net/ ,学习更多的机器学习.深度学习的知识! 目录: 前言 RNN知识结构 简单循环神经网络 RNN的基本结构 RNN的运算过程 ...

- TensorFlow系列专题(九):常用RNN网络结构及依赖优化问题

欢迎大家关注我们的网站和系列教程:http://panchuang.net/ ,学习更多的机器学习.深度学习的知识! 目录: 常用的循环神经网络结构 多层循环神经网络 双向循环神经网络 递归神经网络 ...

- Tensorflow系列专题(四):神经网络篇之前馈神经网络综述

目录: 神经网络前言 神经网络 感知机模型 多层神经网络 激活函数 Logistic函数 Tanh函数 ReLu函数 损失函数和输出单元 损失函数的选择 均方误差损失函数 交叉熵损失函数 输出单元的选 ...

- TensorFlow系列专题(三):深度学习简介

一.深度学习的发展历程 深度学习的起源阶段 深度学习的发展阶段 深度学习的爆发阶段 二.深度学习的应用 自然语言处理 语音识别与合成 图像领域 三.参考文献 一.深度学习的发展历程 作为机器学习最 ...

- 多层神经网络BP算法 原理及推导

首先什么是人工神经网络?简单来说就是将单个感知器作为一个神经网络节点,然后用此类节点组成一个层次网络结构,我们称此网络即为人工神经网络(本人自己的理解).当网络的层次大于等于3层(输入层+隐藏层(大于 ...

- TensorFlow系列专题(十三): CNN最全原理剖析(续)

目录: 前言 卷积层(余下部分) 卷积的基本结构 卷积层 什么是卷积 滑动步长和零填充 池化层 卷积神经网络的基本结构 总结 参考文献 一.前言 上一篇我们一直说到了CNN[1]卷积层的特性,今天 ...

- TensorFlow系列专题(二):机器学习基础

欢迎大家关注我们的网站和系列教程:http://www.tensorflownews.com/ ,学习更多的机器学习.深度学习的知识! 目录: 数据预处理 归一化 标准化 离散化 二值化 哑编码 特征 ...

- [.NET领域驱动设计实战系列]专题五:网上书店规约模式、工作单元模式的引入以及购物车的实现

一.前言 在前面2篇博文中,我分别介绍了规约模式和工作单元模式,有了前面2篇博文的铺垫之后,下面就具体看看如何把这两种模式引入到之前的网上书店案例里. 二.规约模式的引入 在第三专题我们已经详细介绍了 ...

- TensorFlow系列专题(十一):RNN的应用及注意力模型

磐创智能-专注机器学习深度学习的教程网站 http://panchuang.net/ 磐创AI-智能客服,聊天机器人,推荐系统 http://panchuangai.com/ 目录: 循环神经网络的应 ...

随机推荐

- 量化投资学习笔记30——《Python机器学习应用》课程笔记04

有监督学习 常用分类算法 KNN:K近邻分类器.通过计算待分类数据点,与已知数据中所有点的距离,取距离最小的前K个点,根据"少数服从多数"的原则,将这个数据点划分为出现次数最多的那 ...

- ZYNQ自定义AXI总线IP应用——PWM实现呼吸灯效果

一.前言 在实时性要求较高的场合中,CPU软件执行的方式显然不能满足需求,这时需要硬件逻辑实现部分功能.要想使自定义IP核被CPU访问,就必须带有总线接口.ZYNQ采用AXI BUS实现PS和PL之间 ...

- 一个基于Bootstrap实现的HMTL可视化编辑工具

疫情禁足在家,用原生的JS实现了一个HTML可视化编辑工具,页面布局基于Bootstrap.大约一个月时间,打通主要技术关卡,实现了第一版: 可以拖放编辑,实现了几乎所有的bootstrap预定义 ...

- 二叉堆的BuildHeap操作

优先队列(二叉堆)BuildHeap操作 \(BuildHeap(H)\)操作把\(N\)个关键字作为输入并把它们放入空堆中.显然,这可以使用\(N\)个相继的\(Insert\)操作来完成.由于每个 ...

- Windows 使用激活服务器激活操作步骤

最近装了win10企业版系统,总结下激活步骤,激活后是正版,半年后需要重新激活,不介意的小伙伴可以试试,这不是重点,重点是企业版超级clean...... 服务器激活系统步骤,打开cmd或者xshel ...

- HTML与CSS 开发常用语义化命名

一.布局❤️ header 头部/页眉:index 首页/索引:logo 标志:nav/sub_nav 导航/子导航:banner 横幅广告:main/content 主体/内容:container/ ...

- [LeetCode] 1103. Distribute Candies to People 分糖果

题目: 思路: 本题一开始的思路就是按照流程一步步分下去,算是暴力方法,在官方题解中有利用等差数列进行计算的 这里只记录一下自己的暴力解题方式 只考虑每次分配的糖果数,分配的糖果数为1,2,3,4,5 ...

- Vmware安装的linux系统开机黑屏,关闭显示虚拟机忙怎么怎么解决?

在vm虚拟机中,可能会遇到打开一台主机直接黑屏,而且无法关闭,关闭会显示虚拟机繁忙这种情况,如下图: 一般是因为没有正常关机或者操作不当导致的 对此,解决办法一般有两种 第一种方法: 1.重启电脑 ...

- Apache Druid 的集群设计与工作流程

导读:本文将描述 Apache Druid 的基本集群架构,说明架构中各进程的作用.并从数据写入和数据查询两个角度来说明 Druid 架构的工作流程. 关注公众号 MageByte,设置星标点「在看」 ...

- Flutter保持页面状态AutomaticKeepAliveClientMixin

使用bottomNavigationBar切换底部tab,再切换回来就会丢失之前的状态(重新渲染列表,丢失滚动条位置). 解决方法 使用 AutomaticKeepAliveClientMixin 重 ...